12/09/2023

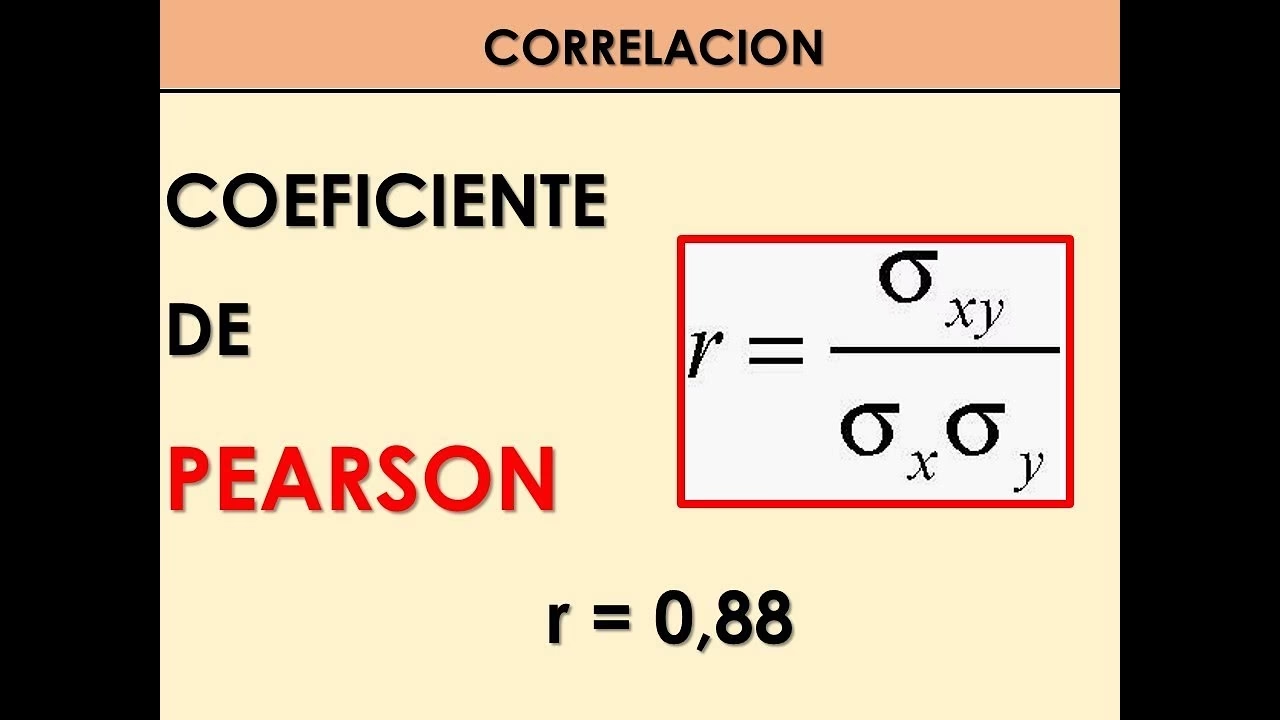

En el vasto universo de los datos, comprender cómo se relacionan diferentes variables es crucial para tomar decisiones informadas y extraer conclusiones significativas. Aquí es donde el Coeficiente de Correlación de Pearson, a menudo denotado como 'r', emerge como una herramienta estadística fundamental. Este coeficiente nos permite cuantificar la fuerza y la dirección de la asociación lineal entre dos variables, ofreciendo una visión clara de su interdependencia.

Desde su formulación por el matemático británico Karl Pearson en 1896, basándose en trabajos previos de Francis Galton y Auguste Bravais, esta medida se ha consolidado como un pilar en campos tan diversos como la economía, la psicología, la biología y las ciencias sociales. Su valor oscila entre -1 y +1, donde cada extremo indica una relación lineal perfecta, ya sea negativa o positiva, y un valor de 0 sugiere la ausencia de cualquier relación lineal. Comprender la mecánica y la interpretación de este coeficiente no solo es una habilidad estadística valiosa, sino una puerta de entrada para desentrañar los patrones ocultos en cualquier conjunto de datos.

- ¿Qué es Exactamente el Coeficiente de Correlación de Pearson?

- La Fórmula del Coeficiente de Correlación de Pearson

- Variables Dependientes e Independientes: Una Distinción Crucial

- Correlación No Implica Causalidad

- Significancia Estadística: Más Allá de la Fuerza

- El Coeficiente de Determinación (R²): Desentrañando la Varianza

- El Impacto de los Valores Atípicos (Outliers)

- Cómo Reportar el Coeficiente de Correlación de Pearson

- Preguntas Frecuentes sobre el Coeficiente de Correlación de Pearson

- ¿La correlación de Pearson establece relaciones de causa y efecto?

- ¿Cómo puedo determinar si la asociación es estadísticamente significativa?

- Si mi correlación es estadísticamente significativa, ¿significa que la asociación es fuerte?

- ¿Qué hago si hay valores atípicos (outliers) en mis datos?

- ¿Cuál es la diferencia entre el Coeficiente de Correlación de Pearson y el Coeficiente de Asimetría de Pearson?

- ¿Qué significa un valor de 'r' cercano a cero?

¿Qué es Exactamente el Coeficiente de Correlación de Pearson?

El Coeficiente de Correlación de Pearson, formalmente conocido como el Coeficiente de Correlación Producto-Momento de Pearson (PPMCC), es una medida de la relación lineal entre dos conjuntos de datos. Esencialmente, nos dice qué tan bien se ajusta una línea recta a los datos cuando se grafican en un diagrama de dispersión. Su valor, 'r', es una métrica estandarizada que siempre caerá dentro del rango de -1 a +1. Un valor de +1 indica una relación lineal positiva perfecta, lo que significa que a medida que una variable aumenta, la otra también lo hace de manera proporcional y predecible. Por ejemplo, si estudiáramos la relación entre las horas de estudio y las calificaciones, un 'r' cercano a +1 implicaría que más horas de estudio se asocian consistentemente con calificaciones más altas.

Por otro lado, un valor de -1 señala una relación lineal negativa perfecta. Esto significa que a medida que una variable aumenta, la otra disminuye de forma proporcional. Un ejemplo podría ser la relación entre la temperatura exterior y las ventas de abrigos de invierno: a temperaturas más altas, las ventas de abrigos tienden a disminuir. Finalmente, un valor de 0 indica que no existe una relación lineal discernible entre las dos variables. Es importante destacar que un 'r' de 0 no significa que no haya relación alguna entre las variables, solo que no hay una relación de tipo lineal. Podría existir una relación no lineal, como una curvilínea, que el coeficiente de Pearson no detectaría.

Interpretación de los Valores de 'r'

Los valores intermedios entre -1, 0 y +1 indican una relación lineal, pero no perfecta. Cuanto más cerca esté 'r' de +1 o -1, más fuerte será la relación lineal. Cuanto más cerca esté de 0, más débil será la relación lineal.

Consideremos un ejemplo práctico: si calculamos un coeficiente de correlación de 0.75 entre la edad de una persona y el porcentaje de personas de esa edad con una enfermedad cardíaca, esto sugiere una correlación moderada a fuerte. Implica que, a medida que la edad aumenta, también lo hace la probabilidad de tener una enfermedad cardíaca. Sin embargo, si el valor fuera 0.20, la relación lineal sería mucho más débil, indicando que aunque hay una tendencia, no es tan pronunciada ni consistente.

| Valor de 'r' | Interpretación |

|---|---|

| +1 | Relación lineal positiva perfecta |

| +0.7 a +0.99 | Relación lineal positiva muy fuerte |

| +0.5 a +0.69 | Relación lineal positiva moderada a fuerte |

| +0.3 a +0.49 | Relación lineal positiva débil a moderada |

| +0.01 a +0.29 | Relación lineal positiva muy débil o insignificante |

| 0 | No hay relación lineal |

| -0.01 a -0.29 | Relación lineal negativa muy débil o insignificante |

| -0.3 a -0.49 | Relación lineal negativa débil a moderada |

| -0.5 a -0.69 | Relación lineal negativa moderada a fuerte |

| -0.7 a -0.99 | Relación lineal negativa muy fuerte |

| -1 | Relación lineal negativa perfecta |

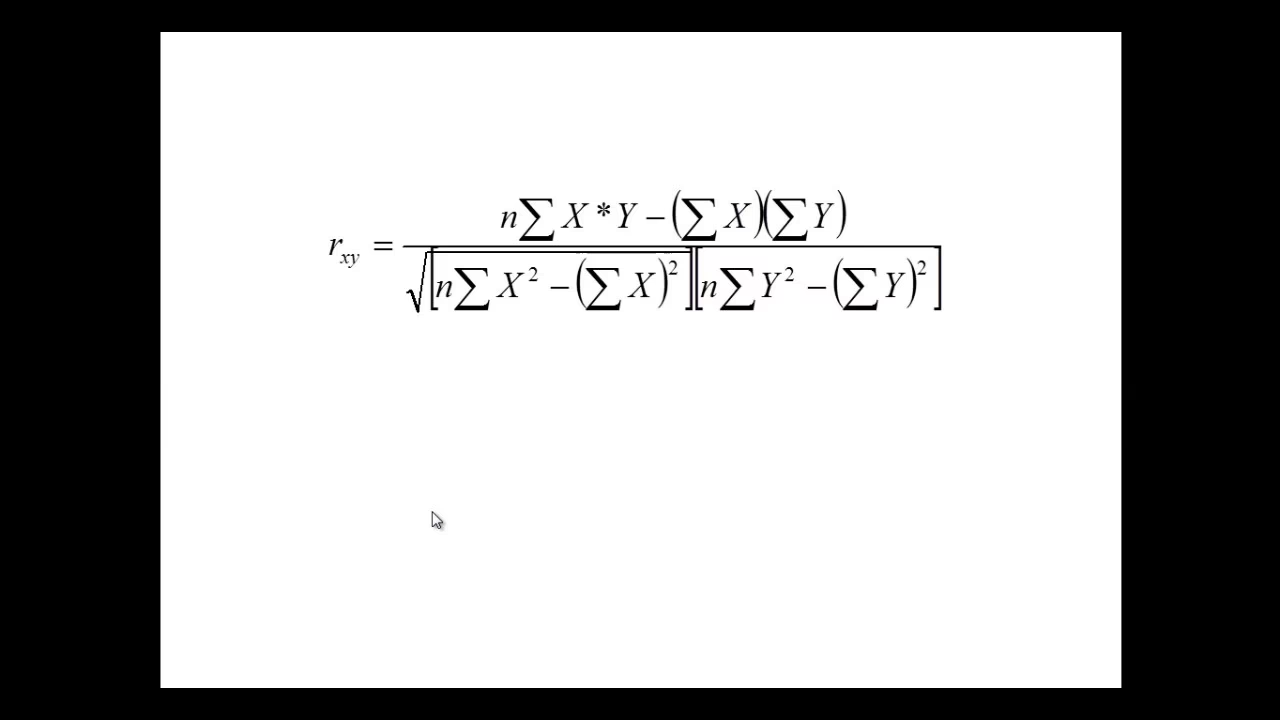

La Fórmula del Coeficiente de Correlación de Pearson

El cálculo del coeficiente de correlación de Pearson se realiza mediante una fórmula específica que relaciona las sumas de los productos de las variables con sus sumas de cuadrados. La fórmula es la siguiente:

r = [n(Σxy) − ΣxΣy] / √[n(Σx²) − (Σx)²][n(Σy²) − (Σy)²]

Desglosemos cada componente de esta fórmula para entenderla mejor:

- r: Es el Coeficiente de Correlación de Pearson que estamos buscando.

- n: Representa el tamaño de la muestra, es decir, el número de pares de datos (observaciones) que tenemos.

- Σxy: Es la suma de los productos de cada par de valores x e y. Para cada observación, multiplicamos el valor de x por el valor de y, y luego sumamos todos esos productos.

- Σx: Es la suma de todos los valores de la variable independiente x.

- Σy: Es la suma de todos los valores de la variable dependiente y.

- Σx²: Es la suma de los cuadrados de cada valor de la variable independiente x. Primero elevamos al cuadrado cada valor de x, y luego sumamos todos esos cuadrados.

- (Σx)²: Es el cuadrado de la suma de todos los valores de la variable independiente x. Aquí, primero sumamos todos los valores de x, y luego elevamos al cuadrado esa suma total.

- Σy²: Es la suma de los cuadrados de cada valor de la variable dependiente y. Similar a Σx², pero para la variable y.

- (Σy)²: Es el cuadrado de la suma de todos los valores de la variable dependiente y. Similar a (Σx)², pero para la variable y.

- √: Representa la raíz cuadrada, aplicada al producto de los dos términos en el denominador.

El proceso de cálculo implica primero obtener todas estas sumas y luego sustituirlas en la fórmula. Aunque hoy en día la mayoría de los programas estadísticos calculan esto automáticamente, comprender cada parte de la fórmula es fundamental para interpretar correctamente el resultado y entender qué tipo de información se está procesando.

Variables Dependientes e Independientes: Una Distinción Crucial

Una de las consideraciones más importantes al utilizar el coeficiente de correlación de Pearson es la correcta identificación de las variables independientes y dependientes. Aunque la fórmula de Pearson es simétrica (es decir, el valor de 'r' será el mismo si se intercambian 'x' e 'y'), la interpretación de los resultados no lo es.

Tomemos el ejemplo de la edad y la enfermedad cardíaca. Si la edad se considera la variable independiente y el porcentaje de personas con enfermedad cardíaca la variable dependiente, un coeficiente de correlación de 0.75 sugiere que la edad es un factor que contribuye al riesgo de enfermedad cardíaca. Esta conclusión tiene sentido lógico. Sin embargo, si se invierten las variables, de modo que el riesgo de enfermedad cardíaca se convierte en la variable independiente y la edad en la dependiente, el coeficiente de correlación seguirá siendo 0.75. Pero la conclusión resultante, que el riesgo de enfermedad cardíaca es un factor determinante de la edad de una persona, es claramente sin sentido.

Este ejemplo subraya la importancia crítica de que el investigador identifique de manera adecuada qué variable es la independiente y cuál es la dependiente, basándose en el conocimiento del dominio y la lógica del estudio. El coeficiente de Pearson solo mide la fuerza de la asociación lineal; la dirección de la causalidad o la influencia debe ser determinada por el diseño del estudio y el juicio del analista, no por la fórmula en sí misma.

Correlación No Implica Causalidad

Este es quizás uno de los principios más importantes y a menudo malinterpretados en la estadística: la correlación no implica causalidad. El coeficiente de correlación de Pearson nos indica el grado en que dos variables se mueven juntas de manera lineal, pero no nos dice si una causa la otra. Es un error común y peligroso asumir una relación de causa y efecto basándose únicamente en una correlación fuerte.

Por ejemplo, podría haber una correlación positiva fuerte entre las ventas de helados y el número de ahogamientos en una playa. Un coeficiente de Pearson alto en este caso no significa que comer helado cause ahogamientos, ni viceversa. La explicación más lógica es que ambos eventos están correlacionados con una tercera variable: la temperatura ambiente. En días calurosos, más personas compran helados y más personas van a nadar, lo que aumenta la probabilidad de ahogamientos. Esta tercera variable se conoce como variable de confusión o latente.

El coeficiente de correlación mide la asociación, la extensión en que las variables están relacionadas entre sí. Cualquier conclusión sobre una relación de causa y efecto debe basarse en un juicio analítico riguroso, un diseño experimental adecuado (como ensayos controlados aleatorios) y un conocimiento profundo del tema en cuestión, no solo en un valor de 'r'. Es crucial recordar que la correlación es una medida de asociación, no de influencia causal.

Significancia Estadística: Más Allá de la Fuerza

Mientras que el coeficiente de correlación de Pearson ('r') es una medida de la fuerza de una asociación lineal, no es una medida de la significancia estadística de esa asociación. La significancia estadística es un análisis separado que evalúa si la correlación observada en una muestra es lo suficientemente grande como para inferir que existe una correlación similar en la población de la que se extrajo la muestra, o si el resultado podría deberse simplemente al azar.

La significancia de un coeficiente de correlación muestral 'r' se evalúa típicamente utilizando una prueba t. Esta prueba compara el 'r' observado con un 'r' esperado bajo la hipótesis nula, que postula que no hay relación lineal en la población (es decir, que la correlación poblacional es cero). Si el p-valor resultante de la prueba t es menor que un nivel de significancia predefinido (comúnmente 0.05), se rechaza la hipótesis nula, lo que sugiere que la correlación observada es estadísticamente significativa y es poco probable que haya ocurrido solo por casualidad.

Sin embargo, es vital comprender que la significancia estadística no equivale a la importancia práctica. Una correlación puede ser estadísticamente significativa (es decir, no es cero en la población) pero ser muy débil en términos de fuerza (un 'r' cercano a cero), especialmente en muestras muy grandes. Por el contrario, una correlación fuerte en una muestra pequeña podría no ser estadísticamente significativa si la variabilidad de los datos es alta. La significancia solo nos dice si existe una relación, no cuán fuerte o importante es esa relación en el mundo real.

El Coeficiente de Determinación (R²): Desentrañando la Varianza

Un concepto estrechamente relacionado con el coeficiente de correlación de Pearson es el coeficiente de determinación, denotado como R². Este valor se calcula simplemente elevando al cuadrado el coeficiente de correlación de Pearson: R² = r². Por ejemplo, si un coeficiente de correlación de Pearson es 0.6, el coeficiente de determinación sería 0.36 (0.6 * 0.6). Si el coeficiente de Pearson es -0.8, el coeficiente de determinación sería 0.64 (-0.8 * -0.8).

El R² tiene una interpretación muy poderosa y útil: representa la proporción de la varianza total en una variable dependiente que puede ser explicada por la varianza en la variable independiente, a través de su relación lineal. En otras palabras, nos dice qué porcentaje de la variación en una variable es compartida o predecible por la otra variable en el modelo de correlación.

Continuando con el ejemplo de un r = 0.6, un R² = 0.36 significa que el 36% de la varianza en una variable puede ser explicada por la otra variable. El 64% restante de la varianza no se explica por la relación lineal entre estas dos variables y podría deberse a otros factores no medidos o al azar. Este valor es crucial porque cuantifica la utilidad predictiva del modelo de correlación. Un R² alto indica que el modelo de correlación es muy bueno para explicar la variabilidad observada.

Es importante reportar el coeficiente de determinación como una proporción (por ejemplo, 0.36) y no como un porcentaje (36%), aunque a menudo se discuta en términos porcentuales para facilitar la comprensión.

El Impacto de los Valores Atípicos (Outliers)

Los valores atípicos, también conocidos como outliers, son puntos de datos que se desvían significativamente del patrón general de los demás datos. En el análisis de correlación de Pearson, los outliers pueden tener un efecto muy grande en la línea de mejor ajuste y, consecuentemente, en el coeficiente de correlación. Un solo outlier puede distorsionar drásticamente el valor de 'r', llevándonos a conclusiones erróneas sobre la fuerza y la dirección de la relación.

La forma más sencilla de detectar outliers en un análisis de correlación es mediante la creación de un diagrama de dispersión. Al graficar las dos variables una contra la otra, los puntos de datos que no siguen la tendencia general y parecen estar 'fuera de lugar' serán visualmente evidentes. Estos puntos extremos pueden arrastrar la línea de mejor ajuste hacia ellos, cambiando la pendiente y la intersección, y alterando el coeficiente de correlación.

Una vez detectados, se debe decidir qué hacer con los outliers. Las opciones incluyen:

- Eliminar el punto de datos: Esto solo debe hacerse si hay una justificación clara y sólida, como un error de entrada de datos, un error de medición, o si el punto representa una población diferente. La eliminación debe ser transparente y justificada en el informe.

- Transformar los datos: En algunos casos, una transformación matemática de los datos puede reducir el impacto de los outliers.

- Utilizar métodos de correlación no paramétricos: Si no se puede justificar la eliminación de los outliers, o si los datos no cumplen con las suposiciones de normalidad necesarias para Pearson (aunque la fuente no lo menciona explícitamente, es una consideración común), se pueden utilizar pruebas de correlación no paramétricas, como la correlación de rangos de Spearman o el Tau de Kendall. Estas pruebas son mucho menos sensibles a los valores extremos porque trabajan con los rangos de los datos en lugar de con los valores brutos.

La presencia de outliers siempre debe investigarse cuidadosamente, ya que pueden contener información valiosa o ser indicativos de problemas en la recolección de datos.

Cómo Reportar el Coeficiente de Correlación de Pearson

Al presentar los resultados de un análisis de correlación de Pearson, es fundamental seguir un formato estándar para asegurar la claridad y la reproducibilidad. El formato general para reportar el coeficiente de correlación de Pearson es el siguiente:

r(df) = valor_r, p = p_valor

Donde:

- r: Es el símbolo del coeficiente de correlación de Pearson.

- df: Representa los grados de libertad. En el contexto de la correlación de Pearson, los grados de libertad se calculan como el número de pares de datos (N) menos 2 (es decir, N - 2).

- valor_r: Es el valor numérico calculado del coeficiente de correlación (por ejemplo, 0.75, -0.42, etc.).

- p_valor: Es el valor de probabilidad asociado a la significancia estadística de la correlación. Indica la probabilidad de obtener un coeficiente de correlación tan extremo o más extremo si la hipótesis nula (de que no hay correlación en la población) fuera verdadera.

Por ejemplo, si se realizó un estudio con 30 participantes (N=30) y se encontró una correlación de 0.65 con un p-valor de 0.001, se reportaría como: r(28) = 0.65, p = 0.001. Si el p-valor es muy pequeño, a menudo se reporta como p < .001.

Si no se ha realizado una prueba de significancia estadística para la correlación (lo cual es menos común en la práctica pero posible), simplemente se reporta el valor del coeficiente de correlación, por ejemplo: r = -0.52.

Es crucial que, además de reportar estos valores, se interprete el significado de la correlación en el contexto del estudio. Esto incluye discutir la dirección (positiva o negativa), la fuerza (débil, moderada, fuerte) y la implicación del valor de p.

Preguntas Frecuentes sobre el Coeficiente de Correlación de Pearson

¿La correlación de Pearson establece relaciones de causa y efecto?

No, bajo ninguna circunstancia. El coeficiente de correlación de Pearson mide la fuerza y la dirección de una relación lineal entre dos variables, pero no puede determinar si una variable causa a la otra. La causalidad debe inferirse a partir del diseño del estudio (por ejemplo, un experimento controlado) y el conocimiento teórico del dominio, no solo de una correlación estadística.

¿Cómo puedo determinar si la asociación es estadísticamente significativa?

La significancia estadística se determina generalmente mediante una prueba t del coeficiente de correlación. Esta prueba calcula un p-valor que, si es menor que un umbral predefinido (comúnmente 0.05), indica que la correlación observada es poco probable que haya ocurrido por puro azar y sugiere que existe una relación en la población. Muchos programas estadísticos, como SPSS Statistics, realizan esta prueba automáticamente.

Si mi correlación es estadísticamente significativa, ¿significa que la asociación es fuerte?

No necesariamente. La significancia estadística solo indica que se ha rechazado la hipótesis nula de que no hay relación en la población. No proporciona información sobre la fuerza o la importancia práctica de la relación. Una correlación muy débil puede ser estadísticamente significativa si el tamaño de la muestra es muy grande. Por lo tanto, siempre se deben considerar tanto el valor de 'r' (para la fuerza) como el p-valor (para la significancia).

¿Qué hago si hay valores atípicos (outliers) en mis datos?

Los valores atípicos pueden distorsionar significativamente el coeficiente de correlación de Pearson. Lo primero es detectarlos, lo que se puede hacer visualmente mediante un diagrama de dispersión. Si se pueden justificar como errores de entrada o mediciones anómalas, se pueden eliminar. Si no hay una justificación clara, o si los datos no cumplen con las suposiciones de Pearson, es recomendable considerar el uso de métodos de correlación no paramétricos, como la correlación de rangos de Spearman o el Tau de Kendall, que son menos sensibles a los valores extremos.

¿Cuál es la diferencia entre el Coeficiente de Correlación de Pearson y el Coeficiente de Asimetría de Pearson?

Son conceptos totalmente distintos. El Coeficiente de Correlación de Pearson mide la relación lineal entre dos variables. Por otro lado, el Coeficiente de Asimetría de Pearson (que tiene dos fórmulas, una de ellas utilizando la moda: sk = (media - moda) / desviación estándar) es una medida de la asimetría o falta de simetría de la distribución de una única variable. Evalúa si los datos están distribuidos simétricamente alrededor de su media o si están sesgados hacia un lado. No tienen relación directa en su propósito o cálculo.

¿Qué significa un valor de 'r' cercano a cero?

Un valor de 'r' cercano a cero indica que no hay una relación lineal fuerte entre las dos variables. Esto no significa que las variables no estén relacionadas en absoluto, solo que su relación no es de naturaleza lineal. Podrían tener una relación curvilínea o no tener ninguna relación de ningún tipo.

El Coeficiente de Correlación de Pearson es una herramienta poderosa y versátil para el análisis de datos. Su correcta aplicación e interpretación son fundamentales para extraer conclusiones válidas y evitar errores comunes. Dominar este concepto es un paso esencial para cualquier persona que trabaje con datos y busque comprender las relaciones subyacentes en ellos.

Si quieres conocer otros artículos parecidos a Coeficiente de Correlación de Pearson: Guía Completa puedes visitar la categoría Estadística.