22/04/2026

En el fascinante mundo de la computación, donde cada milisegundo cuenta, la eficiencia es la clave. Los sistemas operativos, verdaderos directores de orquesta, gestionan innumerables tareas simultáneamente, desde abrir una simple aplicación hasta ejecutar complejos cálculos. Pero, ¿cómo deciden qué tarea se ejecuta primero? La respuesta reside en los algoritmos de planificación de CPU, mecanismos inteligentes que determinan el orden en que los procesos acceden al procesador para optimizar el rendimiento, reducir los tiempos de espera y mejorar la utilización de los recursos.

Estos algoritmos son fundamentales para cualquier sistema informático moderno, ya que impactan directamente en la fluidez y la capacidad de respuesta que experimentamos como usuarios. Sin una planificación adecuada, incluso la máquina más potente podría parecer lenta y poco eficiente. Acompáñanos en este recorrido para desentrañar cómo funcionan estos algoritmos esenciales y por qué son tan cruciales para la informática actual.

- ¿Por qué son Cruciales los Algoritmos de Planificación de CPU?

- Principales Algoritmos de Planificación de Procesos

- Métricas Clave en la Planificación de Procesos

- Comparativa Detallada: FCFS vs. SJF

- Algoritmos de Planificación en Sistemas Operativos Populares

- Herramientas para la Gestión de la Planificación

- Preguntas Frecuentes sobre Algoritmos de Planificación

- Conclusión

¿Por qué son Cruciales los Algoritmos de Planificación de CPU?

La unidad central de procesamiento (CPU) es el cerebro de cualquier computadora, capaz de ejecutar una sola instrucción a la vez por núcleo. Sin embargo, los sistemas operativos modernos permiten que múltiples programas y procesos se ejecuten de manera aparentemente simultánea. Esta ilusión de paralelismo se logra mediante la alternancia rápida entre procesos, lo que se conoce como multitarea. Los algoritmos de planificación de CPU son los encargados de decidir cuándo un proceso debe detenerse y cuándo otro debe comenzar a ejecutarse en la CPU.

La importancia de estos algoritmos radica en varios factores:

- Optimización del Rendimiento: Buscan maximizar el uso de la CPU, asegurando que no permanezca inactiva cuando hay procesos listos para ejecutarse.

- Reducción de Tiempos de Espera: Minimizan el tiempo que los procesos pasan en la cola de espera antes de ser ejecutados, mejorando la experiencia del usuario.

- Equidad: Intentan proporcionar un acceso justo a la CPU para todos los procesos, evitando que algunos procesos monopolizen el recurso mientras otros sufren de inanición.

- Tiempo de Respuesta: En sistemas interactivos, es crucial que las tareas respondan rápidamente a las acciones del usuario. Los algoritmos de planificación ayudan a priorizar estas tareas.

- Throughput: Aumentan el número de procesos completados por unidad de tiempo.

Elegir el algoritmo adecuado para una carga de trabajo específica es un desafío, ya que cada uno tiene sus propias fortalezas y debilidades. Un algoritmo que es excelente para un tipo de tarea podría ser ineficiente para otro.

Principales Algoritmos de Planificación de Procesos

Existen varios algoritmos de planificación de trabajos, cada uno con características únicas y adecuado para escenarios específicos. A continuación, exploraremos los más importantes:

First-Come First-Served (FCFS)

El algoritmo First-Come First-Served (FCFS), o Primero en Llegar, Primero en Ser Atendido, es uno de los algoritmos de planificación de CPU más simples y directos. Su funcionamiento es análogo al de una cola en un supermercado: los trabajos se ejecutan en el orden en que llegan al sistema. Es un ejemplo de planificación no-apropiativa, lo que significa que una vez que un proceso comienza a ejecutarse, continuará hasta que finalice su ráfaga de CPU o se bloquee por alguna operación de E/S, sin ser interrumpido por la llegada de un nuevo proceso.

La implementación de FCFS se basa en una cola FIFO (First In, First Out). Su principal ventaja es su simplicidad, lo que facilita su comprensión e implementación. Sin embargo, esta simplicidad conlleva desventajas significativas. Una de las más notables es la posibilidad de tiempos de espera promedio prolongados para trabajos cortos, especialmente si un trabajo largo llega primero y ocupa la CPU. Esto puede causar el efecto de convoy, un fenómeno donde trabajos más cortos se retrasan considerablemente debido a que un proceso de larga duración monopoliza la CPU.

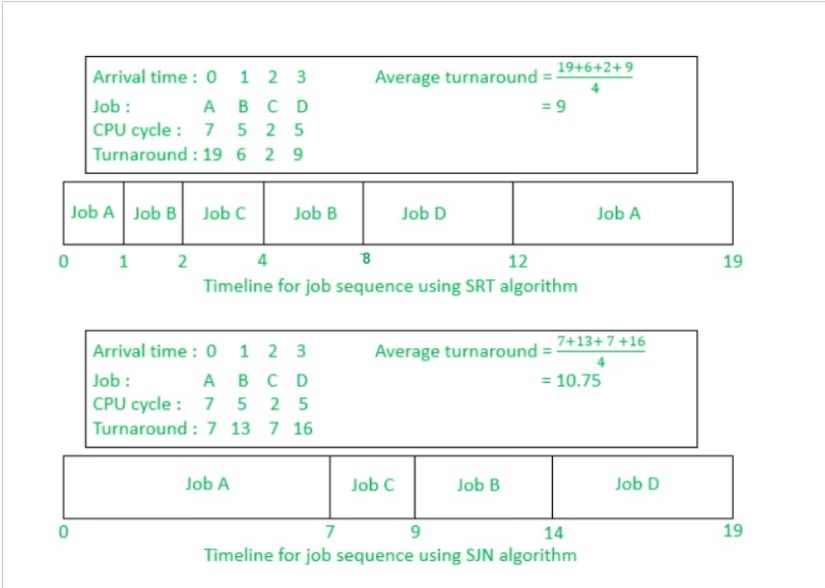

Shortest Job First (SJF)

El algoritmo Shortest Job First (SJF), o Trabajo Más Corto Primero, es un algoritmo que prioriza los trabajos que pueden procesarse en el menor tiempo posible. Es ampliamente reconocido como uno de los algoritmos más eficientes para reducir el tiempo de espera promedio y el tiempo de retorno de los procesos. La idea central es ejecutar primero aquellos procesos que requerirán menos tiempo de CPU, liberando así el procesador más rápidamente y permitiendo que otros procesos avancen.

Al igual que FCFS, la versión básica de SJF es no-apropiativa. Su principal limitación es la posibilidad de inanición (starvation), un escenario en el que si trabajos más cortos ingresan continuamente al sistema, los trabajos más largos pueden ser postergados indefinidamente, quizás nunca llegando a ejecutarse. Además, SJF requiere una estimación precisa de la duración de la ráfaga de CPU de cada trabajo, lo cual no siempre es posible o puede requerir recursos adicionales para obtener esta información.

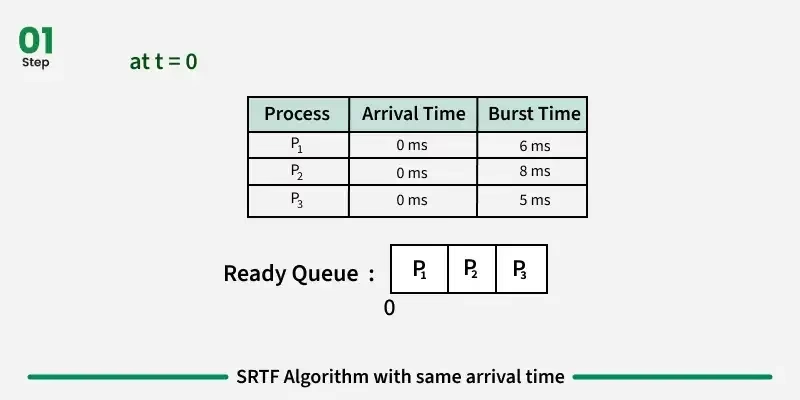

Shortest Remaining Time First (SRTF)

El algoritmo Shortest Remaining Time First (SRTF), o Tiempo Restante Más Corto Primero, es una versión apropiativa de SJF. Esta característica lo hace dinámico y muy receptivo a la llegada de nuevos procesos. En SRTF, cada vez que un nuevo trabajo ingresa a la cola de listos, o un proceso en ejecución termina una fase de E/S y vuelve a estar listo, el planificador compara el tiempo restante estimado del proceso actualmente en ejecución con el tiempo total de ráfaga del nuevo proceso o el tiempo restante de cualquier otro proceso en la cola de listos.

Si hay un trabajo nuevo o ya existente en la cola que tiene un tiempo de ráfaga restante más corto que lo que le falta al proceso actual en la CPU, el proceso actual es interrumpido (apropiado) y el nuevo proceso más corto es cargado en la CPU. Este comportamiento permite que los trabajos cortos se completen muy rápidamente, reduciendo drásticamente el tiempo de espera promedio y el tiempo de retorno, incluso mejor que SJF no-apropiativo. Sin embargo, SRTF comparte la desventaja de SJF de requerir una estimación precisa del tiempo de ráfaga y puede incurrir en un mayor número de cambios de contexto (context switches) debido a las interrupciones frecuentes, lo que añade una sobrecarga al sistema.

Round-Robin (RR)

El algoritmo Round-Robin (RR) es un algoritmo de planificación apropiativo diseñado para sistemas de tiempo compartido. En RR, a cada trabajo se le asigna una porción de tiempo definida, conocida como cuanto de tiempo (time slice o quantum). Los trabajos se ejecutan de forma cíclica, y una vez que un proceso usa su cuanto de tiempo o se bloquea (por ejemplo, para una operación de E/S), se le retira la CPU y se le asigna al siguiente proceso en la cola de listos. Si un proceso termina su cuanto de tiempo pero aún no ha finalizado, se mueve al final de la cola de listos.

RR asegura que ningún trabajo monopolice la CPU, proporcionando una distribución más equitativa del tiempo de procesamiento. Es excelente para sistemas interactivos donde la capacidad de respuesta es crítica. Sin embargo, la eficiencia de la CPU puede disminuir si el cuanto de tiempo es muy pequeño, ya que esto resultaría en una gran cantidad de cambios de contexto. Por otro lado, un cuanto de tiempo demasiado grande podría hacer que RR se comporte de manera similar a FCFS.

Planificación por Prioridad

El algoritmo de planificación por prioridad etiqueta los trabajos con diferentes niveles de prioridad (alta, baja, etc.). Los trabajos se ejecutan en una cola de prioridad, donde los procesos con mayor prioridad se ejecutan antes que los de menor prioridad. Si varios trabajos tienen la misma prioridad, generalmente se ejecutan en una cola FIFO.

Este algoritmo puede ser tanto apropiativo como no-apropiativo. Su principal ventaja es que permite que las tareas críticas o sensibles al tiempo se ejecuten rápidamente. Sin embargo, al igual que SJF, la planificación por prioridad sufre del problema de la inanición: los procesos de baja prioridad pueden no llegar a ejecutarse nunca si hay un flujo constante de procesos de alta prioridad. Una solución común a este problema es el envejecimiento (aging), donde la prioridad de los procesos en espera se incrementa gradualmente con el tiempo para asegurar que eventualmente todos los procesos tengan la oportunidad de ejecutarse.

Métricas Clave en la Planificación de Procesos

Para evaluar la eficacia de los algoritmos de planificación, se utilizan varias métricas. Las dos más importantes, mencionadas en la información proporcionada, son:

Tiempo de Retorno (Turnaround Time)

El Tiempo de Retorno (Turnaround Time) es el intervalo de tiempo total desde que un proceso es cargado en el sistema (es decir, llega a la cola de listos) hasta que este finaliza completamente su ejecución. Incluye el tiempo que el proceso pasa esperando en la cola de listos, el tiempo que se ejecuta en la CPU y cualquier tiempo de espera por operaciones de E/S. Un tiempo de retorno bajo es deseable, ya que indica que los procesos se completan rápidamente.

Tiempo de Espera (Waiting Time)

El Tiempo de Espera (Waiting Time) es la suma de todos los intervalos de tiempo que un proceso estuvo en la cola de procesos listos (ready queue), esperando su turno para ser ejecutado en la CPU. Este tiempo no incluye el tiempo de ejecución en la CPU ni el tiempo de E/S. Minimizar el tiempo de espera es crucial para mejorar la capacidad de respuesta del sistema y la experiencia del usuario, ya que un tiempo de espera alto implica que los procesos pasan mucho tiempo inactivos.

Otras métricas importantes incluyen:

- Throughput: El número de procesos completados por unidad de tiempo.

- Utilización de la CPU: El porcentaje de tiempo que la CPU está ocupada ejecutando procesos.

- Tiempo de Respuesta: El tiempo que transcurre desde que se envía una solicitud hasta que se produce la primera respuesta. Es especialmente importante en sistemas interactivos.

Comparativa Detallada: FCFS vs. SJF

Cuando comparamos dos de los algoritmos de planificación de trabajos más utilizados, FCFS y SJF, hay varios elementos a considerar, incluida la utilización de la CPU, el tiempo de espera promedio y el rendimiento de los trabajos. Aunque ambos son algoritmos no-apropiativos en sus versiones básicas, difieren fundamentalmente en cómo priorizan la ejecución de los trabajos.

| Característica | FCFS (First-Come First-Served) | SJF (Shortest Job First) |

|---|---|---|

| Criterio de Planificación | Tiempo de llegada al sistema. | Tiempo de ejecución estimado más corto. |

| Tipo de Planificación | No-apropiativa. | No-apropiativa (versión básica). SRTF es su versión apropiativa. |

| Ventajas | Simplicidad en la implementación. Ejecución justa basada en el tiempo de llegada. | Reduce el tiempo de espera promedio. Manejo eficiente de trabajos cortos, mejor utilización de CPU. |

| Limitaciones | Tiempos de espera promedio y tiempo de retorno más largos. Efecto de convoy si un trabajo largo llega primero. | Posibilidad de inanición para trabajos largos. Depende de una estimación precisa de la duración del trabajo. |

| Ideal para | Sistemas batch donde la simplicidad es prioritaria y los tiempos de ejecución de los procesos son similares. | Sistemas donde se prioriza la rapidez de finalización de trabajos cortos y se pueden estimar los tiempos de ejecución. |

Las limitaciones del algoritmo FCFS se manifiestan en tiempos de espera promedio más largos y un pobre tiempo de retorno. Si un trabajo largo llega primero en un estado listo, todos los trabajos subsiguientes deben esperar a su finalización. Esto puede causar tiempos de retorno significativos para trabajos que, de otro modo, podrían haberse ejecutado rápidamente. Por otro lado, una limitación asociada con SJF es la posibilidad de inanición. Si los trabajos más cortos ingresan continuamente al sistema, los trabajos más largos pueden terminar esperando indefinidamente. Además, el rendimiento óptimo del algoritmo SJF depende de una estimación precisa de la duración del trabajo, que no siempre está disponible o requiere recursos internos para obtenerla.

Algoritmos de Planificación en Sistemas Operativos Populares

La elección del mejor algoritmo de planificación de trabajos depende de una variedad de factores, incluidos los requisitos del trabajo, la arquitectura del sistema y los recursos de desarrollo. Algunos algoritmos funcionan mejor con ciertas tecnologías y sistemas operativos.

macOS

Uno de los algoritmos de planificación comúnmente empleados en los sistemas operativos Mac es el algoritmo de Cola Multinivel con Realimentación (MLFQ). La planificación de colas multinivel se utiliza a menudo para optimizar el tiempo de ejecución de las tareas en la CPU. El algoritmo MLFQ es un algoritmo de planificación de prioridad dinámica que clasifica los trabajos en múltiples colas de prioridad. Permite que los trabajos se muevan entre colas en función del tiempo de ejecución, el tiempo de procesamiento y la prioridad.

En un sistema operativo Mac, el algoritmo MLFQ puede manejar eficazmente una mezcla de tareas interactivas, tareas en segundo plano y tareas en tiempo real asignando prioridades apropiadas. Este algoritmo garantiza que las tareas interactivas, que requieren tiempos de respuesta rápidos, reciban una prioridad más alta, mientras que las tareas en segundo plano y los trabajos menos sensibles al tiempo se les asignan prioridades más bajas. Este enfoque ayuda a mantener la capacidad de respuesta del sistema, un tiempo de finalización rápido para las tareas y un tiempo de respuesta ágil para los nuevos trabajos.

Windows

En el sistema operativo Windows, el algoritmo de planificación de trabajos predeterminado utilizado es también el algoritmo MLFQ. Windows también admite un subconjunto de algoritmos de planificación a través de su API de Planificador de Windows (Windows Scheduler API), incluidos FCFS, SJF, RR y planificación por prioridad.

La API del Planificador de Windows permite a los desarrolladores y administradores de sistemas personalizar los algoritmos de planificación de trabajos en función de requisitos de trabajo específicos. Esto proporciona una gran flexibilidad para adaptar el comportamiento del sistema a diferentes cargas de trabajo, desde servidores de alto rendimiento hasta estaciones de trabajo interactivas.

Linux

Elegir el mejor algoritmo de planificación de trabajos para Linux depende de la distribución específica de Linux, la versión del kernel y los requisitos del sistema. Un algoritmo de planificación ampliamente utilizado y muy valorado para Linux es el Completely Fair Scheduler (CFS), o Planificador Completamente Justo.

El Completely Fair Scheduler es un planificador de procesos que distribuye equitativamente el tiempo de CPU entre los procesos activos. Utiliza una estructura de datos de árbol rojo-negro para mantener una cola de procesos ejecutables, lo que permite decisiones de planificación programáticas. El algoritmo CFS considera factores como la prioridad del proceso, el tiempo de ejecución virtual y el equilibrio de carga para garantizar una distribución justa y una utilización óptima de los recursos.

Existen otros algoritmos de planificación de trabajos y procesos y opciones compatibles con Linux. Estos incluyen el Planificador en Tiempo Real (SCHED_FIFO), que prioriza las tareas en tiempo real, y el Planificador de Plazos (SCHED_DEADLINE), que garantiza la ejecución oportuna de tareas con plazos estrictos. Esta variedad de opciones permite a los administradores de sistemas configurar el kernel de Linux para satisfacer las necesidades específicas de rendimiento y capacidad de respuesta.

Herramientas para la Gestión de la Planificación

En entornos empresariales y de desarrollo, la gestión de los algoritmos de planificación puede ser compleja. Herramientas especializadas como RunMyJobs de Redwood ofrecen una solución robusta para esta tarea. RunMyJobs es una herramienta potente para la gestión de algoritmos de planificación de trabajos, proporcionando a los desarrolladores la flexibilidad para personalizar y optimizar sus flujos de trabajo. Permite implementar fácilmente varios algoritmos de planificación basados en requisitos específicos.

Una de las ventajas de RunMyJobs es su soporte para la planificación por prioridad, una característica útil en sistemas en tiempo real donde ciertos trabajos requieren atención inmediata o tienen plazos estrictos. También ofrece colas MLFQ, lo que permite la ejecución de trabajos en múltiples niveles de prioridad. Los equipos pueden mover fácilmente trabajos entre colas en función del tiempo de procesamiento, la prioridad y el tiempo de ejecución. Esta característica proporciona un equilibrio entre trabajos cortos y largos, previniendo la inanición y optimizando el rendimiento del sistema.

Preguntas Frecuentes sobre Algoritmos de Planificación

Aquí respondemos algunas de las preguntas más comunes sobre los algoritmos de planificación de CPU.

- ¿Qué es la planificación apropiativa?

La planificación apropiativa permite que el sistema operativo interrumpa (quite la CPU a) un proceso que se está ejecutando actualmente si llega un proceso de mayor prioridad o si el proceso actual ha excedido su cuanto de tiempo. Esto permite una mayor capacidad de respuesta y equidad en sistemas multitarea. - ¿Qué es la inanición en el contexto de la planificación?

La inanición (starvation) ocurre cuando un proceso en la cola de listos nunca llega a ejecutarse porque los procesos de mayor prioridad o los procesos más cortos siempre lo preceden. Es un problema común en algoritmos como SJF o la planificación por prioridad pura. - ¿Cómo se soluciona la inanición?

Una técnica común para evitar la inanición es el envejecimiento (aging), donde la prioridad de un proceso aumenta gradualmente cuanto más tiempo ha estado esperando en la cola. Eventualmente, su prioridad será lo suficientemente alta como para que se le asigne la CPU. - ¿Cuál es la diferencia principal entre FCFS y RR?

La principal diferencia es que FCFS es no-apropiativo y se basa estrictamente en el orden de llegada, lo que puede llevar al efecto de convoy. RR es apropiativo y utiliza cuantas de tiempo para garantizar que todos los procesos tengan acceso regular a la CPU, mejorando la capacidad de respuesta, especialmente en sistemas interactivos. - ¿Es SJF siempre el mejor algoritmo para minimizar el tiempo de espera?

Teóricamente, sí, SJF (y su versión apropiativa SRTF) minimiza el tiempo de espera promedio y el tiempo de retorno. Sin embargo, su principal limitación práctica es la necesidad de conocer de antemano la duración exacta de la ráfaga de CPU de cada proceso, lo cual rara vez es posible en la realidad. Además, puede causar inanición.

Conclusión

Los algoritmos de planificación de CPU son el corazón de la eficiencia en cualquier sistema informático. Desde el simple FCFS hasta el sofisticado MLFQ, pasando por el SRTF que prioriza la finalización rápida de tareas, cada algoritmo juega un papel vital en cómo nuestros dispositivos gestionan y ejecutan las incontables operaciones diarias. Entender cómo funcionan estos mecanismos no solo nos permite apreciar la complejidad detrás de una interacción fluida con nuestras máquinas, sino que también subraya la importancia de elegir la estrategia de planificación adecuada para cada escenario.

La optimización del tiempo de retorno y el tiempo de espera son objetivos primordiales que impulsan el desarrollo y la aplicación de estos algoritmos. En un mundo donde la velocidad y la capacidad de respuesta son cada vez más demandadas, la continua evolución de estas técnicas de planificación seguirá siendo fundamental para el progreso de la computación.

Si quieres conocer otros artículos parecidos a Algoritmos de Planificación de CPU Esenciales puedes visitar la categoría Cálculos.