25/04/2023

¿Te interesa saber cómo diferentes variables interactúan e influyen unas en otras? El análisis de correlación es la clave para desentrañar estas relaciones en tus datos. En este artículo profundizaremos en el análisis de correlación, explorando su definición, métodos, aplicaciones y ejemplos prácticos. Tanto si eres un científico de datos, un investigador o un profesional de los negocios, comprender el análisis de correlación te permitirá tomar decisiones informadas, gestionar riesgos y extraer insights valiosos de tus datos. A continuación, exploraremos el análisis de correlación y descubriremos su importancia en diversos ámbitos.

- ¿Qué es el Análisis de Correlación?

- Tipos de Correlación

- ¿Cómo preparar los datos para el análisis de correlación?

- Coeficiente de Correlación de Pearson: Un Análisis Detallado

- Correlación de Rango de Spearman: Una Alternativa Robusta

- Correlación Tau de Kendall: Ideal para Muestras Pequeñas

- ¿Cómo interpretar los resultados de las correlaciones?

- Errores comunes en el análisis de correlación

- Aplicaciones del análisis de correlación

- Análisis de Correlación en Python

- Análisis de Correlación en R

- Ejemplos de análisis de correlación en escenarios reales

- Conclusiones sobre el análisis de correlación

- Preguntas Frecuentes sobre el Análisis de Correlación

¿Qué es el Análisis de Correlación?

El análisis de correlación es una técnica estadística utilizada para medir y evaluar la fuerza y la dirección de la relación entre dos o más variables. Ayuda a identificar si los cambios en una variable están asociados a cambios en otra y cuantifica el grado de esta asociación. Es una herramienta fundamental en el campo de la estadística y el análisis de datos, permitiendo a los investigadores y analistas comprender mejor los patrones subyacentes en sus conjuntos de datos.

Objetivo del Análisis de Correlación

El objetivo principal del análisis de correlación es doble: descubrir y cuantificar relaciones, pero también va más allá, ofreciendo capacidades predictivas y de diagnóstico:

- Descubrir relaciones: Ayuda a los investigadores y analistas a identificar patrones y relaciones entre las variables de sus datos. Responde a preguntas como: "¿Estas variables se mueven juntas o en direcciones opuestas?".

- Cuantificar relaciones: Cuantifica la fuerza y la dirección de las asociaciones entre variables, proporcionando una medida numérica que permite realizar comparaciones y evaluaciones objetivas. Esta medida numérica se conoce como coeficiente de correlación.

- Insights predictivos: Puede utilizarse con fines predictivos. Si dos variables muestran una fuerte correlación, los cambios en una variable pueden utilizarse para predecir cambios en la otra, lo que resulta valioso para la previsión y la toma de decisiones, aunque es crucial recordar que la correlación no implica causalidad.

- Reducción de datos: En análisis multivariantes, el análisis de correlación puede ayudar a identificar variables redundantes. Las variables muy correlacionadas pueden contener información similar, lo que permite a los analistas simplificar sus modelos y reducir la dimensionalidad de sus datos.

- Diagnóstico: En campos como la sanidad y las finanzas, el análisis de correlación se utiliza con fines de diagnóstico. Por ejemplo, puede revelar correlaciones entre síntomas y enfermedades o entre indicadores financieros y tendencias del mercado, ofreciendo una visión temprana de posibles problemas o oportunidades.

Importancia del Análisis de Correlación

La importancia del análisis de correlación radica en su capacidad para proporcionar información valiosa en diversas áreas, impulsando la toma de decisiones informadas y la gestión efectiva de riesgos:

- Toma de decisiones: Proporciona insights cruciales para tomar decisiones informadas. Por ejemplo, en finanzas, comprender la correlación entre activos ayuda en la diversificación de carteras, la gestión de riesgos y las decisiones de asignación de activos. En el ámbito empresarial, ayuda a evaluar la eficacia de las estrategias de marketing y a identificar los factores que influyen en las ventas.

- Evaluación de riesgos: Es esencial para la evaluación y gestión de riesgos. En el análisis de riesgos financieros, ayuda a identificar cómo se mueven los activos de una cartera en relación con los demás. Los activos muy correlacionados positivamente pueden aumentar el riesgo, mientras que los activos correlacionados negativamente pueden aportar beneficios de diversificación, mitigando el riesgo general.

- Investigación científica: Es una herramienta fundamental para comprender las relaciones entre variables. Por ejemplo, la investigación sanitaria puede descubrir correlaciones entre las características de los pacientes y los resultados sanitarios, lo que permite mejorar los tratamientos y las intervenciones.

- Control de calidad: En la manufactura y el control de calidad, el análisis de correlación puede utilizarse para identificar factores que afecten a la calidad del producto. Por ejemplo, ayuda a determinar si los cambios en los procesos de fabricación se correlacionan con variaciones en las especificaciones del producto, permitiendo ajustes para mantener la calidad.

- Modelado predictivo: Es un precursor de la creación de modelos predictivos. Las variables con fuertes correlaciones pueden utilizarse como predictores en modelos de regresión para pronosticar resultados, como la predicción de la pérdida de clientes basada en sus patrones de uso y datos demográficos.

- Identificación de factores de confusión: En epidemiología y ciencias sociales, el análisis de correlación se utiliza para identificar factores de confusión. Al estudiar la relación entre dos variables, una tercera variable puede confundir la asociación. El análisis de correlación ayuda a los investigadores a identificar y tener en cuenta estos factores de confusión, lo que garantiza conclusiones más precisas.

En resumen, el análisis de correlación es una herramienta estadística indispensable y versátil con diversas aplicaciones en distintos campos. Ayuda a revelar relaciones, evaluar riesgos, tomar decisiones informadas y avanzar en la comprensión científica, convirtiéndola en un valioso activo en el análisis de datos y la investigación.

Tipos de Correlación

El análisis de correlación consiste en examinar la relación entre variables. Existen varios métodos para medir la correlación, cada uno de ellos adecuado para distintos tipos de datos y situaciones. En esta sección, exploraremos tres tipos principales de coeficientes de correlación:

Coeficiente de Correlación de Pearson

El coeficiente de correlación de Pearson, a menudo denominado "r" de Pearson o Coeficiente de Correlación Producto-Momento de Pearson, es el método más utilizado para medir las relaciones lineales entre variables continuas. Cuantifica la fuerza y la dirección de una asociación lineal entre dos variables. Su valor oscila entre -1 y +1, donde -1 indica una correlación negativa perfecta, +1 una correlación positiva perfecta y 0 ausencia de correlación lineal.

Correlación de Rango de Spearman

La correlación de rango de Spearman, también conocida como "ρ" (rho) de Spearman, es un método no paramétrico utilizado para medir la fuerza y la dirección de la asociación monotónica entre dos variables. Resulta especialmente útil cuando se trata de relaciones no lineales o datos ordinales. A diferencia de Pearson, Spearman trabaja con los rangos de los datos en lugar de los valores brutos, lo que lo hace más robusto frente a valores atípicos y distribuciones no normales.

Correlación Tau de Kendall

La correlación Tau de Kendall, a menudo denominada "τ" (tau), es otro método no paramétrico para evaluar la asociación entre dos variables. Resulta ventajoso cuando se trabaja con muestras de pequeño tamaño o datos con empates (valores que aparecen más de una vez). Al igual que Spearman, mide la fuerza de una relación monotónica, pero lo hace contando pares concordantes y discordantes, ofreciendo una alternativa robusta.

¿Cómo preparar los datos para el análisis de correlación?

Antes de sumergirte en el análisis de correlación, debes asegurarte de que tus datos están bien preparados para obtener resultados significativos. Una preparación adecuada de los datos es crucial para obtener resultados precisos y fiables. Exploremos los pasos esenciales para ello:

1. Recogida de datos

- Identifica las variables relevantes: Determina qué variables quieres analizar para la correlación. Estas variables deben estar conectadas lógicamente o tener una asociación hipotética.

- Fuentes de datos: Recopila datos de fuentes fiables, asegurándote de que son representativos de la población o el fenómeno que estás estudiando.

- Calidad de los datos: Comprueba si hay problemas de calidad de los datos, como valores faltantes y/o atípicos, o errores durante el proceso de recopilación de datos.

2. Limpieza de datos

- Tratamiento de datos faltantes: Define una estrategia adecuada para tratar los valores faltantes. Puedes imputar los datos faltantes o excluir los casos con valores faltantes, dependiendo de la naturaleza de tu análisis y de la extensión de los datos faltantes.

- Datos duplicados: Detecta y elimina las entradas duplicadas para evitar sesgar tu análisis.

- Transformación de datos: Si es necesario, realiza transformaciones de datos como normalización o estandarización para asegurar que las variables estén en la misma escala, especialmente si vas a aplicar el coeficiente de Pearson.

3. Manejo de valores faltantes

- Tipos de datos faltantes: Comprende los tipos de datos faltantes, como los que faltan completamente al azar ("missing completely at random", MCAR), los que faltan al azar ("missing at random", MAR) o los que faltan no al azar ("missing not at random", MNAR)..

- Métodos de imputación: Elige los métodos de imputación adecuados, como la imputación de la media, de la mediana o de regresión, en función del patrón de datos perdidos y de la naturaleza de las variables.

4. Detección y tratamiento de valores atípicos

- Identificación de valores atípicos: Utiliza métodos estadísticos o visualizaciones (por ejemplo, gráficos de caja, gráficos de dispersión) para identificar valores atípicos en tus datos.

- Opciones de tratamiento: Decide si eliminar los valores atípicos, transformarlos o dejarlos en el conjunto de datos en función del contexto y los objetivos de tu análisis. Los valores atípicos pueden distorsionar significativamente los resultados de la correlación, especialmente con Pearson.

Una preparación eficaz de los datos sienta las bases para un análisis de correlación sólido. Siguiendo estos pasos, te asegurarás de que tus datos estén limpios, completos y listos para la obtención de insights significativos.

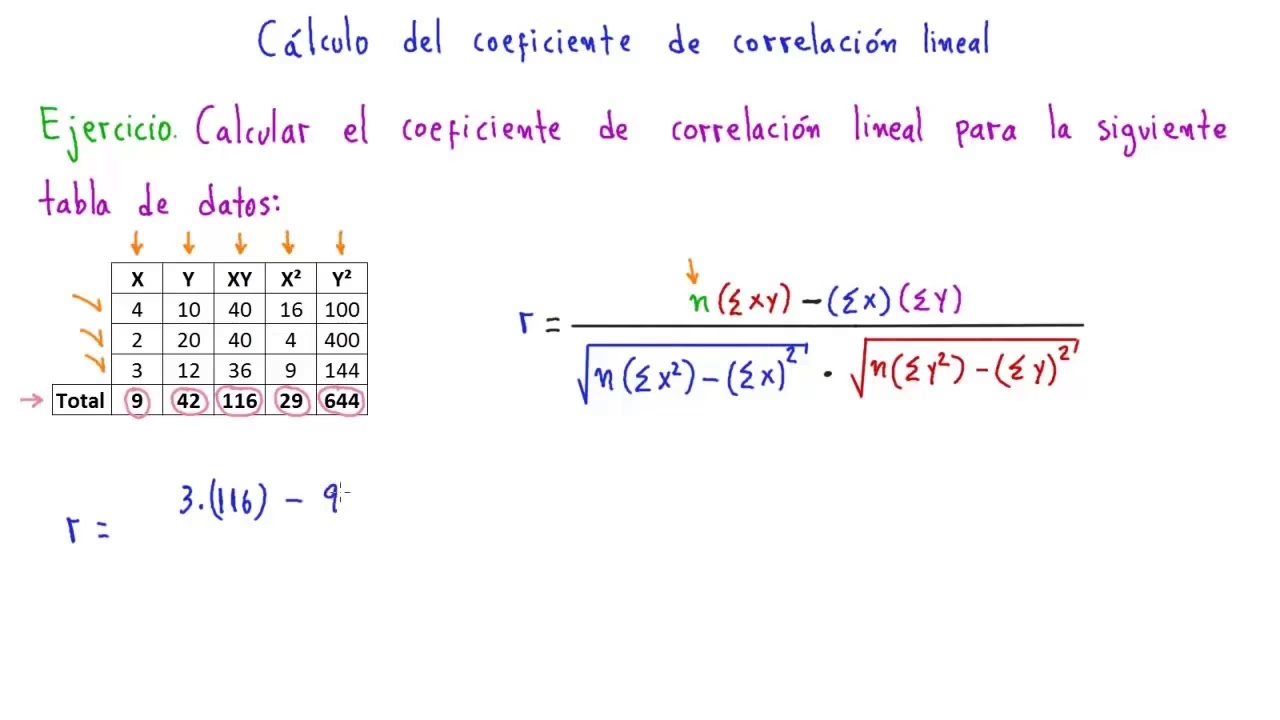

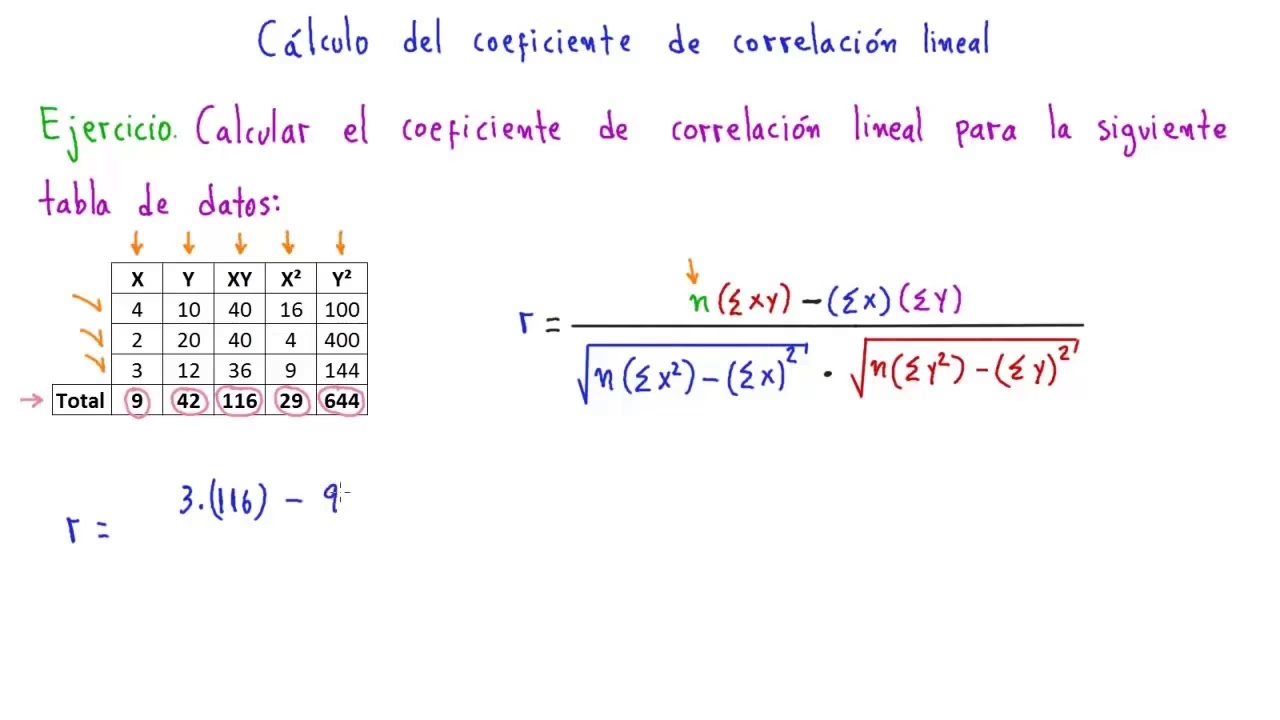

Coeficiente de Correlación de Pearson: Un Análisis Detallado

El coeficiente de correlación de Pearson, a menudo denominado "r" de Pearson, es una medida estadística ampliamente utilizada para cuantificar la fuerza y la dirección de una relación lineal entre dos variables continuas. Es esencial comprender cómo calcular, interpretar y reconocer la fuerza y la dirección de esta correlación.

Cálculo

La fórmula para calcular el coeficiente de correlación de Pearson es la siguiente:

r = (Σ((X - X̄)(Y - Ȳ))) / (√[Σ(X - X̄)² * Σ(Y - Ȳ)²])

Donde:

- X e Y son las variables analizadas.

- X̄ y Ȳ son las medias (promedios) de X e Y.

- Σ denota la suma de los productos de las desviaciones de los puntos de datos individuales de sus respectivas medias.

Para calcular "r", se toma la suma de los productos de las desviaciones de los puntos de datos individuales de sus respectivas medias para ambas variables. Este valor se normaliza dividiéndolo por el producto de las desviaciones estándar de ambas variables, lo que asegura que el coeficiente se mantenga entre -1 y +1, independientemente de la escala de las variables.

Interpretación

La interpretación del coeficiente de correlación de Pearson es crucial para comprender la naturaleza de la relación entre dos variables:

- Correlación positiva (r > 0): Cuando "r" es positiva, indica una relación lineal positiva. Esto significa que a medida que una variable aumenta, la otra tiende a aumentar también. Los puntos en un gráfico de dispersión se agruparían formando una línea ascendente de izquierda a derecha.

- Correlación negativa (r < 0): Un valor de "r" negativo sugiere una relación lineal negativa, lo que implica que a medida que una variable aumenta, la otra tiende a disminuir. En un gráfico de dispersión, los puntos se agruparían formando una línea descendente.

- Sin correlación (r ≈ 0): Si "r" se aproxima a 0, la relación lineal entre las variables es escasa o nula. En este caso, los cambios en una variable no están asociados con cambios consistentes en la otra, y los puntos en un gráfico de dispersión estarían dispersos aleatoriamente.

Fuerza y Dirección de la Correlación

La magnitud del coeficiente de correlación de Pearson "r" indica la fuerza de la correlación:

- Correlación fuerte: Cuando la |r| (valor absoluto de r) es cercana a 1 (ya sea positiva o negativa), sugiere una fuerte relación lineal. Un valor de 1 indica una relación lineal perfecta, mientras que -1 indica una relación lineal negativa perfecta.

- Correlación débil: Cuando la |r| está más cerca de 0, implica una relación lineal más débil. Cuanto más se acerque la "r" a 0, más débil será la correlación.

El signo de "r" (+ o -) indica la dirección de la correlación:

- Correlación positiva: Una "r" positiva sugiere que a medida que una variable aumenta, la otra tiende a aumentar. Las variables se mueven en la misma dirección.

- Correlación negativa: Una "r" negativa indica que cuando una variable aumenta, la otra tiende a disminuir. Las variables se mueven en direcciones opuestas.

Supuestos y Limitaciones

Es esencial conocer los supuestos y las limitaciones del coeficiente de correlación de Pearson:

- Linealidad: La correlación de Pearson supone que existe una relación lineal entre las variables. Si la relación no es lineal (por ejemplo, una relación curvilínea), la correlación de Pearson puede no captar con precisión la asociación o subestimar su fuerza real.

- Distribución normal: Supone que ambas variables se distribuyen normalmente. Si se incumple este supuesto, los resultados pueden ser menos fiables, especialmente en muestras pequeñas, aunque es bastante robusto para grandes muestras.

- Valores atípicos: Los valores atípicos pueden tener un impacto significativo en el coeficiente de correlación de Pearson. Los valores extremos pueden distorsionar los resultados de la correlación, arrastrando el valor de "r" hacia ellos.

- Independencia: Supone que los puntos de datos son independientes entre sí. Es decir, la observación de un punto de datos no debe influir en la observación de otro.

Comprender estos supuestos y limitaciones es vital a la hora de interpretar los resultados del análisis de correlación de Pearson. En los casos en que no se cumplan estos supuestos, pueden ser más apropiados otros métodos de correlación como el Spearman o Kendall Tau.

Correlación de Rango de Spearman: Una Alternativa Robusta

La correlación de rango de Spearman, también conocida como "ρ" (rho) de Spearman, es un método no paramétrico utilizado para medir la fuerza y la dirección de la asociación monotónica entre dos variables. Este método es valioso cuando se trata de relaciones no lineales o datos ordinales, o cuando los supuestos de Pearson no se cumplen.

Cálculo

Para calcular la correlación de rango de Spearman, debes seguir estos pasos:

- Clasificar los valores de cada variable por separado. Asignar el rango más bajo al valor más pequeño y el rango más alto al valor más grande. Si hay empates (valores idénticos), se asigna el rango promedio a esos valores.

- Calcular las diferencias (di) entre los rangos de cada par de puntos de datos de ambas variables.

- Elevar al cuadrado las diferencias y sumarlas para todos los puntos de datos (Σd²).

- Utilizar la fórmula de la rho de Spearman:

ρ = 1 - ((6 * Σd²) / (n(n² - 1)))

Donde:

- ρ es el coeficiente de correlación de rangos de Spearman.

- Σd² es la suma de las diferencias al cuadrado de los rangos.

- n es el número de puntos de datos.

¿Cuándo utilizar la correlación de Spearman?

La correlación de rangos de Spearman es especialmente útil en los siguientes casos:

- Cuando la relación entre variables no es estrictamente lineal, ya que no asume linealidad, sino monotonicidad (es decir, que las variables tienden a aumentar o disminuir juntas, aunque no a un ritmo constante).

- Cuando se trata de datos ordinales, en los que los valores tienen un orden natural pero no son equidistantes (por ejemplo, escalas de Likert, clasificaciones).

- Cuando tus datos violan los supuestos del coeficiente de correlación de Pearson, como la normalidad y la linealidad, o cuando hay valores atípicos que podrían distorsionar los resultados de Pearson.

Interpretación

La interpretación de la rho de Spearman es similar a la interpretación de la correlación de Pearson, pero se refiere a relaciones monotónicas en lugar de lineales:

- Una ρ positiva indica una relación monotónica positiva, lo que significa que a medida que una variable aumenta, la otra tiende a aumentar, o viceversa, manteniendo el mismo orden relativo.

- Una ρ negativa sugiere una relación monotónica negativa, es decir, que a medida que una variable aumenta, la otra tiende a disminuir, o viceversa, pero en orden inverso.

- Una ρ cercana a 0 implica poca o ninguna asociación monotónica entre las variables.

La correlación de rango de Spearman es robusta y versátil, lo que la convierte en una herramienta valiosa para analizar relaciones entre diversos tipos de datos y escenarios, especialmente cuando la distribución de los datos no es normal o la relación no es estrictamente lineal.

Correlación Tau de Kendall: Ideal para Muestras Pequeñas

La correlación Tau de Kendall, a menudo denotada como "τ" (tau), es una medida no paramétrica utilizada para evaluar la fuerza y la dirección de la asociación entre dos variables. La Tau de Kendall es especialmente valiosa cuando se trabaja con muestras de pequeño tamaño, relaciones no lineales o datos que violan los supuestos del coeficiente de correlación de Pearson, y es particularmente útil con datos que presentan muchos empates.

Cálculo

El cálculo de la correlación Tau de Kendall implica el recuento de pares de puntos de datos concordantes y discordantes. Así es como se hace:

- Para cada par de puntos de datos (Xi, Yi) y (Xj, Yj), determina si son concordantes o discordantes.

- Pares concordantes (C): Si Xi < Xj e Yi < Yj o Xi > Xj e Yi > Yj. Es decir, los rangos de ambas variables se mueven en la misma dirección.

- Pares discordantes (D): Si Xi < Xj e Yi > Yj o Xi > Xj e Yi < Yj. Es decir, los rangos de ambas variables se mueven en direcciones opuestas.

- Cuenta el número total de pares concordantes (C) y discordantes (D).

- Utiliza la fórmula de la Tau de Kendall:

τ = (C - D) / (0.5 * n * (n - 1))

Donde:

- τ es el coeficiente de correlación Tau de Kendall.

- C es el número de pares concordantes.

- D es el número de pares discordantes.

- n es el número de puntos de datos.

Ventajas de la Tau de Kendall

La correlación Tau de Kendall ofrece varias ventajas, lo que la convierte en una opción robusta en diversos escenarios:

- Robustez frente a valores atípicos: Es menos sensible a los valores atípicos en comparación con la correlación de Pearson, lo que la hace adecuada para datos con valores extremos sin que estos distorsionen excesivamente el resultado.

- Muestras pequeñas: Funciona bien con tamaños de muestra pequeños, por lo que es útil incluso cuando se tienen datos limitados.

- No paramétrica: Es no paramétrica, lo que significa que no asume distribuciones de datos específicas (como la normalidad), haciéndola versátil para varios tipos de datos.

- No asume linealidad: A diferencia de la correlación de Pearson, la Tau de Kendall no asume una relación lineal entre variables, lo que la hace adecuada para capturar asociaciones monotónicas no lineales.

- Manejo de empates: Tiene una forma natural de manejar los empates en los datos, lo que la hace preferible a Spearman en ciertas situaciones con muchos valores repetidos.

Interpretación

La interpretación de la correlación Tau de Kendall sigue un patrón similar al de la correlación de Pearson y Spearman:

- τ positiva (τ > 0): Indica una asociación positiva entre variables. A medida que una variable aumenta, la otra tiende a aumentar.

- τ negativa (τ < 0): Indica una asociación negativa. A medida que una variable aumenta, la otra tiende a disminuir.

- τ cercana a 0: Implica poca o ninguna asociación entre las variables.

La Tau de Kendall es una herramienta valiosa cuando se desea explorar asociaciones en los datos sin hacer fuertes suposiciones sobre la distribución o linealidad de los datos, siendo una elección sólida para análisis de rango y datos ordinales.

¿Cómo interpretar los resultados de las correlaciones?

Una vez calculados los coeficientes de correlación, el siguiente paso es interpretar los resultados. Es fundamental comprender cómo dar sentido a los valores de correlación y qué significan para tu análisis. La visualización juega un papel clave en esta interpretación.

Mapas de calor de correlación (Heatmaps)

Los mapas de calor de correlación son representaciones visuales de los coeficientes de correlación entre múltiples variables. Constituyen una forma rápida e intuitiva de identificar patrones y relaciones en los datos, especialmente útil cuando se trabaja con un gran número de variables.

- Correlación positiva (valores altos): Las variables con correlaciones positivas altas aparecen como grupos de colores brillantes (por ejemplo, rojo o amarillo) en el mapa de calor.

- Correlación negativa (valores bajos): Las variables con correlaciones negativas altas aparecen como grupos de colores oscuros (por ejemplo, azul o verde) en el mapa de calor.

- Sin correlación (valores cerca de 0): Las variables con una correlación baja o nula aparecen como un color neutro (por ejemplo, blanco o gris) en el mapa de calor.

Los mapas de calor son excelentes para ofrecer una visión general rápida de todas las interacciones entre pares de variables en un conjunto de datos.

Gráficos de dispersión

Los gráficos de dispersión son representaciones gráficas de puntos de datos en un plano cartesiano, con una variable en el eje X y otra en el eje Y. Son útiles para visualizar la relación entre dos variables continuas y para inspeccionar visualmente la forma de la relación (lineal, no lineal) y la presencia de valores atípicos.

- Correlación positiva: En una correlación positiva, los puntos de datos en el diagrama de dispersión tienden a formar un patrón ascendente, lo que sugiere que a medida que una variable aumenta, la otra tiende a aumentar.

- Correlación negativa: Una correlación negativa está representada por un patrón descendente, lo que indica que a medida que una variable aumenta, la otra tiende a disminuir.

- Sin correlación: Cuando no hay correlación, los puntos de datos se dispersan aleatoriamente sin formar ningún patrón definido.

Los gráficos de dispersión proporcionan una forma clara e intuitiva de evaluar la dirección y la fuerza de la correlación entre dos variables, y son cruciales para verificar el supuesto de linealidad para el coeficiente de Pearson.

Significancia estadística

Es fundamental determinar si la correlación observada es estadísticamente significativa. La significancia estadística sirve para evaluar si la correlación se debe al azar o si refleja una verdadera relación entre las variables en la población. Entre los métodos habituales para evaluar la significancia estadística se incluyen las pruebas de hipótesis (por ejemplo, las pruebas t) o el cálculo de los valores p. Un valor p bajo (normalmente inferior a 0,05) indica que la correlación probablemente no se deba al azar y es estadísticamente significativa.

Comprender la significancia estadística permite extraer conclusiones con seguridad a partir del análisis de correlaciones y tomar decisiones informadas basadas en los resultados. Un coeficiente de correlación puede ser fuerte, pero si no es estadísticamente significativo, podría ser simplemente una coincidencia en tu muestra.

Errores comunes en el análisis de correlación

Aunque el análisis de correlación es una herramienta poderosa para descubrir relaciones en los datos, es esencial ser consciente de los errores y escollos comunes que pueden llevar a conclusiones incorrectas. Estos son algunos de los problemas más frecuentes a los que hay que prestar atención:

Causalidad frente a correlación

Error: Suponer que la correlación implica causalidad es un error común y uno de los más peligrosos en el análisis de datos. La correlación sólo indica que dos variables están asociadas o varían juntas; no establece una relación causa-efecto. Es el error más citado en estadística, recordado por la frase "correlación no implica causalidad".

Ejemplo: Supongamos que se encuentra una fuerte correlación positiva entre las ventas de helados y el número de ahogamientos durante los meses de verano. Concluir que comer helado provoca ahogamientos sería un error. El factor común en este caso es el clima caluroso, que impulsa tanto el consumo de helados como la natación, dando lugar a una correlación aparente. El calor es la variable causal subyacente que influye en ambas.

Solución: Siempre hay que tener cuidado al interpretar la correlación. Para establecer la causalidad, se necesitan pruebas adicionales procedentes de experimentos controlados, estudios longitudinales o un conocimiento profundo de los mecanismos subyacentes. La correlación puede sugerir una posible relación causal, pero no la prueba.

Variables de confusión

Error: Ignorar o no tener en cuenta las variables de confusión puede llevar a resultados de correlación engañosos. Las variables de confusión son factores externos que afectan a las dos variables estudiadas, haciendo que parezca que existe una correlación cuando en realidad no la hay, o alterando la fuerza y dirección de una correlación existente.

Ejemplo: Supongamos que estás analizando la relación entre el número de aplicaciones de protección solar y la incidencia de quemaduras solares. Encuentras una correlación negativa, lo que sugiere que más protección solar provoca más quemaduras solares. Sin embargo, la variable de confusión es el tiempo pasado al sol, que afecta tanto a la aplicación de protección solar (la gente se aplica más si va a estar mucho tiempo expuesta) como al riesgo de quemaduras solares.

Solución: Mantente alerta ante posibles variables de confusión y contrólalas en tu análisis (por ejemplo, mediante técnicas de regresión múltiple) o ten en cuenta su influencia en la correlación observada. El diseño cuidadoso del estudio es clave.

Problemas con el tamaño de la muestra

Error: Extraer conclusiones sólidas a partir de tamaños de muestra pequeños puede ser engañoso. Las muestras pequeñas pueden dar lugar a estimaciones de correlación menos fiables y pueden no ser representativas de la población. Una correlación fuerte observada en una muestra pequeña podría ser producto del azar y no generalizable.

Ejemplo: Si sólo tienes diez puntos de datos y encuentras una correlación fuerte, es difícil generalizar esa correlación a una población más grande con confianza. Los resultados pueden ser muy sensibles a la adición o eliminación de unos pocos puntos de datos.

Solución: Siempre que sea posible, intenta obtener muestras de mayor tamaño para mejorar la solidez de tu análisis de correlación. Las pruebas estadísticas (como el valor p) pueden ayudar a determinar si la correlación observada es estadísticamente significativa, dado el tamaño de la muestra. Para planificar estudios, es recomendable usar calculadoras de tamaño de muestra para asegurar una potencia estadística adecuada.

Aplicaciones del análisis de correlación

El análisis de correlación tiene una amplia gama de aplicaciones en diversos campos. Comprender las relaciones entre variables puede aportar valiosos insights para la toma de decisiones y la investigación. Éstas son algunas aplicaciones destacadas en distintos ámbitos:

Negocios y finanzas

- Análisis de la bolsa: El análisis de correlaciones puede ayudar a los inversores y gestores de carteras a evaluar las relaciones entre distintos valores y activos. Comprender las correlaciones ayuda a la diversificación de carteras para gestionar el riesgo, ya que los activos con baja o negativa correlación pueden reducir la volatilidad general.

- Eficacia del marketing: Las empresas utilizan el análisis de correlación para determinar el impacto de las estrategias de marketing (por ejemplo, gasto en publicidad, promociones) en las ventas, el engagement de los clientes y otras métricas clave de rendimiento.

- Gestión de riesgos: En las instituciones financieras, el análisis de correlaciones es crucial para evaluar la interdependencia de los activos y estimar la exposición al riesgo de las carteras, especialmente en momentos de volatilidad del mercado.

Salud y medicina

- Eficacia de los fármacos: Los investigadores utilizan el análisis de correlación para evaluar la relación entre la dosis del fármaco y la respuesta del paciente. Ayuda a determinar la dosis de fármaco adecuada para afecciones específicas, así como a identificar posibles efectos secundarios correlacionados.

- Investigación de enfermedades: El análisis de correlación se utiliza para identificar posibles factores de riesgo y correlaciones entre diversos indicadores de salud (por ejemplo, dieta, ejercicio, antecedentes familiares) y la aparición de enfermedades.

- Ensayos clínicos: En los ensayos clínicos, el análisis de correlación se emplea para evaluar la correlación entre las intervenciones terapéuticas y los resultados de los pacientes, ayudando a determinar la eficacia de nuevos tratamientos.

- Educación: Los investigadores educativos utilizan el análisis de correlación para explorar las relaciones entre los métodos de enseñanza, el rendimiento de los estudiantes y diversos factores socioeconómicos (por ejemplo, ingresos familiares, nivel educativo de los padres).

- Sociología: El análisis de correlación se aplica para estudiar las correlaciones entre variables sociales, como los ingresos, la educación y los índices de delincuencia, para comprender mejor las dinámicas sociales.

- Psicología: Los psicólogos utilizan el análisis de correlación para investigar las relaciones entre variables como los niveles de estrés, el comportamiento y los resultados de salud mental, lo que permite el desarrollo de intervenciones más efectivas.

Estos son sólo algunos ejemplos de cómo se aplica el análisis de correlación en diversos campos. Su versatilidad lo convierte en una valiosa herramienta para descubrir asociaciones y orientar la toma de decisiones en muchos ámbitos de la investigación y la práctica.

Análisis de Correlación en Python

Python es un lenguaje de programación ampliamente utilizado para el análisis de datos y ofrece varias bibliotecas que facilitan el análisis de correlación. En esta sección, exploraremos cómo realizar análisis de correlación utilizando Python, incluyendo el uso de bibliotecas como NumPy y pandas, y proporcionaremos ejemplos de código.

Usando bibliotecas

NumPy

NumPy es una biblioteca fundamental para la computación numérica en Python. Proporciona herramientas esenciales para trabajar con matrices y realizar operaciones matemáticas, lo que la hace valiosa para el análisis de correlación, especialmente para cálculos eficientes.

Para calcular el coeficiente de correlación de Pearson utilizando NumPy, puedes utilizar la función numpy.corrcoef():

import numpy as np # Crear dos arrays (variables) variable1 = np.array([1, 2, 3, 4, 5]) variable2 = np.array([5, 4, 3, 2, 1]) # Calcular el coeficiente de correlación de Pearson correlation_coefficient = np.corrcoef(variable1, variable2)[0, 1] print(f"Coeficiente de Correlación de Pearson: {correlation_coefficient}")pandas

pandas es una potente biblioteca de manipulación de datos en Python. Proporciona una cómoda estructura DataFrame para manipular y analizar datos, lo que la convierte en una opción excelente para conjuntos de datos estructurados.

Para realizar análisis de correlación utilizando pandas, puedes utilizar el método pandas.DataFrame.corr():

import pandas as pd # Crear un DataFrame con dos columnas data = {'Variable1': [1, 2, 3, 4, 5], 'Variable2': [5, 4, 3, 2, 1]} df = pd.DataFrame(data) # Calcular el coeficiente de correlación de Pearson correlation_matrix = df.corr() pearson_coefficient = correlation_matrix.loc['Variable1', 'Variable2'] print(f"Coeficiente de Correlación de Pearson: {pearson_coefficient}")Ejemplos de código

Coeficiente de correlación de Pearson

import numpy as np variable1 = np.array([1, 2, 3, 4, 5]) variable2 = np.array([5, 4, 3, 2, 1]) correlation_coefficient = np.corrcoef(variable1, variable2)[0, 1] print(f"Coeficiente de Correlación de Pearson: {correlation_coefficient}") # Resultado esperado: -1.0 (correlación negativa perfecta)Correlación de rango de Spearman

import scipy.stats variable1 = [1, 2, 3, 4, 5] variable2 = [5, 4, 3, 2, 1] spearman_coefficient, _ = scipy.stats.spearmanr(variable1, variable2) print(f"Coeficiente de Correlación de Rango de Spearman: {spearman_coefficient}") # Resultado esperado: -1.0 (correlación monotónica negativa perfecta)Correlación Tau de Kendall

import scipy.stats variable1 = [1, 2, 3, 4, 5] variable2 = [5, 4, 3, 2, 1] kendall_coefficient, _ = scipy.stats.kendalltau(variable1, variable2) print(f"Coeficiente de Correlación Tau de Kendall: {kendall_coefficient}") # Resultado esperado: -1.0 (correlación monotónica negativa perfecta)Estos ejemplos de código demuestran cómo calcular coeficientes de correlación utilizando Python y sus bibliotecas. Puedes aplicar estas técnicas a tus propios conjuntos de datos y análisis, en función del tipo de correlación que quieras medir y las características de tus datos.

Análisis de Correlación en R

R es un potente lenguaje y entorno de programación estadística que destaca en el análisis y visualización de datos. En esta sección, exploraremos cómo realizar análisis de correlación en R, utilizando funciones base y paquetes comunes. Además, proporcionaremos ejemplos de código para demostrar el proceso.

Usando funciones base y paquetes

R tiene funciones de correlación incorporadas, pero también se beneficia de paquetes especializados para visualización y análisis más avanzados.

Funciones base de R

La función cor() en R es la forma más directa de calcular coeficientes de correlación. Permite especificar el método deseado (Pearson, Spearman, Kendall).

Paquetes como corrplot y psych

corrplotes un popular paquete de R para crear matrices de correlación y gráficos de correlación visualmente atractivos. Proporciona varias opciones para personalizar la apariencia de las matrices de correlación, por lo que es una excelente opción para visualizar las relaciones entre variables.- El paquete

psychen R proporciona una amplia gama de funciones para la psicometría, incluyendo el análisis de correlación. Ofrece funciones para calcular matrices de correlación, realizar análisis factoriales, y más.

Para utilizar estos paquetes, primero debes instalarlos (si no lo has hecho ya) y luego cargarlos en tu sesión de R:

# Instalar paquetes (solo una vez) # install.packages("corrplot") # install.packages("psych") # Cargar paquetes library(corrplot) library(psych)Ejemplos de código

Coeficiente de correlación de Pearson

# Crear dos vectores (variables) variable1 <- c(1, 2, 3, 4, 5) variable2 <- c(5, 4, 3, 2, 1) # Calcular el coeficiente de correlación de Pearson pearson_coefficient <- cor(variable1, variable2, method = "pearson") print(paste("Coeficiente de Correlación de Pearson:", round(pearson_coefficient, 2))) # Resultado esperado: -1.0Correlación de rango de Spearman

# Crear dos vectores (variables) variable1 <- c(1, 2, 3, 4, 5) variable2 <- c(5, 4, 3, 2, 1) # Calcular el coeficiente de correlación de rango de Spearman spearman_coefficient <- cor(variable1, variable2, method = "spearman") print(paste("Coeficiente de Correlación de Rango de Spearman:", round(spearman_coefficient, 2))) # Resultado esperado: -1.0Correlación Tau de Kendall

# Crear dos vectores (variables) variable1 <- c(1, 2, 3, 4, 5) variable2 <- c(5, 4, 3, 2, 1) # Calcular el coeficiente de correlación Tau de Kendall kendall_coefficient <- cor(variable1, variable2, method = "kendall") print(paste("Coeficiente de Correlación Tau de Kendall:", round(kendall_coefficient, 2))) # Resultado esperado: -1.0Estos ejemplos de código ilustran cómo calcular coeficientes de correlación utilizando R, centrándose específicamente en los métodos de correlación de Pearson, Spearman Rank y Kendall Tau. R proporciona una flexibilidad considerable para el análisis estadístico, haciendo que la correlación sea una tarea sencilla para analistas de todos los niveles.

Ejemplos de análisis de correlación en escenarios reales

Ahora que hemos cubierto los fundamentos del análisis de correlación y cómo calcularlo, vamos a explorar ejemplos prácticos que muestran cómo se puede aplicar el análisis de correlación a escenarios del mundo real. Estos ejemplos te ayudarán a comprender la relevancia y utilidad del análisis de correlación en diversos ámbitos.

Ejemplo 1: Finanzas e inversión

Escenario: Supongamos que eres un analista de inversiones que trabaja para un fondo de cobertura y quieres evaluar la relación entre dos acciones: La acción A y la acción B. Tu objetivo es determinar si existe una correlación entre los rendimientos diarios de estas acciones para tomar decisiones de diversificación de cartera.

Pasos del análisis:

- Recopilación de datos: Recopila datos históricos de los precios diarios de las acciones A y B durante un período significativo (por ejemplo, el último año).

- Preparación de los datos: Calcula los rendimientos diarios de cada acción (cambio porcentual en el precio de cierre de un día a otro). Esto es crucial porque la correlación se aplica mejor a los rendimientos que a los precios absolutos, ya que los precios pueden tener tendencias de largo plazo que distorsionen la correlación a corto plazo.

- Análisis de correlación: Utiliza el análisis de correlación (probablemente Pearson, dado que los rendimientos son continuos) para medir la correlación entre los rendimientos diarios de la acción A y la acción B. El coeficiente de correlación indicará la fuerza y la dirección de la relación.

- Interpretación:

- Si el coeficiente de correlación es cercano a 1, sugiere una fuerte correlación positiva, lo que significa que cuando la acción A sube, la acción B tiende a subir también. Ambas se mueven en la misma dirección.

- Si es cercano a -1, indica una fuerte correlación negativa, lo que implica que cuando una acción sube, la otra baja. Se mueven en direcciones opuestas.

- Un coeficiente de correlación cercano a 0 sugiere una relación lineal escasa o nula entre sus rendimientos.

- Gestión de la cartera: Con base en los resultados, puedes decidir si tiene sentido incluir ambas acciones en tu cartera. Si están muy correlacionados positivamente (por ejemplo, r > 0.7), añadir ambos puede no proporcionar una diversificación adecuada, ya que ambos caerán juntos en un mercado bajista. Por el contrario, si tienen una correlación negativa (por ejemplo, r < -0.5), pueden servir como una buena cobertura mutua, reduciendo el riesgo general de la cartera.

Ejemplo 2: Salud e investigación médica

Escenario: Eres un investigador que estudia la relación entre el Índice de Masa Corporal (IMC) de los pacientes y sus niveles de colesterol. Tu objetivo es determinar si existe una correlación entre el IMC y los niveles de colesterol entre una muestra de pacientes para identificar posibles factores de riesgo para la salud cardiovascular.

Pasos del análisis:

- Recopilación de datos: Recoge datos de una muestra representativa de pacientes, incluyendo su IMC (peso en kg / altura en m²) y sus niveles de colesterol total (en mg/dL).

- Preparación de los datos: Asegúrate de que los datos están limpios y de que no faltan valores. Ambos son datos continuos, por lo que Pearson es una opción viable, pero se debe verificar la normalidad y la presencia de valores atípicos.

- Análisis de correlación: Realiza un análisis de correlación para calcular el coeficiente de correlación de Pearson entre el IMC y los niveles de colesterol. Esto te ayudará a cuantificar la fuerza y la dirección de la relación.

- Interpretación:

- Si el coeficiente de correlación de Pearson es positivo y significativo (por ejemplo, r = 0.65, p < 0.01), sugiere que a medida que aumenta el IMC, los niveles de colesterol tienden a aumentar. Esto podría indicar que la obesidad está relacionada con un mayor riesgo de colesterol alto.

- Un coeficiente negativo indicaría lo contrario, lo cual sería inusual en este contexto.

- Una correlación cercana a 0 implica poca o ninguna relación lineal, lo que sugeriría que el IMC por sí solo no es un predictor lineal fuerte de los niveles de colesterol.

- Implicaciones clínicas: Utiliza los resultados del análisis de correlación para fundamentar las decisiones clínicas. Por ejemplo, si existe una fuerte correlación positiva, los profesionales sanitarios pueden considerar la posibilidad de controlar más estrechamente los niveles de colesterol en pacientes con un IMC más elevado y recomendar intervenciones para el manejo del peso como parte de la estrategia de salud cardiovascular.

Ejemplo 3: Educación y rendimiento de los estudiantes

Escenario: Como investigador educativo, estás interesado en comprender los factores que influyen en el rendimiento de los alumnos en un centro de secundaria. Quieres explorar la correlación entre variables como la asistencia de los alumnos (porcentaje de días asistidos), las horas dedicadas al estudio por semana y las calificaciones de los exámenes (en una escala de 0 a 100).

Pasos del análisis:

- Recopilación de datos: Recoge datos de una muestra de estudiantes de secundaria, incluidos sus registros de asistencia, las horas dedicadas al estudio por semana (autoinformadas o registradas) y las calificaciones finales de los exámenes de una asignatura común.

- Preparación de los datos: Garantiza la calidad de los datos, gestiona los valores faltantes y revisa la distribución de cada variable. Dado que todas son variables continuas, Pearson sería el coeficiente inicial a considerar.

- Análisis de correlación: Utiliza el análisis de correlación para calcular los coeficientes de correlación (por ejemplo, Pearson) entre la asistencia, las horas de estudio y las calificaciones de los exámenes. Esto ayudará a identificar qué factores, si los hay, están correlacionados con el rendimiento de los estudiantes.

- Interpretación:

- Analiza los coeficientes de correlación para determinar la fuerza y la dirección de las relaciones. Por ejemplo, una correlación positiva fuerte entre la asistencia y las calificaciones de los exámenes (r = 0.75) sugeriría que los estudiantes con mejor asistencia tienden a obtener mejores resultados académicos.

- Una correlación moderada entre las horas de estudio y las calificaciones (r = 0.45) indicaría que más tiempo de estudio se asocia con mejores calificaciones, pero otros factores también influyen.

- Si la correlación entre la asistencia y las horas de estudio es baja (r = 0.1), significaría que no hay una relación lineal fuerte entre cuánto asisten y cuánto estudian.

- Intervenciones educativas: A partir de los resultados, las instituciones académicas pueden poner en marcha intervenciones específicas. Por ejemplo, si existe una fuerte correlación positiva entre la asistencia y las calificaciones, los educadores podrían implementar programas para mejorar la asistencia. Si las horas de estudio muestran una correlación positiva, se podrían promover hábitos de estudio efectivos y proporcionar recursos para el estudio adicional.

Estos ejemplos prácticos ilustran cómo puede aplicarse el análisis de correlación a distintos ámbitos, como las finanzas, la salud y la educación. Al comprender las relaciones entre variables, las organizaciones y los investigadores pueden tomar decisiones informadas, optimizar estrategias y mejorar los resultados en sus respectivos ámbitos.

Conclusiones sobre el análisis de correlación

El análisis de correlación es una poderosa herramienta que nos permite comprender las conexiones entre distintas variables. Al cuantificar estas relaciones, obtenemos insights que nos ayudan a tomar mejores decisiones, gestionar los riesgos y mejorar los resultados en diversos campos como el de las finanzas, la sanidad y la educación. Es fundamental recordar que, si bien la correlación es un indicador de la asociación, no debe confundirse con la causalidad. Siempre se requiere un análisis más profundo y, a menudo, la experimentación para establecer relaciones de causa y efecto.

Así que, ya sea que estés analizando las tendencias del mercado de valores, investigando datos médicos o estudiando el rendimiento de tus estudiantes, el análisis de correlación te proporcionará los conocimientos necesarios para descubrir conexiones significativas y tomar decisiones fundamentadas en datos. Aprovecha el poder del análisis de correlación y descubrirás que es una herramienta esencial para navegar por el complejo panorama de la información y la toma de decisiones.

Preguntas Frecuentes sobre el Análisis de Correlación

¿Qué es un coeficiente de correlación?

Un coeficiente de correlación es un valor numérico que oscila entre -1 y 1. Indica la fuerza y la dirección de la relación lineal o monotónica entre dos o más variables. Un valor de 1 significa una correlación positiva perfecta, -1 una correlación negativa perfecta, y 0 indica que no hay relación lineal o monotónica.

¿Qué te dice un coeficiente de correlación?

Un coeficiente de correlación te dice dos cosas principales sobre la relación entre variables:

- Fuerza: La magnitud del valor (su valor absoluto) indica cuán fuerte es la relación. Cuanto más cerca esté de 1 o -1, más fuerte será la relación.

- Dirección: El signo (+ o -) indica la dirección de la relación. Un signo positivo significa que las variables se mueven en la misma dirección (cuando una aumenta, la otra también); un signo negativo significa que se mueven en direcciones opuestas (cuando una aumenta, la otra disminuye).

También ayuda a resumir datos y comparar resultados entre estudios, ya que es una medida sin unidades. Sin embargo, no permite inferir causalidad ni predecir cuánto cambiará una variable por un cambio específico en la otra (para eso se usa la regresión).

¿Cuáles son los 3 tipos principales de correlación?

Los tres tipos principales de coeficientes de correlación discutidos en este artículo, adecuados para diferentes tipos de datos y relaciones, son:

- Coeficiente de Correlación de Pearson (r): Mide la fuerza y dirección de una relación lineal entre dos variables continuas. Requiere que los datos sigan una distribución normal y no tengan valores atípicos significativos.

- Correlación de Rango de Spearman (ρ): Mide la fuerza y dirección de una relación monotónica (no necesariamente lineal) entre dos variables. Utiliza los rangos de los datos y es útil para datos ordinales o cuando los supuestos de Pearson no se cumplen.

- Correlación Tau de Kendall (τ): Otra medida no paramétrica de asociación monotónica, similar a Spearman pero a menudo preferida para muestras pequeñas o cuando hay muchos empates en los datos.

Cada uno tiene sus propias ventajas y suposiciones, por lo que la elección depende de la naturaleza de tus datos y la relación que esperas encontrar.

¿La correlación implica causalidad?

No, la correlación no implica causalidad. Que dos variables estén correlacionadas significa que se mueven juntas de alguna manera, pero no significa que una cause la otra. Puede haber una tercera variable (variable de confusión) que influya en ambas, o la relación puede ser puramente coincidente. Para establecer la causalidad, se requieren diseños de investigación más rigurosos, como experimentos controlados o estudios longitudinales.

¿Cómo se visualiza la correlación?

La correlación se puede visualizar principalmente de dos maneras:

- Gráficos de dispersión: Representan puntos de datos individuales en un plano cartesiano, mostrando visualmente la dirección y la fuerza de la relación entre dos variables. Permiten identificar relaciones lineales, no lineales y valores atípicos.

- Mapas de calor de correlación (Heatmaps): Son representaciones matriciales donde cada celda muestra el coeficiente de correlación entre dos variables. El color de la celda indica la fuerza y dirección de la correlación, siendo muy útiles para visualizar correlaciones entre múltiples variables a la vez.

A continuación, una tabla general para interpretar la fuerza de la correlación basada en el valor absoluto del coeficiente de correlación:

| Valor del Coeficiente de Correlación (r, ρ, τ) | Fuerza de la Correlación | Tipo de Correlación |

|---|---|---|

| 0 | Nula | Cero |

| 0 a ±0.3 | Débil | Positiva o Negativa |

| ±0.3 a ±0.5 | Moderada | Positiva o Negativa |

| ±0.5 a ±0.7 | Fuerte | Positiva o Negativa |

| ±0.7 a ±1 | Muy Fuerte | Positiva o Negativa |

Es importante recordar que estas son solo directrices generales. La interpretación de la fuerza de una correlación debe considerar siempre el contexto específico de la investigación y el campo de estudio. Por ejemplo, en ciencias sociales, una correlación de 0.3 podría considerarse significativa, mientras que en física, se esperarían valores mucho más cercanos a 1.

Si quieres conocer otros artículos parecidos a Análisis de Correlación: Desvelando Relaciones en Datos puedes visitar la categoría Estadística.