08/10/2022

En el vasto universo de la estadística y la probabilidad, la distribución Gamma emerge como una herramienta fundamental para modelar una amplia gama de fenómenos en diversas disciplinas, desde la ingeniería hasta las finanzas y la biología. Esta distribución continua, definida para valores positivos, es particularmente útil para describir tiempos de espera, cantidades acumuladas o incluso el tamaño de las reclamaciones de seguros. Sin embargo, para aprovechar su poder predictivo, es crucial comprender cómo se determinan sus parámetros intrínsecos: el parámetro de forma (alpha) y el parámetro de escala (beta). Estos valores son la clave que adapta la curva de la distribución a los datos observados, permitiendo una representación precisa de la realidad subyacente.

La estimación de estos parámetros puede parecer una tarea compleja a primera vista, pero a lo largo de este artículo, desglosaremos los métodos y las consideraciones prácticas que te permitirán dominar este proceso. Desde las propiedades teóricas que definen su forma hasta las fórmulas heurísticas y de máxima verosimilitud, exploraremos cómo transformar datos crudos en una comprensión profunda de los procesos modelados por la distribución Gamma. Prepárate para sumergirte en el fascinante mundo de la modelización estadística y descubrir cómo esta poderosa herramienta puede revelar patrones ocultos en tus datos.

- ¿Qué es la Distribución Gamma?

- ¿Cuándo utilizar la Distribución Gamma?

- Propiedades y Estadísticas Teóricas de la Distribución Gamma

- Funciones Clave de la Distribución Gamma

- Estimación de Parámetros de la Distribución Gamma

- Preguntas Frecuentes sobre la Distribución Gamma

- ¿Cuánto es la gamma de 1?

- ¿Qué diferencia hay entre el parámetro de escala beta y la tasa 1/beta?

- ¿Por qué es importante la estimación de parámetros?

- ¿Cuándo debo usar el método de los momentos frente a la máxima verosimilitud?

- ¿Qué significa que una distribución tenga "sesgo positivo"?

- ¿Cómo se relaciona la distribución Gamma con la exponencial y la normal?

- ¿Qué es la función digamma?

- Conclusión

¿Qué es la Distribución Gamma?

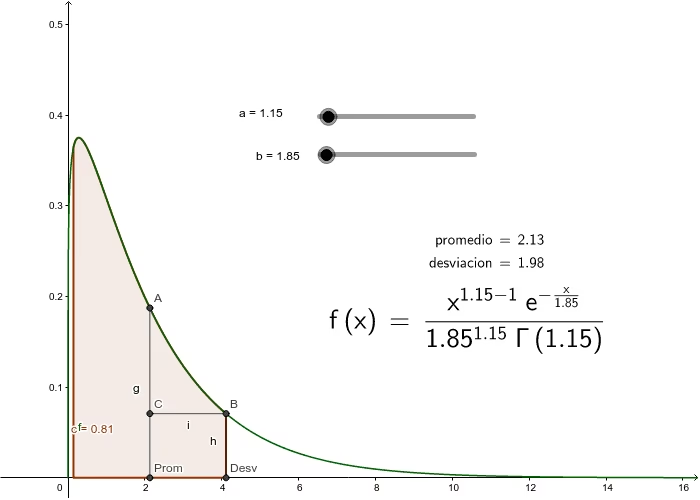

La distribución Gamma es una distribución de probabilidad continua, definida exclusivamente para valores positivos, lo que la hace ideal para modelar cantidades que no pueden ser negativas, como el tiempo, la longitud o el volumen. Es una distribución unimodal, lo que significa que tiene un único pico o moda, y se caracteriza por una asimetría positiva, es decir, su cola se extiende más hacia la derecha. Conceptualmente, la distribución Gamma es conocida por codificar el tiempo requerido para que ocurran un número específico de eventos (representado por el parámetro 'alpha') en un proceso de Poisson, donde los eventos ocurren a una tasa media constante (implícita en el parámetro 'beta').

Los dos parámetros fundamentales que definen la forma y la escala de la distribución Gamma son:

- Alpha (α): Parámetro de Forma. Este parámetro, también conocido como parámetro de forma, influye directamente en la forma de la distribución. Cuando

alpha = 1, la distribución Gamma se simplifica a la distribución exponencial, que modela el tiempo entre eventos en un proceso de Poisson. A medida quealphaaumenta, la distribución se vuelve más simétrica y se asemeja a una curva en forma de campana, aproximándose a una distribución normal cuandoalphatiende a infinito. - Beta (β): Parámetro de Escala. El parámetro de escala,

beta, estira o encoge la distribución a lo largo del eje x. Un valor mayor debetadispersa la distribución, mientras que un valor menor la concentra. Es importante notar que algunos textos o paquetes de software pueden utilizar un parámetro de tasa (lambda o rate) en lugar debeta, dondelambda = 1/beta. Es crucial verificar qué convención se está utilizando para evitar confusiones en los cálculos.

Comprender la interacción entre alpha y beta es esencial, ya que juntos determinan la ubicación, la dispersión y la forma de la distribución, permitiéndole adaptarse a una amplia variedad de conjuntos de datos y situaciones del mundo real.

¿Cuándo utilizar la Distribución Gamma?

La elección de una distribución de probabilidad adecuada es un paso crítico en cualquier análisis estadístico. La distribución Gamma es particularmente apropiada en escenarios donde se cumplen ciertas características de los datos:

- Límite Inferior Nítido en Cero, Sin Límite Superior: Es ideal para variables que son estrictamente positivas (no pueden ser cero o negativas) y que no tienen un valor máximo definido. Por ejemplo, el tiempo de vida de un componente electrónico, el tiempo de espera en una cola, o el tamaño de una precipitación.

- Asimetría Positiva y un Único Modo: Si tus datos muestran una cola más larga hacia la derecha (valores más altos) y tienen un solo pico, la distribución Gamma con

alpha > 1puede ser una excelente opción. - Modelado de Tiempos de Llegada o Eventos Acumulados: Es especialmente pertinente cuando se modelan tiempos de llegada para un conjunto de eventos. Por ejemplo, el tiempo total hasta que ocurran

alphafallas en un sistema, o el tiempo hasta que se completenalphatareas sucesivas. - Curva en Forma de Campana para Cantidades Positivas: Cuando el valor de

alphaes grande, la distribución Gamma puede aproximarse a una forma de campana, lo que la convierte en una alternativa viable a la distribución normal para cantidades que deben ser positivas. En estos casos, la distribución Log-Normal también es una opción, y la elección entre Gamma y Log-Normal a menudo depende del contexto específico y de qué distribución se ajusta mejor a los datos empíricos.

En resumen, si tus datos representan una cantidad positiva, tienen un sesgo hacia la derecha y un único valor más frecuente, la distribución Gamma es una candidata fuerte para modelar su comportamiento.

Propiedades y Estadísticas Teóricas de la Distribución Gamma

La distribución Gamma, al igual que cualquier otra distribución de probabilidad, posee un conjunto de propiedades matemáticas y estadísticas teóricas que describen su comportamiento. Estas propiedades son fundamentales para comprender cómo se espera que se distribuyan los datos que siguen un patrón Gamma. Aquí presentamos las más relevantes:

- Rango de Valores: Los valores de la variable aleatoria

xpara la distribución Gamma se encuentran en el intervalo0 < x < ∞. Esto refuerza su naturaleza de ser una distribución para cantidades positivas. - Rango de Parámetros: Los parámetros

alpha (α)ybeta (β)deben ser estrictamente positivos:α > 0, β > 0.

Las estadísticas teóricas, es decir, las propiedades esperadas de la distribución en ausencia de errores de muestreo, se definen en función de alpha y beta:

| Estadística | Fórmula Teórica | Descripción |

|---|---|---|

| Media (Mean) | α * β | El valor promedio esperado de la distribución. |

| Moda (Mode) | Max([0, (α - 1) * β]) | El valor más frecuente en la distribución. Existe solo si α > 1. Si α = 1, la moda está en 0, y si α < 1, la densidad es máxima en 0 pero no es un pico. |

| Varianza (Variance) | α * β^2 | Una medida de la dispersión de los datos alrededor de la media. |

| Desviación Estándar (SDeviation) | β * √α | La raíz cuadrada de la varianza, que proporciona una medida de dispersión en las mismas unidades que la media. |

| Asimetría (Skewness) | 2 / √α | Indica el grado y la dirección de la asimetría de la distribución. Un valor positivo significa que la cola derecha es más larga. A medida que α aumenta, la asimetría disminuye, acercándose a cero (simetría). |

| Curtosis (Kurtosis) | 6 / α | Mide el "pico" de la distribución y el peso de sus colas. Un valor más alto indica colas más pesadas y un pico más pronunciado. A medida que α aumenta, la curtosis disminuye, acercándose a la curtosis de una distribución normal (que es 3 para la curtosis estándar o 0 para la curtosis en exceso). |

Una propiedad notable es que cuando alpha = 1, la distribución Gamma se reduce a la distribución exponencial. Además, a medida que alpha tiende a infinito (α → ∞), la forma de la distribución Gamma se aproxima a la de una distribución normal, lo que resalta su flexibilidad para modelar diferentes formas de datos.

Funciones Clave de la Distribución Gamma

Para trabajar eficazmente con la distribución Gamma en cálculos y simulaciones, existen varias funciones matemáticas que son esenciales. Estas funciones permiten calcular probabilidades, densidades y cuantiles, y a menudo están disponibles en software estadístico y bibliotecas de programación.

- Función de Distribución (PDF):

Dens_Gamma(x, alpha, beta)

La Función de Densidad de Probabilidad (PDF) de la distribución Gamma describe la probabilidad relativa de que una variable aleatoria continua tome un valor dado. Para un valorx, la PDF se define como:

p(x) = (β-α xα-1 exp(-x/β)) / Γ(α)

DondeΓ(α)es la función Gamma, una extensión de la función factorial a números reales y complejos. Esta función es crucial para visualizar la forma de la distribución y entender dónde es más probable que se encuentren los valores. Para utilizarla en algunos entornos de modelado, puede ser necesario añadir una biblioteca de densidades de distribución. - Función de Distribución Acumulada (CDF):

CumGamma(x, alpha, beta)

La Función de Distribución Acumulada (CDF) proporciona la probabilidad de que una variable aleatoria Gamma sea menor o igual a un valorxdado. Es la integral de la PDF desde 0 hastax:

F(x) = (1 / Γ(α)) ∫0x β-α tα-1 exp(-t/β) dt

Esta función es idéntica a la función Gamma incompleta regularizada. Es fundamental para calcular probabilidades acumuladas, por ejemplo, la probabilidad de que un evento ocurra antes de un cierto tiempo. Al igual que la PDF, su uso puede requerir la adición de una biblioteca de densidades de distribución o el uso de funciones equivalentes comoGammaI. - Función Cuantil (Inverse CDF):

CumGammaInv(p, alpha, beta)

La Función Cuantil, también conocida como la inversa de la CDF o función de probabilidad acumulada inversa, devuelve el valorxpara el cual la probabilidad acumulada esp. En otras palabras, dado un porcentajep(entre 0 y 1), esta función encuentra el valorxpor debajo del cual cae elppor ciento de la distribución. Es esencial para calcular percentiles o puntos de corte en la distribución. Por ejemplo, si deseas encontrar el valor que el 95% de los datos no supera. Al igual que la CDF, puede ser equivalente a funciones comoGammaIInvy requerir bibliotecas específicas.

Es importante destacar que la función Gamma(alpha, beta, over) mencionada en algunos contextos se refiere a la función de distribución en sí, utilizada para describir una cantidad que sigue una distribución Gamma con los parámetros dados. El parámetro over, si está presente, puede referirse a un contexto o índice específico en entornos de modelado.

Estimación de Parámetros de la Distribución Gamma

La estimación de los parámetros alpha y beta a partir de datos muestreados es un paso crítico para aplicar la distribución Gamma a problemas del mundo real. Aunque existen métodos complejos, dos enfoques principales se destacan por su practicidad y precisión:

1. Estimación por el Método de los Momentos (MoM)

El método de los momentos es una técnica sencilla y muy utilizada para la estimación de parámetros. Se basa en igualar los momentos muestrales (como la media y la varianza de los datos observados) con los momentos teóricos de la distribución. Para la distribución Gamma, las fórmulas de estimación son sorprendentemente directas y, en la práctica, ofrecen un rendimiento excelente, a menudo justificando su uso sobre métodos más complejos.

Dada una muestra de datos históricos X (indexada por I), los parámetros alpha y beta se pueden estimar de la siguiente manera:

- Estimación de Alpha (α):

alpha := Media(X, I)^2 / Varianza(X, I)

DondeMedia(X, I)es la media muestral de los datos yVarianza(X, I)es la varianza muestral de los datos. Esta fórmula relaciona la forma de la distribución directamente con la relación entre la media y la varianza de tus datos. - Estimación de Beta (β):

beta := Varianza(X, I) / Media(X, I)

Esta fórmula debetanos indica cómo la escala de la distribución se relaciona con la dispersión de los datos en relación con su promedio.

Este método es valorado por su conveniencia computacional. Aunque no es la estimación de máxima verosimilitud (MLE), que es teóricamente más eficiente para muestras grandes, las estimaciones del método de los momentos son robustas y suficientemente precisas para muchas aplicaciones prácticas. La simplicidad de estas fórmulas hace que la estimación inicial de los parámetros Gamma sea accesible incluso sin software estadístico avanzado.

2. Estimación por Máxima Verosimilitud (MLE)

La estimación por máxima verosimilitud (MLE) es un método más sofisticado y, desde un punto de vista teórico, el más eficiente para obtener estimaciones de parámetros. Su objetivo es encontrar los valores de los parámetros que maximizan la función de verosimilitud, es decir, aquellos que hacen que los datos observados sean lo más probables posible bajo la distribución asumida.

Para la distribución Gamma, las ecuaciones para los estimadores de máxima verosimilitud de alpha (â) y beta (b̂) son un sistema de ecuaciones simultáneas que no tienen una solución analítica cerrada simple y generalmente requieren métodos numéricos iterativos para resolverse:

log(â) - Ψ(â) = log(x̄ / (∏i=1n xi)1/n)b̂ = x̄ / â

Donde:

x̄es la media muestral de los datos (x₁, x₂, ..., xₙ).∏i=1n xies el producto de todos los valores de la muestra.Ψes la función digamma (psi), que es la derivada logarítmica de la función Gamma (Ψ(z) = d/dz ln(Γ(z))).

Debido a la complejidad de la primera ecuación (que involucra la función digamma), las MLEs de la distribución Gamma suelen obtenerse utilizando software estadístico especializado. Herramientas como gamfit, fitdist o mle en entornos como MATLAB o R están diseñadas para resolver estas ecuaciones numéricamente. Mientras que gamfit y mle devuelven directamente las estimaciones de los parámetros, fitdist puede retornar un objeto de distribución ajustado, donde las estimaciones de los parámetros (por ejemplo, a y b) se almacenan como propiedades del objeto.

Aunque más complejos de implementar manualmente, los estimadores MLE son asintóticamente eficientes, lo que significa que para muestras grandes, tienden a ser los mejores estimadores posibles en términos de menor varianza.

3. Estimación de la Distribución Gamma con un Desplazamiento (Offset)

En algunos casos, los datos pueden no comenzar exactamente en cero, sino en un valor positivo diferente. Para estas situaciones, una distribución Gamma con un parámetro de "desplazamiento" (offset) puede ser más apropiada. La forma de esta distribución sería Gamma(alpha, beta) - offset, lo que significa que la distribución se desplaza a lo largo del eje x.

Para estimar los tres parámetros (alpha, beta y offset) cuando se asume un desplazamiento, se pueden utilizar las siguientes fórmulas heurísticas:

- Estimación de Alpha (α):

alpha := 4 / Asimetría(X, I)^2

Aquí, la forma de la distribución se estima directamente a partir de la asimetría de los datos muestrales. - Estimación del Desplazamiento (offset):

offset := Media(X, I) - DesviaciónEstándar(X, I) * RaízCuadrada(alpha)

Este desplazamiento se calcula a partir de la media y la desviación estándar de los datos, ajustado por la raíz cuadrada del alpha estimado. - Estimación de Beta (β):

beta := Varianza(X, I) / (Media(X, I) - offset)

Una vez que el offset ha sido estimado, beta se calcula de manera similar al método de los momentos, pero ajustando la media por el valor del desplazamiento.

Estas fórmulas heurísticas proporcionan una manera práctica de estimar los tres parámetros simultáneamente, aunque como con el método de los momentos, pueden no ser las estimaciones de máxima verosimilitud. Son particularmente útiles cuando se tiene una fuerte indicación de que los datos no empiezan en cero y se necesita un modelo más flexible.

Comparación de Métodos de Estimación

| Método | Ventajas | Desventajas | Complejidad | Uso Típico |

|---|---|---|---|---|

| Método de los Momentos (MoM) | Simple, fácil de calcular, no requiere software especializado, buenas estimaciones en la práctica. | No es asintóticamente tan eficiente como MLE. | Baja | Estimaciones rápidas y preliminares, cuando la eficiencia máxima no es crítica. |

| Máxima Verosimilitud (MLE) | Asintóticamente eficiente, proporciona estimaciones con la varianza más baja para muestras grandes. | Requiere solución numérica, más complejo computacionalmente, necesita software especializado. | Alta | Estimaciones precisas para investigación, publicaciones, cuando la eficiencia es primordial. |

| Heurística con Offset | Permite modelar datos con un límite inferior > 0, útil en escenarios específicos. | Basado en heurísticas, no garantiza la eficiencia óptima, puede ser menos robusto en algunos casos. | Media | Datos con un inicio claro diferente de cero, exploración de modelos con desplazamiento. |

Preguntas Frecuentes sobre la Distribución Gamma

¿Cuánto es la gamma de 1?

La función Gamma, denotada como Γ(z), es una extensión de la función factorial a números complejos y reales. Su valor para z = 1 es una propiedad fundamental: Γ(1) = 1. Esto es consistente con la definición de la función factorial, ya que 0! = 1, y la función Gamma satisface la relación Γ(z+1) = zΓ(z), lo que implica que Γ(n+1) = n! para enteros positivos n. Por lo tanto, Γ(1) = 0! = 1.

¿Qué diferencia hay entre el parámetro de escala beta y la tasa 1/beta?

La distribución Gamma se define con un parámetro de escala, beta (β). Sin embargo, algunos libros de texto y paquetes de software utilizan un parámetro de tasa, lambda (λ), en lugar de beta. La relación es simple: λ = 1/β. Es decir, el parámetro de tasa es el recíproco del parámetro de escala. Mientras que beta indica la 'cantidad' de tiempo o recurso por evento, lambda indica la 'frecuencia' o 'tasa' de eventos por unidad de tiempo o recurso. Es crucial estar atento a la convención utilizada en el contexto específico (documentación, software) para evitar errores en la interpretación y el cálculo de los parámetros.

¿Por qué es importante la estimación de parámetros?

La estimación de parámetros es de vital importancia porque permite adaptar un modelo de distribución teórico (como la Gamma) a un conjunto de datos reales y observados. Sin la estimación, la distribución sería solo una forma matemática sin conexión con la realidad. Al estimar alpha y beta, podemos:

- Entender el proceso subyacente: Los valores de los parámetros a menudo tienen una interpretación física o conceptual que ayuda a comprender el fenómeno que se está modelando.

- Hacer predicciones: Una vez que la distribución se ajusta a los datos, se pueden usar para predecir el comportamiento futuro, calcular probabilidades de eventos específicos o simular escenarios.

- Comparar diferentes conjuntos de datos: Permite comparar las características de diferentes poblaciones o condiciones al examinar las diferencias en sus parámetros estimados.

- Tomar decisiones informadas: En campos como la ingeniería, la medicina o las finanzas, los modelos de distribución se utilizan para evaluar riesgos, optimizar procesos o diseñar sistemas, y la precisión de estas decisiones depende directamente de la correcta estimación de los parámetros.

¿Cuándo debo usar el método de los momentos frente a la máxima verosimilitud?

La elección entre el Método de los Momentos (MoM) y la Máxima Verosimilitud (MLE) depende de varios factores:

- Simplicidad y Rapidez: Si necesitas una estimación rápida y sencilla sin la necesidad de un software complejo, el MoM es tu mejor opción. Sus fórmulas son directas y fáciles de aplicar.

- Precisión y Eficiencia Asintótica: Si la precisión es primordial y estás trabajando con muestras de datos grandes, MLE es preferible. Los estimadores MLE son asintóticamente eficientes, lo que significa que, a medida que el tamaño de la muestra crece, sus estimaciones se acercan más a los verdaderos valores de los parámetros y tienen la menor varianza posible.

- Disponibilidad de Herramientas: Si tienes acceso a software estadístico que implementa algoritmos para MLE (como

gamfitofitdist), entonces MLE es una opción viable y a menudo la preferida por su solidez teórica. - Naturaleza de los Datos: Para distribuciones más complejas o cuando las propiedades teóricas son de suma importancia, MLE suele ser el camino a seguir. Para distribuciones simples o cuando una buena aproximación es suficiente, MoM es adecuado.

En la práctica, a menudo se utilizan las estimaciones del MoM como valores iniciales para los algoritmos numéricos de MLE, lo que puede acelerar la convergencia.

¿Qué significa que una distribución tenga "sesgo positivo"?

Una distribución tiene "sesgo positivo" (o asimetría positiva, o sesgada a la derecha) cuando su cola se extiende más hacia la derecha del pico de la distribución. Esto significa que la mayoría de los valores se concentran en el lado izquierdo de la distribución, y hay un número menor de valores muy altos que "tiran" la media hacia la derecha, haciéndola mayor que la moda y la mediana. En la distribución Gamma, un sesgo positivo es una característica inherente, especialmente para valores de alpha más pequeños. A medida que alpha aumenta, la distribución se vuelve más simétrica y el sesgo positivo disminuye.

¿Cómo se relaciona la distribución Gamma con la exponencial y la normal?

La distribución Gamma tiene relaciones importantes con otras distribuciones de probabilidad:

- Relación con la Exponencial: Cuando el parámetro de forma

alpha (α) = 1, la distribución Gamma se reduce exactamente a la distribución exponencial. La distribución exponencial modela el tiempo entre eventos en un proceso de Poisson (es decir, el tiempo hasta el primer evento), mientras que la Gamma modela el tiempo hasta que ocurrenalphaeventos. - Relación con la Normal: A medida que el parámetro de forma

alpha (α)tiende a infinito (α → ∞), la forma de la distribución Gamma se aproxima a la de una distribución normal. Esto se debe al Teorema del Límite Central, ya que la distribución Gamma puede verse como la suma de variables aleatorias exponenciales independientes e idénticamente distribuidas, y la suma de un gran número de variables aleatorias tiende a distribuirse normalmente. Esta propiedad hace que la Gamma sea útil para modelar cantidades positivas que, de otro modo, podrían ser aproximadas por una normal.

Estas relaciones destacan la versatilidad de la distribución Gamma y su papel como una distribución general que abarca casos específicos importantes.

¿Qué es la función digamma?

La función digamma, denotada por Ψ(z) (psi), es la derivada logarítmica de la función Gamma. En términos matemáticos, se define como:

Ψ(z) = d/dz ln(Γ(z))

Es una función especial que aparece frecuentemente en el contexto de la estimación de parámetros de la distribución Gamma por máxima verosimilitud, así como en otras áreas de la estadística y la física matemática. No tiene una forma cerrada simple en términos de funciones elementales y, por lo tanto, sus valores se calculan numéricamente. Su presencia en las ecuaciones MLE de la Gamma es la razón principal por la que estas ecuaciones requieren métodos numéricos para su solución.

Conclusión

La distribución Gamma es una herramienta estadística de inmenso valor, capaz de modelar una diversidad de fenómenos que se manifiestan con valores positivos y asimetría. Comprender sus parámetros, alpha y beta, y dominar los métodos para su estimación es fundamental para cualquier analista o científico de datos. Ya sea que optes por la simplicidad y practicidad del método de los momentos, la eficiencia teórica de la máxima verosimilitud, o el enfoque heurístico para datos con desplazamiento, la capacidad de ajustar la distribución Gamma a tus datos te permitirá obtener insights profundos, realizar predicciones más precisas y tomar decisiones mejor informadas. Al aplicar estos conocimientos, estarás un paso más cerca de desvelar los patrones ocultos y la verdadera naturaleza de los procesos que te interesan, transformando tus datos en conocimiento accionable.

Si quieres conocer otros artículos parecidos a Cálculo de Parámetros de la Distribución Gamma puedes visitar la categoría Estadística.