28/06/2023

En el vasto universo de los cálculos, desde las complejas simulaciones científicas hasta las operaciones más cotidianas en tu smartphone, los números de punto flotante son los héroes silenciosos que hacen posible representar una asombrosa gama de valores. A diferencia de los números enteros, que solo manejan cantidades exactas sin decimales, el punto flotante permite a las computadoras trabajar con cifras increíblemente grandes, minúsculas o con fracciones, aunque no siempre con la exactitud que la matemática pura promete. Comprender cómo se calculan y representan estos números es fundamental para cualquier persona que interactúe con la tecnología, ya que revela las bases de la precisión (y las limitaciones) de la aritmética digital.

- La Imperiosa Necesidad del Punto Flotante en la Computación

- Anatomía de un Número de Punto Flotante: Signo, Exponente y Mantisa

- El Estándar IEEE 754: La Columna Vertebral de la Precisión Digital

- Operaciones Aritméticas con Punto Flotante: Una Danza de Aproximaciones

- Redondeo y Conversión: El Arte de la Aproximación Controlada

- Manejo de Excepciones: Cuando las Cosas no Salen como Esperamos

- Desafíos de Precisión y Errores Comunes

La Imperiosa Necesidad del Punto Flotante en la Computación

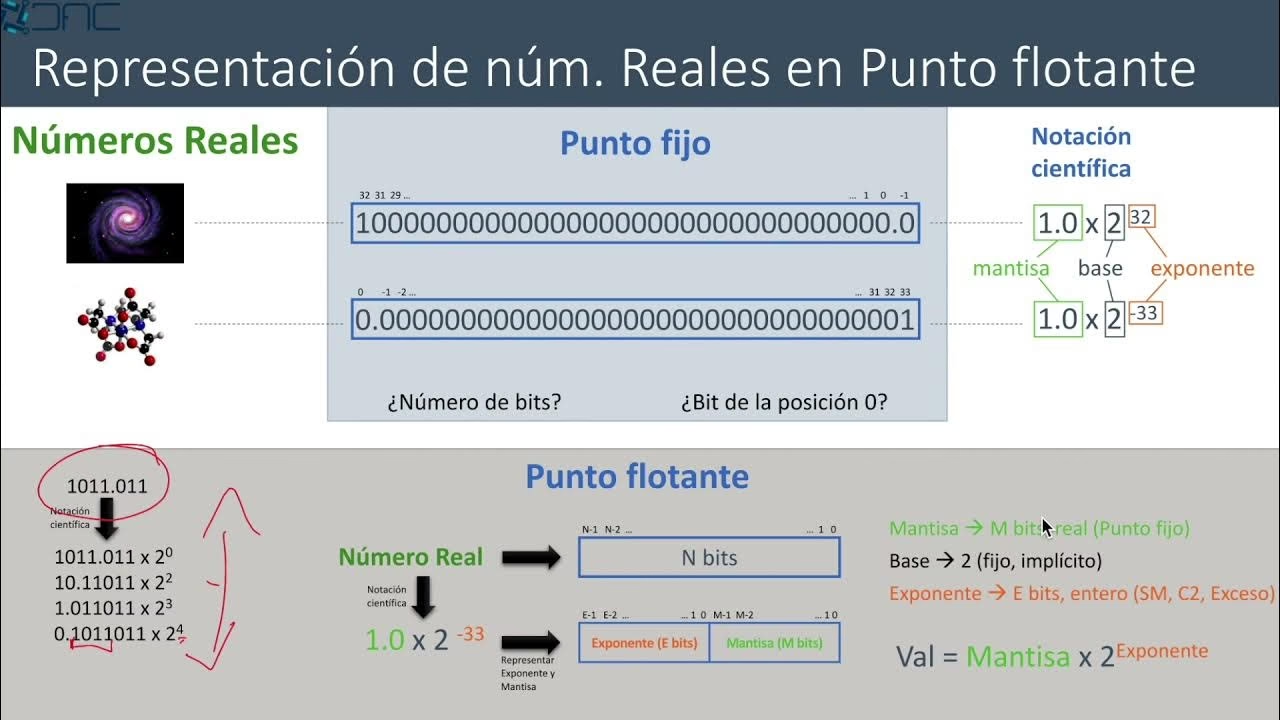

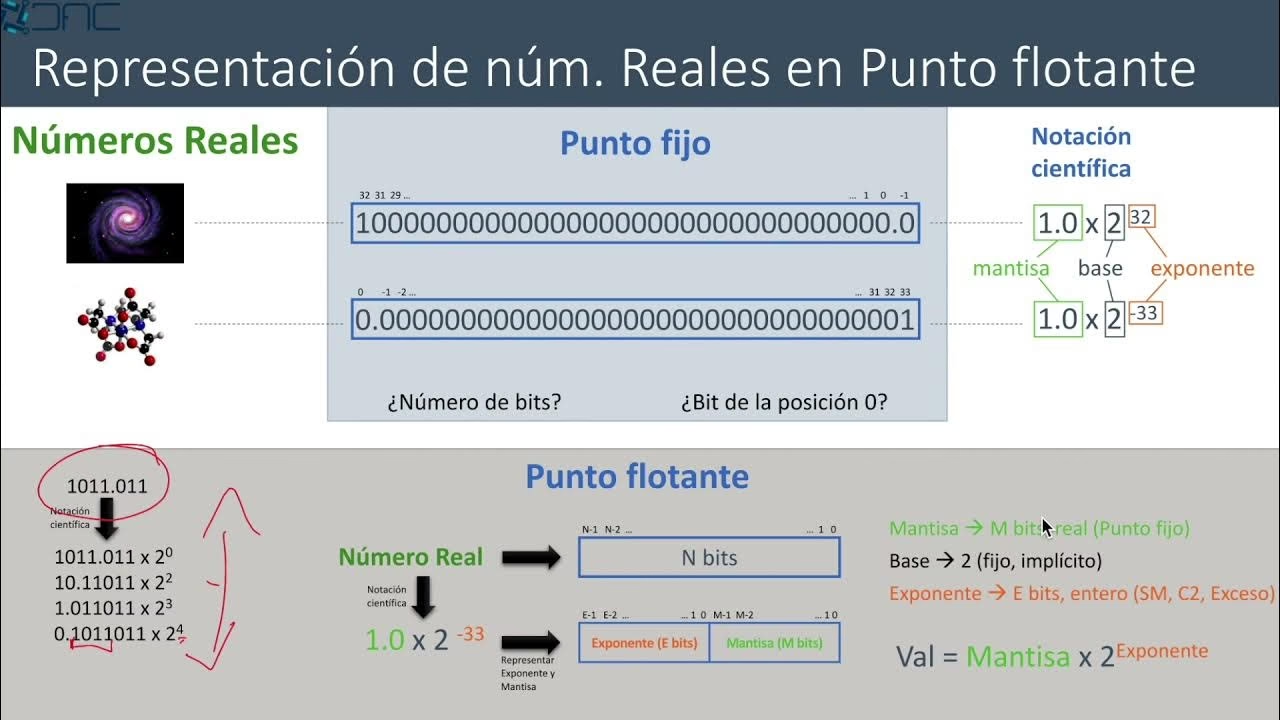

Imagina intentar representar la distancia a una galaxia lejana, como 9.5 billones de kilómetros, o el tamaño de un átomo, que es una fracción diminuta de nanómetros, utilizando solo números enteros. Sería imposible o requeriría una cantidad de bits irrisoria. Los sistemas de numeración de punto fijo, que asignan un número fijo de dígitos antes y después del punto decimal, tampoco son suficientes, ya que su rango es muy limitado. Aquí es donde entra el punto flotante, una solución ingeniosa que emula la notación científica para permitir que las computadoras manejen un rango dinámico de valores extraordinariamente amplio.

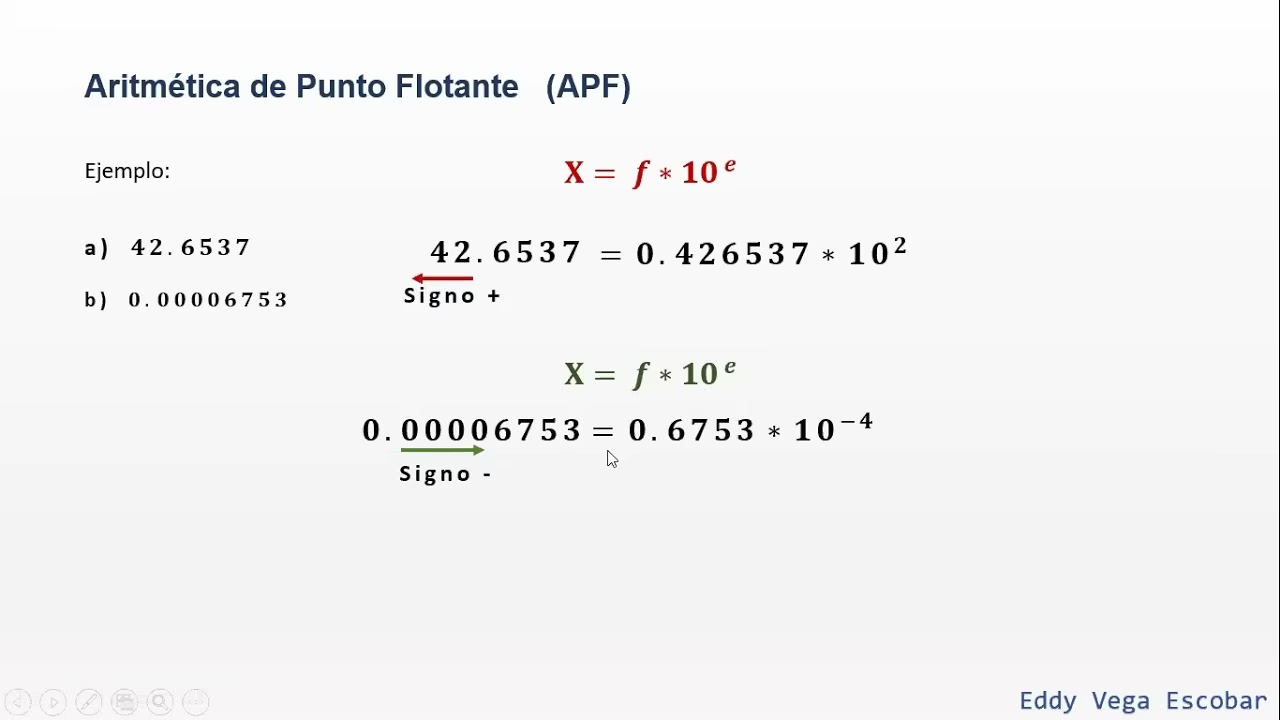

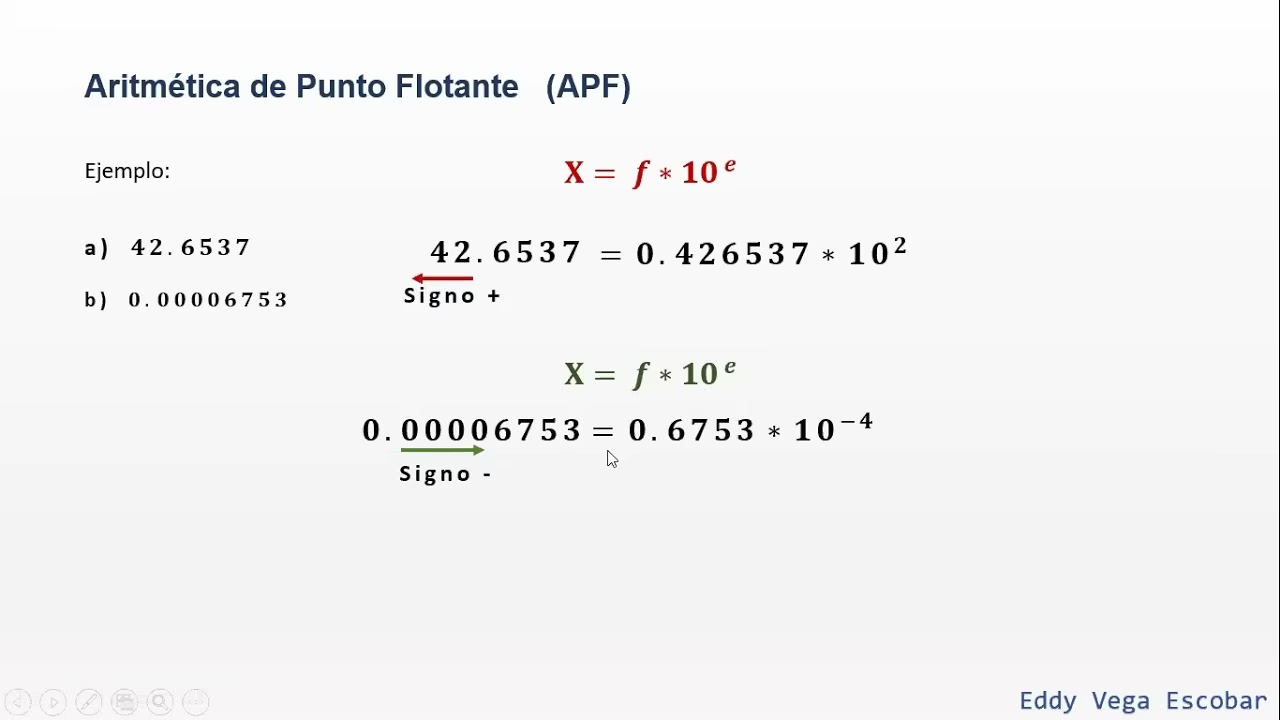

Similar a cómo escribimos 1.23 x 105, los números de punto flotante almacenan un número base (la mantisa o significando) y un exponente que indica dónde se "flota" el punto decimal. Esta flexibilidad es crucial para aplicaciones que van desde la física y la ingeniería hasta los gráficos 3D y el aprendizaje automático, donde la capacidad de representar tanto valores muy grandes como muy pequeños es indispensable.

Anatomía de un Número de Punto Flotante: Signo, Exponente y Mantisa

Cada número de punto flotante se descompone en tres componentes esenciales, que juntos definen su valor y precisión:

- Signo (S): Un único bit que determina si el número es positivo (0) o negativo (1). Es el componente más sencillo, pero fundamental para definir la polaridad del valor.

- Exponente (E): Un conjunto de bits que indica la magnitud del número. Funciona de manera similar a la potencia de 10 en la notación científica (por ejemplo, el "5" en 1.23 x 105). Para poder representar tanto exponentes positivos como negativos sin necesidad de un bit de signo adicional para el exponente, se utiliza un "sesgo" o "bias" que se suma al exponente real.

- Mantisa (M) o Significando: Un conjunto de bits que representa los dígitos significativos del número. Es la parte fraccionaria de la representación. En el estándar IEEE 754, la mantisa se almacena de forma "normalizada", lo que significa que siempre se asume un "1" implícito antes del punto binario. Esto permite ganar un bit adicional de precisión sin almacenarlo explícitamente.

La combinación de estos tres elementos permite construir un valor numérico final utilizando una fórmula general que explicaremos en detalle al abordar el estándar IEEE 754.

El Estándar IEEE 754: La Columna Vertebral de la Precisión Digital

Antes del advenimiento del estándar IEEE 754 en 1985, la forma en que las diferentes computadoras manejaban los números de punto flotante era inconsistente. Esto llevaba a resultados variados para los mismos cálculos en diferentes máquinas, un verdadero dolor de cabeza para la portabilidad y fiabilidad del software. El IEEE 754 revolucionó esto al establecer un conjunto uniforme de reglas para la representación y la aritmética de punto flotante, convirtiéndose en el estándar de facto para casi todos los sistemas informáticos modernos.

Formatos Principales: Precisión Simple (FP32) y Precisión Doble (FP64)

El estándar define varios formatos, pero los dos más comunes y ampliamente utilizados son la precisión simple y la precisión doble:

- Precisión Simple (FP32): Este formato utiliza 32 bits de memoria para representar un número. Se distribuyen de la siguiente manera:

- 1 bit para el Signo.

- 8 bits para el Exponente (con un sesgo de 127).

- 23 bits para la Mantisa (significando). Gracias al bit implícito, esto proporciona efectivamente 24 bits de precisión.

La fórmula para calcular el valor real a partir de estos bits es:

(-1)Signo × 2(Exponente_Almacenado - 127) × (1 + Fracción_Mantisa)Este formato es ideal para aplicaciones donde la velocidad y el uso eficiente de la memoria son cruciales, y una ligera aproximación en la precisión es aceptable, como en gráficos 3D, videojuegos o en ciertas redes neuronales.

Para derivar el valor del número de punto flotante, la mantisa se multiplica por la base elevada a la potencia del exponente , lo que equivale a desplazar el punto de la base desde su posición implícita en una cantidad de lugares igual al valor del exponente (hacia la derecha si el exponente es positivo o hacia la izquierda si ... - Precisión Doble (FP64): Como su nombre indica, este formato utiliza 64 bits de memoria, ofreciendo una precisión y un rango de valores significativamente mayores:

- 1 bit para el Signo.

- 11 bits para el Exponente (con un sesgo de 1023).

- 52 bits para la Mantisa (significando). Con el bit implícito, esto suma 53 bits de precisión.

La fórmula es similar a la de precisión simple, solo cambia el número de bits del exponente y el sesgo:

(-1)Signo × 2(Exponente_Almacenado - 1023) × (1 + Fracción_Mantisa)La precisión doble es la elección preferida para cálculos científicos y de ingeniería de alta precisión, simulaciones complejas, aplicaciones financieras y cualquier escenario donde la exactitud sea crítica, a pesar de requerir más recursos computacionales.

Comparativa: Precisión Simple vs. Precisión Doble

Para visualizar mejor las diferencias entre estos dos formatos, observemos la siguiente tabla:

| Característica | Precisión Simple (FP32) | Precisión Doble (FP64) |

|---|---|---|

| Bits Totales | 32 bits | 64 bits |

| Bits de Signo | 1 bit | 1 bit |

| Bits de Exponente | 8 bits | 11 bits |

| Bits de Mantisa (Fracción) | 23 bits (efectivamente 24 con bit implícito) | 52 bits (efectivamente 53 con bit implícito) |

| Rango Aproximado | ±1.18 × 10-38 a ±3.4 × 1038 | ±2.23 × 10-308 a ±1.8 × 10308 |

| Usos Típicos | Gráficos 3D, videojuegos, machine learning (inferencia), audio digital | Cálculos científicos, financieros, ingeniería, simulaciones, machine learning (entrenamiento) |

Valores Especiales en IEEE 754: Más Allá de los Números Normales

El estándar IEEE 754 no solo define la representación de números "normales", sino también de valores especiales para manejar situaciones excepcionales:

- Cero (±0): Existen tanto el cero positivo (+0) como el cero negativo (-0). Aunque matemáticamente son idénticos, su distinción puede ser relevante en ciertos algoritmos numéricos, especialmente aquellos que involucran límites o signos.

- Números Subnormales (o Denormalizados): Estos números permiten representar valores muy pequeños que están por debajo del rango de los números normales más pequeños. A diferencia de los números normales, los subnormales no tienen un '1' implícito en su mantisa, lo que les permite rellenar el espacio entre cero y el número normal más pequeño, evitando el "underflow" abrupto (cuando un número se vuelve cero de repente). Proporcionan una "underflow gradual" a expensas de la precisión.

- Infinitos (±∞): Representan resultados de operaciones que desbordan el rango representable (overflow), como la división de un número finito por cero (ej., 1/0 resulta en +∞).

- NaN (Not a Number): Este valor se utiliza para indicar resultados de operaciones matemáticamente indefinidas o no representables, como la raíz cuadrada de un número negativo (sqrt(-1)) o la división de cero entre cero (0/0). Los NaN se propagan a través de los cálculos, indicando que un error o una operación inválida ocurrió en algún punto.

Operaciones Aritméticas con Punto Flotante: Una Danza de Aproximaciones

Realizar cálculos con números de punto flotante es más complejo que con enteros, y la precisión limitada introduce el concepto de errores de redondeo. Aquí exploramos cómo se realizan las operaciones básicas:

Suma y Resta: La Alineación Crucial

Para sumar o restar dos números de punto flotante, es esencial que sus exponentes sean idénticos. Si no lo son, el número con el exponente más pequeño debe ser "alineado" desplazando su mantisa hacia la derecha hasta que los exponentes coincidan. Este desplazamiento es donde a menudo se produce la pérdida de precisión debido al redondeo.

Consideremos un ejemplo simple en base 10 con una precisión limitada a 7 dígitos en la mantisa, similar a cómo lo haría una computadora:

Sumar: 123456.7 + 101.7654

- 123456.7 se representa como 1.234567 × 105

- 101.7654 se representa como 1.017654 × 102

Para sumarlos, alineamos los exponentes:

- 1.234567 × 105 (se mantiene)

- 1.017654 × 102 se convierte en 0.001017654 × 105

Ahora, sumamos las mantisas:

(1.234567 + 0.001017654) × 105 = 1.235584654 × 105

Este es el resultado exacto, pero nuestra máquina solo puede almacenar 7 dígitos de precisión. Por lo tanto, se redondea a:

1.235585 × 105 (o 123558.5)

Observa que los últimos dígitos del segundo operando (654) se perdieron durante la alineación y el redondeo. Este es el famoso "error de redondeo". En casos extremos, la suma de un número muy grande y uno muy pequeño puede resultar en que el pequeño sea completamente "absorbido", como si nunca se hubiera sumado, debido a la limitación de precisión.

Otro problema crítico es la "cancelación de significancia", que ocurre al restar dos números casi iguales. Aunque el cálculo de la diferencia puede ser exacto a nivel binario, el resultado puede tener muchos menos dígitos significativos que los operandos originales. Por ejemplo, si tenemos dos números con 7 dígitos de precisión y su diferencia es muy pequeña, los primeros dígitos se cancelan, dejando solo los últimos dígitos (que pueden ser el resultado de errores de redondeo anteriores) como significativos, lo que lleva a una gran pérdida de precisión relativa.

Multiplicación y División: Errores Acumulativos

La multiplicación de números de punto flotante es conceptualmente más sencilla: se multiplican las mantisas y se suman los exponentes. Luego, el resultado se normaliza y se redondea a la precisión del formato. Por ejemplo:

- Multiplicar: (4.734612 × 103) × (5.417242 × 105)

- Producto de mantisas: 4.734612 × 5.417242 = 25.648538980104

- Suma de exponentes: 3 + 5 = 8

- Resultado intermedio: 25.648538980104 × 108

Después de redondear a 7 dígitos y normalizar, el resultado final sería:

2.564854 × 109

La división sigue un principio similar: se divide la mantisa del dividendo por la del divisor, y el exponente del divisor se resta del exponente del dividendo. Aunque la multiplicación y la división no sufren de los mismos problemas de cancelación directa que la suma y la resta, los errores de redondeo pueden acumularse a lo largo de una cadena de operaciones, afectando la precisión final.

Redondeo y Conversión: El Arte de la Aproximación Controlada

El redondeo es una parte inevitable del cálculo de punto flotante. Ocurre cuando el resultado exacto de una operación o una conversión no puede representarse con la precisión finita disponible. El estándar IEEE 754 exige un "redondeo correcto", lo que significa que el resultado redondeado debe ser el mismo que se obtendría si se realizara el cálculo con precisión infinita y luego se redondeara una sola vez.

Modos de Redondeo

El IEEE 754 especifica varios modos de redondeo, aunque el más común es el primero:

- Redondeo al más cercano, con empates al par (Round Half to Even): Este es el modo predeterminado y el más utilizado. Redondea el resultado al valor representable más cercano. En caso de un empate (cuando el número está exactamente a medio camino entre dos valores representables), se elige el valor cuya mantisa termina en un dígito par. Esto ayuda a minimizar el sesgo acumulado en una serie de operaciones.

- Redondeo al más cercano, con empates alejándose de cero: Una alternativa que redondea los empates alejándose de cero.

- Redondeo hacia +∞ (Round Up): Siempre redondea hacia el infinito positivo. Útil para cálculos que requieren un límite superior.

- Redondeo hacia -∞ (Round Down): Siempre redondea hacia el infinito negativo. Útil para cálculos que requieren un límite inferior.

- Redondeo hacia cero (Truncamiento): Simplemente descarta los dígitos adicionales, aproximando el número hacia cero. Es similar al comportamiento de las conversiones de flotante a entero.

Es crucial entender que muchos números decimales "exactos" (como 0.1) no tienen una representación binaria finita. En binario, 0.1 es una secuencia infinita de bits (0.00011001100...). Cuando se convierte a punto flotante, esta secuencia se trunca y se redondea, lo que significa que 0.1 no se representa de forma exacta en binario. Esta es la razón subyacente de por qué expresiones como 0.1 + 0.2 a menudo no son exactamente 0.3 en la programación.

Manejo de Excepciones: Cuando las Cosas no Salen como Esperamos

El estándar IEEE 754 también define cómo manejar "excepciones", que son condiciones inusuales que pueden surgir durante los cálculos. A diferencia de las excepciones en lenguajes de programación (que suelen interrumpir el flujo), las excepciones IEEE 754 generalmente permiten que la computación continúe, registrando la condición en "banderas de estado pegajosas" (sticky flags) que se mantienen activas hasta que se restablecen explícitamente. Esto permite verificar las condiciones excepcionales al final de una serie de cálculos en lugar de después de cada operación.

Las cinco excepciones aritméticas principales son:

- Inexacto: Se activa cuando el resultado de una operación no puede representarse exactamente y ha sido redondeado. Esto ocurre con frecuencia y es una consecuencia normal de la aritmética de punto flotante.

- Underflow: Se activa si el resultado de una operación es un número subnormal (muy pequeño) y/o inexacto. Indica que el resultado está cerca de cero, pero no es cero.

- Overflow: Se activa si el valor absoluto del resultado es demasiado grande para ser representado en el formato. Por defecto, el resultado de una operación que causa overflow suele ser un infinito (±∞) o el valor finito más grande representable.

- División por cero: Se activa cuando se divide un número finito no cero por cero. El resultado por defecto es ±∞, dependiendo del signo del dividendo y del divisor.

- Inválido: Se activa para operaciones matemáticamente indefinidas, como 0/0, ∞/∞, ∞-∞, o la raíz cuadrada de un número negativo. El resultado por defecto es un NaN.

El diseño del IEEE 754 busca que, en muchos casos, el comportamiento por defecto de estas excepciones permita que los cálculos continúen y, a menudo, produzcan un resultado final razonable, incluso si se encontró una condición excepcional en el camino. Por ejemplo, en el cálculo de resistencias en paralelo, si una resistencia es cero (un cortocircuito), 1/0 resultará en infinito, y la suma de inversas con un infinito dará infinito, lo que al invertir de nuevo (1/infinito) dará cero, el resultado correcto para un cortocircuito.

Desafíos de Precisión y Errores Comunes

La naturaleza aproximada de los cálculos de punto flotante es una fuente común de malentendidos y errores en el desarrollo de software. Es vital recordar que, a diferencia de las matemáticas puras, donde los números tienen precisión infinita, en una computadora, la precisión es siempre finita.

- Error de Discretización: Es la diferencia entre un número real y su representación de punto flotante más cercana. Este error está limitado por la "máquina epsilon", que es el número más pequeño que, sumado a 1.0, produce un valor mayor que 1.0 en el formato de punto flotante.

- ULP (Unit in the Last Place): Representa la diferencia aritmética entre dos números de punto flotante consecutivos. Es una medida de la granularidad de la representación. Por ejemplo, en precisión simple, un ULP para números entre 1 y 2 es 2-23. El estándar IEEE 754 a menudo garantiza que los resultados estén dentro de medio ULP del resultado matemáticamente exacto.

- Comparaciones de Igualdad: Debido a los errores de redondeo, comparar dos números de punto flotante para una igualdad estricta (

a == b) es casi siempre una mala idea. Es mucho más seguro verificar si la diferencia absoluta entre ellos es menor que una pequeña tolerancia (abs(a - b) < epsilon). - Acumulación de Errores: En largas secuencias de cálculos, especialmente en algoritmos iterativos, los pequeños errores de redondeo pueden acumularse y magnificarse, llevando a resultados significativamente incorrectos. La elección de algoritmos numéricamente estables es crucial.

Comprender estas limitaciones no es un impedimento, sino una herramienta para escribir código más robusto y fiable. La aritmética de punto flotante es una maravilla de la ingeniería que nos permite resolver problemas complejos, siempre y cuando seamos conscientes de sus características intrínsecas.

Preguntas Frecuentes (FAQ)

¿Es el cálculo de punto flotante exacto?

No, el cálculo de punto flotante es inherentemente aproximado. Debido a la cantidad finita de bits disponibles para representar números, muchos valores reales (especialmente fracciones decimales no terminantes en binario como 0.1 o números irracionales como π) deben ser redondeados a la representación más cercana, introduciendo pequeños errores.

¿Por qué 0.1 + 0.2 no es 0.3 en mi programa?

Esto se debe a que las fracciones decimales como 0.1 y 0.2 no tienen una representación binaria exacta y finita. Cuando se convierten a formato binario de punto flotante, se redondean ligeramente. La suma de estas aproximaciones redondeadas resulta en un número que está muy cerca de 0.3, pero no es exactamente 0.3, lo que se revela al verificar su igualdad estricta.

¿Cuándo debo usar precisión simple (FP32) versus doble (FP64)?

La elección depende de tus necesidades. Usa precisión doble (FP64) para aplicaciones donde la máxima precisión y un amplio rango de valores son críticos, como en simulaciones científicas, cálculos financieros o ingeniería. Usa precisión simple (FP32) cuando el rendimiento, el uso de memoria o el ancho de banda son más importantes, y una precisión ligeramente menor es aceptable, como en gráficos 3D, videojuegos o en ciertas aplicaciones de inteligencia artificial.

¿Qué significa NaN?

NaN significa "Not a Number" (No es un Número). Es un valor especial en el estándar IEEE 754 que indica el resultado de una operación matemáticamente indefinida o no representable, como dividir cero entre cero, tomar la raíz cuadrada de un número negativo, o realizar operaciones como infinito menos infinito. Los NaN se propagan a través de los cálculos.

¿Qué es el "sesgo" del exponente en punto flotante?

El sesgo es un valor que se suma al exponente real antes de almacenarlo en el formato de punto flotante. Su propósito es permitir que el exponente sea representado como un número positivo sin la necesidad de un bit de signo adicional para el propio exponente. Esto simplifica las comparaciones y la aritmética. Por ejemplo, en precisión simple (FP32), el sesgo es 127, lo que significa que un exponente almacenado de 127 representa un exponente real de 0.

En resumen, los números de punto flotante son una herramienta poderosa y compleja que permite a las computadoras manejar una vasta gama de valores con eficiencia. Si bien ofrecen una flexibilidad impresionante, es crucial comprender que operan con una precisión finita y que los cálculos son, por naturaleza, aproximados. Conocer el estándar IEEE 754 y sus implicaciones es clave para escribir software robusto y fiable, que pueda interpretar y manejar correctamente los desafíos inherentes a la aritmética de punto flotante.

Si quieres conocer otros artículos parecidos a Punto Flotante: Cálculos y Precisión Digital puedes visitar la categoría Cálculos.