05/08/2022

En el vasto universo de la estadística y el análisis de datos, la variabilidad es una constante. Los fenómenos que observamos rara vez son idénticos; siempre hay diferencias, fluctuaciones y dispersiones. Comprender y cuantificar esta variabilidad es fundamental para extraer conclusiones significativas y tomar decisiones informadas. Una de las herramientas más poderosas para lograrlo es la desviación estándar, y cuando la aplicamos al concepto de distribuciones muestrales, entramos en un terreno aún más profundo y revelador.

Este artículo explorará la desviación estándar no solo en su forma más básica, sino también cómo se manifiesta y por qué es tan crítica en el contexto de la distribución muestral. Abordaremos cómo factores como las diferencias individuales pueden influir dramáticamente en nuestros resultados y cómo la aplicación inteligente de métodos estadísticos puede revelar verdades ocultas en nuestros datos.

- ¿Qué es la Desviación Estándar?

- La Variabilidad Individual: Un Desafío Crucial en la Investigación

- La Desviación Estándar de la Distribución Muestral (Error Estándar)

- Impacto en la Significancia Estadística

- Estrategias para Reducir el Impacto de la Variabilidad Individual

- Preguntas Frecuentes (FAQs)

- Conclusión

¿Qué es la Desviación Estándar?

Antes de sumergirnos en las complejidades de las distribuciones muestrales, es esencial recordar qué es la desviación estándar en su esencia. La desviación estándar (σ) es una medida de la dispersión o propagación de un conjunto de datos. Nos dice cuánto, en promedio, se desvían los valores individuales de la media (promedio) del conjunto. Una desviación estándar baja indica que los puntos de datos tienden a estar cerca de la media, mientras que una desviación estándar alta indica que los puntos de datos están distribuidos en un rango más amplio de valores.

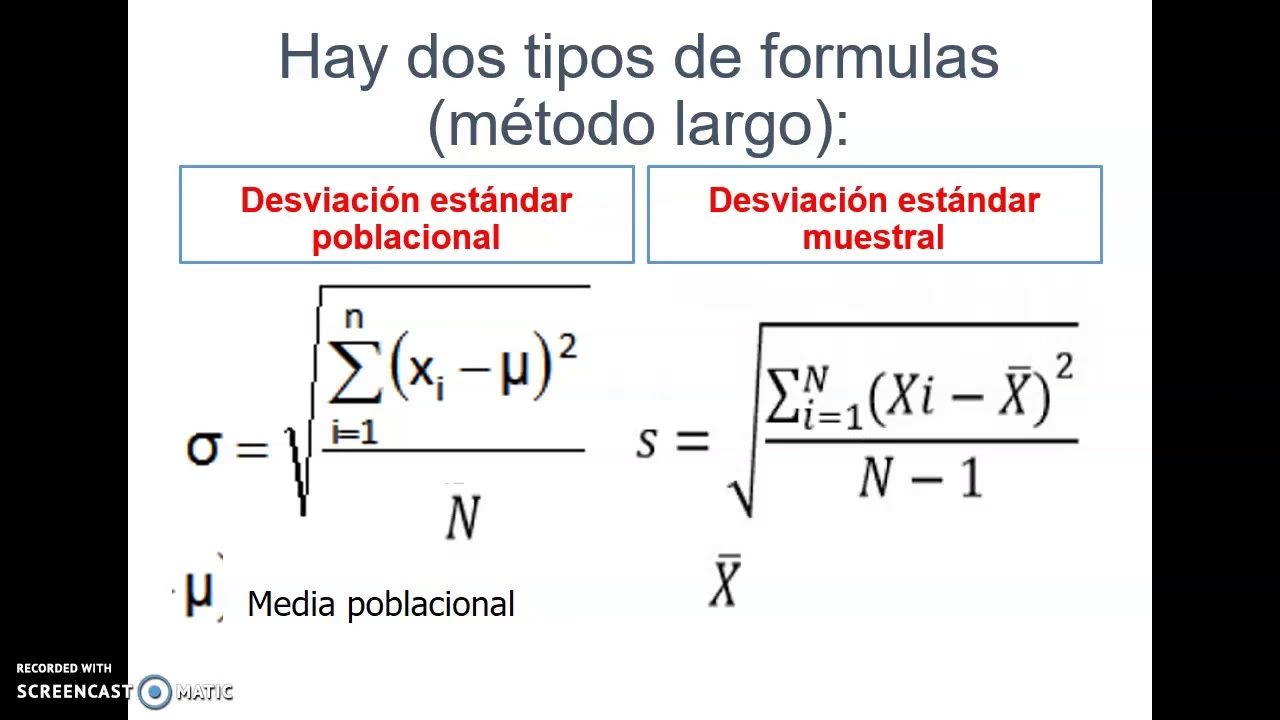

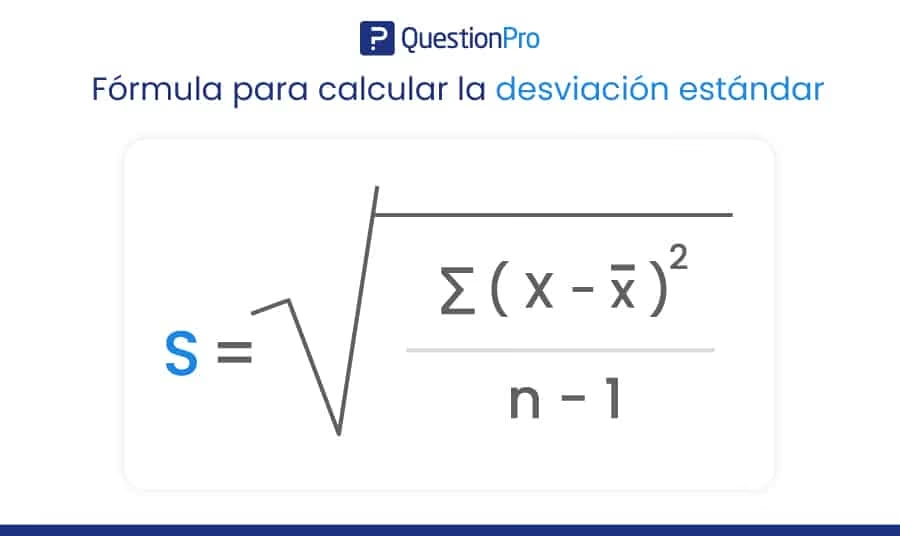

Matemáticamente, la desviación estándar se calcula como la raíz cuadrada de la varianza. La varianza (σ²) es el promedio de las diferencias al cuadrado de cada punto de datos con respecto a la media. Su fórmula para una muestra es:

σ = √( ∑(xᵢ - µ)² / (n - 1) )

Donde xᵢ son las mediciones individuales de la muestra, µ es la media de la muestra y n es el número total de mediciones. La desviación estándar se mide en las mismas unidades que la media, lo que facilita su interpretación.

Una de las distribuciones más comunes en estadística es la distribución normal, a menudo llamada la 'curva de campana'. Esta distribución es simétrica alrededor de su media, y su densidad de probabilidad disminuye exponencialmente con el cuadrado del número de desviaciones estándar desde la media. Una propiedad clave de la distribución normal es que aproximadamente el 68% de los datos se encuentran dentro de una desviación estándar de la media (µ ± σ), más del 95% dentro de dos desviaciones estándar (µ ± 2σ), y menos de 3 de cada 1000 muestras se encontrarán fuera de tres desviaciones estándar (µ ± 3σ).

La Variabilidad Individual: Un Desafío Crucial en la Investigación

Cuando realizamos experimentos, especialmente aquellos que involucran a seres humanos, nos enfrentamos a una fuente significativa de variabilidad: las diferencias individuales. Cada persona es única, con habilidades, experiencias y ritmos distintos. Estas diferencias pueden influir drásticamente en los resultados de un experimento, enmascarando los efectos reales de las variables que estamos tratando de medir.

Imaginemos un estudio donde medimos el tiempo que tardan 20 sujetos en completar una tarea utilizando dos formularios diferentes, Formulario A y Formulario B. Diez sujetos usan primero el Formulario A y luego el B, y los otros diez, el Formulario B y luego el A. Los resultados podrían ser similares a los de la siguiente tabla:

| Sujeto | A | B | C | D | E | F | G | H | I | J |

|---|---|---|---|---|---|---|---|---|---|---|

| Tiempo A (seg) | 195 | 278 | 146 | 247 | 198 | 209 | 121 | 256 | 262 | 131 |

| Tiempo B (seg) | 250 | 358 | 187 | 313 | 234 | 254 | 137 | 347 | 326 | 181 |

| Ratio A/B | 0.78 | 0.78 | 0.78 | 0.79 | 0.85 | 0.82 | 0.88 | 0.74 | 0.80 | 0.72 |

| Sujeto | K | L | M | N | O | P | Q | R | S | T |

| Tiempo A (seg) | 229 | 271 | 243 | 222 | 262 | 168 | 98 | 58 | 242 | 238 |

| Tiempo B (seg) | 287 | 308 | 272 | 260 | 304 | 195 | 104 | 61 | 257 | 290 |

| Ratio A/B | 0.80 | 0.88 | 0.89 | 0.85 | 0.86 | 0.86 | 0.94 | 0.95 | 0.94 | 0.82 |

Como se puede observar, existe una gran variación entre los individuos. El Sujeto B registró el tiempo más largo (358 segundos), mientras que el Sujeto R registró el más corto (58 segundos). Si calculamos los tiempos promedio, obtenemos µ(tA) ≈ 204 segundos y µ(tB) ≈ 246 segundos. Parece que el Formulario A fue 42 segundos más rápido que el Formulario B. Pero, ¿es esta diferencia realmente significativa o podría deberse simplemente a la casualidad?

Si combinamos todos los resultados y calculamos una desviación estándar global, encontramos que µ ≈ 225 y σ ≈ 80.5. Esta desviación estándar tan grande refleja la inmensa variabilidad entre los sujetos. En este escenario, la diferencia de 42 segundos entre los promedios de los formularios A y B no es estadísticamente significativa, ya que la variación individual fácilmente supera esta diferencia. Es como si la «ruido» de las diferencias individuales ahogara la «señal» de la diferencia entre los formularios.

La Desviación Estándar de la Distribución Muestral (Error Estándar)

Aquí es donde entra en juego la desviación estándar de la distribución muestral, más comúnmente conocida como error estándar. Mientras que la desviación estándar de una muestra (σ) nos dice sobre la dispersión de los datos individuales dentro de esa muestra, el error estándar nos informa sobre la dispersión de las *estadísticas de la muestra* (como la media muestral) si tomáramos múltiples muestras de la misma población.

Imagina que repites el experimento de los formularios muchas veces, cada vez tomando una nueva muestra de 20 sujetos y calculando la media de los tiempos para el Formulario A y el Formulario B. Si graficaras todas estas medias muestrales, formarían una distribución propia. La desviación estándar de esta distribución de medias muestrales es lo que llamamos el error estándar de la media. Es una medida de cuán precisamente la media de una muestra representa la verdadera media de la población.

Un error estándar pequeño indica que las medias de las diferentes muestras serían muy parecidas entre sí y, por lo tanto, la media de nuestra muestra actual es probablemente una buena estimación de la media de la población. Un error estándar grande, por el contrario, sugiere que las medias de las muestras pueden variar mucho, lo que hace que la media de nuestra muestra sea una estimación menos precisa.

Para las medias, el error estándar (SE) se calcula como:

SE = σ / √n

Donde σ es la desviación estándar de la población (o una estimación de la misma a partir de la muestra) y n es el tamaño de la muestra. Se observa que a medida que el tamaño de la muestra (n) aumenta, el error estándar disminuye, lo que significa que nuestras estimaciones de la media de la población se vuelven más precisas.

Impacto en la Significancia Estadística

La significancia estadística es la probabilidad de que una diferencia observada entre dos grupos o variables no se deba simplemente al azar. Un valor p bajo (generalmente menor a 0.05) indica que la diferencia es estadísticamente significativa.

Como vimos en el ejemplo de los formularios, las grandes diferencias individuales llevaron a una desviación estándar general alta (σ = 80.5 segundos). Esto, a su vez, resultó en un error estándar relativamente grande para las medias de los tiempos. Un error estándar grande significa que el «rango de incertidumbre» alrededor de nuestras medias muestrales es amplio, haciendo que una diferencia de 42 segundos sea difícil de considerar significativa frente a esa variabilidad inherente.

En otras palabras, la alta variabilidad individual amplifica el error estándar de las medias muestrales, lo que dificulta la detección de diferencias verdaderas. La hipótesis nula (que no hay diferencia real entre los formularios y todas las observaciones provienen de una única distribución normal) no pudo ser rechazada con confianza en este caso, a pesar de la diferencia aparente.

Estrategias para Reducir el Impacto de la Variabilidad Individual

La clave para lograr la significancia estadística, incluso con alta variabilidad individual, reside en cómo analizamos los datos para reducir el error estándar de la estadística que nos interesa. El texto proporcionado sugiere una estrategia muy efectiva: en lugar de comparar las medias de los tiempos absolutos, comparamos los *ratios* o las *diferencias* dentro de cada individuo.

Comparación de Ratios o Diferencias Intrasujeto

Si comparamos los ratios entre el tiempo del Formulario A y el Formulario B para cada sujeto (tA / tB), encontramos que, en promedio, los sujetos completaron la tarea con el Formulario A en 0.84 del tiempo que les llevó con el Formulario B. Lo más sorprendente es que la desviación estándar de estos ratios, σ(tA/tB), es de solo 0.07. Esta desviación estándar mucho más pequeña indica que el Formulario A es más rápido que el Formulario B con una significancia superior al 98%.

¿Por qué esta diferencia tan marcada en la significancia? La respuesta es simple: al tomar ratios o diferencias (tA - tB) dentro del mismo individuo, estamos controlando las diferencias individuales. Un sujeto que es consistentemente lento en general, lo será tanto con el Formulario A como con el B. Al comparar tA con tB para el mismo sujeto, estamos viendo la diferencia *para esa persona*, eliminando el efecto de su velocidad general. Esto reduce drásticamente la variabilidad de la medida que estamos analizando (el ratio o la diferencia), lo que a su vez reduce su error estándar y aumenta la probabilidad de detectar una diferencia significativa.

De manera similar, el promedio de las diferencias, µ(tA - tB), también resulta ser significativo, a pesar de que la diferencia de los promedios, µ(tA) - µ(tB), no lo era. Esto subraya la importancia de un diseño experimental que permita el emparejamiento o la comparación intrasujeto cuando la variabilidad individual es alta.

Efectos del Aprendizaje y Otras Consideraciones

Además de las diferencias individuales, existen otros factores que pueden introducir variabilidad en nuestros experimentos. Uno de ellos son los efectos del aprendizaje. Si un sujeto realiza una tarea varias veces, su rendimiento puede mejorar debido a la familiarización o el aprendizaje. El texto menciona que, al analizar los datos, se encontró que el formulario que se probó en segundo lugar obtuvo una ventaja de aproximadamente el 5%. Esto significa que el orden en que se presentan los formularios puede influir en los resultados, y es una fuente adicional de variabilidad que debe ser considerada y controlada en el diseño experimental (por ejemplo, mediante la contrabalanceo).

En resumen, al realizar experimentos, especialmente en campos como la psicología o la usabilidad, es crucial:

- Asegurarse de que los experimentadores no influyan inconscientemente en los resultados.

- Compensar adecuadamente los efectos del aprendizaje.

- Tomar en cuenta las diferencias individuales de los participantes.

Solo al reconocer y gestionar estas fuentes de variabilidad podemos transformar las mediciones de una muestra en inferencias válidas y estadísticamente significativas sobre la población de la que proviene la muestra. La desviación estándar, y más específicamente el error estándar de la distribución muestral, son las herramientas que nos permiten cuantificar la incertidumbre en estas inferencias.

Preguntas Frecuentes (FAQs)

¿Cuál es la diferencia entre desviación estándar y error estándar?

Esta es una de las preguntas más comunes y cruciales en estadística. La desviación estándar (σ) mide la dispersión de los puntos de datos individuales alrededor de la media en una *única muestra o población*. Es una descripción de la variabilidad inherente en los datos brutos. Por ejemplo, si mides la altura de 100 personas, la desviación estándar te dirá cuánto varían sus alturas entre sí.

El error estándar (SE), por otro lado, es la desviación estándar de la *distribución muestral de una estadística* (como la media). Mide la variabilidad de las estimaciones de la estadística de una muestra a otra. Si tomaras 100 muestras de 100 personas cada una y calcularas la altura media de cada muestra, el error estándar de la media te diría cuánto varían esas 100 medias entre sí. En esencia, el error estándar estima cuán precisa es tu estadística muestral como estimación del parámetro poblacional verdadero.

¿Por qué es importante considerar las diferencias individuales en un experimento?

Considerar las diferencias individuales es vital porque ignorarlas puede llevar a conclusiones erróneas o a la incapacidad de detectar efectos reales. Las personas varían enormemente en sus habilidades, tiempos de reacción, conocimientos previos y otros factores. Si estas variaciones individuales son muy grandes, pueden enmascarar el efecto de la variable que estás intentando estudiar. Por ejemplo, si un tratamiento solo funciona en un subgrupo específico o si la velocidad general de los participantes es tan variada que ahoga el efecto de un factor experimental. Al tener en cuenta estas diferencias (por ejemplo, mediante diseños intrasujeto o análisis de covarianza), puedes reducir el ruido en tus datos, lo que a su vez disminuye el error estándar de tus mediciones y aumenta la potencia estadística para detectar efectos significativos.

¿Cómo se relaciona la desviación estándar con la significancia estadística?

La desviación estándar está intrínsecamente ligada a la significancia estadística a través del error estándar. Un valor de desviación estándar alto en tus datos brutos (debido a la variabilidad individual o de otro tipo) se traduce en un error estándar más grande para las estadísticas que calculas (como las medias). Un error estándar grande significa que hay más incertidumbre sobre la verdadera ubicación del parámetro poblacional. Para que una diferencia observada sea considerada estadísticamente significativa, debe ser lo suficientemente grande en comparación con esta incertidumbre (es decir, en comparación con el error estándar). Si el error estándar es grande, la diferencia observada debe ser aún mayor para alcanzar la significancia. Por lo tanto, reducir la desviación estándar (y, por ende, el error estándar) a través de un buen diseño experimental o un análisis adecuado es clave para aumentar la probabilidad de encontrar significancia estadística si un efecto real existe.

¿Qué es una distribución normal y por qué es relevante?

Una distribución normal, también conocida como distribución gaussiana o curva de campana, es una de las distribuciones de probabilidad más importantes en estadística. Se caracteriza por ser simétrica alrededor de su media y por tener una forma de campana distintiva. Es relevante por varias razones:

- Ocurrencia Natural: Muchos fenómenos naturales (alturas, pesos, puntuaciones de CI, errores de medición) tienden a seguir una distribución normal.

- Teorema del Límite Central: Incluso si los datos de una población no son normales, las medias de muestras grandes tomadas de esa población tienden a distribuirse normalmente. Esto es fundamental para las pruebas de hipótesis y los intervalos de confianza.

- Propiedades Conocidas: Sus propiedades matemáticas son bien entendidas, lo que permite calcular fácilmente probabilidades y establecer intervalos de confianza (por ejemplo, la regla 68-95-99.7).

- Base para Pruebas Estadísticas: Muchas pruebas estadísticas paramétricas asumen que los datos (o los errores de los datos) se distribuyen normalmente.

Comprender la distribución normal es esencial para interpretar la desviación estándar, ya que esta última define la dispersión de los datos dentro de esa forma de campana.

Conclusión

La desviación estándar es mucho más que un simple número; es una ventana a la dispersión de nuestros datos. Cuando la aplicamos al contexto de la distribución muestral, a través del concepto de error estándar, se convierte en una métrica indispensable para evaluar la fiabilidad de nuestras inferencias sobre una población. Hemos visto cómo la variabilidad individual puede ser un factor dominante que enmascara los efectos reales, pero también cómo estrategias de análisis inteligentes, como el uso de ratios o diferencias intrasujeto, pueden reducir drásticamente el impacto de esta variabilidad, revelando patrones y significancia que de otro modo pasarían desapercibidos.

En última instancia, un análisis de datos robusto requiere una comprensión profunda de la variabilidad y cómo gestionarla. Al dominar la desviación estándar y el error estándar, equipamos nuestras herramientas analíticas para desentrañar la complejidad de los datos y tomar decisiones basadas en evidencia sólida y confiable.

Si quieres conocer otros artículos parecidos a ¿Qué es la Desviación Estándar de la Distribución Muestral? puedes visitar la categoría Estadística.