05/09/2022

En el vasto universo del análisis de datos y el aprendizaje automático, la capacidad de predecir el futuro o comprender las relaciones entre variables es invaluable. Los modelos de regresión son herramientas poderosas que nos permiten hacer precisamente eso: identificar patrones, tendencias y dependencias en los datos. Sin embargo, la utilidad de cualquier modelo predictivo reside en su precisión. ¿Cómo podemos saber si un modelo es confiable? Para responder a esta pregunta fundamental, es esencial dominar métricas clave de evaluación, como el Error Cuadrático Medio (RMSE), el cual nos proporciona una visión clara de cuán bien nuestro modelo se ajusta a los datos reales.

Aunque la información a menudo se presenta en el contexto de lenguajes como Python, los principios subyacentes y la importancia de estas métricas son universales y se aplican igualmente en R, un lenguaje ampliamente utilizado por estadísticos y científicos de datos. A lo largo de este artículo, desglosaremos qué es el RMSE, cómo se relaciona con otras métricas importantes y cómo puedes calcularlo e interpretarlo para validar la robustez de tus modelos de regresión en R.

La Importancia de los Modelos de Regresión y su Evaluación

Los modelos de regresión son una piedra angular en el análisis predictivo. Permiten explorar cómo una o más variables independientes influyen en una variable dependiente, cuantificando la fuerza y la dirección de estas relaciones. Esta capacidad para "ver" el futuro o comprender conexiones complejas es crucial en una multitud de campos, desde la predicción de precios de acciones hasta la evaluación de la eficacia de un tratamiento médico o la optimización de procesos de ingeniería. Industrias de alto riesgo como las finanzas, la analítica de negocios, la ingeniería, la salud, la ciencia y el deporte, dependen en gran medida de estos modelos para la planificación estratégica, la evaluación de riesgos y la toma de decisiones informadas.

La validez de cualquier modelo de regresión depende directamente de su precisión, es decir, de qué tan bien explica las variaciones en los datos. Aquí es donde entran en juego las métricas de evaluación. Sin una forma de cuantificar el error o la bondad de ajuste de un modelo, sus predicciones podrían ser engañosas o, peor aún, incorrectas. El aprendizaje automático y la inteligencia artificial, en particular, trabajan para identificar las variables correctas, ajustar los modelos para mejorar las predicciones y capturar relaciones difíciles de identificar en conjuntos de datos masivos que son complejos y no lineales. Mejorar la forma en que un modelo se ajusta o explica las variaciones de los datos lo hace más preciso en sus predicciones, reduciendo el subajuste (cuando el modelo pierde relaciones clave) y el sobreajuste (cuando incorpora ruido sin sentido).

Métricas Clave para Entender el Error

Antes de sumergirnos en el RMSE, es fundamental comprender algunas métricas relacionadas que nos ayudan a evaluar la calidad de un modelo.

¿Qué es la Varianza?

En el contexto de la regresión lineal, la varianza es una medida de cuánto difieren los valores observados de la media de los valores predichos. El objetivo es que esta medida sea baja, lo que indica que las predicciones del modelo están cerca de los valores reales. Una varianza alta sugiere que las predicciones están muy dispersas con respecto a los valores observados, lo que implica una menor fiabilidad del modelo.

El Coeficiente de Determinación (R2 Score)

El R2 score, o coeficiente de determinación, es una métrica fundamental que nos dice la proporción de la varianza en la variable dependiente que es predecible a partir de la(s) variable(s) independiente(s). Matemáticamente, se define como (varianza total explicada por el modelo) / varianza total. Si el R2 es del 100%, significa que las variables están perfectamente correlacionadas, es decir, no hay varianza sin explicar por el modelo. El R2 varía entre 0% y 100%.

Un R2 alto (cercano a 100%) generalmente indica un buen ajuste del modelo, lo que significa que gran parte de la variabilidad de la variable dependiente es explicada por las variables independientes. Sin embargo, un R2 bajo no siempre implica un mal modelo, ya que su interpretación puede depender del campo de estudio y la complejidad inherente de los datos. Es una métrica valiosa para comparar diferentes versiones del mismo modelo o modelos en el mismo contexto de datos.

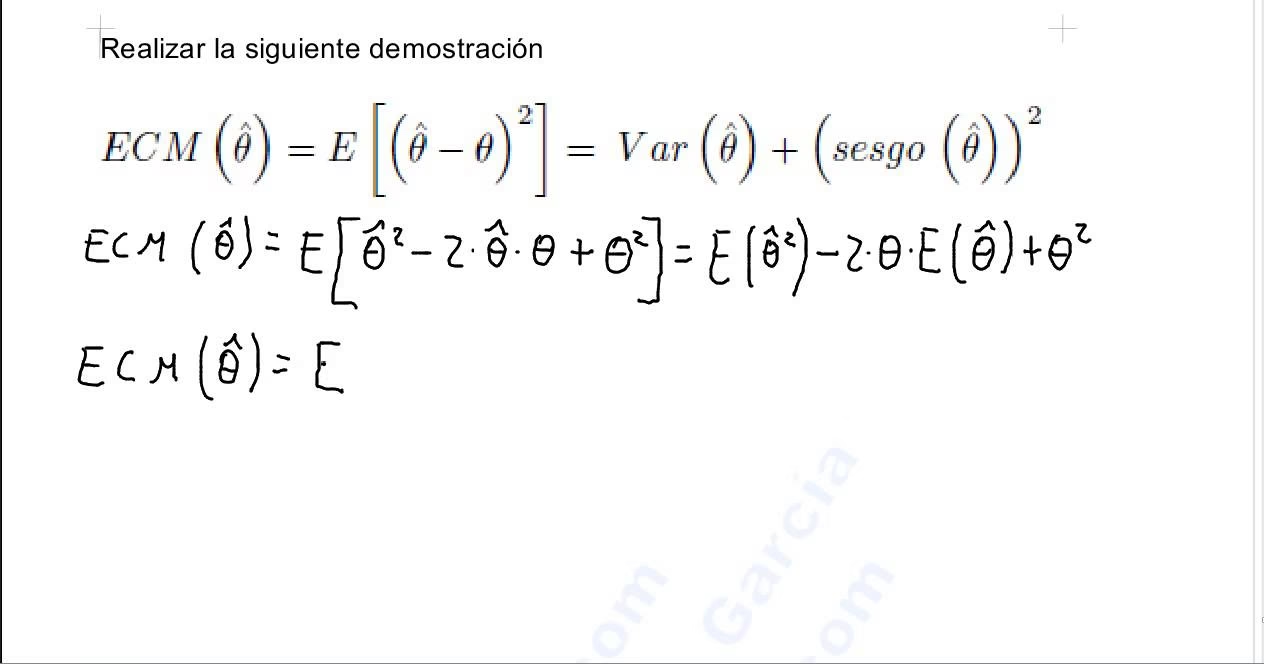

El Error Cuadrático Medio (MSE)

El Error Cuadrático Medio (MSE) es el promedio de los cuadrados de los errores. El error, en este caso, es la diferencia entre los valores observados (reales) y los valores predichos por el modelo. Se eleva al cuadrado cada diferencia para asegurar que los valores negativos y positivos no se cancelen entre sí, y para penalizar más fuertemente los errores grandes. Cuanto mayor sea el valor del MSE, mayor será el error del modelo. Un MSE de cero significaría un modelo perfecto, algo raramente alcanzable en la práctica.

La fórmula del MSE es la siguiente:

MSE = (1/n) * Σ(Y_observado - Y_predicho)^2

Donde:

nes el número de observaciones.Y_observadoson los valores reales de la variable dependiente.Y_predichoson los valores pronosticados por el modelo.

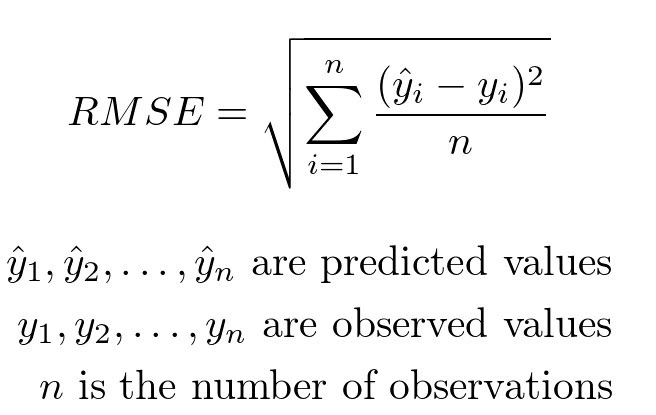

Del MSE al RMSE: El Error Cuadrático Medio Raíz

El Error Cuadrático Medio Raíz (RMSE) es, como su nombre indica, la raíz cuadrada del MSE. Es una de las métricas de evaluación de modelos de regresión más utilizadas debido a su interpretabilidad. Mientras que el MSE está en unidades cuadradas de la variable dependiente, el RMSE está en las mismas unidades que la variable dependiente, lo que facilita su comprensión y comparación con los valores reales.

La fórmula del RMSE es:

RMSE = √MSE = √[(1/n) * Σ(Y_observado - Y_predicho)^2]

La principal ventaja del RMSE sobre el MSE es su interpretabilidad. Si tu variable dependiente mide precios en dólares, un RMSE de 5.00 dólares significa que, en promedio, las predicciones de tu modelo se desvían de los valores reales en 5.00 dólares. Esto es mucho más intuitivo que un MSE de 25.00 dólares cuadrados. Al igual que el MSE, un RMSE más bajo indica un mejor ajuste del modelo a los datos.

Calculando RMSE en R

Aunque el texto original se centra en Python, la lógica para calcular el RMSE es idéntica en R. R ofrece varias formas de realizar esta tarea, ya sea mediante cálculos manuales paso a paso o utilizando funciones predefinidas de paquetes populares.

Pasos Conceptuales para Calcular RMSE en R:

- Obtener los valores observados y predichos: Necesitarás un vector con los valores reales de tu variable dependiente y otro vector con las predicciones generadas por tu modelo de regresión.

- Calcular los errores (residuos): Resta los valores predichos de los valores observados.

- Elevar al cuadrado los errores: Cada error individual debe ser elevado al cuadrado.

- Calcular la media de los errores cuadrados: Suma todos los errores cuadrados y divídelos por el número de observaciones. Esto te dará el MSE.

- Tomar la raíz cuadrada del MSE: Aplica la función de raíz cuadrada al MSE para obtener el RMSE.

Uso de Funciones en R:

En R, no es necesario realizar estos cálculos paso a paso manualmente en la mayoría de los casos, ya que existen funciones y paquetes optimizados para ello. Paquetes como Metrics, caret, o MLmetrics proporcionan funciones directas para calcular el MSE y el RMSE. Por ejemplo, una vez que tienes tus vectores de valores reales (y_real) y predichos (y_pred), podrías usar:

- Para MSE:

mean((y_real - y_pred)^2) - Para RMSE:

sqrt(mean((y_real - y_pred)^2))

O, si utilizas un paquete:

- Con el paquete

Metrics:rmse(y_real, y_pred) - Con el paquete

MLmetrics:RMSE(y_pred, y_real)(¡nota el orden de los argumentos!)

Es importante siempre consultar la documentación de la función específica que uses para verificar el orden correcto de los argumentos (valores reales vs. predichos).

Interpretando el RMSE

Al igual que el MSE, no existe un valor universalmente "bueno" para el RMSE. Su interpretación depende en gran medida del contexto de tus datos y del dominio en el que trabajes. Sin embargo, algunas pautas generales incluyen:

- Cuanto más bajo, mejor: Un RMSE más cercano a cero indica un modelo que se ajusta casi perfectamente a los datos observados.

- Comparación entre modelos: El RMSE es excelente para comparar el rendimiento de diferentes modelos entrenados en el mismo conjunto de datos. El modelo con el RMSE más bajo generalmente se considera el mejor.

- Escala de la variable dependiente: El RMSE debe interpretarse en relación con la escala de la variable que estás prediciendo. Un RMSE de 10 puede ser excelente si estás prediciendo valores que van de 0 a 1000, pero podría ser inaceptable si los valores oscilan entre 0 y 20.

Es crucial no interpretar el RMSE de forma aislada. Siempre debe considerarse junto con otras métricas, como el R2, el error absoluto medio (MAE) y el análisis de los residuos. La combinación de estas métricas proporciona una visión más completa de la fortaleza y las debilidades de tu modelo.

Tabla Comparativa: MSE vs. RMSE

| Característica | Error Cuadrático Medio (MSE) | Error Cuadrático Medio Raíz (RMSE) |

|---|---|---|

| Definición | Promedio de los errores al cuadrado. | Raíz cuadrada del MSE. |

| Unidades | Unidades de la variable dependiente al cuadrado. | Mismas unidades que la variable dependiente. |

| Penalización de errores grandes | Penaliza más fuertemente los errores grandes. | Penaliza más fuertemente los errores grandes (debido a la cuadratura). |

| Interpretabilidad | Menos intuitivo, ya que las unidades están al cuadrado. | Más intuitivo, directamente comparable con los valores reales. |

| Rango de valores | ≥ 0 | ≥ 0 |

| Uso principal | Cálculo interno para optimización, base para RMSE. | Métrica de evaluación final para presentar y comparar modelos. |

Preguntas Frecuentes (FAQ)

¿Por qué se elevan al cuadrado los errores al calcular MSE y RMSE?

Existen dos razones principales: primero, elevar al cuadrado asegura que los errores positivos y negativos no se cancelen entre sí, lo que podría llevar a un error total engañosamente bajo. Segundo, la cuadratura penaliza los errores grandes de manera más significativa que los errores pequeños. Esto significa que un modelo con varios errores pequeños es preferible a un modelo con unos pocos errores grandes, aunque la suma de sus errores absolutos pudiera ser similar.

¿Cuál es la diferencia fundamental entre MSE y RMSE?

La diferencia fundamental radica en sus unidades y, por ende, en su interpretabilidad. El MSE está en unidades cuadradas de la variable dependiente, lo que lo hace menos intuitivo. El RMSE, al tomar la raíz cuadrada del MSE, devuelve el error a las unidades originales de la variable dependiente, haciéndolo mucho más fácil de entender y comunicar.

¿Existe un valor "bueno" o "aceptable" para el RMSE?

No existe un valor universalmente "bueno" para el RMSE. La calidad de un RMSE depende del contexto y la escala de los datos. Un RMSE de 10 puede ser excelente para predecir el precio de una casa en miles de dólares, pero terrible para predecir la temperatura en grados Celsius. Siempre debe evaluarse en relación con el rango de los valores de la variable dependiente y los requisitos del problema específico.

¿Cuándo debería usar RMSE en lugar de MSE?

Generalmente, se prefiere el RMSE para la presentación y la interpretación de los resultados del modelo debido a que sus unidades son las mismas que las de la variable objetivo. El MSE es más común en los procesos de optimización del modelo (por ejemplo, en el descenso de gradiente) porque su función es diferenciable y matemáticamente más conveniente para la minimización.

¿Es posible calcular RMSE manualmente en R sin usar paquetes?

Sí, es perfectamente posible. Como se explicó en la sección de pasos conceptuales, puedes realizar la resta de valores, elevar al cuadrado, calcular la media y luego la raíz cuadrada utilizando las funciones básicas de R como -, ^2, mean() y sqrt().

Comprender y aplicar métricas como el RMSE es fundamental para cualquier persona que trabaje con modelos de regresión. No solo te permite cuantificar la precisión de tus predicciones, sino que también te capacita para comparar y seleccionar el mejor modelo para tu problema. Al interpretar el RMSE en el contexto adecuado y combinarlo con otras métricas, puedes asegurar que tus modelos no solo sean potentes, sino también confiables y útiles para la toma de decisiones.

Si quieres conocer otros artículos parecidos a Calculando el Error Cuadrático Medio (RMSE) en R puedes visitar la categoría Estadística.