03/08/2025

En el fascinante mundo de la programación y el desarrollo de software, entender cuánto tiempo tarda una pieza de código en ejecutarse es fundamental. A primera vista, la respuesta parece sencilla: basta con usar un cronómetro, iniciar el programa y observar cuánto tiempo tarda hasta que finalice. Sin embargo, esta aproximación, aunque útil para una medición rápida y superficial, apenas roza la superficie de un concepto mucho más profundo y complejo: la complejidad temporal de los algoritmos. Este artículo te guiará desde la medición práctica con un cronómetro hasta el análisis abstracto que permite comparar la eficiencia de diferentes soluciones a un mismo problema.

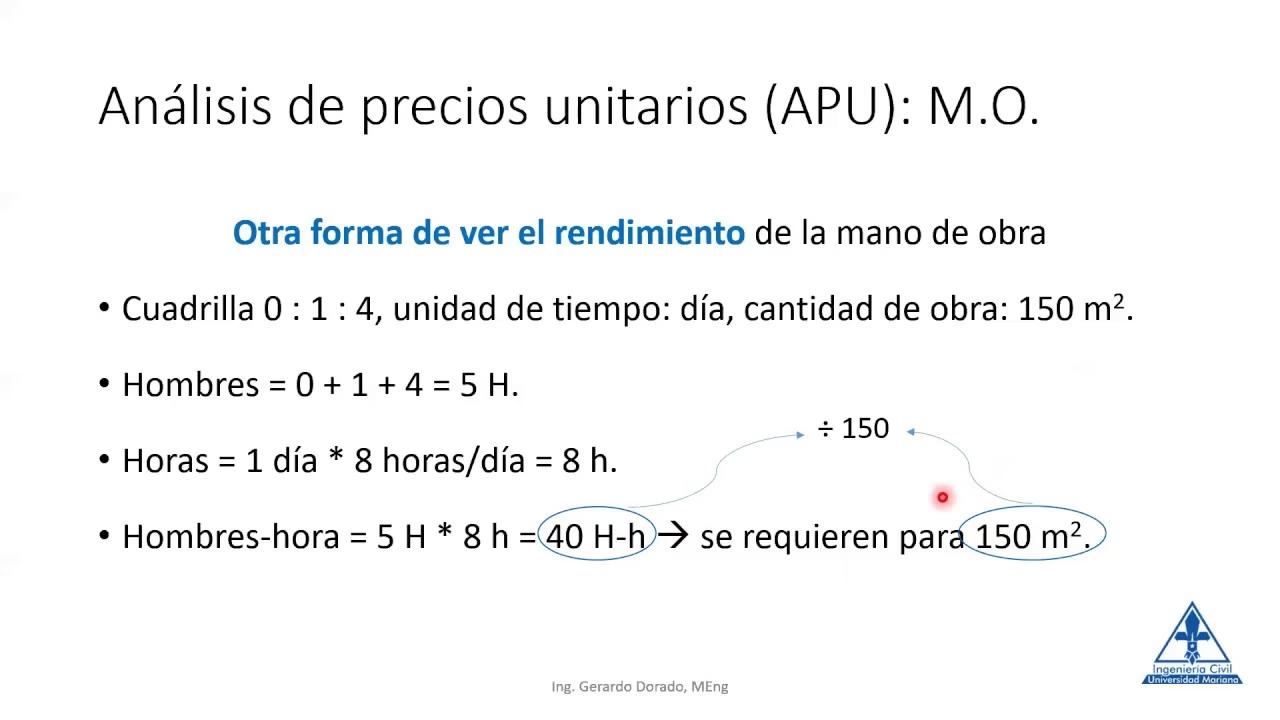

La medición del tiempo de ejecución de un programa con un cronómetro es un método directo y empírico. Simplemente, se inicia el temporizador justo antes de que el programa comience su ejecución y se detiene una vez que ha finalizado. El valor resultante es el tiempo real que el programa tardó en completarse en un entorno específico. Este enfoque es valioso para depuración y para tener una idea aproximada del rendimiento en un sistema dado. Sin embargo, tiene limitaciones significativas: el tiempo medido puede variar según el hardware, el sistema operativo, la carga del sistema en ese momento y otros procesos ejecutándose en paralelo. No nos dice nada sobre cómo se comportará el programa si el tamaño de los datos de entrada cambia drásticamente, ni permite comparar de forma justa dos algoritmos ejecutándose en máquinas diferentes.

- La Complejidad Temporal: Un Modelo Abstracto de Eficiencia

- La Tasa de Crecimiento y la Notación Big-O

- Complejidades Temporales Populares en Algoritmos

- Pasos para Calcular la Complejidad Temporal y Comparar la Eficiencia

- Preguntas Frecuentes (FAQ)

- ¿Por qué es importante medir el tiempo de ejecución de un programa?

- ¿Cuál es la diferencia entre medir con un cronómetro y el análisis de complejidad temporal?

- ¿Siempre debo usar la notación Big-O para analizar algoritmos?

- ¿Qué significa 'tamaño de entrada' en el contexto de la complejidad temporal?

- ¿Un algoritmo O(n) es siempre más rápido que un O(n²)?

La Complejidad Temporal: Un Modelo Abstracto de Eficiencia

Para superar las limitaciones de la medición empírica, los informáticos desarrollaron un modelo matemático abstracto conocido como análisis de la complejidad temporal. Este modelo nos permite comparar la eficiencia de diversos algoritmos para un mismo problema de codificación, independientemente del hardware o el lenguaje de programación. Además, nos ayuda a comprender la naturaleza del rendimiento de un algoritmo para diferentes tamaños de entrada y proporciona oportunidades para una optimización futura.

¿Qué es el Tamaño de Entrada?

Definimos el tamaño de entrada como el número total de elementos presentes en los datos de entrada. A medida que aumentamos el tamaño de entrada, el número total de operaciones realizadas por un algoritmo generalmente aumentará. En otras palabras, el tiempo que tarda un algoritmo aumentará con el crecimiento del tamaño de entrada.

El valor del tamaño de entrada depende de la naturaleza del problema. La mayoría de las veces, lo calculamos en función del número de elementos. Por ejemplo, para ordenar 'n' enteros en un array, tenemos 'n' elementos de datos, por lo que el tamaño de entrada es 'n'. Realizamos operaciones básicas como comparación o intercambio para ordenar la entrada. Si aumentamos el valor de 'n', el recuento de tales operaciones aumentará. Ejemplos similares incluyen la búsqueda en una lista enlazada de 'n' nodos o el recorrido de un árbol de 'n' nodos.

A veces, el tamaño de entrada se define en términos del número de bits. Por ejemplo, para multiplicar dos enteros A y B mediante multiplicación bit a bit. Si el entero A tiene 'm' bits y B tiene 'n' bits, entonces el tamaño de entrada se definirá en términos de 'm' y 'n'. Si 'm' o 'n' aumentan, el número total de operaciones bit a bit aumentará. Ejemplos similares incluyen encontrar el MCD de dos números o verificar si un número es primo.

En otros casos, el tamaño de entrada se define en términos de dos o más números. Por ejemplo, para encontrar la ruta más corta en un grafo desde un origen dado, procesamos vértices y aristas en el grafo. Así, el tamaño de entrada se define como el número total de vértices (V) y aristas (E) en el grafo. Si el valor de V o E aumenta, el número total de operaciones realizadas por el algoritmo de ruta más corta aumentará. Ejemplos similares incluyen la fusión de dos arrays ordenados de tamaño 'm' y 'n', o encontrar la subsecuencia común más larga de dos cadenas de tamaño 'm' y 'n'.

¿Qué es el Tiempo de Ejecución de un Algoritmo?

El tiempo de ejecución de un algoritmo para un tamaño de entrada dado depende del número de operaciones ejecutadas. Cuanto mayor sea el número de operaciones, mayor será el tiempo de ejecución. Generalmente, queremos saber cuántas operaciones ejecutará un algoritmo en proporción al tamaño de su entrada. Medimos el tiempo de ejecución de un algoritmo como una función del tamaño de entrada.

Tipos de Operaciones en Algoritmos

Para analizar un algoritmo, es crucial entender los tipos de operaciones básicas que realiza, ya que cada una consume tiempo. Aunque asumimos que cada operación básica toma un tiempo constante, su frecuencia en el algoritmo es lo que determina el rendimiento general:

- Operaciones Aritméticas: Suma (+), resta (-), multiplicación (*), división (/), módulo (%).

- Operaciones Relacionales: Igual (==), no igual (!=), mayor que (>), menor que (<), mayor o igual que (>=), menor o igual que (<=).

- Operaciones Bit a Bit: AND bit a bit (&), OR bit a bit (|), XOR bit a bit (^), NOT bit a bit (~), desplazamiento a la izquierda (<<), desplazamiento a la derecha (>>).

- Operaciones Lógicas: AND lógico (&&), OR lógico (||), NOT lógico (!).

- Operaciones de Asignación: Asignación (=), sumar y asignar (+=), restar y asignar (-=), multiplicar y asignar (*=), dividir y asignar (/=), módulo y asignar (%=), etc.

- Operaciones de Incremento/Decremento: Post-incremento (++), post-decremento (--), pre-incremento (++), pre-decremento (--).

- Operaciones de Control: Sentencias condicionales (if/else), llamadas a funciones, sentencias de retorno, sentencias incondicionales (break).

Suposiciones Críticas para el Análisis de Algoritmos

Para simplificar el análisis y hacerlo más universal, realizamos algunas suposiciones clave:

- Cada operación básica o instrucción toma un tiempo constante para ejecutarse.

- Estudiamos el análisis del algoritmo independientemente de factores específicos del sistema, como el lenguaje de programación, el compilador o el hardware. Estos factores se consideran constantes para una especificación de sistema dada.

- La variable clave es el tamaño de entrada, que depende de la especificación del problema. Por lo tanto, calculamos el tiempo de ejecución de un algoritmo como una función del tamaño de entrada.

- El tamaño de los datos de entrada suele ser enorme en aplicaciones del mundo real (millones o miles de millones). Por lo tanto, analizamos el algoritmo principalmente para un tamaño de entrada grande.

La pregunta clave es: ¿Cómo podemos determinar el tiempo de ejecución de un algoritmo? La respuesta depende de las sentencias de código utilizadas dentro del algoritmo: bucles, llamadas recursivas, sentencias condicionales, etc. La idea básica es calcular el tiempo total sumando el tiempo que toma cada sentencia de código. Es decir, Tiempo total = Tiempo sentencia 1 + Tiempo sentencia 2 + ... + Tiempo sentencia k.

Ejemplo 1: Búsqueda Lineal

int linearSearch ( int X [ ], int n, int k ) { for ( int i = 0 ; i < n ; i = i + 1 ) { if ( X [ i ] == k ) return i } return - 1 }Idea del algoritmo: Comparamos cada valor de X[] con k usando un bucle. Si encontramos un valor X[i] igual a k, devolvemos el índice donde está presente (búsqueda exitosa). De lo contrario, pasamos al siguiente valor. Al final del bucle, si no encontramos un valor igual a k, devolvemos -1 (búsqueda no exitosa).

- Tamaño de entrada: n, porque se dan n enteros.

- Distribución de entrada: Desconocida, y k puede estar en cualquier lugar del array.

Análisis del Mejor Caso (Búsqueda Lineal): Ocurre cuando k está presente en el primer índice. El bucle se ejecutará solo una vez. El tiempo de ejecución será una constante, digamos 'a'.

Análisis del Peor Caso (Búsqueda Lineal): Cuando k no está presente en el array, o está en la última posición, el bucle se ejecutará 'n' veces. Realizamos una comparación en cada iteración. El tiempo de ejecución será una función lineal de 'n', de la forma an + b, donde 'a' y 'b' son constantes.

Análisis del Caso Promedio (Búsqueda Lineal): Asumiendo una distribución uniforme donde la probabilidad de encontrar k en cada ubicación es la misma. Habrá n+1 casos (n de búsqueda exitosa, 1 de no exitosa). El costo promedio es aproximadamente c(n/2 + 1), lo que también es una función lineal de 'n'.

Ejemplo 2: Encontrar el Valor Máximo en un Array

int findMax ( int X [ ], int n ) { int max = X [ 0 ] for ( int i = 1 ; i < n ; i = i + 1 ) { if ( X [ i ] > max ) max = X [ i ] } return max }Idea del algoritmo: Inicializamos una variable max con el primer elemento y ejecutamos un bucle para comparar los valores restantes con max. Al final, max contiene el valor máximo.

- Tamaño de entrada: n.

- Distribución de entrada: No dada.

Análisis del Mejor Caso (Encontrar Máximo): Cuando el array está ordenado en orden decreciente, el valor máximo es X[0] y la comparación X[i] > max siempre será falsa. La operación de asignación max = X[i] nunca se ejecutará dentro del bucle. El tiempo de ejecución es una función lineal de 'n', a*n + b.

Análisis del Peor Caso (Encontrar Máximo): Cuando el array está ordenado en orden creciente, la comparación X[i] > max siempre será verdadera, y la asignación max = X[i] se ejecutará en cada iteración. El tiempo de ejecución también es una función lineal de 'n', a'*n + b', pero con constantes 'a'' y 'b'' mayores.

Como se observa, el tiempo de ejecución de un algoritmo depende de la distribución de los datos de entrada. Por lo tanto, es crucial comprender los escenarios de peor y mejor caso.

Tipos de Análisis de Algoritmos

Para caracterizar el rendimiento de un algoritmo, nos centramos en diferentes escenarios:

Análisis del Peor Caso: Es el tiempo que tarda el algoritmo para la entrada que le hace ejecutar el número máximo de operaciones. Nos da un límite superior del tiempo de ejecución y garantiza que el algoritmo nunca tardará más tiempo que este. Por eso, preferimos el análisis del peor caso para la mayoría de los problemas de codificación. Este escenario ocurre con bastante frecuencia; por ejemplo, al buscar en una base de datos, el peor caso suele ocurrir cuando los datos no están presentes.

Análisis del Mejor Caso: Es el tiempo que tarda el algoritmo para la entrada que le hace ejecutar el número mínimo de operaciones. Nos da un límite inferior del tiempo de ejecución. Generalmente, no nos interesa mucho el mejor caso porque rara vez ocurre y su análisis no suele representar el comportamiento típico del algoritmo. Sin embargo, hay excepciones, como en los algoritmos Shell sort y Quicksort, que pueden aprovechar el mejor caso de Insertion Sort para ser más eficientes.

Análisis del Caso Promedio: Para algunos algoritmos, el análisis del peor caso puede no representar el comportamiento de rendimiento correcto. Para obtener una estimación más precisa, combinamos el tiempo de ejecución de todas las entradas posibles y calculamos el promedio. Es esencial conocer las distribuciones de entrada para este análisis. El tiempo de ejecución del caso promedio suele ser similar al del peor caso, aunque en algunas situaciones puede acercarse al mejor caso.

Simplemente utilice un cronómetro, inicie el programa y observe cuánto tiempo tarda hasta que el programa finalice .

La Tasa de Crecimiento y la Notación Big-O

Dado que existen varios algoritmos para un problema de codificación y que los tamaños de entrada suelen ser enormes, necesitamos un modelo simplificado para comparar la eficiencia. La clave está en la tasa de crecimiento del tiempo de ejecución.

Cuando el tamaño de entrada 'n' es muy grande, los términos de orden inferior en la función de tiempo de ejecución (por ejemplo, bn + c en an² + bn + c) se vuelven insignificantes en comparación con el término de orden superior (an²). Por ejemplo, si el tiempo de ejecución es 3n² + 2n + 1:

- Para n = 1:

3n² = 3,2n + 1 = 3. (3n² = 2n + 1) - Para n = 10:

3n² = 300,2n + 1 = 21. (3n² > 2n + 1) - Para n = 1000:

3n² = 3 * 10^6,2n + 1 = 2001. (3n² >> 2n + 1)

Para grandes valores de 'n', el término 3n² domina completamente. Por lo tanto, para simplificar el análisis, hacemos tres suposiciones:

- Consideramos solo el término de orden superior en la función de tiempo de ejecución e ignoramos los términos de orden inferior.

- Ignoramos el coeficiente del término de orden superior, ya que los factores constantes son menos significativos que la tasa de crecimiento para grandes tamaños de entrada.

- Para comparar la eficiencia de dos algoritmos, solo comparamos la tasa de crecimiento de sus términos de orden superior.

Por ejemplo:

- Tiempo de ejecución =

3n² + 4nlogn + 2, el término de orden superior es3n², la tasa de crecimiento esn². - Tiempo de ejecución =

2^n + 7n^4 + 4n + 2, el término de orden superior es2^n, la tasa de crecimiento es2^n.

Si el algoritmo A toma 3n² + 4nlogn + 2 y el algoritmo B toma 6nlogn + n + 5. La tasa de crecimiento de A es n² y la de B es nlogn. Dado que n² > nlogn para grandes 'n', el algoritmo B es más eficiente que el algoritmo A.

¿Qué es la Complejidad Temporal?

Para simplificar aún más el análisis y la comparación de algoritmos, definimos el término complejidad temporal. Es una forma abstracta de representar el tiempo de ejecución de un algoritmo en términos de la tasa de crecimiento y las notaciones Big-O. Es una estimación aproximada de cuánto tiempo tardará un algoritmo para un gran valor del tamaño de entrada. Utilizamos diferentes notaciones para representar la complejidad temporal del mejor, promedio y peor caso.

Notaciones Asintóticas

Notación Big Omega (Ω): Representa la complejidad temporal del mejor caso de un algoritmo. Proporciona un límite inferior para el tiempo de ejecución. Por ejemplo, si el mejor caso de tiempo de ejecución es

2n + 3log n + 4, la tasa de crecimiento esn, y la complejidad temporal del mejor caso esΩ(n).Notación Big Theta (Θ): Representa la complejidad temporal del caso promedio de un algoritmo. Proporciona un límite ajustado para el tiempo de ejecución. Por ejemplo, si el tiempo de ejecución promedio es

4n² + 2n + 5, la tasa de crecimiento esn², y la complejidad temporal del caso promedio esΘ(n²).Notación Big-O (O): Es la notación más utilizada y representa la complejidad temporal del peor caso de un algoritmo. Proporciona un límite superior del tiempo de ejecución. En pocas palabras, la notación Big-O y el análisis del peor caso son herramientas que simplifican enormemente nuestra capacidad para comparar la eficiencia de los algoritmos. Por ejemplo, si el peor caso de tiempo de ejecución es

4nlogn + 2n + 6, la tasa de crecimiento esnlogn, y la complejidad temporal del peor caso esO(nlogn).

Algunas propiedades básicas de la notación Big-O:

O(n) * O(m) = O(m*n)O(n) + O(m) = O(n + m)constante * O(n) = O(n)constante + O(n) = O(n)

Complejidades Temporales Populares en Algoritmos

Existen varias categorías de complejidad temporal que se encuentran comúnmente en los algoritmos:

Complejidad de Tiempo Constante: O(1)

Esta complejidad aparece cuando un algoritmo realiza un número constante de operaciones, independientemente del tamaño de la entrada. El tiempo de ejecución no depende del tamaño de entrada. Ejemplos incluyen acceder a un elemento en un array por su índice, encontrar el valor mínimo en un min-heap o intercambiar dos variables.

Complejidad de Tiempo Logarítmico: O(log n)

Esta complejidad aparece cuando el tamaño de la entrada disminuye en un factor constante (generalmente a la mitad) en cada paso. Un logaritmo es lo inverso de la exponenciación. Ejemplos clásicos son la búsqueda binaria, el algoritmo de Euclides para encontrar el MCD o la búsqueda en un árbol de búsqueda binario (BST) balanceado.

Complejidad de Tiempo Lineal: O(n)

Se presenta cuando necesitamos procesar cada elemento de entrada en tiempo constante. Es una complejidad eficiente y frecuente, ya que a menudo es necesario acceder a cada elemento de entrada al menos una vez. Generalmente, involucra un solo bucle o una serie de bucles individuales. Ejemplos incluyen encontrar el elemento máximo en un array, el algoritmo de Kadane para la suma máxima de sub-array, la fusión de dos arrays ordenados o los recorridos BFS y DFS en un árbol binario.

Complejidad de Tiempo Log-Lineal: O(n log n)

Esta complejidad surge en algoritmos de tipo 'divide y vencerás' donde el problema se divide en subproblemas independientes, y se realizan operaciones O(n) para combinar las soluciones. La altura del árbol de recursión suele ser O(log n), y en cada nivel se realizan operaciones O(n). Ejemplos son Merge Sort, Quicksort, Heapsort o la creación de un BST balanceado insertando 'n' elementos.

Complejidad de Tiempo Cuadrático: O(n²)

A menudo aparece cuando hay dos bucles anidados en el algoritmo. Estas situaciones ocurren principalmente en problemas basados en matrices y soluciones de fuerza bruta que exploran todos los pares de elementos de entrada. Ejemplos típicos son Bubble Sort, Insertion Sort o la transposición de una matriz.

Complejidad de Tiempo Exponencial: O(2^n)

Esta complejidad se da cuando un algoritmo tiene que explorar todos los escenarios posibles de salida. Esto incluye encontrar todos los posibles subconjuntos de los elementos de entrada (por ejemplo, los subconjuntos de {1,2,3} son: {1}, {2}, {3}, {1,2}, {1,3}, {2,3}, y {1,2,3}), o encontrar todas las permutaciones. Ejemplos incluyen soluciones de fuerza bruta para problemas de optimización en programación dinámica, encontrar el n-ésimo número de Fibonacci de forma recursiva sin memoización o la Torre de Hanói.

Pasos para Calcular la Complejidad Temporal y Comparar la Eficiencia

El proceso para determinar la complejidad temporal y comparar algoritmos se puede resumir en los siguientes pasos:

- Primero, cuenta el número total de operaciones críticas realizadas por el algoritmo en función del tamaño de entrada ('n'). Por ejemplo, puede ser de la forma

(an² + bn + c)o(an + b). - Luego, ignora los términos de orden inferior y los coeficientes, y represéntalo en la forma de la notación Big-O (por ejemplo,

O(n²)oO(n)). - Finalmente, compara los términos de orden superior presentes en la notación Big-O y decide cuál es el algoritmo más eficiente.

Para facilitar la comparación, aquí se presenta una tabla con las complejidades temporales más comunes, ordenadas de la más eficiente a la menos eficiente:

| Notación Big-O | Descripción | Ejemplo Típico |

|---|---|---|

| O(1) | Tiempo constante | Acceder a un elemento en un array por índice |

| O(log n) | Tiempo logarítmico | Búsqueda binaria |

| O(n) | Tiempo lineal | Recorrer una lista completa |

| O(n log n) | Tiempo log-lineal | Algoritmos de ordenamiento eficientes (Merge Sort) |

| O(n²) | Tiempo cuadrático | Algoritmos de ordenamiento simples (Bubble Sort) |

| O(2^n) | Tiempo exponencial | Cálculo de todos los subconjuntos |

Es importante recordar que, aunque O(1) < O(log n) < O(n) < O(n log n) < O(n²) < O(2^n) es el orden general de eficiencia, en algunas situaciones, debido a los grandes valores de los factores constantes o los términos de orden inferior, un algoritmo con una tasa de crecimiento de orden superior podría tomar menos tiempo para entradas pequeñas que uno con una tasa de crecimiento de orden inferior.

Preguntas Frecuentes (FAQ)

¿Por qué es importante medir el tiempo de ejecución de un programa?

Medir el tiempo de ejecución es crucial para evaluar el rendimiento de tu código, identificar cuellos de botella y asegurar que tus soluciones sean escalables. Permite optimizar el uso de recursos y garantizar una experiencia de usuario fluida, especialmente con grandes volúmenes de datos.

¿Cuál es la diferencia entre medir con un cronómetro y el análisis de complejidad temporal?

Medir con un cronómetro te da el tiempo real de ejecución en un entorno específico, afectado por hardware, sistema operativo y carga del sistema. Es una medida empírica. El análisis de complejidad temporal es un modelo matemático abstracto que predice cómo el tiempo de ejecución de un algoritmo escalará con el tamaño de entrada, independientemente del hardware. Se enfoca en la tasa de crecimiento de las operaciones.

¿Siempre debo usar la notación Big-O para analizar algoritmos?

La notación Big-O es la más utilizada en la práctica porque proporciona un límite superior del tiempo de ejecución (el peor caso), lo cual es fundamental para garantizar que un algoritmo funcionará de manera aceptable incluso en las condiciones más desfavorables. Aunque Big Omega (mejor caso) y Big Theta (caso promedio) también existen, Big-O es la referencia principal para la eficiencia y la escalabilidad.

¿Qué significa 'tamaño de entrada' en el contexto de la complejidad temporal?

El 'tamaño de entrada' se refiere a la cantidad de datos que el algoritmo debe procesar. Puede ser el número de elementos en un array, el número de bits en un número, o el número de nodos y aristas en un grafo. Es la variable 'n' en las notaciones de complejidad, y es fundamental porque el tiempo de ejecución del algoritmo se expresa como una función de 'n'.

¿Un algoritmo O(n) es siempre más rápido que un O(n²)?

Para tamaños de entrada grandes, un algoritmo O(n) siempre será más rápido que uno O(n²). Sin embargo, para tamaños de entrada muy pequeños, un algoritmo O(n²) con una constante de proporcionalidad muy baja podría ser momentáneamente más rápido que un O(n) con una constante alta. Pero a medida que 'n' crece, la tasa de crecimiento del O(n²) lo hará mucho más lento.

Comprender cómo medir y analizar el tiempo de ejecución de tus programas y algoritmos es una habilidad indispensable para cualquier desarrollador. Va más allá de una simple lectura de cronómetro; implica una comprensión profunda de cómo los algoritmos escalan y se comportan bajo diferentes cargas de trabajo. Al dominar el análisis de la complejidad temporal, especialmente con la notación Big-O, adquieres las herramientas para escribir código más robusto, eficiente y escalable, capaz de afrontar los desafíos del mundo real.

Si quieres conocer otros artículos parecidos a Tiempo de Ejecución: De Cronómetros a la Eficiencia puedes visitar la categoría Cálculos.