15/05/2022

En el vasto universo de la informática y el desarrollo de software, la eficiencia es una cualidad tan valorada como la funcionalidad. No basta con que un programa resuelva un problema; es fundamental que lo haga de la manera más óptima posible. Aquí es donde entra en juego el concepto de complejidad, una métrica esencial que nos permite evaluar y comparar diferentes soluciones para un mismo problema. Comprender cómo medir esta complejidad es clave para crear sistemas robustos, rápidos y con un consumo de recursos eficiente, evitando costosos problemas de rendimiento en el futuro.

- ¿Qué es la Complejidad Computacional?

- Notaciones Asintóticas: El Lenguaje de la Complejidad

- Órdenes de Complejidad Comunes y su Jerarquía

- Clasificación de Problemas: P, NP y NP-Completos

- Resolución de Ecuaciones de Recurrencia

- Caso Especial: Cálculo de la Complejidad de Secuencias

- Preguntas Frecuentes sobre la Complejidad

- ¿Cuál es la diferencia principal entre complejidad temporal y espacial?

- ¿Por qué los desarrolladores prefieren la notación Big-O?

- ¿Un algoritmo con O(n) es siempre mejor que uno con O(n²)?

- ¿La complejidad de un algoritmo incluye el tiempo de entrada/salida?

- ¿Qué significa que un problema sea "intratable"?

- Conclusión

¿Qué es la Complejidad Computacional?

La complejidad computacional se refiere a la cantidad de recursos que un algoritmo necesita para ejecutarse. Estos recursos suelen ser el tiempo de ejecución y el espacio de almacenamiento (memoria). Cuando hablamos de complejidad, nuestro objetivo principal es entender cómo estos recursos crecen en función del tamaño de la entrada de datos. Un algoritmo eficiente es aquel que utiliza la menor cantidad de tiempo y espacio, especialmente a medida que el volumen de datos a procesar aumenta.

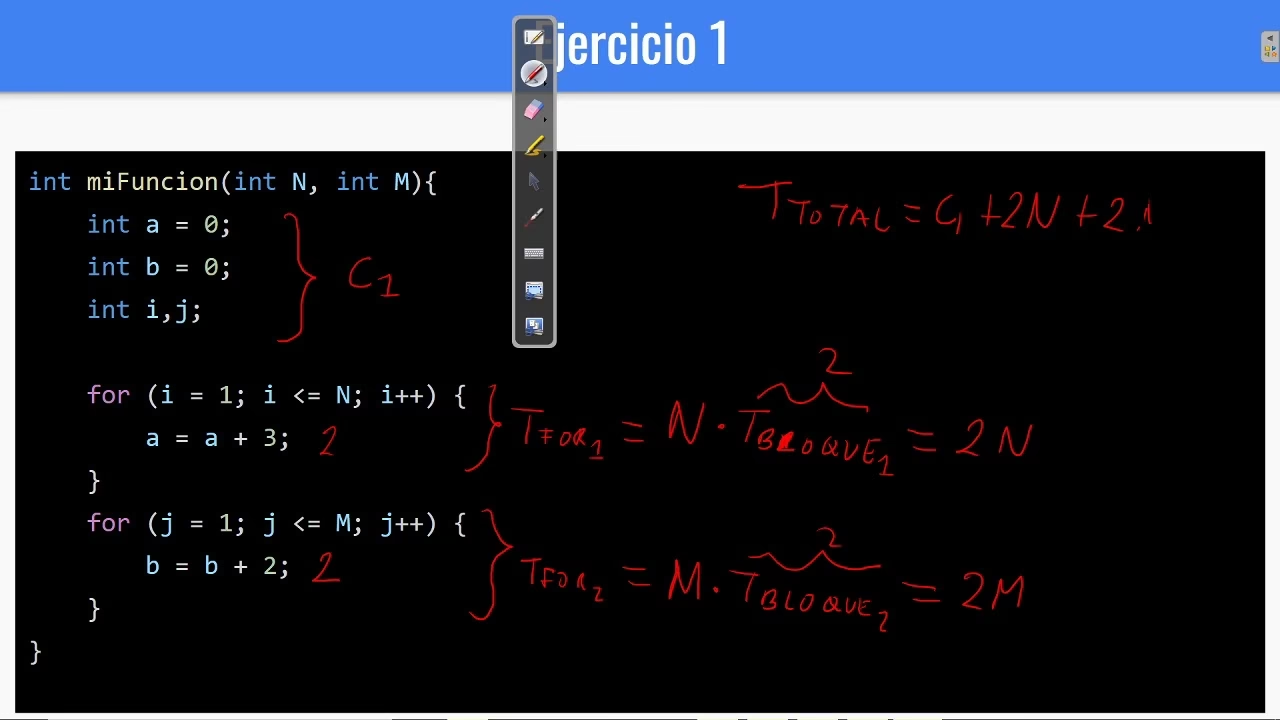

Complejidad Temporal (Tiempo de Ejecución)

La complejidad temporal mide el tiempo que tarda un algoritmo en completar su ejecución. Es crucial que este valor sea lo más bajo posible, ya que un algoritmo lento no solo frustra al usuario, sino que también puede acarrear costos operativos elevados y problemas de escalabilidad. Por ejemplo, si una instrucción se ejecuta 'n' veces y cada ejecución toma 'k' unidades de tiempo, la complejidad temporal sería 'n * k'. Sin embargo, esta medida directa puede variar según la máquina, el lenguaje de programación y otros factores. Por ello, necesitamos una forma más abstracta y universal de medirla.

Complejidad Espacial (Uso de Memoria)

La complejidad espacial se refiere a la cantidad de memoria que un algoritmo necesita para funcionar. Esto incluye el espacio para almacenar las variables de entrada, las variables intermedias y las estructuras de datos que el algoritmo utiliza. Al igual que con el tiempo, el objetivo es minimizar el uso de memoria, especialmente en entornos con recursos limitados o al trabajar con grandes volúmenes de datos.

Notaciones Asintóticas: El Lenguaje de la Complejidad

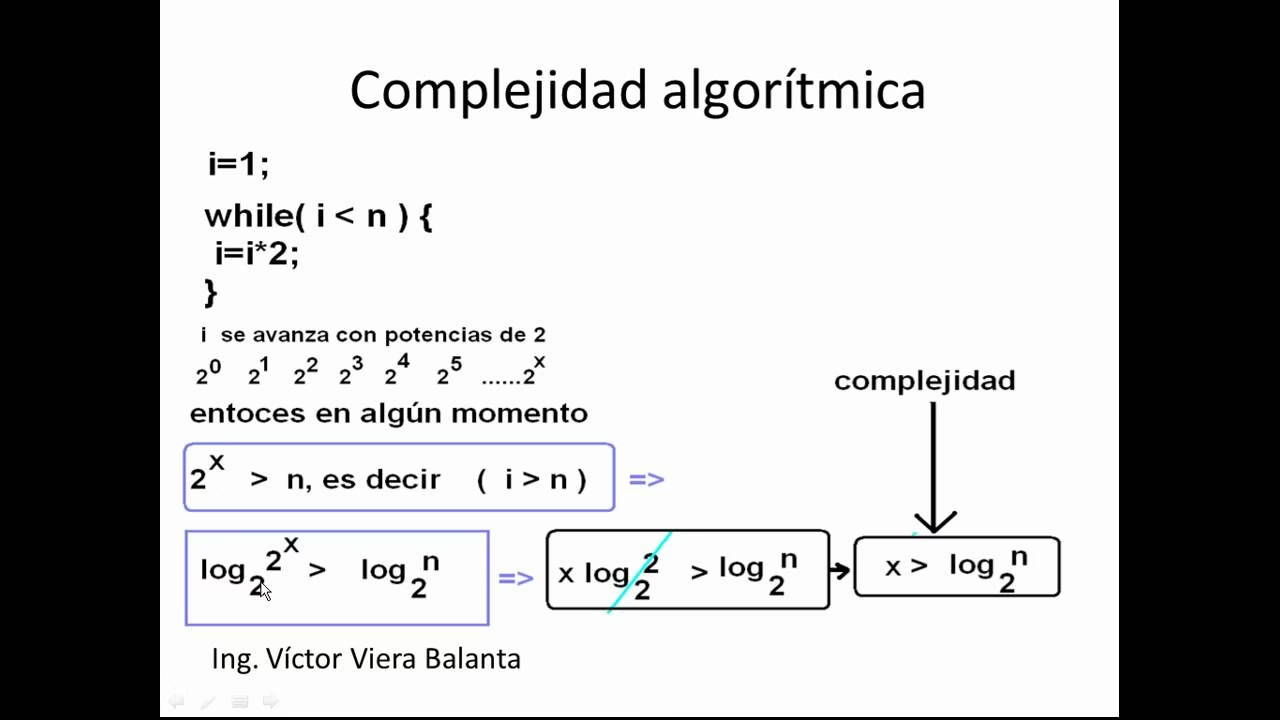

Para describir la relación entre el tamaño de la entrada de datos (comúnmente denotado como 'n') y los recursos requeridos por un algoritmo, se utilizan notaciones estandarizadas conocidas como notaciones asintóticas. Estas notaciones describen el comportamiento límite de una función a medida que el tamaño de la entrada tiende a infinito, lo que nos permite comparar algoritmos de manera independiente de factores de hardware o software específicos.

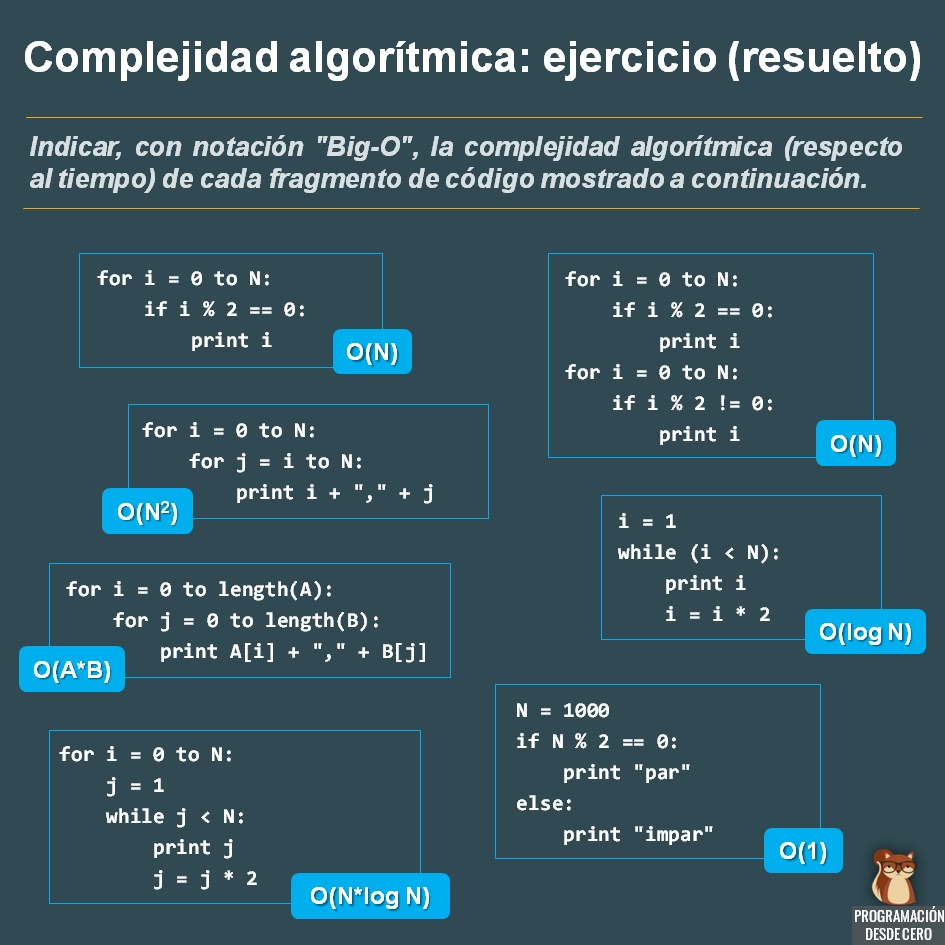

Notación Big-O (O): El Peor Caso

La notación Big-O (O) es, con diferencia, la más utilizada por los desarrolladores para describir la complejidad. Representa la cota superior asintótica, es decir, el peor escenario posible para el tiempo o espacio de un algoritmo. Nos da una garantía de que el tiempo o el espacio que tomará el algoritmo no excederá un cierto límite a medida que el tamaño de la entrada crece. Es ideal para planificación y para asegurar que un sistema no se colapse bajo carga máxima.

Cuando decimos que un algoritmo tiene una complejidad O(f(n)), significa que su tiempo de ejecución (o espacio) crece a lo sumo tan rápido como la función f(n). Por ejemplo, O(n) indica un crecimiento lineal, mientras que O(n²) indica un crecimiento cuadrático.

Notación Omega (Ω): El Mejor Caso

La notación Omega (Ω) describe la cota inferior asintótica, representando el mejor escenario posible para la complejidad temporal o espacial de un algoritmo. Indica el tiempo mínimo que un algoritmo tardará en ejecutarse, sin importar cuán favorable sea la entrada. Aunque es menos común en la práctica diaria que Big-O, es útil para entender los límites fundamentales de un problema.

Notación Theta (θ): El Caso Promedio

La notación Theta (θ) se utiliza cuando la cota superior (Big-O) y la cota inferior (Omega) son las mismas. Esto significa que el rendimiento del algoritmo está acotado tanto por arriba como por abajo por la misma función. La notación Theta representa el comportamiento exacto del algoritmo en el caso promedio, cuando el tamaño de la entrada 'n' es suficientemente grande.

Órdenes de Complejidad Comunes y su Jerarquía

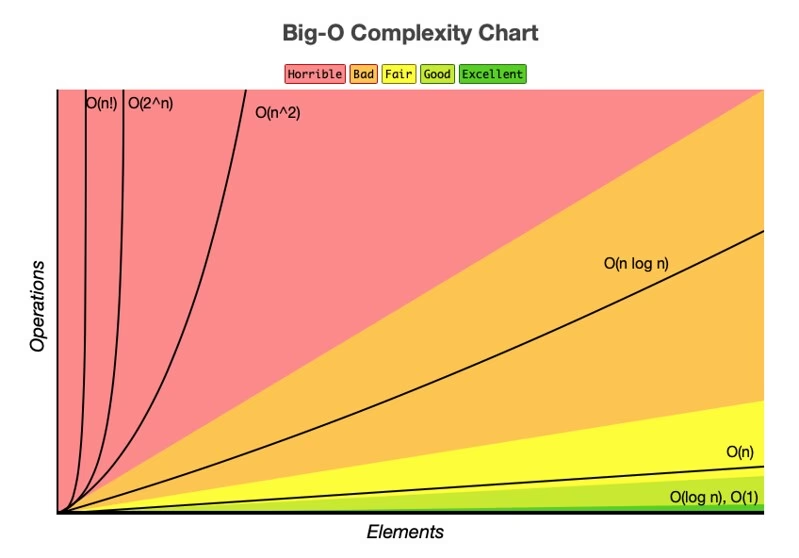

Se dice que O(f(n)) define un "orden de complejidad". Elegimos como representante de este orden la función f(n) más sencilla del mismo. Existe una jerarquía clara entre los diferentes órdenes de complejidad, donde cada orden superior es significativamente menos eficiente que los inferiores, especialmente para grandes volúmenes de datos.

Es un error común pensar que todos los algoritmos son "más o menos iguales" o que el aumento de la potencia de las máquinas compensará un mal diseño algorítmico. La realidad es que un algoritmo con un orden de complejidad superior puede volverse inviable rápidamente a medida que el tamaño de los datos crece, sin importar la velocidad del procesador.

Tabla de Órdenes de Complejidad Típicos

| Notación Big-O | Nombre | Descripción | Ejemplo (n=1,000,000) |

|---|---|---|---|

| O(1) | Constante | El tiempo de ejecución no depende del tamaño de la entrada. | 1 operación |

| O(log n) | Logarítmico | El tiempo de ejecución disminuye a la mitad con cada paso. | ~20 operaciones |

| O(n) | Lineal | El tiempo de ejecución crece proporcionalmente con el tamaño de la entrada. | 1,000,000 operaciones |

| O(n log n) | Log-lineal | Un poco más lento que lineal, común en algoritmos de ordenamiento eficientes. | ~20,000,000 operaciones |

| O(n²) | Cuadrático | El tiempo de ejecución crece con el cuadrado del tamaño de la entrada. | 1,000,000,000,000 operaciones |

| O(2^n) | Exponencial | El tiempo de ejecución se duplica con cada incremento en la entrada. Muy lento. | Inviable para n > 40 |

| O(n!) | Factorial | El tiempo de ejecución crece extremadamente rápido. Solo para entradas muy pequeñas. | Inviable para n > 10 |

Clasificación de Problemas: P, NP y NP-Completos

La complejidad no solo se aplica a los algoritmos individuales, sino también a la clasificación de los problemas computacionales en sí mismos. Esta clasificación nos ayuda a entender qué problemas son "tratables" (resolubles en un tiempo razonable) y cuáles son inherentemente difíciles.

Clase P (Polinómica)

La clase P engloba a todos los problemas para los que se conoce un algoritmo que puede resolverlos en tiempo polinómico. Esto significa que su complejidad es O(n^k) para algún entero constante 'k'. Los problemas de la clase P se consideran "tratables" o "fácilmente resolubles" en la práctica, ya que su tiempo de ejecución crece de manera manejable incluso para entradas grandes.

Clase NP (No Determinista Polinómica)

La clase NP incluye problemas para los cuales, si se nos da una posible solución, podemos verificar si esa solución es correcta en tiempo polinómico. Es importante destacar que "NP" no significa "no polinómico", sino "no determinista polinómico". Todos los problemas de la clase P son también problemas de la clase NP, ya que si podemos resolver un problema en tiempo polinómico, también podemos verificar una solución en tiempo polinómico (simplemente resolviendo el problema y comparando). La gran pregunta abierta en la informática es si P = NP, es decir, si todo problema cuya solución puede ser verificada rápidamente puede también ser resuelto rápidamente.

Clase NP-Completos

Los problemas NP-Completos son un subconjunto de los problemas NP que se consideran los "más difíciles" de la clase NP. Son problemas NP, y tienen la propiedad de que si se encontrara una solución polinómica para uno de ellos, esa solución podría ser fácilmente adaptada para resolver *todos* los problemas de la clase NP en tiempo polinómico. La búsqueda de una solución polinómica para un problema NP-Completo es uno de los mayores desafíos en la informática teórica, con un premio de prestigio asociado a su descubrimiento.

Resolución de Ecuaciones de Recurrencia

Para algoritmos recursivos, donde una función se llama a sí misma, el cálculo de la complejidad temporal presenta una dificultad adicional. El tiempo de ejecución se expresa a menudo mediante una ecuación de recurrencia, como T(n) = E(n), donde T aparece en la expresión E. Resolver estas ecuaciones implica encontrar una expresión no recursiva para T(n), lo cual puede ser un proceso complejo que a menudo requiere técnicas matemáticas específicas.

Caso Especial: Cálculo de la Complejidad de Secuencias

Más allá de la complejidad algorítmica general, existen aplicaciones específicas donde el concepto de complejidad se adapta a contextos particulares. Un ejemplo interesante es el cálculo de la complejidad de una secuencia, como las secuencias de ADN o cadenas de texto. Este tipo de complejidad no se refiere al tiempo de ejecución de un algoritmo, sino a la "riqueza" o "variedad" de los elementos dentro de la secuencia.

La complejidad de una secuencia no alineada se calcula como el producto de 'los usos de vocabulario observados' divididos por 'los usos de vocabulario máximos posibles', para tamaños de palabra desde uno hasta siete. Cuando se usan múltiples puntos de quiebre para construir una variante estructural, la complejidad se calcula como el producto de las complejidades de secuencia individuales de los puntos de quiebre que constituyen la variante estructural.

El "uso de vocabulario observado" para un tamaño de palabra 'k' en una secuencia dada es el número de "palabras" diferentes de tamaño 'k' que existen en esa secuencia. El "uso de vocabulario máximo posible" para un tamaño de palabra 'k' en una secuencia de una longitud dada es el número máximo de palabras diferentes de tamaño 'k' que se pueden observar. Para secuencias de ADN, el conjunto de letras posibles es {A, C, G, T}.

Ejemplo Práctico: Secuencia "CAGTACAG"

Consideremos la secuencia de ADN: CAGTACAG. Su longitud es 8.

1. Usos de Vocabulario Observados:

- Palabras de tamaño 1: ('A', 'C', 'G', 'T') - 4 diferentes

- Palabras de tamaño 2: ('CA', 'AG', 'GT', 'TA', 'AC') - 5 diferentes

- Palabras de tamaño 3: ('CAG', 'AGT', 'GTA', 'TAC', 'ACA') - 5 diferentes

- Palabras de tamaño 4: ('CAGT', 'AGTA', 'GTAC', 'TACA', 'ACAG') - 5 diferentes

- Palabras de tamaño 5: ('CAGTA', 'AGTAC', 'GTACA', 'TACAG') - 4 diferentes

- Palabras de tamaño 6: ('CAGTAC', 'AGTACA', 'GTACAG') - 3 diferentes

- Palabras de tamaño 7: ('CAGTACA', 'AGTACAG') - 2 diferentes

2. Usos de Vocabulario Máximos Posibles (para una secuencia de longitud 8 en ADN):

- Tamaño 1: 4 (A, C, G, T son las únicas 4 letras posibles)

- Tamaño 2: 7 (Una secuencia de 8 nucleótidos tiene 7 dinucleótidos posibles: pos 1-2, 2-3, ..., 7-8. Cada uno puede ser único)

- Tamaño 3: 6 (Una secuencia de 8 nucleótidos tiene 6 trinucleótidos posibles)

- Tamaño 4: 5 (Una secuencia de 8 nucleótidos tiene 5 cuatrinucleótidos posibles)

- Tamaño 5: 4 (Una secuencia de 8 nucleótidos tiene 4 pentanucleótidos posibles)

- Tamaño 6: 3 (Una secuencia de 8 nucleótidos tiene 3 hexanucleótidos posibles)

- Tamaño 7: 2 (Una secuencia de 8 nucleótidos tiene 2 heptanucleótidos posibles)

3. Cálculo de la Complejidad:

Multiplicamos las proporciones de usos observados sobre usos máximos para cada tamaño de palabra (de 1 a 7):

(4/4) * (5/7) * (5/6) * (5/5) * (4/4) * (3/3) * (2/2) = 1 * 0.714 * 0.833 * 1 * 1 * 1 * 1 = 0.595

Por lo tanto, la complejidad de la secuencia "CAGTACAG" es aproximadamente 0.595.

Ejemplo de Baja Complejidad: "AAAAAAA"

Consideremos la secuencia "AAAAAAA" (longitud 7). Es un ejemplo de muy baja complejidad:

- Usos observados: 1 para todos los tamaños de palabra (solo 'A', 'AA', 'AAA', etc.)

- Usos máximos posibles (para longitud 7):

- Tamaño 1: 4

- Tamaño 2: 6

- Tamaño 3: 5

- Tamaño 4: 4

- Tamaño 5: 3

- Tamaño 6: 2

- Tamaño 7: 1

Cálculo:

(1/4) * (1/6) * (1/5) * (1/4) * (1/3) * (1/2) * (1/1) = 0.000347

Este valor extremadamente bajo refleja la naturaleza repetitiva y poco diversa de la secuencia "AAAAAAA".

Preguntas Frecuentes sobre la Complejidad

¿Cuál es la diferencia principal entre complejidad temporal y espacial?

La complejidad temporal mide el tiempo de ejecución de un algoritmo en función del tamaño de la entrada, mientras que la complejidad espacial mide la cantidad de memoria que el algoritmo utiliza. Ambos son cruciales para evaluar la eficiencia, pero a menudo la complejidad temporal es el foco principal.

¿Por qué los desarrolladores prefieren la notación Big-O?

La notación Big-O describe el peor escenario posible. Esto es valioso porque proporciona una garantía del rendimiento máximo que un algoritmo podría requerir, lo que es esencial para diseñar sistemas que funcionen de manera confiable incluso bajo condiciones de carga pesada.

¿Un algoritmo con O(n) es siempre mejor que uno con O(n²)?

Generalmente, sí. A medida que el tamaño de la entrada 'n' crece, O(n) siempre superará a O(n²). Sin embargo, para valores de 'n' muy pequeños, las constantes ocultas en la notación Big-O podrían hacer que un algoritmo O(n²) sea marginalmente más rápido. Pero en la práctica, para cualquier tamaño de entrada significativo, O(n) es drásticamente superior.

¿La complejidad de un algoritmo incluye el tiempo de entrada/salida?

Las notaciones de complejidad asintótica (Big-O, Omega, Theta) se centran principalmente en las operaciones computacionales internas del algoritmo. El tiempo de entrada/salida (I/O) a menudo se considera por separado o como un factor externo, ya que depende en gran medida del hardware y del sistema operativo, no intrínsecamente del algoritmo.

¿Qué significa que un problema sea "intratable"?

Un problema se considera "intratable" si la mejor solución conocida para él tiene una complejidad superior a la polinómica (por ejemplo, exponencial o factorial). Esto significa que, para tamaños de entrada moderados o grandes, el tiempo o los recursos necesarios para resolverlo crecen tan rápidamente que se vuelven inviables en la práctica.

Conclusión

La evaluación de la complejidad computacional es una habilidad fundamental para cualquier profesional de la informática. No se trata solo de escribir código que funcione, sino de escribir código que funcione de manera óptima. Al comprender y aplicar conceptos como las notaciones asintóticas, los órdenes de complejidad y las clases de problemas, podemos diseñar algoritmos y sistemas que no solo cumplan con sus funciones, sino que también sean eficientes, escalables y sostenibles a largo plazo. La búsqueda de la eficiencia es un pilar central en la evolución de la tecnología, y el cálculo de la complejidad es nuestra brújula en ese viaje.

Si quieres conocer otros artículos parecidos a Comprendiendo la Complejidad en Cálculos y Algoritmos puedes visitar la categoría Cálculos.