14/05/2024

En el multifacético mundo de la inteligencia artificial generativa, la ciencia de datos, el aprendizaje automático y el análisis, comprender la distancia y la relación entre los puntos de datos es crucial. Esta comprensión fundamental es la que permite a los Grandes Modelos de Lenguaje (LLM) interpretar el contexto y recuperar la información pertinente. Grandes volúmenes de datos no estructurados pueden almacenarse eficientemente en bases de datos vectoriales, donde los puntos de datos se representan como vectores y las distancias se calculan utilizando coordenadas cartesianas y el teorema de Pitágoras. Cada vez que un usuario realiza una consulta, la respuesta más aproximada se recupera de la base de datos basándose en estas mediciones de distancia. Es fascinante observar cómo se almacena la información y cómo estos cálculos tan precisos permiten la recuperación de datos específicos. Existen diversas maneras avanzadas de calcular la distancia entre vectores. En este artículo, exploraremos algunas de las métricas de distancia más importantes, como la distancia de Manhattan, la distancia Euclídea, la distancia del Coseno y el producto escalar.

- ¿Qué son los Vectores en el Contexto del Aprendizaje Automático?

- La Búsqueda de Similitud Vectorial: El Corazón de la Recuperación de Datos

- Métodos Esenciales para Calcular la Distancia entre Vectores

- Manejo de Vectores con Diferentes Longitudes

- Mejores Prácticas para el Cálculo de Distancias

- Tabla Comparativa de Métricas de Distancia

- Preguntas Frecuentes (FAQ)

- ¿Cuál es la distancia más comúnmente utilizada en el aprendizaje automático?

- ¿Cuándo debería usar la distancia del Coseno en lugar de la Euclídea?

- ¿Cómo se manejan los vectores que tienen diferentes longitudes?

- ¿El producto escalar es una métrica de distancia?

- ¿Por qué son tan importantes estas métricas de distancia en la inteligencia artificial?

¿Qué son los Vectores en el Contexto del Aprendizaje Automático?

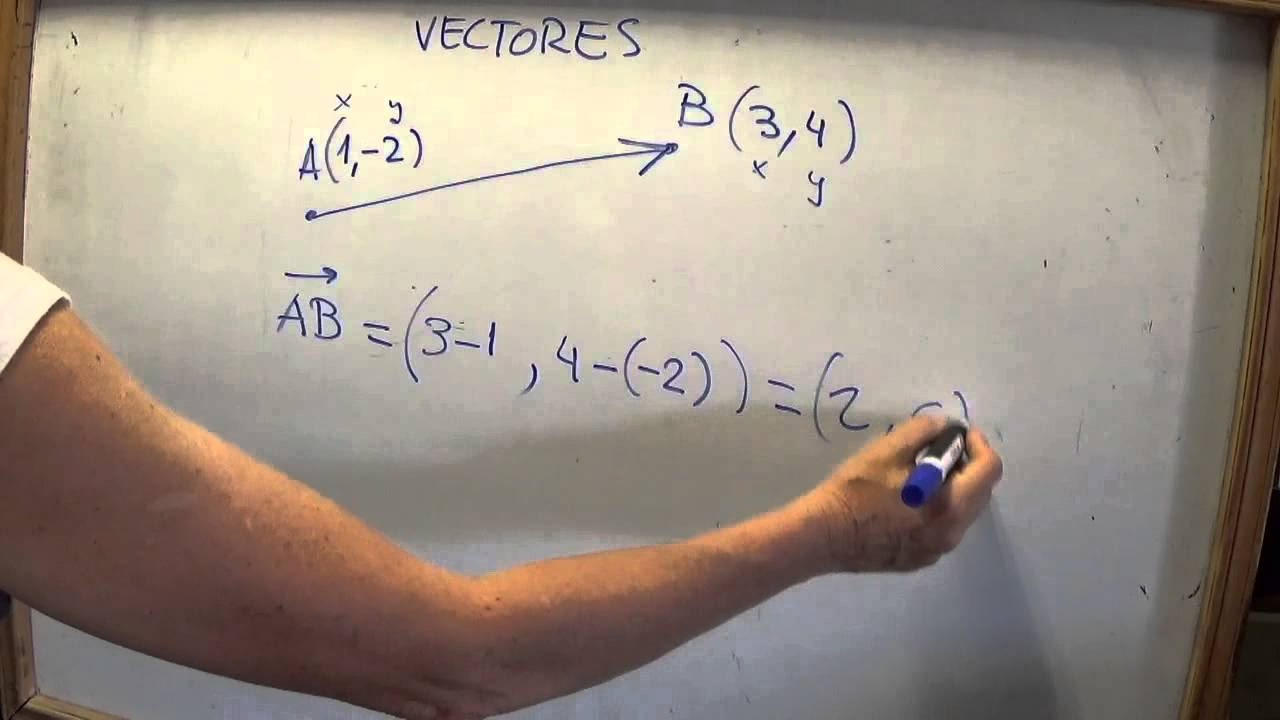

En el ámbito de la inteligencia artificial generativa, los vectores desempeñan un papel fundamental como medio para representar y manipular datos complejos. Dentro de este contexto, los vectores son a menudo matrices de números de alta dimensión que codifican cantidades significativas de información. Por ejemplo, en el caso de la generación de imágenes, cada imagen puede convertirse en un vector que representa sus valores de píxeles o características más abstractas extraídas a través de modelos de aprendizaje profundo. Estos vectores se convierten en el lenguaje a través del cual los algoritmos de IA comprenden y generan nuevo contenido. Al navegar y modificar estos vectores en un espacio multidimensional, la IA generativa produce nuevas instancias sintéticas de datos, ya sean imágenes, sonidos o texto, que imitan las características del conjunto de datos original. Esta manipulación vectorial a menudo implica el cálculo de la distancia entre dos vectores, donde un vector se define en relación con otro, destacando las operaciones matemáticas involucradas en la determinación de la distancia. Este proceso está en el corazón de la capacidad de la IA para aprender de los datos y generar resultados realistas basados en ese aprendizaje.

Para ilustrarlo mejor, consideremos cómo se manejan los datos no estructurados. Estos datos, provenientes de diversas fuentes, pasan por un modelo de embedding (incrustación) —como los de OpenAI, Cohere o HuggingFace— para convertir el contenido en pequeños fragmentos de palabras, conocidos como incrustaciones vectoriales. A cada fragmento de palabra se le asigna un valor numérico, un proceso que se denomina tokenización. Una vez creadas las incrustaciones vectoriales, se representan en un espacio tridimensional (o de mayor dimensión) dentro de una base de datos vectorial donde se almacena toda esta información. Por ejemplo, si los datos no estructurados 'gato' y 'perro' se convierten en datos vectoriales, se representarán más cerca el uno del otro en el espacio vectorial porque ambos pertenecen a la misma categoría de mascotas. Si consideramos un ejemplo adicional como 'coche', este obtendrá una representación espacial mucho más alejada de 'gato' y 'perro', ya que no entra en la categoría de mascotas. De esta manera, los objetos similares se agrupan, y cuando el usuario realiza una consulta, se considera el contexto y se recupera un objeto más similar para el usuario.

La Búsqueda de Similitud Vectorial: El Corazón de la Recuperación de Datos

Las consultas en sistemas basados en vectores implican encontrar los vecinos más cercanos a un vector dado en el espacio de alta dimensión. Este proceso, conocido como búsqueda de similitud vectorial o búsqueda de vecinos más cercanos aproximados (ANN por sus siglas en inglés), busca vectores que estén más próximos en términos de distancia (por ejemplo, distancia Euclídea o similitud del Coseno) al vector de consulta. Este método captura la similitud en el contexto o las características entre diferentes puntos de datos, lo cual es crucial para tareas como los sistemas de recomendación, las búsquedas de similitud y la agrupación (clustering).

La eficiencia en la búsqueda de similitud es lo que permite que las aplicaciones de IA respondan rápidamente. Imagina un sistema de recomendación de películas: cuando un usuario ve una película, el sistema convierte esa película en un vector y luego busca otras películas cuyos vectores estén 'cerca' en el espacio vectorial. La cercanía en este contexto significa similitud en características, como género, actores, o incluso la trama. Este proceso se repite millones de veces, lo que subraya la necesidad de métodos de cálculo de distancia robustos y eficientes.

Métodos Esenciales para Calcular la Distancia entre Vectores

Existen diferentes técnicas para calcular la distancia entre vectores. El producto escalar, la distancia Euclídea, la distancia de Manhattan y la distancia del Coseno son todos conceptos fundamentales utilizados en la búsqueda de similitud vectorial. Cada uno mide la similitud o disimilitud entre dos vectores en un espacio multi-dimensional, ofreciendo perspectivas únicas sobre su relación.

Distancia de Manhattan (Norma L1)

La distancia de Manhattan, también conocida como la norma L1 o distancia del taxista, es una forma de calcular la distancia entre dos puntos (vectores) sumando las diferencias absolutas de sus coordenadas. Imagina que navegas por una ciudad diseñada en una cuadrícula perfecta: la distancia de Manhattan entre dos puntos sería el número total de bloques que tendrías que recorrer vertical y horizontalmente para llegar de un punto a otro, sin la posibilidad de tomar un atajo diagonal. En el contexto de los vectores, es similar: se calcula la distancia sumando las diferencias absolutas para cada componente correspondiente de los vectores. Si tenemos dos vectores, A = (a1, a2, ..., an) y B = (b1, b2, ..., bn), la distancia de Manhattan se calcula como: d(A, B) = |a1 - b1| + |a2 - b2| + ... + |an - bn|.

Esta métrica es particularmente útil en situaciones donde el movimiento está restringido a ejes ortogonales, como en el diseño de circuitos integrados o en ciertos algoritmos de optimización. Es menos sensible a los valores atípicos (outliers) que la distancia Euclídea, lo que la hace robusta en ciertos tipos de datos ruidosos.

Distancia Euclídea (Norma L2)

La distancia Euclídea, a menudo conocida como la norma L2, es la forma más directa de medir la distancia entre dos puntos o vectores, asemejándose a la manera en que normalmente pensamos en la distancia en el mundo físico. Imagina que dibujas una línea recta entre dos puntos en un mapa; la distancia Euclídea es la longitud de esa línea. Esta métrica se utiliza ampliamente en muchos campos, incluyendo la física para medir distancias reales, algoritmos de aprendizaje automático para tareas como la agrupación (clustering) y la clasificación, y en escenarios cotidianos cada vez que se necesita determinar una distancia directa o 'en línea recta'. Su alineación natural con nuestra comprensión intuitiva de la distancia la convierte en una herramienta fundamental en el análisis de datos y la geometría. Si tenemos dos vectores, A = (a1, a2, ..., an) y B = (b1, b2, ..., bn), la distancia Euclídea se calcula como: d(A, B) = √((a1 - b1)² + (a2 - b2)² + ... + (an - bn)²). Esta fórmula es una aplicación directa del teorema de Pitágoras generalizado a múltiples dimensiones.

Aunque es intuitiva y ampliamente utilizada, la distancia Euclídea puede ser sensible a la escala de las características y a la presencia de valores atípicos, ya que las diferencias al cuadrado magnifican los valores grandes.

Distancia del Coseno

La distancia del Coseno es una medida de similitud entre dos vectores no nulos que evalúa el coseno del ángulo entre ellos. No es una 'distancia' en el sentido tradicional de una métrica que cumple la desigualdad triangular, sino más bien una métrica que determina cómo los vectores están orientados entre sí, independientemente de su magnitud. Imagina dos flechas partiendo del mismo punto; cuanto menor sea el ángulo entre ellas, más similares serán en dirección. El valor de la similitud del Coseno varía de -1 a 1, donde 1 indica que los vectores apuntan exactamente en la misma dirección, -1 indica que apuntan en direcciones opuestas, y 0 indica ortogonalidad (sin relación direccional). La distancia del Coseno se calcula a menudo como 1 - similitud del Coseno, de modo que un valor de 0 indica máxima similitud y 2 máxima disimilitud.

Esta medida es particularmente útil en campos como el análisis de texto y la recuperación de información, donde la orientación de los vectores (que representan, por ejemplo, documentos o consultas en un espacio de alta dimensión) importa más que sus posiciones o magnitudes absolutas. Por ejemplo, dos documentos pueden contener las mismas palabras clave, pero uno puede ser mucho más largo que el otro. La distancia Euclídea podría considerarlos muy diferentes debido a la magnitud, mientras que la similitud del Coseno los consideraría muy similares si el 'tema' o la 'dirección' del contenido es la misma.

Producto Escalar (Dot Product)

El producto escalar (o producto punto) captura la relación entre dos vectores. Imagina dos flechas que se extienden desde el mismo punto de partida; el producto escalar cuantifica cuánto se alinea una flecha con la dirección de la otra. Matemáticamente, se calcula multiplicando los componentes correspondientes de los vectores y luego sumando estos productos. Para los vectores A = (a1, a2, ..., an) y B = (b1, b2, ..., bn), el producto escalar es: A · B = a1b1 + a2b2 + ... + an*bn.

Una característica clave del producto escalar es que es grande (positivo o negativo) cuando los vectores apuntan en direcciones similares u opuestas, y pequeño (o cero) cuando los vectores son perpendiculares (ortogonales). Esto hace que el producto escalar sea extremadamente útil en diversas aplicaciones, como determinar si dos vectores son ortogonales, calcular el ángulo entre vectores en el espacio (está directamente relacionado con la similitud del Coseno), o en operaciones más complejas de física e ingeniería como el cálculo de trabajo o torque. En el aprendizaje automático y la ciencia de datos, el producto escalar es fundamental en algoritmos como las redes neuronales, donde ayuda a calcular la suma ponderada de las entradas.

Manejo de Vectores con Diferentes Longitudes

Al tratar con vectores de diferentes longitudes, es esencial comprender cómo manejarlos correctamente. En muchos casos, los vectores de diferentes longitudes pueden tratarse como si tuvieran la misma longitud rellenando el vector más corto con ceros. Este enfoque es particularmente útil cuando se trabaja con vectores en espacios de alta dimensión.

Por ejemplo, consideremos dos vectores, un 'vector A' con una longitud de 3 y un 'vector B' con una longitud de 4. Para calcular la distancia Euclídea entre ellos, podemos rellenar el vector más corto, el 'vector A', con un cero para que tenga la misma longitud que el 'vector B'. Los vectores resultantes serían conceptualmente:

- A = (a1, a2, a3, 0)

- B = (b1, b2, b3, b4)

Entonces, podemos calcular la distancia Euclídea entre los dos vectores utilizando la fórmula estándar: d = √((a1 - b1)² + (a2 - b2)² + (a3 - b3)² + (0 - b4)²).

Este enfoque nos permite calcular la distancia entre vectores de diferentes longitudes, lo cual es esencial en muchas aplicaciones, como la recuperación de información y el aprendizaje automático. Al asegurar que los vectores tengan la misma longitud, podemos aplicar varias métricas de distancia de manera consistente y precisa.

Mejores Prácticas para el Cálculo de Distancias

Al calcular distancias entre vectores, hay varias mejores prácticas a tener en cuenta:

- Elegir la métrica de distancia correcta: Dependiendo de la aplicación, diferentes métricas de distancia pueden ser más adecuadas. Por ejemplo, la distancia Euclídea se usa comúnmente en muchas aplicaciones, mientras que la distancia de Manhattan puede ser más adecuada para ciertos tipos de datos o problemas donde el movimiento es restrictivo. Comprender la naturaleza de sus datos y los requisitos de su aplicación le ayudará a seleccionar la métrica más apropiada.

- Utilizar la fórmula correcta: Asegúrese de usar la fórmula correcta para la métrica de distancia elegida. El uso de la fórmula correcta garantiza cálculos de distancia precisos entre dos vectores. Un error en la fórmula puede llevar a resultados completamente erróneos y, por ende, a decisiones incorrectas en los modelos de IA.

- Manejar correctamente los vectores de diferentes longitudes: Como se discutió anteriormente, cuando se trabaja con vectores de diferentes longitudes, es esencial rellenar el vector más corto con ceros para que tenga la misma longitud que el vector más largo. Esto asegura que todos los componentes se tengan en cuenta en el cálculo de la distancia, proporcionando una medida más precisa de similitud o disimilitud.

- Usar algoritmos eficientes: Dependiendo del tamaño de los vectores y el número de cálculos, el uso de algoritmos eficientes puede mejorar significativamente el rendimiento. Por ejemplo, en programación, usar operaciones vectorizadas ofrecidas por librerías especializadas (como NumPy en Python) es exponencialmente más rápido que usar bucles para calcular las distancias entre vectores, especialmente cuando se trabaja con grandes conjuntos de datos o vectores de alta dimensión.

Siguiendo estas mejores prácticas, puede asegurarse de que sus cálculos de distancia sean precisos, eficientes y adecuados para su aplicación específica. Ya sea que esté trabajando en aprendizaje automático, análisis de datos o recuperación de información, estas pautas le ayudarán a aprovechar al máximo sus datos vectoriales.

Tabla Comparativa de Métricas de Distancia

| Métrica | Concepto Principal | Cuándo Usarla | Ventajas | Desventajas |

|---|---|---|---|---|

| Manhattan (L1) | Suma de diferencias absolutas de coordenadas; movimiento en cuadrícula. | Datos con valores atípicos; cuando las diferencias individuales son importantes. | Robusta a valores atípicos; fácil de interpretar. | No representa la distancia más corta 'en línea recta'. |

| Euclídea (L2) | Distancia en línea recta; teorema de Pitágoras. | La más común y general; cuando la distancia geométrica es relevante. | Intuitiva; ampliamente comprendida y aplicada. | Sensible a valores atípicos y a la escala de las características. |

| Coseno | Ángulo entre vectores; mide la orientación, no la magnitud. | Análisis de texto, recuperación de información, similitud semántica. | Efectiva con datos dispersos; insensible a la magnitud. | No es una métrica de distancia en sentido estricto (no cumple la desigualdad triangular). |

| Producto Escalar | Medida de la alineación de vectores; suma de productos de componentes. | Determinar ortogonalidad; componentes de similitud del Coseno; redes neuronales. | Directamente relacionado con la similitud del Coseno; computacionalmente eficiente. | No es una métrica de distancia; su valor depende de las magnitudes de los vectores. |

Preguntas Frecuentes (FAQ)

¿Cuál es la distancia más comúnmente utilizada en el aprendizaje automático?

La distancia Euclídea es la más comúnmente utilizada debido a su naturaleza intuitiva y su correspondencia con nuestra percepción de la distancia en el espacio físico. Sin embargo, su idoneidad depende del tipo de datos y del problema a resolver. Para datos de texto o cuando la dirección es más importante que la magnitud, la distancia del Coseno es preferida.

¿Cuándo debería usar la distancia del Coseno en lugar de la Euclídea?

Deberías usar la distancia del Coseno cuando la orientación o la dirección de los vectores es más relevante que su magnitud. Esto es especialmente cierto en tareas de procesamiento de lenguaje natural (NLP) y recuperación de información, donde los vectores representan documentos o palabras y la similitud semántica se mide por la dirección de los vectores, no por su 'longitud' o 'tamaño'. Por ejemplo, dos documentos que hablan del mismo tema pero con diferente extensión se considerarían muy similares con la distancia del Coseno.

¿Cómo se manejan los vectores que tienen diferentes longitudes?

Para calcular la distancia entre vectores de diferentes longitudes, la práctica común es rellenar el vector más corto con ceros hasta que ambos vectores tengan la misma dimensión. Este proceso asegura que todas las operaciones matemáticas, como la resta o la multiplicación de componentes, se realicen sobre dimensiones correspondientes, manteniendo la coherencia en el cálculo de la distancia.

¿El producto escalar es una métrica de distancia?

No, el producto escalar no es una métrica de distancia en sí mismo. Es una medida de la alineación de dos vectores y de la proyección de uno sobre el otro. Sin embargo, es un componente fundamental en el cálculo de la similitud del Coseno, que a su vez se puede transformar en una distancia del Coseno (1 - similitud del Coseno).

¿Por qué son tan importantes estas métricas de distancia en la inteligencia artificial?

Estas métricas de distancia son cruciales en la IA porque permiten a los sistemas comprender la similitud y la relación entre diferentes puntos de datos. Esta capacidad es la base para muchas aplicaciones de IA, como la búsqueda de información relevante en bases de datos vectoriales, la agrupación de datos similares, la clasificación de nuevos datos, la recomendación de productos o contenido, y la generación de contenido contextualizado por parte de los LLM. Sin una forma precisa de medir la distancia, la IA no podría organizar ni interpretar eficazmente el vasto universo de datos.

Si quieres conocer otros artículos parecidos a Calculando la Distancia entre Vectores: Clave en la IA puedes visitar la categoría Cálculos.