05/02/2024

En el vasto universo de la programación y la ciencia de la computación, comprender cómo se comportan los algoritmos es tan crucial como su diseño. Más allá del tiempo que tardan en ejecutarse, existe otro factor determinante para su eficiencia: la cantidad de memoria que consumen. Este concepto es lo que conocemos como complejidad espacial, y su análisis es fundamental para desarrollar software robusto, escalable y que aproveche de forma óptima los recursos disponibles. Si bien a menudo se discute la complejidad temporal, la complejidad espacial es su contraparte esencial, dictando la huella de memoria que un programa deja en el sistema.

- ¿Qué es la Complejidad Espacial?

- ¿Por qué es Crucial la Complejidad Espacial?

- Notaciones para Expresar la Complejidad Espacial

- ¿Cómo se Calcula la Complejidad Espacial?

- Ejemplos Avanzados: Complejidad Espacial en Sistemas de Reconocimiento Facial (PCA)

- Preguntas Frecuentes sobre la Complejidad Espacial

- Conclusión

¿Qué es la Complejidad Espacial?

La complejidad espacial de un algoritmo se refiere a la cantidad total de memoria que dicho algoritmo necesita para ejecutarse, en función del tamaño de su entrada. Es, en esencia, la medida del espacio de almacenamiento que el algoritmo requiere para resolver un problema computacional, expresado como una función de las características de la entrada. Esta medida incluye toda la memoria que el algoritmo utiliza desde su inicio hasta su completa ejecución.

Es importante distinguir la complejidad espacial del concepto de espacio auxiliar. Mientras que el espacio auxiliar se refiere únicamente a la memoria extra o temporal que un algoritmo utiliza para sus operaciones internas (variables adicionales, estructuras de datos temporales), la complejidad espacial abarca el espacio auxiliar más el espacio ocupado por la entrada misma del algoritmo. Es decir, la fórmula es simple:

Complejidad Espacial = Espacio Auxiliar + Espacio de Entrada

La complejidad espacial es un concepto paralelo a la complejidad temporal. Así como una operación puede tardar O(n) tiempo, crear un arreglo de tamaño 'n' requerirá O(n) espacio. De manera similar, una matriz bidimensional de tamaño 'n*n' necesitará O(n²) espacio. La complejidad espacial puede depender de varios factores, incluyendo el lenguaje de programación, el compilador utilizado y la máquina en la que se ejecuta el algoritmo, aunque en el análisis asintótico estos factores constantes suelen ignorarse.

¿Para qué utiliza un algoritmo el espacio de memoria?

Un algoritmo utiliza el espacio de memoria para tres propósitos principales durante su ejecución:

- Espacio de Instrucciones: Es la cantidad de espacio utilizada para almacenar la versión compilada de instrucciones. Es el código binario del programa.

- Pila Ambiental (Environmental Stack): Cuando una función llama a otra función, las variables y el estado actual de la función que llama se guardan temporalmente en la pila del sistema. Por ejemplo, si la función A() llama a la función B(), todas las variables de A() se almacenan en la pila mientras B() se ejecuta.

- Espacio de Datos: Esta es la cantidad de espacio utilizada por las variables y constantes que el algoritmo manipula directamente. Incluye variables locales, globales y parámetros pasados a funciones.

Al calcular la complejidad espacial, generalmente solo se considera el espacio de datos. El espacio de instrucciones y la pila ambiental (excepto en el caso de recursión profunda, como veremos más adelante) a menudo se ignoran en el análisis asintótico porque su contribución suele ser constante o predecible y no directamente proporcional al tamaño de la entrada en la mayoría de los casos.

¿Por qué es Crucial la Complejidad Espacial?

Los desarrolladores de aplicaciones están limitados por la memoria física de los sistemas en los que pretenden ejecutar sus programas. Es por eso que la complejidad espacial es de suma importancia. Nunca querrás ejecutar una función o un proceso que exceda la cantidad de espacio que el sistema tiene en un momento dado. Un uso ineficiente de la memoria puede llevar a:

- Colapsos del Programa: Si un algoritmo intenta asignar más memoria de la que el sistema puede proporcionar, resultará en un error de "memoria insuficiente".

- Rendimiento Degradado: Incluso si el sistema no colapsa, el uso excesivo de memoria puede llevar a un "swapping" constante (el sistema operativo mueve datos entre la RAM y el disco duro), lo que ralentiza drásticamente la ejecución del programa.

- Restricciones en el Tamaño de la Entrada: Un algoritmo con alta complejidad espacial puede no ser capaz de procesar entradas grandes, limitando su aplicabilidad en escenarios de "big data".

- Costos Operacionales: En entornos de nube, el consumo de memoria se traduce directamente en costos. Optimizar la complejidad espacial puede generar ahorros significativos.

En resumen, una buena comprensión de la complejidad espacial permite a los desarrolladores crear algoritmos que no solo sean rápidos, sino también eficientes en el uso de los recursos, lo cual es fundamental para la estabilidad y el rendimiento de cualquier aplicación.

Notaciones para Expresar la Complejidad Espacial

Para describir el comportamiento asintótico de la complejidad espacial (es decir, cómo crece el consumo de memoria a medida que el tamaño de la entrada tiende al infinito), se utilizan las mismas notaciones que para la complejidad temporal:

Notación Big-O (O)

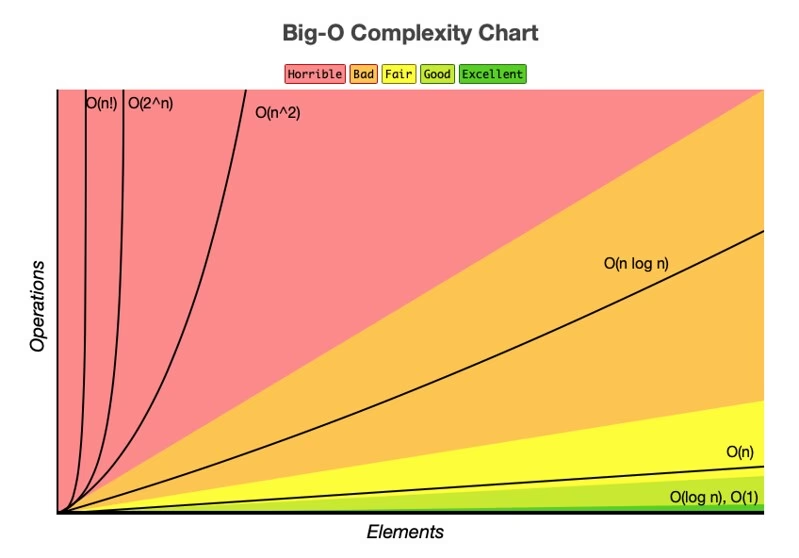

La notación Big-O describe un límite superior asintótico. Representa el escenario del "peor caso" del crecimiento del consumo de memoria de un algoritmo. Nos dice que la cantidad de espacio que un algoritmo particular toma no crecerá más rápido que una función dada f(n), pero podría crecer a un ritmo más lento. Es la más utilizada para expresar la complejidad.

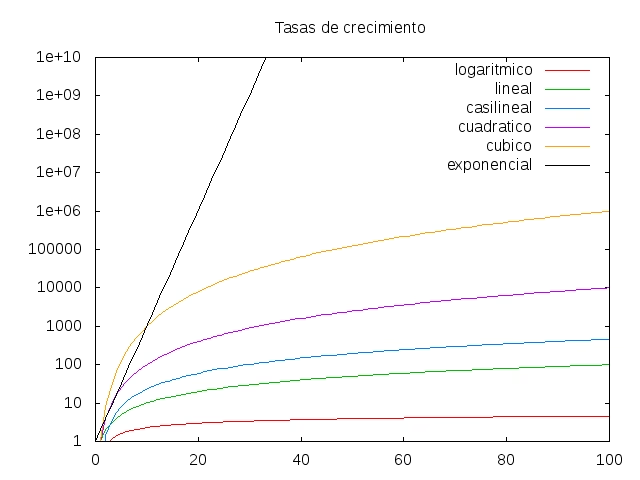

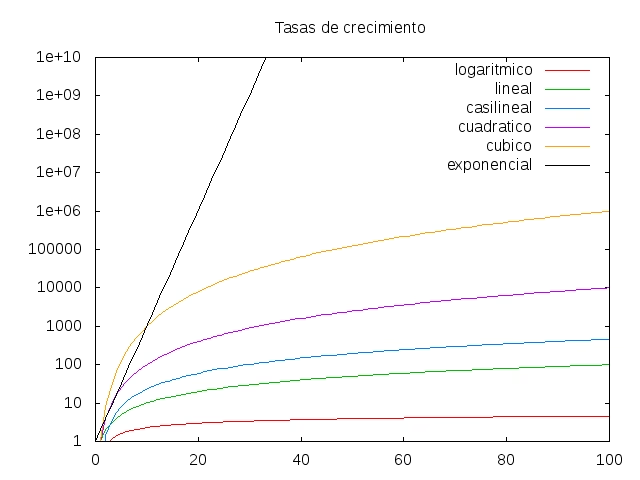

- O(1) - Complejidad Constante: El algoritmo utiliza la misma cantidad de espacio, independientemente del tamaño de la entrada. Ejemplos incluyen el almacenamiento de un número fijo de variables simples.

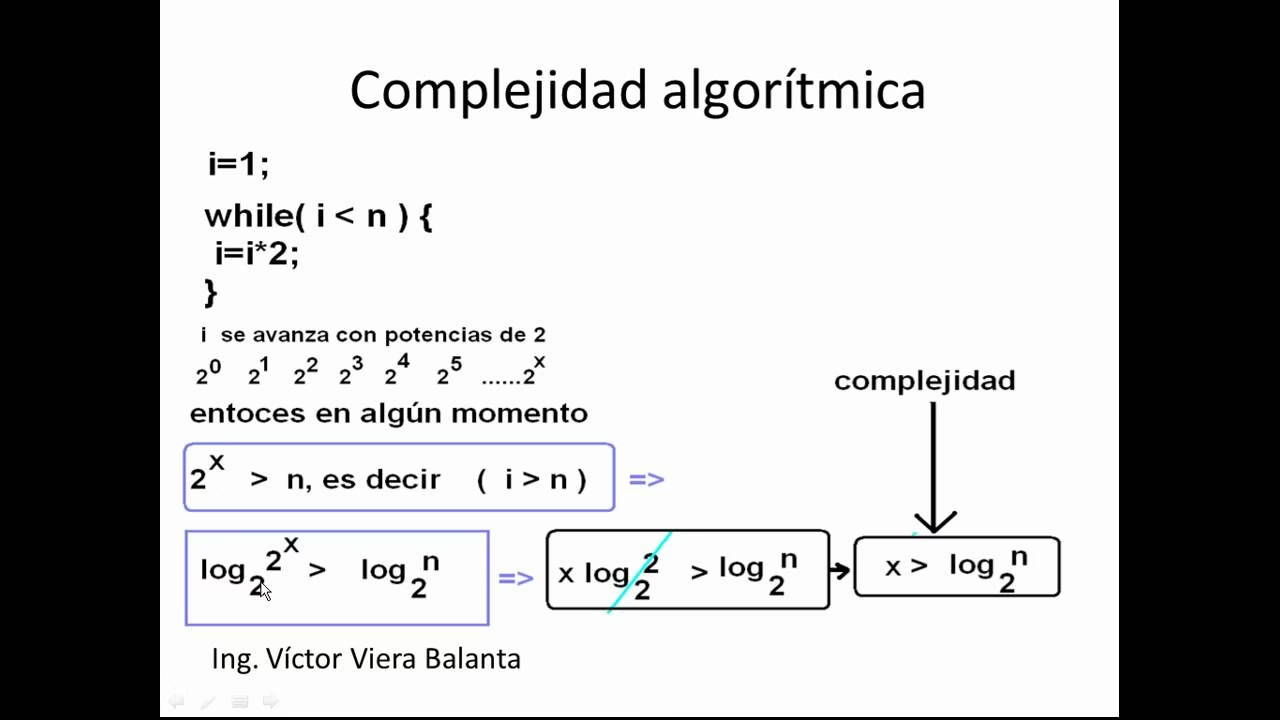

- O(log n) - Complejidad Logarítmica: El espacio utilizado es proporcional al logaritmo del tamaño de la entrada. Esto es común en algoritmos que dividen el problema a la mitad en cada paso, como la búsqueda binaria (aunque su complejidad espacial suele ser O(1) si es iterativa, o O(log n) si es recursiva debido a la pila de llamadas).

- O(n) - Complejidad Lineal: El espacio utilizado es directamente proporcional al tamaño de la entrada. Un ejemplo clásico es almacenar un arreglo de 'n' elementos.

- O(n log n) - Complejidad Log-Lineal: El espacio aumenta proporcionalmente al tamaño de la entrada multiplicado por un factor logarítmico. Menos común para la complejidad espacial directa, pero puede surgir en ciertos algoritmos de ordenamiento o estructuras de datos.

- O(n²) - Complejidad Cuadrática: El espacio aumenta proporcionalmente al cuadrado del tamaño de la entrada. Un ejemplo es el almacenamiento de una matriz bidimensional de 'n x n' elementos.

- O(2^n) - Complejidad Exponencial: El espacio crece exponencialmente con el tamaño de la entrada. Esto es extremadamente ineficiente y generalmente solo se ve en algoritmos que exploran todas las posibles combinaciones o permutaciones.

Notación Omega (Ω)

La notación Omega describe un límite inferior asintótico. Representa el escenario del "mejor caso" del crecimiento del consumo de memoria de un algoritmo. Indica que la cantidad de espacio que un algoritmo toma no crecerá más lento que una función dada f(n), pero podría crecer a un ritmo más rápido.

Notación Theta (Θ)

La notación Theta representa un límite ajustado asintótico. Se utiliza cuando el límite superior (Big-O) y el límite inferior (Omega) son los mismos. Significa que el algoritmo tomará al menos esta cantidad de espacio (límite inferior) y no más de esta cantidad (límite superior). Es la descripción más precisa del crecimiento de la complejidad espacial.

¿Cómo se Calcula la Complejidad Espacial?

El cálculo de la complejidad espacial varía ligeramente dependiendo del tipo de algoritmo:

Algoritmos Iterativos

Para los algoritmos iterativos, el cálculo es generalmente más directo. Necesitas considerar las variables y estructuras de datos que se declaran en tu programa:

- Variables Simples: Declarar una variable de tipo entero, booleano o flotante generalmente añade una complejidad espacial de O(1), ya que el tamaño de un tipo de dato específico es constante, independientemente del tamaño de la entrada del problema.

- Arreglos (Arrays): Declarar un arreglo de tamaño 'n' (por ejemplo,

int arr[n];) hará que la complejidad espacial aumente en un factor de O(n). - Matrices (2D Arrays): Una matriz bidimensional de tamaño 'n x m' (o 'n x n' si es cuadrada) aumentará la complejidad espacial en un factor de O(n*m) o O(n²).

- Estructuras de Datos Definidas por el Usuario: Tipos de datos más complejos, como nodos de listas enlazadas, árboles o grafos, requerirán un análisis más detallado, pero seguirán principios similares de proporcionalidad al número de elementos almacenados.

En la mayoría de los casos, los algoritmos iterativos son relativamente sencillos de analizar en términos de complejidad espacial, ya que el uso de memoria es explícito a través de las declaraciones de variables y estructuras de datos.

Algoritmos Recursivos

Los algoritmos recursivos pueden ser más complejos de analizar en términos de complejidad espacial, ya que, además de las variables y estructuras de datos (memoria reservada para operaciones en el "heap"), también debes considerar la memoria de la pila que se utiliza para las llamadas recursivas. Cada llamada a una función recursiva añade un "marco de pila" a la pila de llamadas, que contiene las variables locales de esa llamada, los parámetros y la dirección de retorno.

Consideremos el clásico algoritmo de Fibonacci, donde F(n) = F(n-1) + F(n-2) para n > 2. Si trazas las llamadas recursivas, verás que el programa no ocupa más de 'n' celdas en la memoria de la pila para una llamada a F(n). Cada llamada recursiva crea un nuevo marco en la pila hasta que se alcanza el caso base. Una vez que la llamada recursiva más profunda retorna, su marco se elimina de la pila, liberando memoria. Sin embargo, en el peor de los casos, la profundidad máxima de la pila de llamadas puede ser 'n'.

Si asumimos que cada celda en la pila reserva un espacio igual, entonces podríamos decir que este algoritmo (en su implementación recursiva ingenua) tiene una complejidad espacial de O(n) debido al tamaño de la pila de llamadas. Es crucial tener esto en cuenta, ya que una recursión muy profunda puede llevar a un "desbordamiento de pila" (stack overflow), un error similar a la falta de memoria, pero específico de la pila de llamadas.

Ejemplos Avanzados: Complejidad Espacial en Sistemas de Reconocimiento Facial (PCA)

Para ilustrar la aplicación práctica de la complejidad espacial, podemos analizar su cálculo en sistemas de reconocimiento facial basados en el Análisis de Componentes Principales (PCA), como se menciona en la literatura especializada. En estos sistemas, el "eigenspace" de la matriz de covarianza y los vectores de características se calculan una única vez para el conjunto de entrenamiento y se almacenan en memoria para tareas posteriores de extracción de características y reconocimiento.

La complejidad espacial de un sistema FRS (Face Recognition System) basado en PCA se define como la cantidad de espacio necesaria para almacenar la matriz de covarianza y los vectores de características del conjunto de entrenamiento.

Supongamos que tenemos N imágenes de entrenamiento, cada una con dimensiones m × n. Cada imagen se transforma en un vector de dimensión d, donde d = m × n. Para enfoques basados en particiones, cada vector se divide en 'p' subvectores, cada uno de dimensión 'u'.

Complejidad Espacial para PCA Estándar (SPCA)

Sea la dimensión de cada vector de características PCA d' (d' ≤ d). La complejidad espacial para un FRS basado en PCA (SPCA) es la suma de la complejidad espacial para almacenar las matrices de covarianza PCA (SPCAC) y la complejidad espacial para almacenar N vectores de características de entrenamiento PCA (SPCAF).

SPCA = SPCAC + SPCAF = d² + N * d' = (m*n)² + N * d'

Donde d² representa el espacio para la matriz de covarianza (que es cuadrada de dimensión d) y N*d' es el espacio para N vectores de características, cada uno de dimensión d'.

Complejidad Espacial para SpPCA (SSpPCA)

La complejidad espacial para un FRS basado en SpPCA (SSpPCA) es el espacio para las matrices de covarianza correspondientes (SSpPCAC) más el espacio para N vectores de características de entrenamiento SpPCA (SSpPCAF). Sea la dimensión de cada vector de características de subpatrón r (r ≤ u). El espacio necesario para los vectores de características de subpatrones por imagen es p * r.

SSpPCA = SSpPCAC + SSpPCAF = p * u² + N * p * r = (m*n)² / p + N * p * r

Aquí, p*u² representa el espacio para las 'p' matrices de covarianza de subpatrones (cada una de dimensión u), y N*p*r es el espacio para N imágenes, cada una con 'p' subvectores de dimensión 'r'.

Complejidad Espacial para SubXPCA (SSubXPCA)

Para SubXPCA, la complejidad espacial (SSubXPCA) es la suma de las complejidades espaciales de su matriz de covarianza (SSubXPCAC) y los vectores de características de entrenamiento (SSubXPCAP). Dado que la característica SubXPCA se obtiene aplicando PCA sobre los vectores de características SpPCA, SSubXPCAC es la suma de SSpPCAC y la matriz de covarianza (SPCA-SpPCAC) necesaria para obtener los vectores de características SubXPCA a partir de los vectores de características SpPCA. Sea la dimensión de cada vector de características SubXPCA d''.

SSubXPCA = (SSpPCAC + SPCA-SpPCAC) + N * d'' = (m*n)² / p + (p*r)² + N * d''

Esta fórmula refleja el espacio necesario para las matrices de covarianza de subpatrones, la matriz de covarianza adicional para la transformación y el almacenamiento de los nuevos vectores de características.

Complejidad Espacial para ESpPCA (SESpPCA)

La complejidad espacial para ESpPCA (SESpPCA) es la suma de las complejidades espaciales de su matriz de covarianza (SESpPCAC) y los vectores de características de entrenamiento (SESpPCAF). Como ESpPCA combina características SpPCA y PCA, SESpPCAC es la suma de SSpPCAC y SPCAC.

SESpPCA = SESpPCAC + SESpPCAF = (m*n)² + (m*n)² / p + N * (p*r + d') = (1 + 1/p) * (m*n)² + N * (p*r + d')

Aquí se suma el espacio de las matrices de covarianza de PCA y SpPCA, más el espacio para los vectores de características combinados.

Complejidad Espacial para ESubXPCA (SESubXPCA)

Para ESubXPCA, la complejidad espacial (SESubXPCA) es la suma de las complejidades espaciales de su matriz de covarianza (SESubXPCAC) y los vectores de características de entrenamiento (SESubXPCAF). Como en ESubXPCA, PCA se aplica sobre los vectores de características ESpPCA, SESubXPCAC es la suma de SESpPCAC y la matriz de covarianza (SPCA-ESpPCAC) necesaria para obtener los vectores de características ESubXPCA a partir de los vectores de características ESpPCA. Sea la dimensión de cada vector de características ESubXPCA d'''.

SESubXPCA = (SESpPCAC + SPCA-ESpPCAC) + N * d''' = (1 + 1/p) * (m*n)² + (p*r + d')² + N * d'''

Esta es la más compleja, ya que acumula el espacio de varias matrices de covarianza y los vectores de características transformados.

Estos ejemplos demuestran cómo la complejidad espacial se calcula de manera específica para diferentes algoritmos y configuraciones, resaltando la importancia de considerar el almacenamiento de matrices y vectores de características, especialmente en aplicaciones de procesamiento de datos a gran escala.

Preguntas Frecuentes sobre la Complejidad Espacial

¿La complejidad espacial es siempre menos importante que la complejidad temporal?

No, no siempre. Si bien la complejidad temporal a menudo recibe más atención porque afecta directamente la velocidad de ejecución, la complejidad espacial es igualmente crítica, especialmente en sistemas con recursos de memoria limitados (como dispositivos embebidos o móviles) o cuando se manejan conjuntos de datos muy grandes (big data). Un algoritmo con baja complejidad temporal pero alta complejidad espacial puede ser inutilizable si agota la memoria del sistema. El equilibrio entre ambas es clave para un diseño algorítmico óptimo.

¿El hardware de mi computadora afecta la complejidad espacial de un algoritmo?

La complejidad espacial asintótica (O(n), O(n²), etc.) describe cómo el consumo de memoria del algoritmo crece con el tamaño de la entrada, y esta relación fundamental no cambia con el hardware. Sin embargo, la cantidad real de memoria (en bytes o gigabytes) que un algoritmo consume para una entrada dada sí se ve afectada por el hardware (tamaño de la palabra del procesador, arquitectura de memoria) y el software (lenguaje de programación, compilador, sistema operativo). Un sistema con más RAM podrá ejecutar algoritmos con una mayor huella de memoria antes de experimentar problemas.

¿Puedo ignorar la complejidad espacial para entradas pequeñas?

Para entradas muy pequeñas, la complejidad espacial suele ser un factor menor, ya que la memoria requerida es mínima y fácilmente acomodada por la mayoría de los sistemas. En estos casos, la facilidad de implementación o la legibilidad del código pueden ser más importantes que la optimización extrema del espacio. Sin embargo, es una buena práctica tener en cuenta la complejidad espacial desde el principio, ya que un algoritmo diseñado sin considerar el espacio puede volverse problemático si las entradas crecen inesperadamente o si el algoritmo se reutiliza en un entorno con recursos más limitados.

¿Cómo puedo reducir la complejidad espacial de un algoritmo?

Reducir la complejidad espacial a menudo implica compromisos. Algunas estrategias incluyen:

- Reutilización de variables: En lugar de crear nuevas variables o estructuras de datos en cada paso, reutiliza las existentes cuando sea posible.

- Estructuras de datos eficientes: Elige estructuras de datos que minimicen el uso de memoria para tu problema específico (ej. listas enlazadas vs. arreglos fijos si el tamaño es muy variable).

- Algoritmos "in-place": Prefiere algoritmos que modifican los datos de entrada directamente en lugar de crear copias completas de los datos (ej. algunos algoritmos de ordenamiento como Quicksort vs. Mergesort).

- Recursión a Iteración: Convertir algoritmos recursivos a iterativos puede eliminar la sobrecarga de la pila de llamadas, reduciendo la complejidad espacial de O(n) a O(1) en muchos casos.

- Carga de datos bajo demanda: En lugar de cargar todo un conjunto de datos en memoria, procesa los datos en bloques pequeños o cárgalos solo cuando sean necesarios.

Conclusión

La complejidad espacial es una métrica vital en el análisis de algoritmos que complementa a la complejidad temporal. Comprender cómo los algoritmos utilizan la memoria es esencial para diseñar sistemas eficientes, estables y escalables. Desde la gestión de variables simples hasta el almacenamiento de complejas matrices en sistemas de reconocimiento facial, cada decisión de diseño tiene implicaciones en el consumo de recursos. Al dominar el cálculo y la optimización de la complejidad espacial, los desarrolladores pueden asegurar que sus soluciones no solo sean rápidas, sino también sostenibles y robustas frente a las crecientes demandas de datos y procesamiento en el mundo actual.

En la era del "big data" y la computación en la nube, donde los costos y la eficiencia de los recursos son primordiales, el análisis de la complejidad espacial no es solo una curiosidad académica, sino una habilidad práctica indispensable para todo ingeniero de software.

Si quieres conocer otros artículos parecidos a La Importancia de la Complejidad Espacial en Algoritmos puedes visitar la categoría Cálculos.