26/04/2025

En un mundo cada vez más complejo, donde cada decisión puede tener un impacto significativo, la capacidad de encontrar la 'mejor' opción posible se vuelve invaluable. Aquí es donde entra en juego la optimización matemática, una poderosa rama de las matemáticas aplicadas que nos permite identificar los valores óptimos de una función, ya sea para maximizar un beneficio o minimizar un costo. Desde la ingeniería y la economía hasta la logística y la inteligencia artificial, los principios de la optimización son fundamentales para la eficiencia y la innovación. Este artículo te guiará a través de los conceptos clave de la optimización, sus aplicaciones prácticas y cómo puedes empezar a entender y aplicar estas técnicas.

La optimización no es solo un concepto abstracto; es una disciplina que permea nuestra vida diaria, aunque no siempre seamos conscientes de ello. Cada vez que buscas la ruta más corta en el GPS, una empresa decide cómo asignar sus recursos para maximizar la producción, o un científico ajusta parámetros para obtener el mejor resultado experimental, se están aplicando principios de optimización. Se trata, en esencia, de transformar un problema del mundo real en un modelo matemático que nos permita encontrar la solución más eficiente o deseable.

- ¿Qué es un Problema de Optimización Matemática?

- Notación Común en Problemas de Optimización

- Subcampos Principales de la Optimización

- Cálculo de Unidades Producidas: Un Enfoque desde la Optimización

- Condiciones para la Optimalidad

- Técnicas de Optimización Computacional

- Preguntas Frecuentes sobre la Optimización

- Conclusión

¿Qué es un Problema de Optimización Matemática?

Un problema de optimización, en su forma más fundamental, busca encontrar un elemento 𝑥₀ dentro de un conjunto 𝑥 (llamado el espacio de búsqueda o conjunto de elección), tal que una función 𝑓: 𝑥 → ℝ (conocida como la función objetivo, función de costo o función de utilidad) alcance su valor mínimo o máximo en 𝑥₀. Si buscamos el valor más bajo, hablamos de minimización; si buscamos el más alto, de maximización.

Formalmente, un problema de optimización se puede expresar como:

- Minimización: Buscar 𝑥₀ en 𝑥 tal que 𝑓(𝑥₀) ≤ 𝑓(𝑥) para todo 𝑥 en 𝑥.

- Maximización: Buscar 𝑥₀ en 𝑥 tal que 𝑓(𝑥₀) ≥ 𝑓(𝑥) para todo 𝑥 en 𝑥.

Los elementos de 𝑥 se denominan soluciones candidatas o soluciones factibles. Una solución factible que minimiza o maximiza la función objetivo se conoce como una solución óptima. Es importante destacar que, por convención, muchos problemas de optimización se formulan en términos de minimización, ya que un problema de maximización puede convertirse en uno de minimización simplemente minimizando el negativo de la función objetivo.

Tipos de Óptimos: Locales vs. Globales

En problemas de optimización, especialmente aquellos donde la función objetivo o la región factible no son convexas, puede haber múltiples mínimos o máximos. Un mínimo local 𝑥* es un punto donde, en una región cercana, todos los valores de la función son mayores o iguales al valor en 𝑥*. Un mínimo global, por otro lado, es el punto donde la función alcanza su valor más bajo en todo el espacio de búsqueda. La distinción es crucial, ya que muchos algoritmos encuentran mínimos locales, pero garantizar un mínimo global requiere técnicas más avanzadas o propiedades específicas del problema, como la convexidad.

Notación Común en Problemas de Optimización

Los problemas de optimización a menudo se expresan con una notación especial que condensa mucha información. Comprender esta notación es fundamental para trabajar con estos problemas.

Valor Mínimo y Máximo de una Función

La notación más básica indica si buscamos un mínimo o un máximo:

minₓ∈ℝ (x² + 1): Esta expresión denota el valor mínimo de la función objetivox² + 1, dondexse selecciona del conjunto de números reales (ℝ). En este caso, el valor mínimo es 1, y ocurre cuandox = 0.maxₓ∈ℝ 2x: Esta expresión busca el valor máximo de la función objetivo2x, dondexpuede ser cualquier número real. En este caso, no existe un máximo acotado, por lo que la respuesta sería 'infinito' o 'indefinido'.

Argumentos de la Entrada Óptima (argmin y argmax)

A veces, no nos interesa el valor mínimo o máximo de la función en sí, sino los valores de las variables de entrada que producen ese mínimo o máximo. Para esto, usamos argmin y argmax:

argminₓ∈(-∞, -1] x² + 1: Esta notación representa el valor (o valores) dexen el intervalo(-∞, -1]que minimizan la función objetivox² + 1. Aunque el mínimo global dex² + 1ocurre enx = 0, ese valor no es factible (no pertenece al intervalo dado). Por lo tanto, el valor que minimiza la función dentro del intervalo esx = -1.argmaxₓ∈[-5, 5], y∈ℝ x cos(y): Aquí buscamos el par(x, y)que maximiza la funciónx cos(y), con la restricción de quexesté en el intervalo[-5, 5]. Las soluciones son pares de la forma(5, 2kπ)y(-5, (2k+1)π), dondekes cualquier número entero.

argmin y argmax significan "argumento del mínimo" y "argumento del máximo", respectivamente.

Subcampos Principales de la Optimización

La optimización es un campo vasto con muchas especializaciones, cada una diseñada para abordar tipos específicos de problemas. A continuación, exploraremos algunos de los subcampos más importantes:

| Subcampo | Características Principales | Ejemplos de Aplicación |

|---|---|---|

| Programación Lineal (PL) | Función objetivo y restricciones son lineales. | Optimización de rutas de transporte, asignación de recursos en producción, mezcla de productos. |

| Programación Cuadrática | Función objetivo con términos cuadráticos, restricciones lineales. | Optimización de carteras de inversión, control de procesos, diseño de sistemas. |

| Programación Convexa | Función objetivo convexa (minimización) o cóncava (maximización), conjunto de restricciones convexo. | Machine learning (SVMs), diseño de circuitos, procesamiento de señales. |

| Programación No Lineal | Función objetivo o restricciones (o ambas) contienen partes no lineales. | Diseño de ingeniería, optimización de redes, problemas de ajuste de curvas. |

| Programación con Enteros | Algunas o todas las variables deben tomar valores enteros. | Planificación de la producción, problemas de empaquetamiento, programación de horarios. |

| Programación Estocástica | Algunas restricciones o parámetros dependen de variables aleatorias. | Gestión de riesgos financieros, planificación de energía bajo incertidumbre, logística. |

| Programación Robusta | Aborda la incertidumbre en los datos de entrada considerando imprecisiones. | Diseño de sistemas bajo incertidumbre, planificación de cadenas de suministro. |

| Optimización Combinatoria | El conjunto de soluciones factibles es discreto o puede reducirse a uno. | Problema del viajante de comercio, problemas de asignación, planificación de redes. |

| Cálculo de Variaciones | Optimiza objetivos definidos sobre muchos puntos a lo largo del tiempo. | Control óptimo, mecánica, física. |

| Programación Dinámica | Divide el problema en subproblemas más pequeños, resolviéndolos recursivamente. | Ruta más corta, planificación de inventarios, finanzas. |

Detalles Adicionales sobre Subcampos

- Programación Lineal (PL): Es quizás el subcampo más conocido y utilizado. Su simplicidad y la disponibilidad de algoritmos eficientes (como el método Simplex o los métodos de punto interior) la hacen ideal para problemas de gran escala. Un ejemplo clásico es la maximización de beneficios en una fábrica, sujeta a limitaciones de materias primas y tiempo de máquina.

- Programación Convexa: Es particularmente atractiva porque cualquier mínimo local es también un mínimo global, lo que facilita la búsqueda de la solución óptima. Esto la hace muy útil en campos donde se requiere una garantía de optimalidad, como en el diseño de algoritmos para aprendizaje automático.

- Programación con Enteros: A menudo es mucho más difícil de resolver que la programación lineal, ya que la restricción de que las variables sean enteras introduce una complejidad combinatoria significativa. Se usa cuando las decisiones son discretas, como decidir si construir una fábrica (sí o no) o cuántas unidades exactas producir.

- Programación No Lineal: Es la categoría más general y, a menudo, la más desafiante. La ausencia de convexidad puede llevar a múltiples mínimos locales, y encontrar el mínimo global puede ser computacionalmente intensivo. Se aplica en situaciones donde las relaciones entre variables no son proporcionales, como en la optimización de la aerodinámica de un vehículo.

Cálculo de Unidades Producidas: Un Enfoque desde la Optimización

Aunque el concepto de 'unidades producidas' a menudo se asocia con la contabilidad y la depreciación, el método de la unidad de producción puede verse como una forma de optimizar la asignación de costos a lo largo de la vida útil de un activo. Este método busca reflejar de manera más precisa el desgaste de un activo en función de su uso real, en lugar de simplemente dividir su costo uniformemente a lo largo del tiempo.

Método de la Unidad de Producción

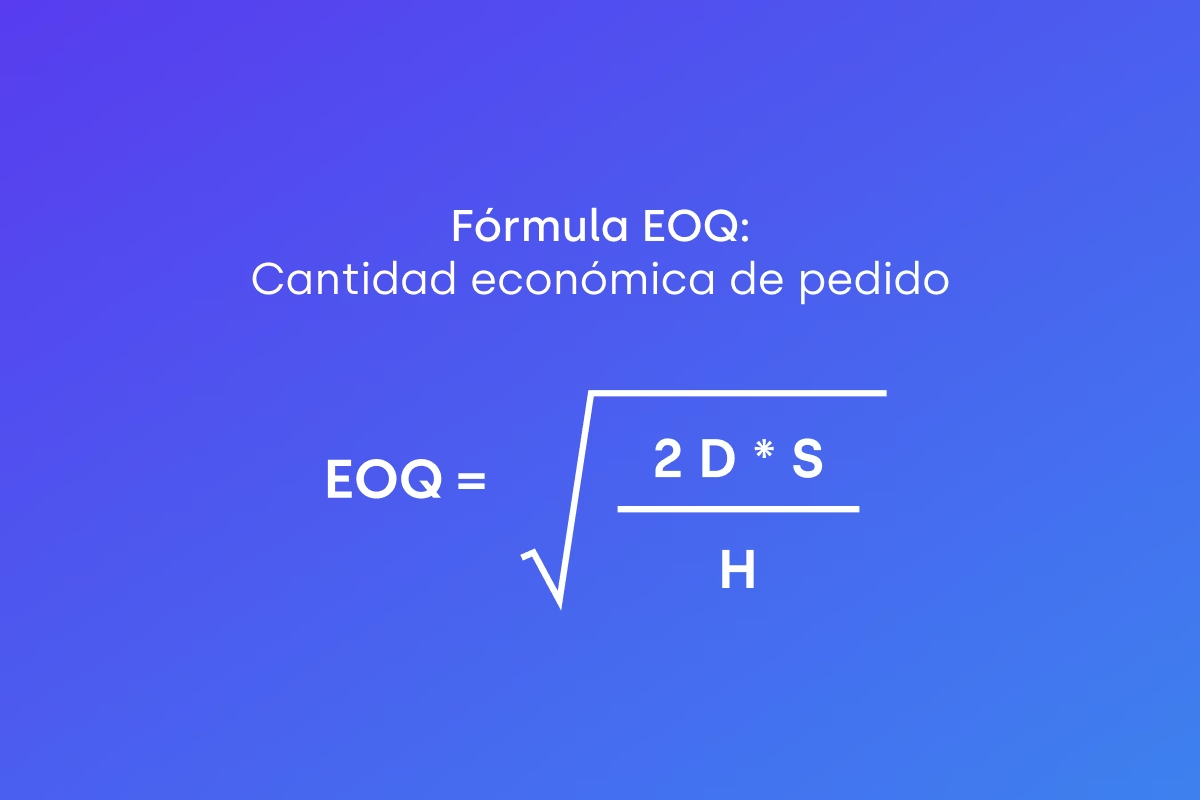

El método de unidad de producción calcula la depreciación de un activo basándose en la cantidad de producción que genera. Funciona dividiendo el costo total del activo (menos su valor residual, si lo hay) por el número total de unidades que se espera que produzca durante su vida útil. Esto nos da un costo de depreciación por unidad de producción.

Fórmula del Costo por Unidad de Producción:

Costo por Unidad = (Costo Total del Activo - Valor Residual) / Número Total de Unidades Esperadas

Una vez que tenemos el costo por unidad, para cada período contable, el costo de depreciación se calcula multiplicando este costo por unidad por el número de unidades producidas en ese período.

Fórmula de la Depreciación del Período:

Depreciación del Período = Costo por Unidad × Número de Unidades Producidas en el Período

Ejemplo Práctico: Depreciación por Unidades Producidas

Imaginemos que una empresa adquiere una máquina por 100.000 unidades monetarias. Se estima que la máquina tiene un valor residual de 10.000 unidades monetarias al final de su vida útil y que producirá un total de 450.000 unidades a lo largo de su existencia.

- Calcular el Costo por Unidad:

Costo Depreciable = Costo Total - Valor Residual = 100.000 - 10.000 = 90.000 unidades monetariasCosto por Unidad = 90.000 / 450.000 unidades = 0,20 unidades monetarias por unidad producida - Calcular la Depreciación Anual (o Periódica):

Supongamos que en el primer año, la máquina produce 100.000 unidades.Depreciación Año 1 = 0,20 × 100.000 = 20.000 unidades monetarias

Si en el segundo año produce 150.000 unidades.Depreciación Año 2 = 0,20 × 150.000 = 30.000 unidades monetarias

Y así sucesivamente hasta que el costo depreciable total se haya asignado.

Este método es una forma de optimizar la asignación de costos, asegurando que los gastos de capital se distribuyan de manera eficiente y proporcional al uso real del activo, lo cual es fundamental para una contabilidad precisa y la toma de decisiones financieras. No es una optimización en el sentido de "encontrar el mejor valor" de una función matemática, sino una aplicación de cálculos para determinar la distribución 'óptima' de un costo a lo largo del tiempo, basada en un uso variable.

Condiciones para la Optimalidad

Para encontrar las soluciones óptimas, los matemáticos y los ingenieros utilizan una serie de condiciones y pruebas. Estas condiciones nos permiten identificar los puntos críticos y determinar si son mínimos, máximos o puntos de silla.

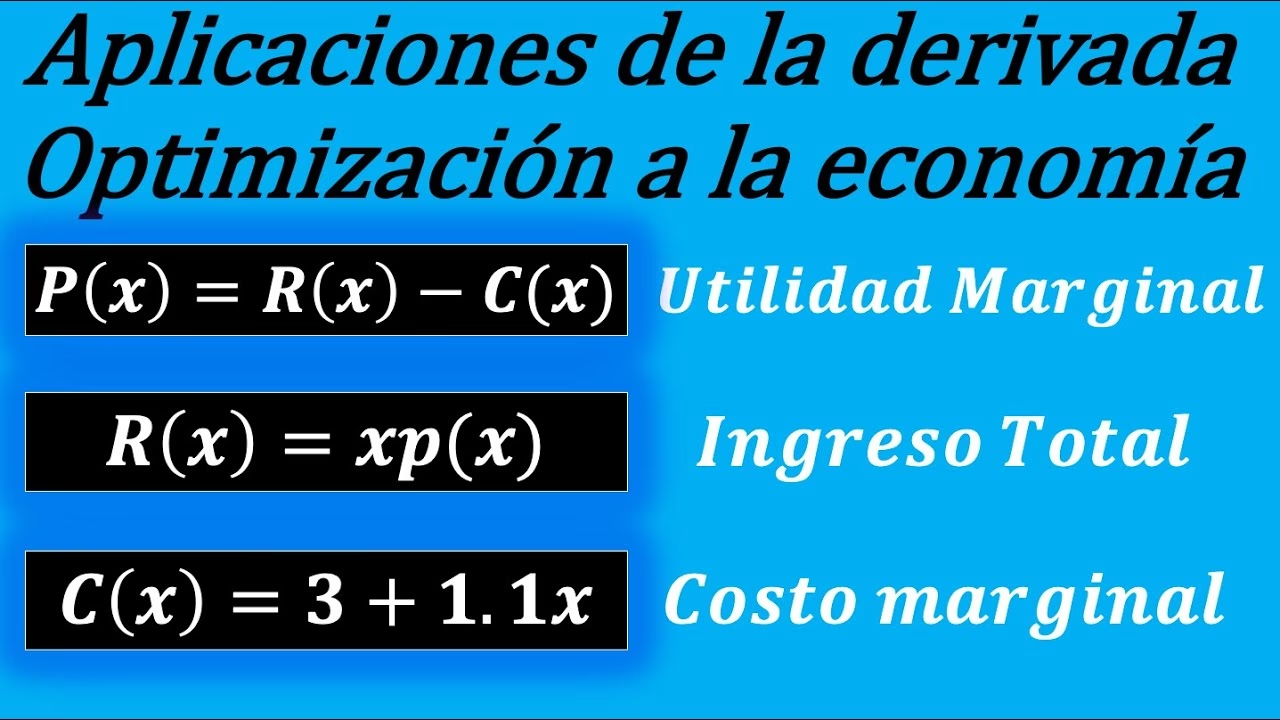

- Condiciones de Primer Orden: Para problemas sin restricciones, un óptimo (mínimo o máximo) se encuentra en un punto estacionario, donde la primera derivada de la función objetivo es cero (o su gradiente es nulo en problemas multidimensionales). El famoso teorema de Fermat es un pilar aquí.

- Condiciones de Segundo Orden: Si la primera derivada es cero, un punto puede ser un mínimo, un máximo o un punto de silla. Para diferenciar, se examina la segunda derivada (o la matriz Hessiana para múltiples variables). Si la segunda derivada es positiva, es un mínimo; si es negativa, un máximo.

- Multiplicadores de Lagrange y Condiciones KKT: Para problemas con restricciones, la situación se vuelve más compleja. Los multiplicadores de Lagrange son una técnica ingeniosa que transforma un problema con restricciones de igualdad en uno sin restricciones. Cuando hay restricciones de desigualdad, se utilizan las Condiciones de Karush-Kuhn-Tucker (KKT), que son un conjunto de condiciones necesarias para la optimalidad en problemas no lineales con restricciones.

Técnicas de Optimización Computacional

Resolver problemas de optimización complejos, especialmente aquellos con muchas variables o funciones no lineales, a menudo requiere el uso de computadoras y algoritmos especializados. Estos algoritmos pueden ser deterministas (garantizan encontrar el óptimo global bajo ciertas condiciones) o heurísticos (buscan buenas soluciones, pero no necesariamente las óptimas, en un tiempo razonable).

- Métodos de Punto Interior: Son algoritmos eficientes para la programación lineal y convexa que se mueven a través del interior de la región factible hasta alcanzar el óptimo.

- Algoritmos de Gradiente: Utilizan la información del gradiente de la función objetivo para moverse en la dirección de mayor descenso (para minimización) o mayor ascenso (para maximización).

- Heurísticas y Metaheurísticas: Incluyen algoritmos como los genéticos, recocido simulado, y optimización por enjambre de partículas. Son útiles para problemas muy difíciles o NP-duros donde encontrar la solución óptima es computacionalmente inviable. No garantizan la optimalidad, pero a menudo encuentran soluciones muy buenas.

- Programación Dinámica: Una técnica que descompone un problema grande en subproblemas más pequeños, resolviéndolos una vez y almacenando sus soluciones para evitar recálculos, lo que es eficiente para problemas con estructura de superposición de subproblemas y subestructura óptima.

Preguntas Frecuentes sobre la Optimización

¿Cuál es la diferencia entre un mínimo local y uno global?

Un mínimo local es el punto más bajo en una región específica del espacio de búsqueda, mientras que un mínimo global es el punto más bajo en todo el espacio de búsqueda. Un algoritmo puede encontrar un mínimo local y creer que ha encontrado la mejor solución, cuando en realidad hay un punto aún más bajo en otro lugar. La convexidad de la función objetivo y del conjunto factible es clave, ya que en problemas convexos, cualquier mínimo local es también un mínimo global.

¿Por qué es importante la convexidad en optimización?

La convexidad es crucial porque simplifica enormemente el problema de encontrar la solución óptima. Cuando la función objetivo es convexa (para minimización) y el conjunto factible es convexo, cualquier mínimo local es garantizado ser un mínimo global. Esto significa que los algoritmos pueden encontrar la solución óptima de manera más eficiente y confiable, sin el riesgo de quedarse atrapados en un óptimo subóptimo.

¿Cómo se aplica la optimización en la vida real?

La optimización se aplica en innumerables campos. Por ejemplo, en logística, para encontrar las rutas de entrega más eficientes; en finanzas, para construir carteras de inversión que maximicen el retorno y minimicen el riesgo; en ingeniería, para diseñar estructuras que sean fuertes pero utilicen la mínima cantidad de material; en medicina, para planificar tratamientos de radioterapia que maximicen la dosis al tumor y minimicen el daño a tejidos sanos; y en ciencia de datos, para entrenar modelos de aprendizaje automático minimizando errores de predicción.

¿Qué herramientas se usan para resolver problemas de optimización complejos?

Además de la comprensión teórica, existen diversas herramientas computacionales para resolver problemas de optimización. Estas incluyen lenguajes de programación con bibliotecas especializadas (como SciPy en Python, Optim.jl en Julia), software de optimización dedicado (como Gurobi, CPLEX, KNITRO) y plataformas de modelado (como AMPL, GAMS). Estas herramientas permiten a los usuarios definir sus funciones objetivo y restricciones, y luego aplicar algoritmos sofisticados para encontrar soluciones.

Conclusión

La optimización matemática es una disciplina poderosa y versátil que nos dota de las herramientas necesarias para tomar decisiones más inteligentes y eficientes. Desde los cálculos básicos de unidades producidas para la contabilidad hasta la resolución de intrincados problemas de logística global o el diseño de sistemas complejos, la capacidad de identificar la 'mejor' solución es fundamental. Al comprender sus principios, notaciones y subcampos, podemos aplicar el rigor del cálculo para transformar desafíos en oportunidades, maximizando beneficios y minimizando desperdicios en prácticamente cualquier dominio. Es, en esencia, el arte de encontrar la eficiencia en un mundo de posibilidades.

Si quieres conocer otros artículos parecidos a Optimización Matemática: Halla la Mejor Solución puedes visitar la categoría Cálculos.