24/12/2023

En el vasto universo de la estadística y el análisis de datos, comprender la dispersión es tan crucial como conocer la tendencia central. Mientras que la media nos dice dónde se agrupan los datos, la varianza nos revela cuán dispersos están esos datos alrededor de su promedio. Es una medida fundamental que proporciona una visión profunda sobre la variabilidad de un conjunto de observaciones o de una variable aleatoria, siendo un pilar para la toma de decisiones informadas en campos tan diversos como la ciencia, la economía, la ingeniería y las finanzas. Este artículo desglosará qué es la varianza, cómo se calcula, sus propiedades esenciales y sus aplicaciones prácticas, permitiéndole dominar este concepto estadístico indispensable.

¿Qué es la Varianza de una Variable Aleatoria?

La varianza es una medida de la dispersión o la propagación de un conjunto de datos alrededor de su media. En términos más técnicos, es el valor esperado de las desviaciones al cuadrado de una variable aleatoria respecto a su media. Cuanto mayor sea la varianza, mayor será la dispersión de los datos.

Etimología y Origen

El término 'varianza' fue introducido por primera vez por el estadístico y biólogo Ronald Fisher en su influyente artículo de 1918, "La correlación entre parientes en el supuesto de herencia mendeliana". Fisher reconoció la utilidad de trabajar con el cuadrado de la desviación típica como una medida de variabilidad, especialmente cuando se combinaban múltiples causas independientes de variabilidad. Su razonamiento se basaba en el hecho de que las varianzas son aditivas bajo ciertas condiciones, lo que facilitaba el análisis de las fuentes de variación en los datos.

Definición Formal

La varianza de una variable aleatoria X, denotada comúnmente como Var(X) o sigma^2 (σ^2), se define matemáticamente como el valor esperado de la desviación al cuadrado de X respecto a su media (μ = E[X]):

Var(X) = E[(X - μ)^2]

Esta definición se aplica a variables aleatorias de cualquier tipo: discretas, continuas o mixtas. La varianza también puede ser vista como la covarianza de una variable aleatoria consigo misma: Cov(X, X). Es importante recordar que la unidad de medida de la varianza será siempre la unidad de medida original de los datos, pero elevada al cuadrado. Por ejemplo, si sus datos están en metros, la varianza estará en metros cuadrados.

Fórmula Alternativa y Propiedades Clave

Una fórmula alternativa y equivalente para la varianza, que a menudo es más conveniente para cálculos, es:

Var(X) = E[X^2] - E[X]^2

Es decir, la varianza de X es igual a la media del cuadrado de X menos el cuadrado de la media de X. Sin embargo, es crucial tener en cuenta que esta fórmula puede sufrir de cancelación catastrófica en cálculos con aritmética de coma flotante si los dos términos son muy similares en magnitud, lo que puede llevar a errores numéricos significativos. Para cálculos computacionales, existen algoritmos numéricamente más estables.

Una propiedad fundamental de la varianza es que siempre es mayor o igual que cero (Var(X) ≥ 0). Esto se debe a que las desviaciones se elevan al cuadrado, lo que hace que cualquier valor negativo se convierta en positivo, y la suma de cuadrados siempre es no negativa. Una varianza de cero implica que todos los valores de la variable aleatoria son idénticos a la media, es decir, no hay dispersión en absoluto.

Es interesante notar que no todas las distribuciones de probabilidad tienen varianza definida. Por ejemplo, la distribución de Cauchy no tiene esperanza (media), y por lo tanto tampoco tiene varianza. Otras distribuciones, como la de Pareto con un índice 'k' entre 1 y 2, pueden tener esperanza pero carecer de varianza.

¿Cómo se calcula la Varianza de una Variable Aleatoria?

El método de cálculo de la varianza depende de si la variable aleatoria es discreta o continua.

Varianza para Variables Aleatorias Discretas

Si X es una variable aleatoria discreta con una función de probabilidad P[X=x], la varianza se calcula mediante la siguiente sumatoria:

Var(X) = Sumatoria sobre x en R_X de (x - μ)^2 * P[X=x]

Donde μ = E[X] es la media de X, calculada como Sumatoria sobre x en R_X de x * P[X=x].

Ejemplo: Lanzamiento de un Dado Perfecto

Consideremos un dado de seis caras. Los valores posibles son 1, 2, 3, 4, 5, 6, y la probabilidad de cada uno es 1/6. Primero, calculamos la media (E[X]):

μ = (1+2+3+4+5+6)/6 = 3.5

Ahora, calculamos la varianza:

Var(X) = Sumatoria desde i=1 hasta 6 de (1/6) * (i - 3.5)^2

Var(X) = (1/6) * [(-2.5)^2 + (-1.5)^2 + (-0.5)^2 + (0.5)^2 + (1.5)^2 + (2.5)^2]

Var(X) = (1/6) * [6.25 + 2.25 + 0.25 + 0.25 + 2.25 + 6.25]

Var(X) = (1/6) * 17.50 = 35/12 ≈ 2.92

Ejemplo: Lanzamiento de una Moneda

Aunque el texto original menciona un programa, podemos simplificar el concepto. Asignemos valores a los resultados de lanzar una moneda: Cara = 0 y Cruz = 1. Si la moneda es justa, P[Cara=0] = 0.5 y P[Cruz=1] = 0.5.

Primero, calculamos la media (E[X]):

μ = (0 * 0.5) + (1 * 0.5) = 0.5

Ahora, la varianza:

Var(X) = (0 - 0.5)^2 * 0.5 + (1 - 0.5)^2 * 0.5

Var(X) = (-0.5)^2 * 0.5 + (0.5)^2 * 0.5

Var(X) = (0.25 * 0.5) + (0.25 * 0.5) = 0.125 + 0.125 = 0.25

Varianza para Variables Aleatorias Continuas

Si X es una variable aleatoria continua con una función de densidad de probabilidad f(x), la varianza se calcula mediante la siguiente integral:

Var(X) = Integral sobre R_X de (x - μ)^2 * f(x) dx

Donde μ = E[X] es la media de X, calculada como Integral sobre R_X de x * f(x) dx. Las integrales están definidas sobre el soporte de la variable aleatoria X (R_X).

Ejemplo: Distribución Exponencial

Para una variable aleatoria continua X con distribución exponencial y parámetro λ, su función de densidad es f_X(x) = λe^(-λx) para x ≥ 0. Se sabe que su media es E[X] = 1/λ. La varianza se calcula integrando:

Var(X) = Integral de 0 a infinito de (x - 1/λ)^2 * λe^(-λx) dx

Después de realizar la integración, el resultado es:

Var(X) = 1/λ^2

Propiedades Fundamentales de la Varianza

La varianza posee varias propiedades importantes que son cruciales para su manipulación y comprensión en el análisis estadístico:

- No Negatividad:

Var(X) ≥ 0. Como se mencionó, la varianza nunca puede ser negativa. - Varianza de una Constante:

Var(a) = 0. La varianza de una constante (un valor que no cambia) es siempre cero, ya que no hay dispersión. - Escalado por una Constante:

Var(aX) = a^2 * Var(X). Si una variable aleatoria se multiplica por una constante, su varianza se multiplica por el cuadrado de esa constante. - Varianza de la Suma de Variables Aleatorias (Dependientes):

Var(X + Y) = Var(X) + Var(Y) + 2 * Cov(X, Y). Aquí, Cov(X, Y) es la covarianza entre X e Y, una medida de cómo se mueven juntas las dos variables. - Varianza de la Suma de Variables Aleatorias (Independientes):

Var(X + Y) = Var(X) + Var(Y). Si X e Y son variables aleatorias independientes, su covarianza es cero, simplificando la fórmula anterior. - Ley de la Varianza Total (Fórmula de la Varianza Condicional):

Var(Y) = E(Var(Y|X)) + Var(E(Y|X)). Esta propiedad relaciona la varianza total de una variable con la varianza condicional y el valor esperado de la variable condicional, siendo muy útil en modelado estadístico complejo.

La Varianza Muestral: Estimando la Varianza Poblacional

En la práctica, rara vez tenemos acceso a la población completa para calcular la verdadera varianza poblacional (σ^2). En su lugar, trabajamos con muestras y necesitamos estimar la varianza de la población a partir de los datos de la muestra. Aquí es donde entra en juego la varianza muestral.

Si tomamos una muestra de 'n' valores (x1, x2, ..., xn) de una población, existen dos estimadores comunes para la varianza poblacional:

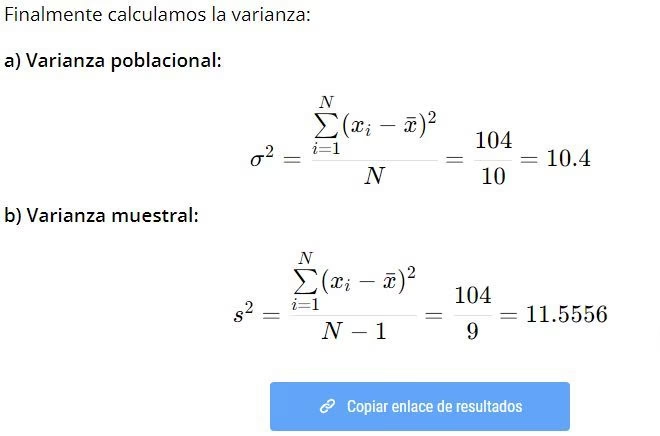

1. Varianza Muestral Directa (Sesgada)

Este estimador se calcula de manera similar a la varianza poblacional, dividiendo por 'n':

s_n^2 = (1/n) * Sumatoria desde i=1 hasta n de (x_i - x_barra)^2

Donde x_barra es la media muestral. Esta fórmula es intuitiva, pero es un estimador sesgado de la varianza poblacional. Esto significa que, en promedio, s_n^2 subestima la verdadera varianza poblacional.

2. Varianza Muestral Insesgada (Corregida por Bessel)

Este es el estimador más utilizado y se calcula dividiendo por 'n-1' en lugar de 'n':

s^2 = (1/(n-1)) * Sumatoria desde i=1 hasta n de (x_i - x_barra)^2

La razón de usar 'n-1' (conocida como la corrección de Bessel) se debe a que la media muestral (x_barra) ya es un estimador de la media poblacional (μ). Al usar x_barra en lugar de μ, perdemos un 'grado de libertad'. Dividir por 'n-1' compensa esta pérdida, haciendo que s^2 sea un estimador insesgado de la varianza poblacional, lo que significa que, en promedio, s^2 es igual a la verdadera varianza poblacional.

Para muestras grandes, la diferencia entre s_n^2 y s^2 es insignificante, pero para muestras pequeñas, la corrección de Bessel es crucial para obtener una estimación más precisa.

Propiedades de la Varianza Muestral

Además de ser un estimador insesgado, s^2 también es un estimador consistente de σ^2 bajo las condiciones de la ley de los grandes números. Esto significa que a medida que el tamaño de la muestra (n) aumenta, la varianza muestral tiende a acercarse al verdadero valor de la varianza poblacional. Cuando las muestras provienen de una distribución normal, la varianza muestral s^2 sigue una distribución chi-cuadrado escalada, lo cual es fundamental para la construcción de intervalos de confianza y pruebas de hipótesis relacionadas con la varianza.

Interpretaciones Adicionales de la Varianza Muestral

La varianza muestral también puede interpretarse como el promedio de los cuadrados de las diferencias entre cada par posible de datos. Por ejemplo, la fórmula para s_n^2 puede expresarse como:

s_n^2 = (1/n^2) * Sumatoria de i < j de (y_i - y_j)^2

Esto significa que la varianza es, en esencia, una medida de la distancia cuadrática promedio entre todos los puntos de datos de la muestra. Esta perspectiva resalta que la varianza cuantifica la variabilidad intrínseca dentro del propio conjunto de datos.

Algunas Aplicaciones Clave de la Varianza

La varianza no es solo un concepto teórico; tiene innumerables aplicaciones prácticas en diversos campos:

- Optimización de Estimadores: En inferencia estadística, la varianza se utiliza para evaluar la calidad de los estimadores. Los estimadores eficientes son aquellos que tienen la menor varianza posible, lo que minimiza el riesgo de que la estimación se desvíe demasiado del verdadero valor del parámetro. Los estimadores consistentes, por otro lado, son aquellos cuya varianza tiende a cero a medida que el tamaño de la muestra aumenta, garantizando precisión con muestras grandes.

- Modelado de Distribuciones de Probabilidad: En la distribución normal (campana de Gauss), la varianza (o su raíz cuadrada, la desviación típica) es uno de los parámetros clave que define la forma de la curva. Una varianza pequeña produce una campana de Gauss alta y estrecha (baja dispersión), mientras que una varianza grande resulta en una campana más ancha y aplanada (alta dispersión).

- Diagnóstico en Modelos de Regresión: En el análisis de regresión, un supuesto importante es la homocedasticidad, que significa que la varianza del término de error es constante en todos los niveles de las variables predictoras. Si la varianza del error no es constante (heterocedasticidad), los estimadores de mínimos cuadrados pueden ser ineficientes, afectando la validez de las inferencias estadísticas.

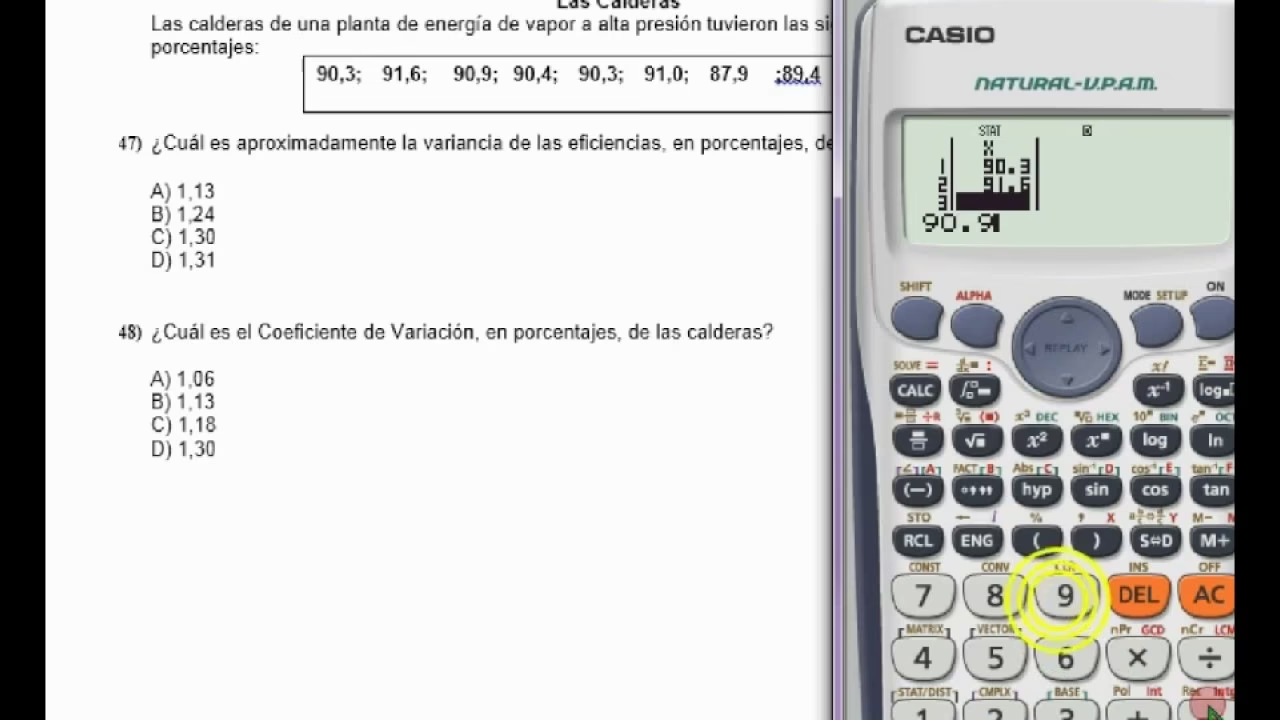

- Análisis de la Varianza (ANOVA): El ANOVA es una técnica estadística fundamental que permite comparar las medias de dos o más grupos. Su nombre se deriva de su enfoque en la descomposición de la varianza total de los datos en diferentes componentes atribuibles a distintas fuentes de variación (factores). Permite determinar si las diferencias observadas entre las medias de los grupos son estadísticamente significativas.

- Desigualdad de Chebyshev: Esta desigualdad es una herramienta poderosa que utiliza la varianza (o la desviación típica) para acotar la probabilidad de que una variable aleatoria se desvíe de su media en una cierta cantidad. Es útil cuando se desconoce la forma exacta de la distribución de probabilidad.

- Análisis de Riesgo en Finanzas: En el ámbito financiero, la varianza se utiliza ampliamente como una medida de riesgo. Una mayor varianza en el rendimiento de un activo (como una acción o un fondo de inversión) indica una mayor volatilidad y, por lo tanto, un mayor riesgo. Los inversores utilizan la varianza para evaluar y comparar el riesgo asociado con diferentes opciones de inversión.

- Control de Calidad: En la industria, la varianza es crucial para el control de calidad. Monitorear la varianza de un proceso de fabricación ayuda a asegurar que los productos se mantengan dentro de las especificaciones y que la variabilidad en la producción sea mínima, lo que lleva a productos más consistentes y de mayor calidad.

Preguntas Frecuentes (FAQ)

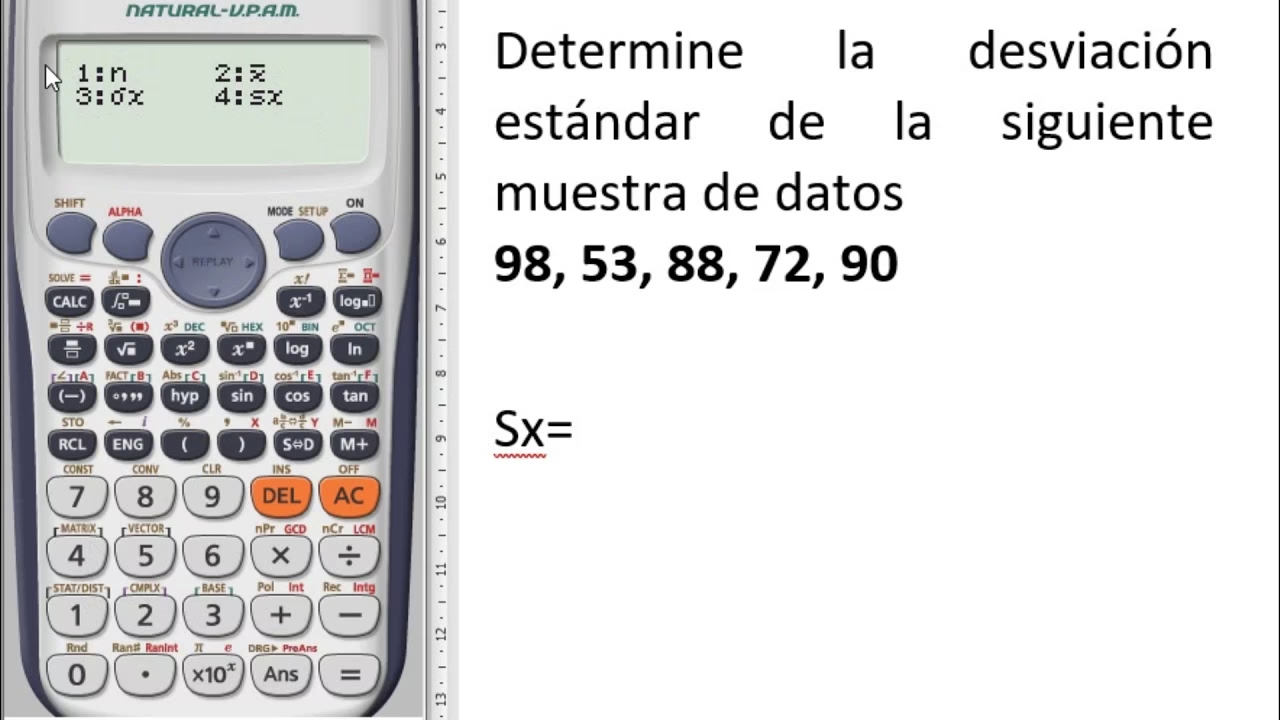

¿Cuál es la diferencia entre varianza y desviación estándar?

La varianza es el promedio de las desviaciones al cuadrado de los datos respecto a la media, mientras que la desviación estándar es simplemente la raíz cuadrada de la varianza. La principal diferencia radica en sus unidades: la varianza está en unidades cuadradas de los datos originales, lo que a menudo dificulta su interpretación directa. La desviación estándar, al estar en las mismas unidades que los datos originales, es mucho más fácil de interpretar y comprender en un contexto práctico.

¿Por qué la varianza siempre es no negativa?

La varianza siempre es no negativa (mayor o igual a cero) porque se calcula elevando al cuadrado las diferencias entre cada punto de datos y la media. Elevar al cuadrado cualquier número (positivo o negativo) siempre resulta en un número positivo o cero. Al sumar estos cuadrados, el resultado total nunca puede ser negativo. Una varianza de cero solo ocurre si todos los puntos de datos son idénticos.

¿Para qué se utiliza la varianza en la vida real?

La varianza tiene numerosas aplicaciones. En finanzas, mide el riesgo de una inversión. En control de calidad, evalúa la consistencia de un producto. En meteorología, puede indicar la variabilidad de la temperatura en una región. En investigación científica, ayuda a determinar si los resultados de un experimento son consistentes o si hay mucha variación. Es una herramienta fundamental para entender la dispersión y la predictibilidad de los fenómenos.

¿Qué son los valores atípicos y cómo afectan la varianza?

Los valores atípicos (o 'outliers') son puntos de datos que se desvían significativamente del resto de los datos en un conjunto. La varianza es muy sensible a estos valores atípicos. Debido a que la varianza calcula las desviaciones al cuadrado, un solo valor atípico que esté muy lejos de la media puede inflar drásticamente el valor de la varianza, dando una falsa impresión de una mayor dispersión general en los datos. Por esta razón, a menudo se considera la limpieza de datos o el uso de medidas de dispersión más robustas en presencia de valores atípicos.

¿Cuándo se usa 'n' y cuándo 'n-1' en la varianza muestral?

Se utiliza 'n' (el tamaño total de la muestra) en el denominador cuando se calcula la varianza de la muestra per se (s_n^2), es decir, la varianza de los datos que realmente se tienen. Sin embargo, cuando el objetivo es estimar la varianza de la población de la cual se extrajo la muestra, se utiliza 'n-1' en el denominador (s^2). Esto se conoce como la corrección de Bessel y produce un estimador insesgado de la varianza poblacional, lo que significa que es una estimación más precisa y confiable de la verdadera varianza de la población en promedio.

Conclusión

La varianza es una medida estadística de inmenso valor, que va mucho más allá de ser una simple fórmula matemática. Es la piedra angular para comprender la dispersión y la variabilidad inherente en cualquier conjunto de datos o variable aleatoria. Desde su conceptualización por Ronald Fisher hasta su aplicación en algoritmos modernos, la varianza nos permite cuantificar el riesgo en inversiones, evaluar la consistencia en procesos industriales, comparar grupos en estudios científicos y mucho más.

Aunque es sensible a valores atípicos, lo que puede requerir un manejo cuidadoso de los datos, la varianza, junto con su hermana la desviación estándar, sigue siendo una de las herramientas más poderosas en el arsenal de cualquier analista de datos, científico o profesional que busque extraer información significativa de la incertidumbre. Dominar este concepto es fundamental para realizar análisis estadísticos robustos y tomar decisiones bien fundamentadas en un mundo impulsado por los datos.

Si quieres conocer otros artículos parecidos a Varianza: Clave para Entender la Dispersión de Datos puedes visitar la categoría Estadística.