14/02/2025

En el vasto universo de la ciencia y la ingeniería, donde la precisión es a menudo sinónimo de éxito, existe una verdad ineludible: ninguna medición es perfecta. No importa cuán avanzado sea un instrumento, cuán meticuloso sea el científico o cuán controladas sean las condiciones, siempre existirá un margen de imprecisión. Es aquí donde emerge la Teoría de Errores, una disciplina fundamental que no solo reconoce esta realidad, sino que nos proporciona las herramientas para entenderla, cuantificarla y, en la medida de lo posible, mitigar sus efectos. Desde la construcción de un puente hasta el lanzamiento de un cohete, o incluso la simple medición de una longitud en un laboratorio escolar, comprender cómo los errores se manifiestan y cómo se manejan es crucial para garantizar la fiabilidad y validez de cualquier resultado.

La Teoría de Errores es una rama vital de la estadística matemática que se sumerge en el estudio de las desviaciones entre el valor medido y el valor verdadero de una magnitud física. Imagina que intentas medir la masa de un objeto con una balanza. Si repites la medición varias veces, es muy probable que obtengas resultados ligeramente diferentes cada vez. Estas variaciones no son un signo de fracaso, sino una manifestación inherente de la naturaleza de la medición. La teoría de errores nos equipa para ir más allá de la simple observación de estas diferencias, permitiéndonos comprender sus causas, predecir su impacto y, lo más importante, expresar la confiabilidad de nuestros resultados. Su objetivo principal no es eliminar los errores por completo —algo prácticamente imposible— sino cuantificarlos y presentarlos de manera transparente, permitiendo que otros evalúen la calidad de nuestros datos y experimentos.

- Tipos de Errores Identificados por la Teoría de Errores

- La Importancia Fundamental de la Teoría de Errores en la Ciencia y la Técnica

- Herramientas y Métodos para el Manejo de Errores

- Tabla Comparativa de Tipos de Errores

- Ejemplos Prácticos de Aplicación de la Teoría de Errores

- Aplicaciones Empresariales e Industriales de la Teoría de Errores

- Preguntas Frecuentes sobre la Teoría de Errores

- ¿Por qué es imposible evitar los errores en las mediciones?

- ¿Cuál es la diferencia clave entre precisión y exactitud en el contexto de la teoría de errores?

- ¿Cómo se utiliza una calculadora en la teoría de errores?

- ¿Qué es la incertidumbre de una medición?

- ¿Puede la inteligencia artificial ayudar con la teoría de errores?

Tipos de Errores Identificados por la Teoría de Errores

Para abordar eficazmente las imprecisiones, la teoría de errores clasifica las desviaciones en categorías distintas, cada una con sus propias características, causas y métodos de mitigación.

Errores Sistemáticos

Estos son los errores más insidiosos porque se repiten de manera consistente y predecible, afectando todas las mediciones en una misma dirección. Los errores sistemáticos distorsionan los resultados de forma constante, lo que significa que el valor medido siempre será mayor o menor que el valor verdadero en una cantidad fija o proporcional. Sus causas suelen ser identificables y controlables:

- Instrumentación: Un instrumento mal calibrado es un ejemplo clásico. Si una regla está fabricada con una marca inicial desplazada, todas las mediciones con esa regla serán sistemáticamente erróneas. De igual forma, una balanza que siempre muestra un kilogramo de más generará un error constante en cada pesaje.

- Observación: Errores personales debido a hábitos del observador. Por ejemplo, el error de paralaje, donde la lectura de una escala varía según el ángulo de visión del experimentador.

- Método: Un diseño experimental defectuoso o una técnica incorrecta pueden introducir errores sistemáticos. Por ejemplo, si al medir la temperatura, el termómetro se coloca en un lugar donde la corriente de aire constante lo enfría artificialmente.

- Ambientales: Condiciones del entorno que permanecen constantes durante el experimento pero afectan la medición. La expansión o contracción de materiales debido a una temperatura ambiente constante pero no considerada, o la influencia de un campo magnético cercano.

Identificar y corregir los errores sistemáticos es crucial, ya que no pueden ser reducidos simplemente repitiendo las mediciones. Requieren una recalibración, un cambio en el método o la corrección de las condiciones ambientales.

Errores Aleatorios

A diferencia de los sistemáticos, los errores aleatorios varían de manera impredecible de una medición a otra. Son el resultado de factores incontrolables y fluctuaciones sutiles que afectan los resultados en cualquier dirección, tanto aumentando como disminuyendo el valor medido. Su naturaleza es estocástica, lo que significa que no se pueden predecir con exactitud, pero sí se pueden analizar estadísticamente. Algunas de sus causas incluyen:

- Fluctuaciones Naturales: Pequeñas variaciones en la temperatura, presión o humedad del ambiente que no son constantes sino que oscilan.

- Limitaciones del Instrumento: La resolución inherente de un instrumento. Incluso los equipos más avanzados tienen un límite de precisión más allá del cual las lecturas mostrarán pequeñas variaciones.

- Variaciones en la Observación: Pequeñas e incontrolables variaciones en la habilidad del observador, como el tiempo de reacción al iniciar o detener un cronómetro.

- Ruido: Interferencias eléctricas o vibraciones mecánicas que pueden afectar la lectura de un sensor.

Los errores aleatorios no pueden eliminarse, pero su impacto puede ser minimizado mediante la repetición de mediciones y el uso de métodos estadísticos para promediar los resultados, ya que tienden a cancelarse entre sí a lo largo de un gran número de ensayos.

Errores Graves (Valores Atípicos)

También conocidos como valores atípicos o errores burdos, estos se distinguen por ser desviaciones muy grandes e inesperadas de los resultados esperados. Generalmente, son el resultado de un descuido significativo o un fallo repentino durante el proceso de medición. Pueden ser causados por:

- Error Humano: Una lectura incorrecta de un instrumento, un error de transcripción al registrar datos, un cálculo erróneo o un procedimiento experimental mal ejecutado.

- Fallo del Equipo: Una falla momentánea de un sensor o un cable suelto que produce una lectura anómala.

- Eventos Externos Inesperados: Una interrupción repentina, un golpe accidental al equipo o un pico de energía imprevisto.

Identificar y, si está justificado, descartar estos errores es crucial para mantener la integridad de los datos. No hacerlo puede distorsionar significativamente los promedios y las conclusiones extraídas de un experimento. Su detección a menudo se realiza mediante la inspección visual de los datos o el uso de pruebas estadísticas específicas para valores atípicos.

La Importancia Fundamental de la Teoría de Errores en la Ciencia y la Técnica

La relevancia de la teoría de errores trasciende la mera curiosidad académica; es una piedra angular para cualquier campo que dependa de la medición y la experimentación. Su importancia radica en varios pilares:

- Confianza y Validez de los Resultados: Permite cuantificar la confiabilidad de las mediciones. Un resultado sin un margen de error asociado es incompleto y, en muchos casos, engañoso. La teoría de errores nos da la incertidumbre de nuestras mediciones, que es la cuantificación de la duda sobre el valor verdadero.

- Reproducibilidad Experimental: Ayuda a otros investigadores a replicar experimentos y verificar resultados. Si se conocen los márgenes de error, se pueden comparar los resultados de diferentes laboratorios de manera significativa.

- Toma de Decisiones Informada: En ingeniería y desarrollo de productos, entender los errores ayuda a diseñar sistemas más robustos y seguros, a establecer tolerancias de fabricación y a predecir el rendimiento.

- Optimización de Procesos: Al identificar las fuentes de errores sistemáticos y aleatorios, se pueden mejorar los métodos experimentales y la instrumentación, llevando a mediciones más precisas y eficientes.

- Diferenciación entre Efectos Reales y Ruido: Permite distinguir si una variación observada en los datos es un efecto real del fenómeno estudiado o simplemente una fluctuación aleatoria inherente al proceso de medición.

Herramientas y Métodos para el Manejo de Errores

La teoría de errores no solo clasifica los errores, sino que también proporciona un arsenal de herramientas matemáticas y estadísticas para su manejo y cuantificación.

Repetición de Mediciones y el Promedio

Una de las formas más simples y efectivas de reducir el impacto de los errores aleatorios es repetir la medición varias veces. Al tomar múltiples lecturas de la misma magnitud y calcular su promedio (media aritmética), se espera que los errores aleatorios, al variar en direcciones impredecibles, tiendan a cancelarse entre sí. El promedio de un gran número de mediciones suele ser una estimación más precisa del valor verdadero que cualquier medición individual.

Desviación Estándar y Varianza

Para cuantificar la dispersión de los datos alrededor del promedio, se utilizan la desviación estándar y la varianza. La desviación estándar es una medida de la variabilidad de un conjunto de datos. Un valor bajo indica que los puntos de datos tienden a estar muy cerca del valor medio, mientras que un valor alto indica que los puntos de datos están dispersos en un rango más amplio. Es una herramienta fundamental para estimar el error aleatorio de una serie de mediciones. La varianza es simplemente el cuadrado de la desviación estándar.

Cálculo de la Incertidumbre

La incertidumbre es una estimación del rango dentro del cual se espera que se encuentre el valor verdadero de una magnitud medida, con un cierto nivel de confianza. Se deriva de los errores aleatorios y, cuando es posible, de la corrección de errores sistemáticos conocidos. No es un 'error' en el sentido de equivocación, sino una expresión de la duda que existe sobre el resultado. Se expresa comúnmente como un valor más/menos (±) junto con la medición (por ejemplo, 10.5 ± 0.2 cm), indicando el intervalo de confianza.

Propagación de Errores

Cuando se realizan cálculos utilizando magnitudes que ya tienen su propia incertidumbre (por ejemplo, si se mide el largo y el ancho de una mesa, y luego se calcula su área), los errores de las mediciones individuales se combinan y afectan la incertidumbre del resultado final. La propagación de errores es el conjunto de reglas matemáticas que permite calcular la incertidumbre del resultado de una función basada en las incertidumbres de sus variables de entrada. Esto es crucial en cualquier cálculo complejo donde la precisión del resultado depende de la precisión de varias mediciones.

Calibración y Control Ambiental

Para mitigar los errores sistemáticos, la calibración regular de los instrumentos es esencial. Esto implica comparar la lectura del instrumento con un estándar conocido y ajustar el instrumento para que sus lecturas sean correctas. Además, mantener un control estricto sobre las condiciones ambientales (temperatura, humedad, presión, vibraciones) durante el experimento ayuda a minimizar las fuentes de error sistemático y aleatorio.

Tabla Comparativa de Tipos de Errores

| Característica | Errores Sistemáticos | Errores Aleatorios | Errores Graves |

|---|---|---|---|

| Causa Principal | Defectos de instrumento, calibración, método, ambiente constante, sesgo personal. | Fluctuaciones impredecibles, limitaciones de resolución del instrumento, variaciones sutiles del entorno. | Error humano, fallas inesperadas del equipo, eventos externos disruptivos. |

| Efecto en Resultados | Desviación consistente en una dirección (siempre alto o siempre bajo). | Dispersión aleatoria de resultados alrededor del valor verdadero, sin patrón fijo. | Desviación extrema y aislada de lo esperado, un valor atípico. |

| Predecibilidad | Predecibles y repetibles, se manifiestan de la misma forma en cada medición. | Impredecibles, variables de una medición a otra. | Esporádicos, aislados, no recurrentes de forma predecible. |

| Detección | Comparación con estándares conocidos, cambio de método o instrumento, análisis de gráficos de residuos. | Repetición de mediciones, cálculo de la desviación estándar, observación de la dispersión de los datos. | Inspección visual de los datos, pruebas estadísticas para valores atípicos (ej. criterio de Chauvenet). |

| Mitigación | Calibración del equipo, corrección del método experimental, control o compensación de las condiciones ambientales. | Realización de múltiples mediciones y cálculo del promedio, mejora de la instrumentación o técnica para reducir fluctuaciones. | Extremo cuidado en la ejecución, doble verificación de datos y procedimientos, descarte justificado de la medición si se identifica la causa del error. |

Ejemplos Prácticos de Aplicación de la Teoría de Errores

La relevancia de la teoría de errores se manifiesta en innumerables campos, impactando directamente la fiabilidad de los resultados y la seguridad de las aplicaciones.

Ingeniería Aeroespacial

En el lanzamiento de cohetes y satélites, la precisión es absoluta. Cada pequeña imprecisión en las mediciones de trayectoria, velocidad, consumo de combustible o propiedades de los materiales puede tener consecuencias catastróficas. Los ingenieros aeroespaciales utilizan la teoría de errores para analizar las incertidumbres de cada sensor (acelerómetros, giroscopios, GPS), la propagación de estas incertidumbres a través de los complejos algoritmos de navegación, y para diseñar márgenes de seguridad. Esto les permite predecir y compensar desviaciones, asegurando que el cohete llegue a su destino previsto con la mayor exactitud posible.

Meteorología y Climatología

Los meteorólogos se enfrentan constantemente a la variabilidad. Al medir la velocidad del viento, la temperatura, la presión atmosférica o la humedad, utilizan instrumentos sujetos a errores sistemáticos (por calibración) y aleatorios (por ráfagas inesperadas o microfluctuaciones atmosféricas). La teoría de errores les permite comprender la precisión de sus datos y ajustar sus modelos predictivos para obtener estimaciones más fiables del clima. Esto es crucial no solo para los pronósticos diarios, sino también para los modelos climáticos a largo plazo, donde las pequeñas incertidumbres en las mediciones de gases de efecto invernadero pueden llevar a grandes variaciones en las proyecciones futuras.

Medicina y Farmacología

En el ámbito médico, la precisión en las mediciones es vital para la seguridad del paciente. La dosificación de medicamentos, por ejemplo, debe ser extremadamente precisa. La teoría de errores se aplica para garantizar que las balanzas utilizadas para pesar principios activos estén correctamente calibradas (evitando errores sistemáticos) y que las mediciones repetidas tengan una variabilidad mínima (controlando errores aleatorios). De igual modo, en los diagnósticos, la fiabilidad de las pruebas de laboratorio (como análisis de sangre o resonancias magnéticas) se evalúa utilizando conceptos de error, asegurando que los resultados sean suficientemente precisos para tomar decisiones clínicas correctas.

Aplicaciones Empresariales e Industriales de la Teoría de Errores

Más allá de la ciencia pura, la teoría de errores tiene un impacto significativo en el mundo empresarial, optimizando procesos y reduciendo costes.

Control de Calidad en Manufactura

En la fabricación, la teoría de errores es fundamental para el control de calidad. Ya sea produciendo componentes electrónicos, piezas de automóviles o alimentos procesados, las dimensiones, el peso, la pureza y otras características deben cumplir con especificaciones estrictas. Al entender los errores sistemáticos y errores aleatorios inherentes a las máquinas y procesos, las empresas pueden:

- Reducir Desperdicios: Identificar y corregir fuentes de error que llevan a productos defectuosos, minimizando el material y la energía desperdiciados.

- Mejorar la Consistencia del Producto: Asegurar que cada unidad producida cumpla con los estándares de calidad, aumentando la satisfacción del cliente y la reputación de la marca.

- Optimizar el Mantenimiento: Predecir cuándo los equipos necesitan recalibración o mantenimiento basándose en el análisis de la deriva sistemática de las mediciones.

Finanzas y Modelado Económico

Aunque no se trata de mediciones físicas directas, los modelos financieros y económicos se basan en datos que contienen incertidumbres. Los errores en los datos de entrada (por ejemplo, tasas de interés, precios históricos de acciones) pueden propagarse y amplificarse, llevando a predicciones erróneas o a evaluaciones de riesgo inexactas. La teoría de errores ayuda a los analistas a entender la fiabilidad de sus modelos y a cuantificar el rango de resultados posibles, lo que es crucial para la toma de decisiones de inversión y la gestión de riesgos.

Investigación y Desarrollo (I+D)

En I+D, la validación de nuevas tecnologías o productos depende de experimentos precisos. Entender la teoría de errores permite a los equipos de I+D diseñar experimentos robustos, interpretar los resultados de manera fiable y determinar si una mejora observada es estadísticamente significativa o simplemente el resultado de variaciones aleatorias. Esto acelera el ciclo de innovación y reduce el riesgo de invertir en soluciones que no son realmente superiores.

Preguntas Frecuentes sobre la Teoría de Errores

¿Por qué es imposible evitar los errores en las mediciones?

Es imposible evitar los errores por varias razones inherentes a la naturaleza de la medición. Los instrumentos tienen una resolución y precisión limitadas, el entorno siempre presenta fluctuaciones (temperatura, vibraciones, ruido), y los observadores humanos tienen limitaciones. Además, el mismo acto de medir a menudo interfiere ligeramente con lo que se está midiendo. Estos factores combinados garantizan que siempre habrá una diferencia, por mínima que sea, entre el valor medido y el valor verdadero.

¿Cuál es la diferencia clave entre precisión y exactitud en el contexto de la teoría de errores?

La exactitud se refiere a cuán cerca está una medición del valor verdadero o aceptado. Una medición es exacta si tiene un error sistemático pequeño. La precisión, por otro lado, se refiere a cuán cerca están entre sí un conjunto de mediciones repetidas. Una medición es precisa si tiene un error aleatorio pequeño. Es posible ser preciso pero no exacto (todas las mediciones están cerca entre sí, pero lejos del valor verdadero debido a un error sistemático), o ser exacto pero no preciso (las mediciones promedian el valor verdadero, pero están muy dispersas).

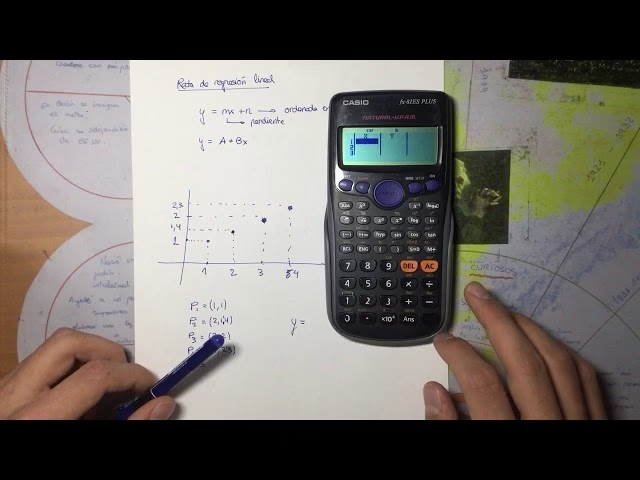

¿Cómo se utiliza una calculadora en la teoría de errores?

Una calculadora es fundamental para aplicar la teoría de errores. Se utiliza para calcular promedios (medias), desviaciones estándar, varianzas y para realizar la propagación de errores a través de fórmulas matemáticas. Las calculadoras científicas y las herramientas de software (como hojas de cálculo o programas estadísticos) permiten manejar grandes conjuntos de datos, realizar cálculos complejos de incertidumbre y visualizar la dispersión de los datos, lo que facilita la cuantificación y el análisis de los errores.

¿Qué es la incertidumbre de una medición?

La incertidumbre de una medición es la cuantificación de la duda sobre el resultado de una medición. No es un 'error' en el sentido de equivocación, sino un parámetro que caracteriza la dispersión de los valores que podrían atribuirse razonablemente al mensurando. Se expresa típicamente como un intervalo de confianza (por ejemplo, ± un valor), indicando el rango dentro del cual se espera que se encuentre el valor verdadero con una cierta probabilidad.

¿Puede la inteligencia artificial ayudar con la teoría de errores?

Sí, la inteligencia artificial (IA) puede complementar y potenciar la aplicación de la teoría de errores. Algoritmos de aprendizaje automático pueden ser entrenados para identificar patrones en grandes conjuntos de datos de mediciones, lo que podría ayudar a detectar errores sistemáticos sutiles o a identificar valores atípicos de manera más eficiente. Además, la IA puede optimizar la calibración de instrumentos, predecir el rendimiento de sistemas complejos bajo incertidumbre y mejorar la modelización de la propagación de errores en sistemas dinámicos, llevando a una mayor precisión y fiabilidad en los análisis.

En resumen, la Teoría de Errores es mucho más que un concepto matemático abstracto; es una habilidad práctica indispensable para cualquiera que trabaje con datos y mediciones. Nos enseña a ver la imperfección no como un obstáculo insuperable, sino como una característica inherente que podemos entender y gestionar. Dominar esta teoría no solo mejora la calidad y la confiabilidad de nuestros proyectos y experimentos, sino que también fomenta un pensamiento crítico y una comprensión más profunda de la realidad física. En un mundo cada vez más impulsado por datos, la capacidad de evaluar la precisión y la exactitud de la información es una ventaja inestimable, asegurando que nuestras conclusiones sean sólidas y nuestras decisiones, informadas.

Si quieres conocer otros artículos parecidos a Teoría de Errores en Física: Midiendo lo Impreciso puedes visitar la categoría Cálculos.