22/04/2024

En el vasto universo de las matemáticas aplicadas, la búsqueda de máximos y mínimos es un problema recurrente. Sin embargo, a menudo nos encontramos con situaciones donde esta optimización no es libre, sino que debe realizarse bajo ciertas condiciones o restricciones. Aquí es donde el ingenioso Método de los Multiplicadores de Lagrange emerge como una herramienta fundamental, permitiéndonos resolver problemas de optimización que, de otro modo, serían extraordinariamente complejos. Este método, desarrollado por el brillante matemático Joseph-Louis de Lagrange, transforma un problema de optimización restringida en uno sin restricciones, simplificando drásticamente su resolución. Prepárese para desentrañar los principios, la lógica y las aplicaciones prácticas de esta técnica indispensable en campos tan diversos como la economía, la física, la ingeniería y la ciencia de datos.

¿Qué es el Método de los Multiplicadores de Lagrange?

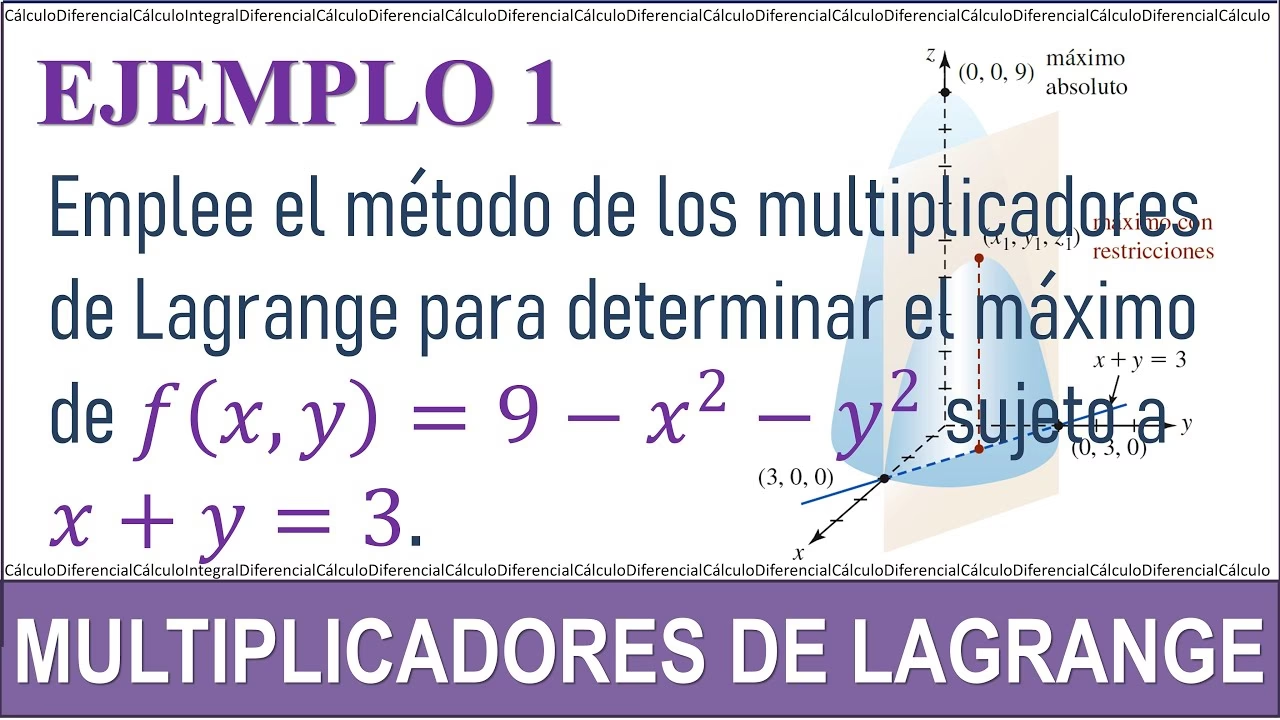

Imaginemos que deseamos encontrar el punto más alto de una montaña (maximizar una función de altura) pero con la condición de que debemos permanecer sobre un sendero específico (una restricción). El Método de Lagrange aborda este tipo de escenarios. En términos matemáticos, si tenemos una función, f(x, y), que queremos maximizar o minimizar, sujeta a una condición g(x, y) = c (donde c es una constante), este método nos proporciona una vía sistemática para hallarlos.

La clave reside en la visualización geométrica. Pensemos en las curvas de nivel de la función f (líneas donde f tiene un valor constante) y el contorno definido por la restricción g = c. Generalmente, la curva de la restricción cruzará muchas de las curvas de nivel de f. Al movernos a lo largo de la curva de g, el valor de f cambiará. Sin embargo, en los puntos donde f alcanza un extremo local (máximo o mínimo) bajo la restricción de g, la curva de g tocará tangencialmente (no cortará) una curva de nivel de f. En estos puntos críticos, los vectores gradientes paralelos de f y g serán colineales.

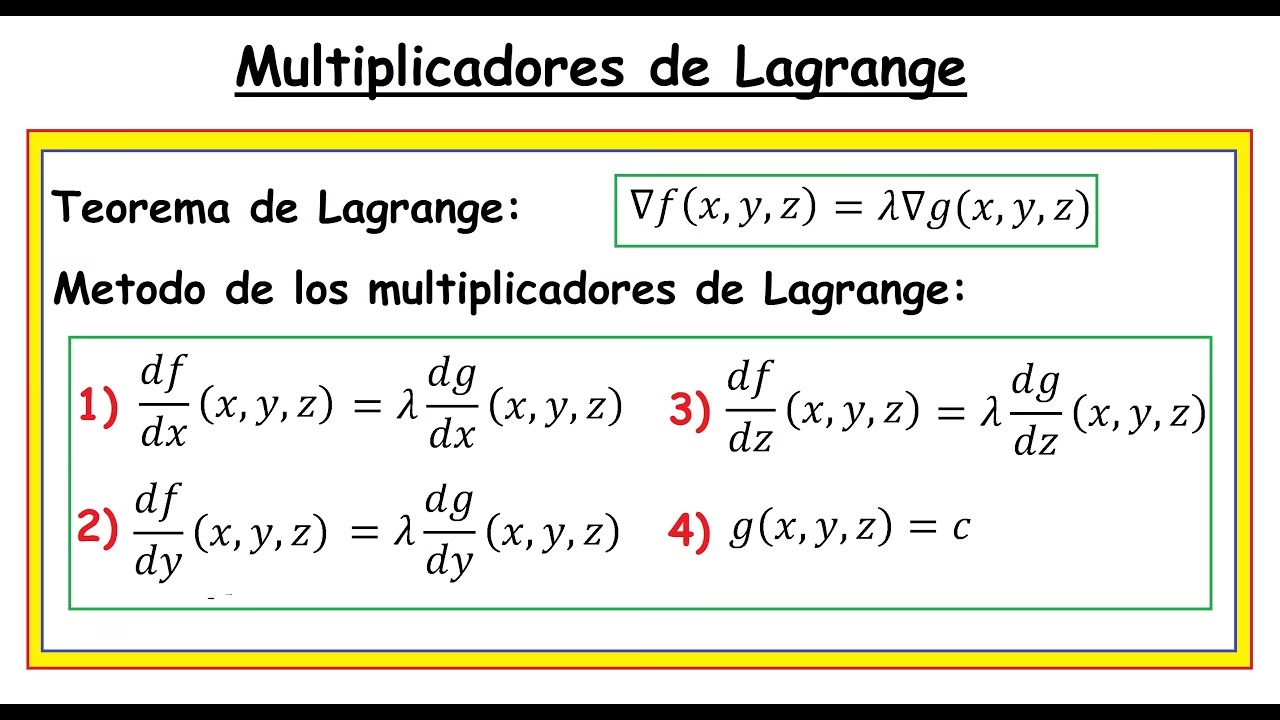

Este paralelismo se expresa matemáticamente introduciendo un nuevo escalar, λ (lambda), conocido como el multiplicador de Lagrange. La condición de tangencia se traduce en la ecuación vectorial ∇f(x, y) = λ∇g(x, y). Al combinar esta ecuación con la restricción original g(x, y) = c, formamos un sistema de ecuaciones que nos permite encontrar los puntos críticos. De manera alternativa y más general, se construye una nueva función auxiliar, F(x, y, λ) o h(x, λ), que incorpora tanto la función a optimizar como la restricción:

F(x, y, λ) = f(x, y) - λ(g(x, y) - c)

O, de forma más general para múltiples restricciones:

h(x, λ) = f(x) + Σk=1s λkgk(x)

Donde x representa el vector de variables (x1, ..., xn) y λ el vector de multiplicadores (λ1, ..., λs). Los puntos críticos se encuentran resolviendo el sistema de ecuaciones resultante de igualar a cero las derivadas parciales de esta función auxiliar con respecto a todas sus variables (x, y, y λ, o xi y λk).

La Formulación Matemática y Su Lógica

La elegancia del método de Lagrange reside en su fundamento geométrico y analítico. Consideremos la función auxiliar h(x, λ) definida como:

h(x, λ) = f(x) + Σk=1s λkgk(x)

Para encontrar los puntos críticos, debemos igualar a cero todas las derivadas parciales de h:

∂h / ∂xi = 0 para cada variable xi

∂h / ∂λk = 0 para cada multiplicador λk

La segunda condición, ∂h / ∂λk = gk(x) = 0, simplemente nos devuelve las restricciones originales, asegurando que cualquier solución encontrada satisfaga las condiciones impuestas. La primera condición es la que revela la relación fundamental entre los gradientes:

∂f / ∂xi = - Σk=1s λk (∂gk / ∂xi)

Esto es equivalente a:

∇f = - Σk=1s λk ∇gk

O, más comúnmente presentado como ∇f = Σk=1s λk ∇gk (el signo del multiplicador λ no altera el resultado final, ya que λ puede ser positivo o negativo).

Demostración Geométrica

Para entender por qué esta condición de los gradientes es crucial, consideremos el caso de una sola restricción, g(x) = c. Si p es un punto crítico en la superficie M definida por g(x) = c, entonces cualquier pequeño desplazamiento en una dirección tangente a M en p no debe cambiar el valor de f a primer orden. Esto significa que el gradiente de f, ∇f, debe ser perpendicular a cualquier vector tangente a M en p.

Dado que M es una superficie de nivel de g, su gradiente, ∇g, es perpendicular a la superficie M en cada punto. Por lo tanto, si ∇f es perpendicular a todos los vectores tangentes a M en p, y ∇g también lo es, entonces ∇f y ∇g deben ser paralelos. Esta relación de paralelismo se expresa mediante la existencia de un escalar λ tal que:

∇f = λ∇g

Cuando tenemos múltiples restricciones, g1(x) = c1, ..., gs(x) = cs, el conjunto de vectores perpendiculares a la superficie de la restricción en p es generado por los gradientes de todas las funciones de restricción: ∇g1, ..., ∇gs. Por lo tanto, el gradiente de f en un punto crítico debe ser una combinación lineal de estos gradientes:

∇f = λ1∇g1 + λ2∇g2 + ... + λs∇gs

Los valores de los multiplicadores de Lagrange (λk) se determinan simultáneamente con las variables xi al resolver el sistema de ecuaciones. Este enfoque permite que la optimización de f se realice mientras se satisfacen rigurosamente las restricciones.

Aplicaciones Prácticas y Ejemplos Resueltos

El método de Lagrange es increíblemente versátil. A continuación, exploraremos algunos ejemplos clásicos que ilustran su poder y aplicabilidad en diferentes contextos.

Ejemplo 1: Maximización de la Entropía

Imaginemos que queremos encontrar la distribución de probabilidad discreta con máxima entropía. La función de entropía de Shannon para una distribución de probabilidades p1, p2, ..., pn es:

f(p1, p2, ..., pn) = - Σk=1n pk log2(pk)

La restricción fundamental para cualquier distribución de probabilidad es que la suma de todas las probabilidades debe ser igual a 1:

g(p1, p2, ..., pn) = Σk=1n pk = 1

Aplicando el método de Lagrange, formamos la función auxiliar y tomamos las derivadas parciales con respecto a cada pk y a λ:

∂/∂pk (f + λ(g - 1)) = ∂/∂pk (- Σ pk log2(pk) + λ Σ pk - λ) = 0

Esto nos lleva a:

- (1/ln(2) + log2(pk)) + λ = 0

Esta ecuación implica que todos los pk deben ser iguales. Usando la restricción Σpk = 1, encontramos que pk = 1/n. Esto demuestra que la distribución uniforme discreta es la que posee la mayor entropía, un resultado fundamental en la teoría de la información.

Ejemplo 2: Puntos más Cercanos en una Esfera

Consideremos el problema de determinar los puntos en la esfera x2 + y2 + z2 = 4 que están más cercanos (o más lejanos) al punto (3, 1, -1).

La función a minimizar (o maximizar) es la distancia, pero para simplificar los cálculos, trabajamos con el cuadrado de la distancia:

f(x, y, z) = (x - 3)2 + (y - 1)2 + (z + 1)2

La restricción es la ecuación de la esfera:

g(x, y, z) = x2 + y2 + z2 = 4

Establecemos las ecuaciones de Lagrange (∇f = λ∇g y la restricción g=4):

1. 2(x - 3) = 2xλ

2. 2(y - 1) = 2yλ

3. 2(z + 1) = 2zλ

4. x2 + y2 + z2 = 4

De las ecuaciones (1), (2) y (3), podemos expresar x, y, z en función de λ (asumiendo λ ≠ 1, lo cual es cierto):

x = 3 / (1 - λ)

y = 1 / (1 - λ)

z = -1 / (1 - λ)

Sustituyendo estos valores en la ecuación (4):

(3/(1-λ))2 + (1/(1-λ))2 + (-1/(1-λ))2 = 4

Resolviendo para λ, obtenemos λ = 1 ± √(11)/2. Sustituyendo estos valores de λ de nuevo en las expresiones para x, y, z, obtenemos dos puntos:

- Punto 1:

(6/√11, 2/√11, -2/√11) - Punto 2:

(-6/√11, -2/√11, 2/√11)

Evaluando la función de distancia cuadrada en estos puntos, determinamos que el primer punto es el más cercano a (3, 1, -1), mientras que el segundo es el más lejano.

Ejemplo 3: Optimización con Múltiples Restricciones

Este ejemplo demuestra cómo manejar más de una restricción. Sea la función a optimizar:

f(x, y, z) = xy + yz

Con las restricciones:

g(x, y, z) = xy - 1 = 0

h(x, y, z) = y2 + z2 - 1 = 0

La ecuación de Lagrange generalizada es ∇f = λ∇g + μ∇h, donde λ y μ son los multiplicadores de Lagrange. Calculamos los gradientes:

∇f = (y, z + x, y)

∇g = (y, x, 0)

∇h = (0, 2y, 2z)

El sistema de ecuaciones resultante es:

1. y = λy

2. z + x = λx + 2μy

3. y = 2μz

4. xy = 1 (restricción g)

5. y2 + z2 = 1 (restricción h)

De la ecuación (1), si y ≠ 0 (lo cual es cierto por la restricción 4), entonces λ = 1. Sustituyendo λ = 1 en la ecuación (2), obtenemos z + x = x + 2μy, lo que simplifica a z = 2μy. De la ecuación (3), y = 2μz. Sustituyendo z en esta última ecuación, tenemos y = 2μ(2μy) = 4μ2y. Dado que y ≠ 0, podemos dividir por y, obteniendo 4μ2 = 1, lo que implica μ = ±1/2.

Ahora, usando z = 2μy, obtenemos z = ±y. Sustituyendo esto en la restricción (5): y2 + (±y)2 = 1, lo que da 2y2 = 1, y por lo tanto y = ±1/√2. Con xy=1, podemos encontrar x, y con y=±z, encontramos z.

Los puntos críticos son:

(√2, 1/√2, 1/√2)(√2, 1/√2, -1/√2)(-√2, -1/√2, 1/√2)(-√2, -1/√2, -1/√2)

Evaluando f(x, y, z) en estos puntos:

f(√2, 1/√2, 1/√2) = f(-√2, -1/√2, -1/√2) = 3/2(Máximos)f(√2, 1/√2, -1/√2) = f(-√2, -1/√2, 1/√2) = 1/2(Mínimos)

Así, hemos identificado los puntos donde la función alcanza sus extremos bajo las dos restricciones dadas.

Criterio de la Segunda Derivada para Extremos con Restricción

Una vez que hemos encontrado los puntos críticos utilizando el método de Lagrange, surge una pregunta crucial: ¿es este punto un máximo, un mínimo o un punto silla bajo la restricción? Similar al caso de optimización sin restricciones, donde se utiliza la matriz Hessiana, existe un método análogo para determinar la naturaleza de estos puntos en el contexto de la optimización restringida.

El Caso Bidimensional

Para funciones f(x,y) y g(x,y) de clase C2 (dos veces continuamente diferenciables), y un punto crítico v0 donde g(v0) = c y ∇f(v0) = λ∇g(v0) con ∇g(v0) ≠ 0, construimos la matriz hessiana limitada (o matriz Hessiana orlada):

H = | 0 -∂g/∂x -∂g/∂y | | -∂g/∂x ∂2h/∂x2 ∂2h/∂y∂x | | -∂g/∂y ∂2h/∂x∂y ∂2h/∂y2 | Donde h = f - λg (o h = f + λg, el signo no afecta la segunda derivada, solo el valor de λ). El determinante de esta matriz nos da la información necesaria:

- Si

|H| > 0, entonces v0 es un máximo local para f limitada a S (la curva de nivel de g). - Si

|H| < 0, entonces v0 es un mínimo local para f limitada a S. - Si

|H| = 0, el criterio no es concluyente.

El Caso n-Dimensional

La generalización a n dimensiones con una sola restricción sigue un patrón similar. La matriz Hessiana limitada se expande para incluir todas las variables:

H = | 0 -∂g/∂x1 -∂g/∂x2 ... -∂g/∂xn | | -∂g/∂x1 ∂2h/∂x12 ∂2h/∂x1∂x2 ... ∂2h/∂x1∂xn | | -∂g/∂x2 ∂2h/∂x1∂x2 ∂2h/∂x22 ... ∂2h/∂x2∂xn | | ... ... ... ... ... | | -∂g/∂xn ∂2h/∂x1∂xn ∂2h/∂x2∂xn ... ∂2h/∂xn2 | Para determinar la naturaleza de v0, examinamos los determinantes de las submatrices principales de orden mayor o igual a 3 (los menores principales del borde):

- Si todos los subdeterminantes de orden

(s+k) x (s+k)(donde s es el número de restricciones, y k va de 1 a n-s) son menores que cero (siempre que se cumpla el patrón de signos alternos si n-s es impar), tenemos un mínimo local en v0. - Si el primer subdeterminante (3x3) es mayor que cero, el siguiente (4x4) es menor que cero, y así sucesivamente (alternando su signo), tenemos un máximo local en v0.

- Si todos los subdeterminantes son distintos de cero pero no siguen ninguno de los patrones anteriores, el punto es un punto silla.

- Si algún subdeterminante es cero, o no sigue los patrones, el criterio no es concluyente.

Es importante notar que este criterio puede ser complejo de aplicar en la práctica para dimensiones muy altas, pero es fundamental para la comprensión teórica de la optimización restringida.

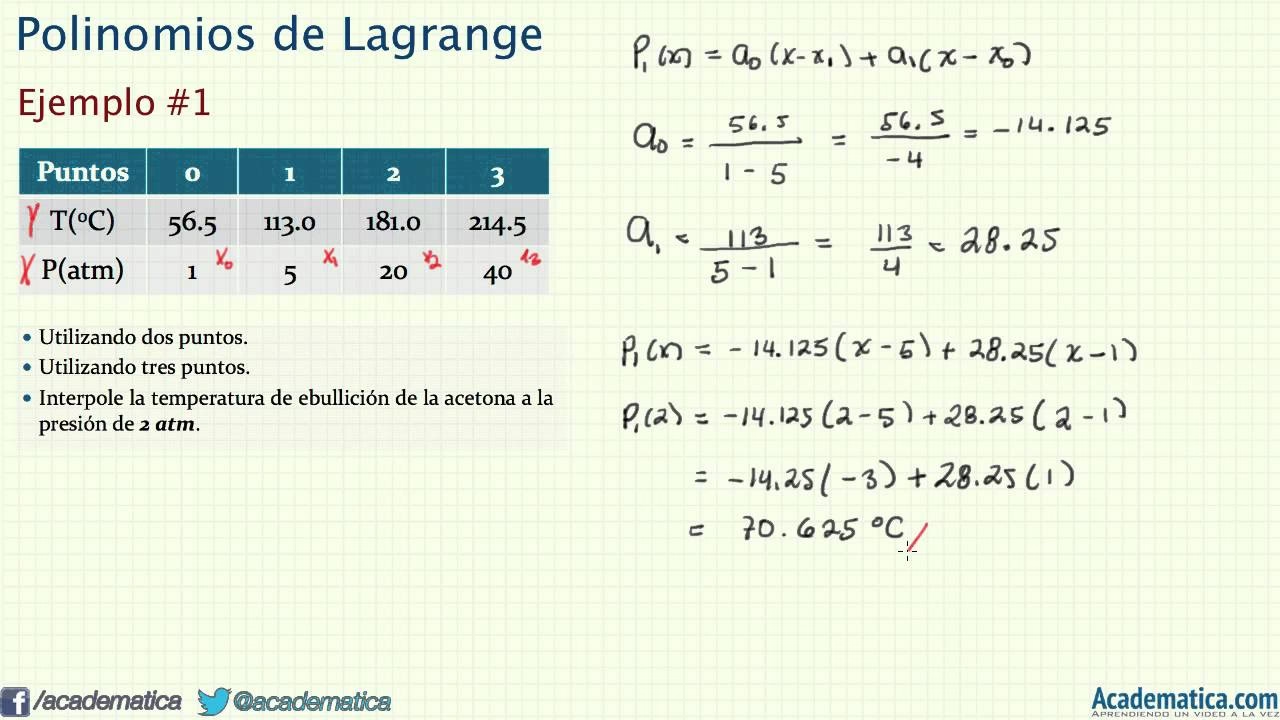

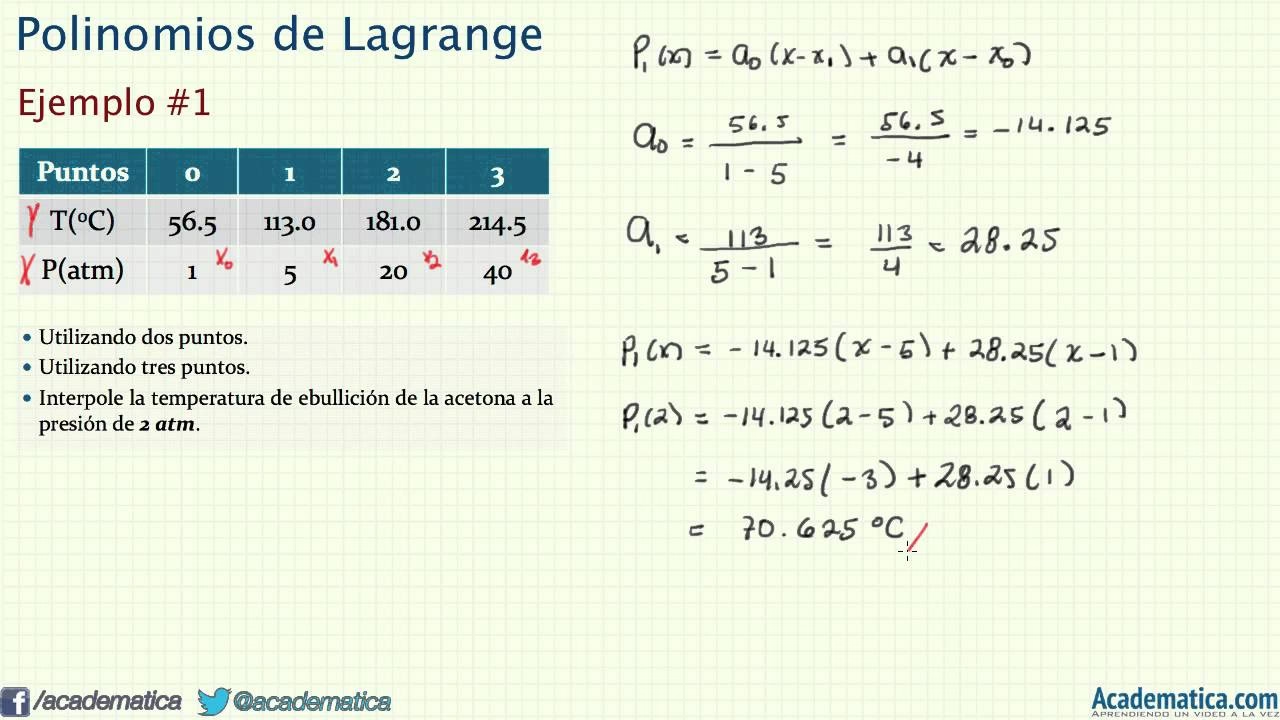

¿Para Qué Sirve el Polinomio de Lagrange?

Aunque lleva el mismo nombre de su creador, el "Polinomio de Lagrange" se refiere a una aplicación diferente del trabajo de Joseph-Louis de Lagrange. No se utiliza para la optimización restringida, sino para un problema fundamental en análisis numérico: la interpolación.

La interpolación de Lagrange es un método eficaz para construir un polinomio que pasa exactamente por un conjunto dado de puntos de datos. Esto es particularmente útil cuando se tiene una serie de puntos discretos y se necesita una función continua que los represente. Su principal ventaja radica en su simplicidad algorítmica y su capacidad para manejar espaciamientos variables entre los puntos de datos, lo que lo hace muy flexible en comparación con otros métodos de interpolación que requieren puntos equiespaciados.

Por ejemplo, si tenemos una tabla de valores (xi, yi) y queremos estimar un valor de y para un x que no está en la tabla, el polinomio de Lagrange nos permite construir un polinomio único de grado n-1 (si tenemos n puntos) que pasa por todos esos puntos. Este polinomio puede entonces usarse para la estimación.

Joseph-Louis de Lagrange: El Genio Detrás del Método

El método que hemos explorado es solo una de las muchas contribuciones monumentales de Joseph-Louis de Lagrange (1736-1813), una figura central en la historia de las matemáticas y la física del siglo XVIII y principios del XIX.

Nacido en Turín, Italia, el 25 de enero de 1736, Lagrange no mostró inicialmente una inclinación por las matemáticas. Sus intereses tempranos se inclinaban hacia la literatura clásica. Sin embargo, la lectura de una obra del astrónomo Edmund Halley a los diecisiete años encendió una pasión que lo transformó en un matemático consumado en un solo año de estudio intenso. Su genio precoz lo llevó a ser nombrado profesor de matemáticas en la Escuela Real de Artillería de Turín a una edad muy temprana, donde, a pesar de su timidez y pocas palabras, cautivaba la atención de sus alumnos y colegas.

En 1758, fundó una sociedad que eventualmente se convertiría en la Academia de Turín, un testimonio de su liderazgo y visión. A los diecinueve años, alcanzó la fama al resolver el "problema isoperimétrico", un desafío que había eludido a los matemáticos durante medio siglo. Su solución no solo resolvió el problema, sino que también sentó las bases de un nuevo campo: el cálculo de variaciones, que se convertiría en el tema central de su obra.

La admiración de gigantes como Euler y D'Alembert lo llevó a Berlín en 1766, donde sucedió a Euler en la Academia Prusiana de Ciencias, un puesto de inmensa prestigio. Durante veinte años en Prusia, produjo algunas de sus obras más destacadas, culminando en su obra maestra, la "Mécanique Analytique" (Mecánica Analítica). Publicada en Francia en 1788, esta obra fue revolucionaria por su enfoque puramente analítico, sin diagramas ni ilustraciones, y por unificar la mecánica clásica bajo un conjunto de principios variacionales. Se dice que Lagrange se propuso reducir la mecánica a un área de las matemáticas, "a simples operaciones de análisis", y lo logró con creces.

A pesar de un período de melancolía y desinterés por las matemáticas tras la muerte de Federico el Grande y su traslado a París en 1787, la Revolución Francesa y sus consecuencias lo revitalizaron. Desempeñó un papel crucial en el desarrollo del sistema métrico decimal y fue profesor en la recién fundada École Normale y la École Polytechnique, donde sus conferencias fueron elogiadas por su claridad y perfección. Sus obras "Teoría de las funciones analíticas" y "Resolución de ecuaciones numéricas" surgieron de sus enseñanzas.

Lagrange era conocido por su aguda capacidad para detectar errores en el trabajo de otros, incluso en el de Newton, pero siempre con respeto. Era una persona modesta y austera, que encontraba la música un medio para concentrarse. Falleció en París el 10 de abril de 1813, dejando un legado imperecedero que continúa influyendo en la matemática y la física modernas. Su método de los multiplicadores de Lagrange es solo una muestra de su extraordinaria capacidad para simplificar y resolver problemas complejos, cimentando su lugar como uno de los más grandes matemáticos de todos los tiempos.

Preguntas Frecuentes (FAQ)

Aquí respondemos a algunas de las preguntas más comunes sobre el método de Lagrange y conceptos relacionados.

¿Qué es exactamente un multiplicador de Lagrange (λ)?

Un multiplicador de Lagrange, simbolizado generalmente por λ (lambda), es un escalar introducido en el método de Lagrange para ayudar a encontrar los puntos críticos de una función sujetos a una o más restricciones. Geométricamente, λ representa la proporcionalidad entre los gradientes de la función objetivo y las funciones de restricción en los puntos donde estas superficies son tangentes. En aplicaciones económicas, λ a menudo se interpreta como el "precio sombra" de la restricción, indicando cuánto cambiaría el valor óptimo de la función si la restricción se relajara marginalmente.

¿Cuándo se debe usar el método de Lagrange?

El método de Lagrange se utiliza cuando se necesita optimizar (encontrar máximos o mínimos) una función de varias variables, pero estas variables no son independientes, sino que están sujetas a una o más ecuaciones de restricción. Es ideal para problemas donde la sustitución directa de las restricciones en la función objetivo es difícil o imposible, o cuando se desea una solución que revele la relación entre la función y sus restricciones a través de los multiplicadores.

¿El método de Lagrange solo sirve para encontrar máximos?

No, el método de Lagrange se utiliza para encontrar los "extremos" de una función, lo que incluye tanto máximos locales como mínimos locales, y en algunos casos, puntos silla. Una vez que se encuentran los puntos críticos, se requiere un análisis adicional (como el criterio de la segunda derivada con la matriz Hessiana limitada) para determinar si cada punto es un máximo, un mínimo o un punto silla bajo las restricciones dadas.

¿Cuál es la diferencia entre el Método de Lagrange y el Polinomio de Lagrange?

Aunque ambos conceptos llevan el nombre de Joseph-Louis de Lagrange, se aplican a problemas matemáticos completamente diferentes. El Método de los Multiplicadores de Lagrange es una técnica de cálculo diferencial para la optimización restringida de funciones de varias variables. Por otro lado, el Polinomio de Lagrange es una herramienta de interpolación en análisis numérico, utilizada para construir un polinomio que pasa por un conjunto dado de puntos de datos. Son dos ramas distintas del vasto legado matemático de Lagrange.

Si quieres conocer otros artículos parecidos a Desentrañando el Método de Multiplicadores de Lagrange puedes visitar la categoría Matemáticas.