23/09/2022

En el vasto universo de la estadística y el análisis de datos, las transformaciones juegan un papel crucial. Permiten manipular las variables para adaptarlas a diferentes propósitos, desde cambiar unidades de medida hasta prepararlas para modelos complejos. Entre todas las transformaciones posibles, la transformación lineal destaca por su simplicidad y por las propiedades predecibles que confiere a los datos. Comprender cómo funciona y, más importante aún, cómo afecta a las propiedades estadísticas de una variable, es fundamental para cualquier persona que trabaje con números.

Este artículo se adentrará en el corazón de la transformación lineal en estadística, desglosando su fórmula, explorando su impacto en las medidas clave de los datos como la media, la varianza y la desviación estándar, y discutiendo sus múltiples aplicaciones prácticas. Veremos por qué, a diferencia de otras transformaciones, la lineal mantiene intacta la forma de la distribución original, lo que la convierte en una herramienta potente y, a la vez, transparente para la interpretación de resultados.

- ¿Qué es una Transformación Lineal en Estadística?

- Impacto de la Transformación Lineal en las Propiedades Estadísticas

- Aplicaciones Prácticas de las Transformaciones Lineales

- Diferencia entre Transformaciones Lineales y No Lineales

- Tabla Comparativa: Efecto de la Transformación Lineal (X' = aX + b)

- Preguntas Frecuentes sobre la Transformación Lineal en Estadística

- ¿La transformación lineal cambia la forma de mi distribución de datos?

- ¿Afecta la transformación lineal la relación (correlación) entre dos variables?

- ¿Cuándo debo usar una transformación lineal?

- ¿Es lo mismo una transformación lineal que una transformación de función cualquiera (vertical, horizontal, estirada/comprimida)?

- ¿Qué pasa si 'a' es negativo en una transformación lineal?

- Conclusión

¿Qué es una Transformación Lineal en Estadística?

En el ámbito de la estadística, una transformación lineal se refiere a un tipo específico de cambio aplicado a una variable, donde la nueva variable resultante es una función lineal de la original. Si tenemos una variable original que denotamos como X, y aplicamos una transformación lineal, obtenemos una nueva variable, que llamaremos X'. La fórmula que describe esta relación es increíblemente sencilla pero poderosa:

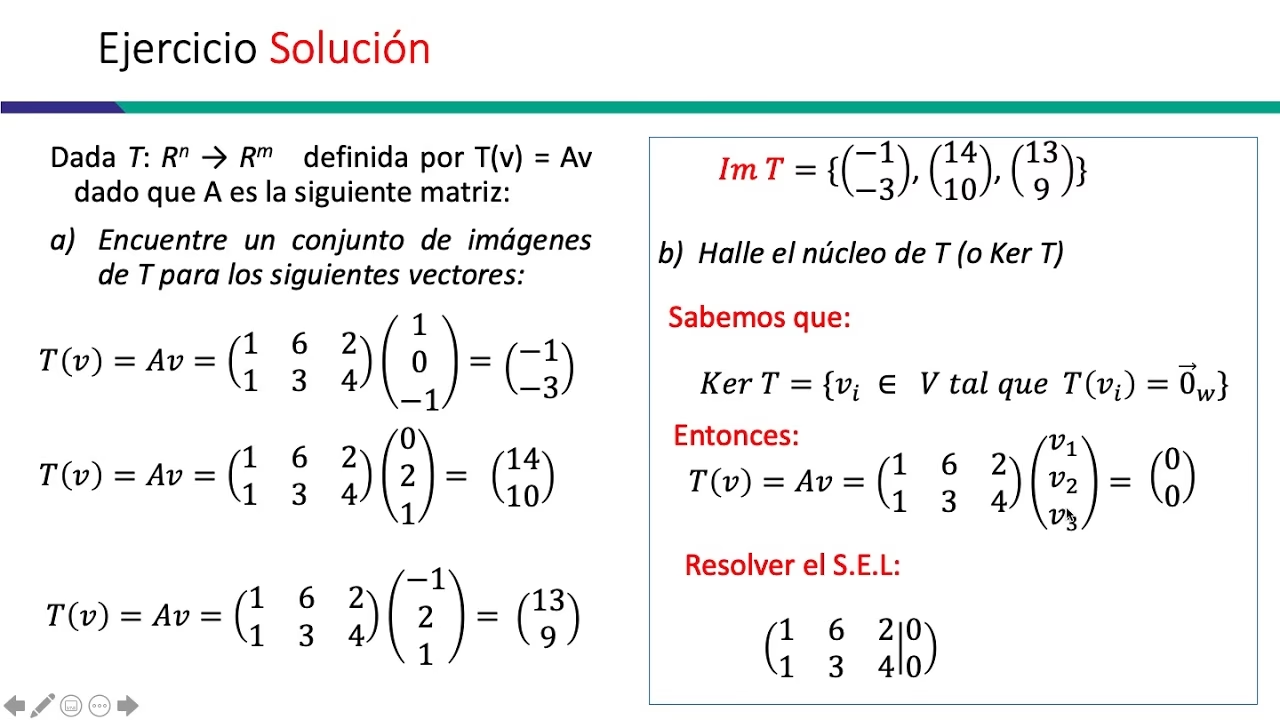

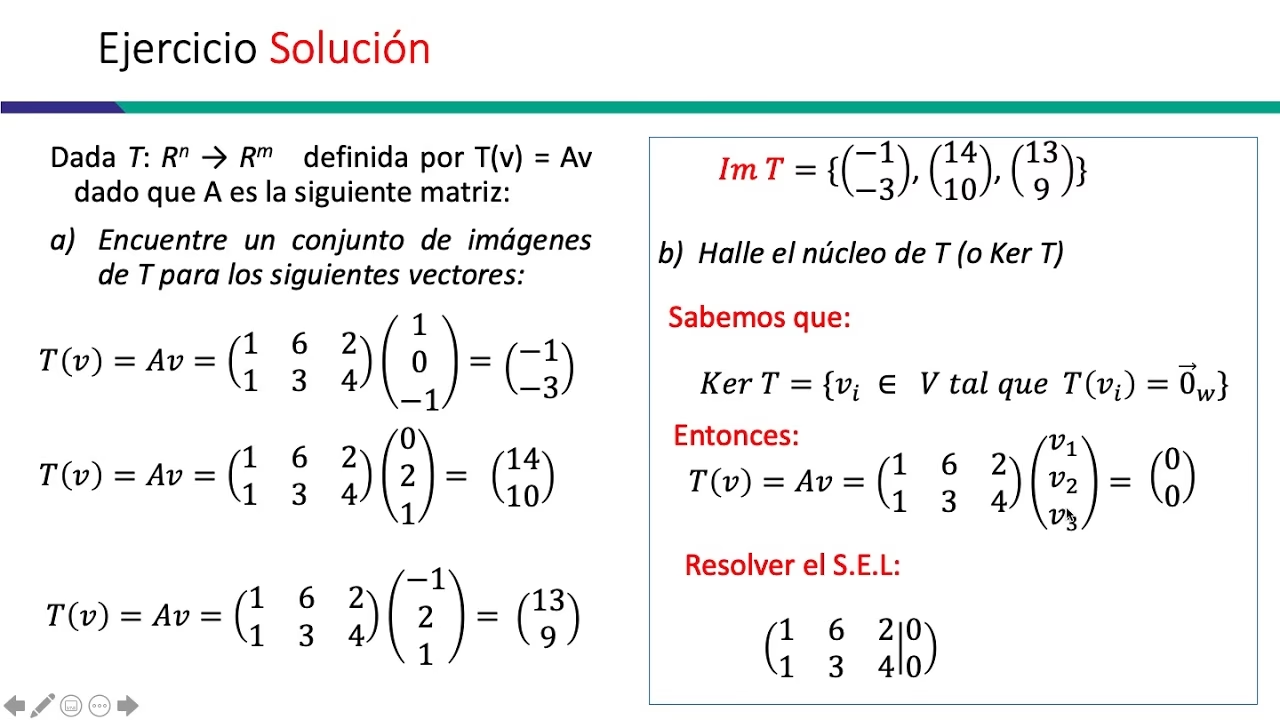

X' = aX + b

En esta expresión, 'a' y 'b' son constantes numéricas que definen la naturaleza de la transformación:

- 'a' (Componente Escalar o Multiplicativo): Este coeficiente se encarga de cambiar la escala de la variable. Si 'a' es mayor que 1, la variable se estira; si está entre 0 y 1, se comprime. Si 'a' es negativo, además de escalar, la variable se invierte. Es el factor que influye en la dispersión de los datos.

- 'b' (Componente Aditivo o de Traslación): Esta constante desplaza la variable completa a lo largo del eje numérico, ya sea hacia arriba (si 'b' es positivo) o hacia abajo (si 'b' es negativo). Es un factor de traslación que afecta la posición central de los datos sin alterar su dispersión.

Por ejemplo, si tenemos una variable X que representa la altura de las personas en metros, y queremos transformarla a centímetros, usaríamos a=100 y b=0, de modo que X' = 100X. Si luego quisiéramos ajustar todas las alturas sumando 5 centímetros por algún motivo, la transformación sería X'' = X' + 5, lo que en términos de la variable original X sería X'' = 100X + 5. La simplicidad de esta fórmula es engañosa, ya que sus implicaciones en las propiedades estadísticas son profundas y merecen un análisis detallado.

Impacto de la Transformación Lineal en las Propiedades Estadísticas

Una de las razones por las que las transformaciones lineales son tan valoradas en estadística es su efecto predecible y fácil de calcular en las medidas descriptivas clave de una distribución. A diferencia de las transformaciones no lineales, que pueden alterar drásticamente la forma y las relaciones de los datos, las lineales mantienen una estructura constante.

Efecto sobre la Media (Promedio)

La media, o valor esperado, es una medida de tendencia central que nos indica el 'centro' de nuestros datos. Cuando aplicamos una transformación lineal X' = aX + b a una variable X, la nueva media E[X'] se relaciona con la media original E[X] de la siguiente manera:

E[X'] = aE[X] + b

Esto significa que tanto el componente multiplicativo 'a' como el componente aditivo 'b' afectan directamente la nueva media. Si duplicamos los valores de una variable (a=2) y luego le sumamos 10 (b=10), la media de la nueva variable será el doble de la media original más 10. Esta relación es intuitiva: si todos los valores se escalan y se desplazan, el promedio de esos valores también lo hará de la misma manera.

Efecto sobre la Varianza y la Desviación Estándar

La varianza y la desviación estándar son medidas de dispersión que nos dicen cuán extendidos están los datos alrededor de su media. Aquí es donde las transformaciones lineales revelan una propiedad fundamental: el componente aditivo 'b' no tiene ningún efecto sobre la dispersión de los datos.

- Varianza: Si Var[X] es la varianza de la variable original X, la varianza de la variable transformada X' es:

Var[X'] = a²Var[X]

El término 'b' desaparece porque sumar una constante a todos los valores de una distribución simplemente los desplaza, pero no cambia su dispersión relativa. La distancia entre cualquier par de puntos sigue siendo la misma. Por lo tanto, solo el factor de escala 'a' afecta la varianza, y lo hace al cuadrado.

- Desviación Estándar: La desviación estándar es la raíz cuadrada de la varianza. Por lo tanto, si SD[X] es la desviación estándar de X, la desviación estándar de X' es:

SD[X'] = |a|SD[X]

Se usa el valor absoluto de 'a' porque la desviación estándar, al ser una medida de distancia, siempre es no negativa. Esto significa que si 'a' es negativo, la dispersión sigue siendo positiva, solo que los datos se invierten en el eje.

Efecto sobre la Forma de la Distribución

Una de las características más importantes y a menudo subestimadas de las transformaciones lineales es que no cambia la forma de la distribución de los datos. Si su variable original X sigue una distribución normal, la variable transformada X' también seguirá una distribución normal. Si X tiene una distribución sesgada a la derecha, X' también estará sesgada a la derecha, y en la misma medida. Esto es crucial para la inferencia estadística, ya que muchas pruebas y modelos asumen ciertas formas de distribución (como la normalidad). Una transformación lineal nos permite ajustar la escala o la posición sin invalidar estas suposiciones.

Efecto sobre el Coeficiente de Correlación

El coeficiente de correlación de Pearson mide la fuerza y dirección de la relación lineal entre dos variables. Una propiedad sorprendente y útil de las transformaciones lineales es que no afecta la correlación entre dos variables. Si transformamos linealmente una o ambas variables (por ejemplo, X' = aX + b e Y' = cY + d), el coeficiente de correlación entre X' e Y' será el mismo que el coeficiente de correlación entre X e Y. Esto se debe a que la correlación se basa en la relación relativa entre los puntos, y las transformaciones lineales solo escalan y desplazan esos puntos de manera uniforme, manteniendo sus posiciones relativas.

Aplicaciones Prácticas de las Transformaciones Lineales

Las transformaciones lineales son herramientas versátiles con numerosas aplicaciones en el análisis de datos y la estadística:

- Cambio de Unidades de Medida: Esta es quizás la aplicación más directa y común. Por ejemplo, convertir temperaturas de grados Celsius (°C) a grados Fahrenheit (°F) utiliza una transformación lineal: F = 1.8 * C + 32. Aquí, a = 1.8 y b = 32. De manera similar, se usan para convertir de metros a centímetros, de kilogramos a libras, etc.

- Estandarización (Puntuación Z): La estandarización es una transformación lineal fundamental para comparar datos de diferentes distribuciones o escalas. La fórmula para una puntuación Z es Z = (X - μ) / σ, donde μ es la media y σ es la desviación estándar de X. En términos de nuestra fórmula general X' = aX + b, aquí a = 1/σ y b = -μ/σ. Al estandarizar, la variable resultante (Z) tendrá una media de 0 y una desviación estándar de 1, sin cambiar la forma de su distribución. Esto es invaluable para identificar valores atípicos o para preparar datos para ciertos algoritmos de aprendizaje automático.

- Normalización (Min-Max Scaling): Otra forma de escalar datos es la normalización min-max, que transforma los valores de una variable a un rango específico, comúnmente entre 0 y 1. La fórmula es X_norm = (X - min(X)) / (max(X) - min(X)). Aquí, a = 1 / (max(X) - min(X)) y b = -min(X) / (max(X) - min(X)). Esto es útil cuando se necesitan datos en un rango fijo, por ejemplo, para redes neuronales.

- Ajuste de Escala para Comparación: A menudo, en la investigación, necesitamos comparar variables que se miden en escalas muy diferentes. Aplicar transformaciones lineales para llevarlas a una escala común (como la estandarización) facilita la comparación directa y la interpretación de los resultados.

Diferencia entre Transformaciones Lineales y No Lineales

Es importante distinguir las transformaciones lineales de las no lineales, ya que sus efectos en los datos son muy diferentes. Mientras que una transformación lineal (X' = aX + b) solo escala y desplaza los datos, manteniendo su forma de distribución y las relaciones de correlación lineal, una transformación no lineal modifica la estructura fundamental de la variable.

Ejemplos de transformaciones no lineales incluyen:

- Transformación Logarítmica: log(X) o ln(X). Se utiliza comúnmente para reducir el sesgo en distribuciones asimétricas (por ejemplo, datos de ingresos o poblaciones) o para estabilizar la varianza.

- Transformación Cuadrada o Raíz Cuadrada: X² o √X. Pueden usarse para ajustar relaciones no lineales o para hacer que una distribución sea más simétrica.

- Transformación Recíproca: 1/X. Útil para datos con colas largas o para linearizar ciertas relaciones.

La principal diferencia radica en que las transformaciones no lineales pueden cambiar la forma de la distribución (por ejemplo, hacer que una distribución sesgada se parezca más a una normal), afectar la varianza de maneras complejas y alterar las relaciones de correlación. Se eligen a menudo para cumplir con suposiciones de modelos estadísticos o para mejorar la interpretabilidad de relaciones no lineales, mientras que las lineales se eligen por su simplicidad y por el mantenimiento de las propiedades estructurales de los datos.

Tabla Comparativa: Efecto de la Transformación Lineal (X' = aX + b)

| Propiedad | Original (X) | Transformada (X') | Comentario |

|---|---|---|---|

| Media (Esperanza) | E[X] | E[X'] = aE[X] + b | Ambos componentes 'a' y 'b' afectan la media de la misma manera. |

| Varianza | Var[X] | Var[X'] = a²Var[X] | Solo el componente multiplicativo 'a' afecta la varianza, y lo hace al cuadrado. El componente 'b' no tiene efecto. |

| Desviación Estándar | SD[X] | SD[X'] = |a|SD[X] | Derivada de la varianza, solo el valor absoluto de 'a' afecta la desviación estándar. |

| Forma de la Distribución | Cualquiera | Se mantiene idéntica a la original | Una distribución normal seguirá siendo normal; una sesgada, sesgada. |

| Coeficiente de Correlación | Corr(X, Y) | Corr(X', Y') = Corr(X, Y) | La correlación entre dos variables no se ve afectada por transformaciones lineales de una o ambas variables. |

Preguntas Frecuentes sobre la Transformación Lineal en Estadística

¿La transformación lineal cambia la forma de mi distribución de datos?

No, una de las propiedades más importantes de la transformación lineal (X' = aX + b) es que no altera la forma de la distribución de los datos. Si tus datos originales siguen una distribución normal, la variable transformada seguirá siendo normal. Si tienen un sesgo, ese sesgo se mantendrá. Esto es diferente de las transformaciones no lineales (como las logarítmicas), que sí pueden cambiar la forma de la distribución para, por ejemplo, hacerla más simétrica o normal.

¿Afecta la transformación lineal la relación (correlación) entre dos variables?

No, la transformación lineal no afecta el coeficiente de correlación de Pearson entre dos variables. Si tienes dos variables X e Y, y aplicas una transformación lineal a X (X' = aX + b) o a Y (Y' = cY + d), o a ambas, el coeficiente de correlación entre X' e Y' será exactamente el mismo que el coeficiente de correlación entre X e Y. Esto se debe a que la correlación mide la fuerza y dirección de la relación lineal, y las transformaciones lineales solo escalan y desplazan los puntos, manteniendo sus posiciones relativas.

¿Cuándo debo usar una transformación lineal?

Debes usar una transformación lineal cuando necesitas cambiar la escala o la posición de tus datos sin alterar su forma de distribución o las relaciones de correlación. Las aplicaciones comunes incluyen cambiar unidades de medida (por ejemplo, de metros a centímetros), estandarizar datos (como las puntuaciones Z para tener media 0 y desviación estándar 1), o normalizar datos a un rango específico (como de 0 a 1) para algoritmos que lo requieren. También son útiles para hacer que diferentes variables sean comparables en la misma escala.

¿Es lo mismo una transformación lineal que una transformación de función cualquiera (vertical, horizontal, estirada/comprimida)?

En el contexto general de las funciones matemáticas, una transformación lineal es un tipo específico de transformación que sigue la forma f(x) = ax + b. Las transformaciones verticales (f(x) + a) y las estiradas/comprimidas (cf(x)) son componentes de la transformación lineal en estadística, donde 'a' es el factor de escala y 'b' es la traslación vertical. Sin embargo, las transformaciones horizontales (f(x + a)) o funciones más complejas como f(cx) o f(x^2) no son transformaciones lineales en el sentido estadístico X' = aX + b, ya que afectan la variable de entrada de una manera no lineal o cambian la forma de la distribución.

¿Qué pasa si 'a' es negativo en una transformación lineal?

Si el componente multiplicativo 'a' es negativo (por ejemplo, X' = -2X + 5), la transformación no solo escala la variable, sino que también la invierte. Esto significa que los valores más pequeños de X se convertirán en valores más grandes de X', y viceversa. En términos de las propiedades estadísticas, la media se verá afectada por el signo de 'a' (si E[X] es positivo y 'a' negativo, E[X'] será negativo o menos positivo). Sin embargo, la varianza y la desviación estándar siempre serán positivas (Var[X'] = (-a)²Var[X] = a²Var[X] y SD[X'] = |-a|SD[X] = |a|SD[X]), ya que la dispersión se mide en términos de distancia y no dirección.

Conclusión

La transformación lineal es una herramienta simple pero extraordinariamente potente en el arsenal del estadístico. Su fórmula, X' = aX + b, encapsula la capacidad de manipular la escala y la posición de una variable, permitiendo ajustar los datos a diferentes necesidades sin comprometer la integridad de su forma de distribución. Hemos visto cómo afecta de manera predecible la media, la varianza y la desviación estándar, y, lo más importante, cómo mantiene inalteradas la forma de la distribución y las relaciones de correlación entre variables.

Desde la conversión de unidades hasta la estandarización para el análisis comparativo, las aplicaciones de la transformación lineal son vastas y fundamentales para la correcta interpretación y preparación de los datos. Su comprensión no solo facilita la manipulación de variables, sino que también profundiza la apreciación de cómo las propiedades estadísticas se comportan bajo diferentes escenarios. Dominar este concepto es, sin duda, un paso esencial para cualquier persona que aspire a una comprensión profunda del análisis de datos.

Si quieres conocer otros artículos parecidos a Transformación Lineal en Estadística: Guía Completa puedes visitar la categoría Estadística.