23/08/2024

En el vasto y creciente universo del big data, la capacidad de extraer significado y conocimiento de grandes volúmenes de información es una habilidad invaluable. Para cualquier persona que trabaje con datos, desde analistas hasta científicos de datos, es fundamental tener un conocimiento profundo sobre ciertos conceptos estadísticos. Entre ellos, la covarianza y la correlación se alzan como herramientas poderosas para comprender las relaciones entre variables. Esta guía está diseñada para desmitificar estos conceptos, explicando sus diferencias, sus métodos de cálculo y su importancia en el análisis de datos moderno.

En el mundo actual, donde tratamos con una amplia gama de variables para realizar diversas operaciones de análisis de datos, encontrar relaciones entre ellas nos ayuda a deducir ideas significativas que pueden ayudar a las organizaciones a tomar decisiones mejor informadas. Por ejemplo, ¿existe una relación entre la fuerza de un virus y el estado inmunológico de una persona? ¿O entre las tasas impositivas y el crecimiento económico de un estado? Estos ejemplos de escrutinio de la relación entre variables se pueden cuantificar empleando herramientas de análisis estadístico como la covarianza y la correlación. A continuación, descubriremos las diferencias clave entre la covarianza y la correlación, y cómo se complementan para ofrecer una imagen completa de la interconexión de tus datos.

¿Qué es la Covarianza?

La covarianza es una medida cuantitativa del grado en que la desviación de una variable (X) de su media está relacionada con la desviación de otra variable (Y) de su media. En términos simples, la covarianza mide la variabilidad conjunta de dos variables aleatorias. Por ejemplo, si los valores mayores de una variable tienden a corresponder con valores mayores de otra variable, esto sugiere una covarianza positiva. Es una medida que nos indica la dirección de la relación lineal entre dos variables, es decir, si tienden a moverse en la misma dirección o en direcciones opuestas.

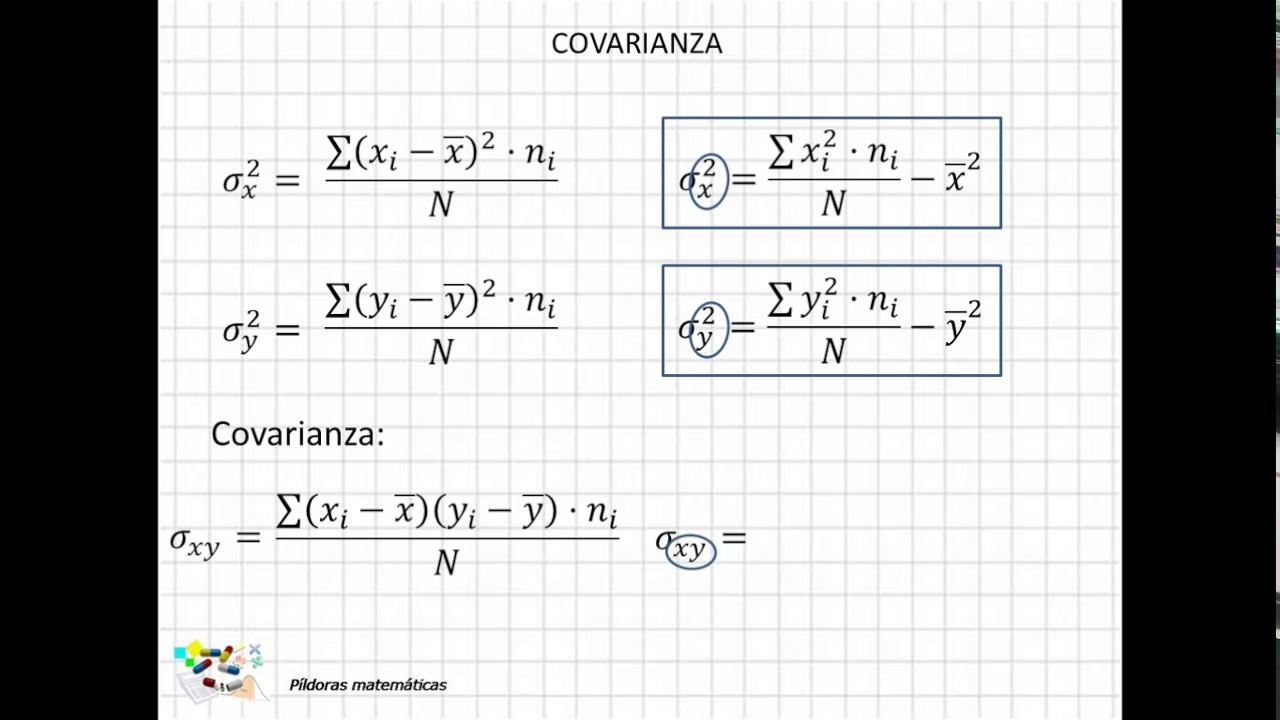

Fórmula de Covarianza

La fórmula de covarianza calcula la relación entre los puntos de datos y sus valores promedio en un conjunto de datos. La covarianza entre dos variables aleatorias X e Y se puede calcular mediante la siguiente fórmula:

Cov(X, Y) = Σ [(xi - x̄) * (yi - ȳ)] / (n - 1)

Donde:

xirepresenta los valores individuales de la variable X.yirepresenta los valores individuales de la variable Y.x̄representa la media (promedio) de la variable X.ȳrepresenta la media (promedio) de la variable Y.nrepresenta el número de puntos de datos.

Es importante notar que en algunos contextos, especialmente cuando se trabaja con poblaciones completas, el denominador puede ser n en lugar de n-1. Sin embargo, para muestras, n-1 es más común, ya que proporciona una estimación insesgada.

Tipos de Covarianza

La covarianza puede tener valores tanto positivos como negativos, lo que implica que hay tres tipos principales:

Covarianza Positiva

La covarianza positiva implica que ambas variables (X, Y) se mueven en la misma dirección, es decir, muestran un comportamiento similar. Si los valores mayores de una variable (X) parecen corresponder con valores mayores de otra variable (Y), entonces se considera que las variables tienen una covarianza positiva. Esto proporciona información sobre una relación lineal directa entre las dos variables. Por ejemplo, si un aumento en la altura de una persona se corresponde con un aumento en su peso, existe una covarianza positiva entre ambas variables.

Covarianza Negativa

Si la covarianza es negativa, indica que las variables se mueven en dirección opuesta. En particular, si los valores mayores de la variable X corresponden a valores menores de la variable Y, y viceversa, entonces las variables tienen covarianza negativa. Esto implica que cuando una variable aumenta, la otra tiende a disminuir. Un ejemplo clásico es la relación entre el precio de un producto y la cantidad demandada: a medida que el precio sube, la demanda tiende a bajar, lo que sugiere una covarianza negativa.

Covarianza Cero o Débil

En el caso en que la covarianza es cero o muy cercana a cero, no existe una relación lineal clara entre las variables X e Y. Es decir, los valores de una variable no pueden ser utilizados para predecir los valores de la otra variable de manera lineal. Por lo tanto, se considera que ambas variables son linealmente independientes. Es crucial recordar que una covarianza cero no implica necesariamente que no exista ningún tipo de relación entre las variables, solo que no hay una relación lineal.

¿Qué es una Matriz de Covarianza?

En el análisis estadístico de datos multidimensionales, se utiliza una generalización de la covarianza en términos de una matriz de covarianza. Esta matriz también se conoce como matriz de varianza-covarianza, ya que los valores diagonales de la matriz representan las varianzas de cada variable, y los otros valores (los fuera de la diagonal) representan las covarianzas entre los pares de variables. Es una matriz cuadrada de tamaño n x n, donde n es el número de variables en el conjunto de datos.

Matriz de Covarianza = [[Cov(X1,X1) Cov(X1,X2) ... Cov(X1,Xn)], [Cov(X2,X1) Cov(X2,X2) ... Cov(X2,Xn)], [...], [Cov(Xn,X1) Cov(Xn,X2) ... Cov(Xn,Xn)]]

Cada elemento Cov(Xi,Xj) de la matriz representa la covarianza entre las variables Xi y Xj. La diagonal principal Cov(Xi,Xi) es simplemente la varianza de la variable Xi. La matriz de covarianza es simétrica, lo que significa que Cov(Xi,Xj) = Cov(Xj,Xi).

¿Para qué sirve la Matriz de Covarianza?

La matriz de covarianza es una herramienta importante en el análisis de datos multivariados y se utiliza en diversas aplicaciones:

- Distancia de Mahalanobis: Una medida de distancia que tiene en cuenta la varianza y covarianza de las variables. Se calcula utilizando la inversa de la matriz de covarianza, permitiendo estimar la distancia entre puntos en un espacio multivariado, ajustando por la dispersión de los datos.

- Filtros de Kalman: Algoritmos utilizados para estimar variables desconocidas a lo largo del tiempo. La matriz de covarianza se usa para calcular el promedio ponderado que ayuda a predecir el nuevo estado del sistema.

- Modelos de Mezcla Gaussiana: Utilizan la matriz de covarianza para interpretar la forma y orientación de los clústeres normales multivariados, lo que es crucial en técnicas de clustering.

- Análisis de Componentes Principales (PCA): Una técnica fundamental de reducción de la dimensionalidad. La matriz de covarianza (o de correlación) es el punto de partida para calcular las componentes principales, que son nuevas variables ortogonales que capturan la mayor parte de la varianza de los datos originales.

¿Qué es la Correlación?

Mientras que la covarianza mide la dirección de la relación lineal entre dos variables, su magnitud no está estandarizada y depende de la escala de las variables, lo que dificulta su interpretación directa. Aquí es donde entra en juego la correlación. La correlación es una medida estandarizada que indica tanto la fuerza como la dirección de la relación lineal entre dos variables aleatorias. Es una medida más universal, ya que su valor siempre se encuentra en un rango definido, facilitando la comparación entre diferentes pares de variables.

La correlación es particularmente útil para analizar múltiples variables que expresan una relación lineal entre sí. Cuando se asume una correlación entre dos variables, se deduce que un cambio en una variable puede estar asociado a un cambio en la otra variable. Nos ayuda a determinar si los cambios en varias variables se relacionan entre sí y con qué fuerza.

Es importante tener en cuenta que la correlación no implica causalidad. Es decir, una correlación fuerte entre dos variables no significa necesariamente que una variable cause la otra. Además, una correlación débil o nula no significa necesariamente que no haya una relación entre las variables, solo que no hay una relación lineal.

Tipos de Correlación

La correlación se clasifica en tres tipos principales en función del valor del coeficiente:

Correlación Positiva

La correlación positiva se produce cuando dos variables aumentan o disminuyen juntas. Se expresa como un valor entre 0 y 1, siendo 1 una correlación positiva perfecta. Una correlación positiva cercana a 1 indica una relación fuerte y positiva, lo que significa que a medida que una variable aumenta, la otra también lo hace de manera predecible.

Correlación Negativa

La correlación negativa se produce cuando dos variables se mueven en direcciones opuestas. Se expresa como un valor entre -1 y 0, siendo -1 una correlación negativa perfecta. Una correlación negativa cercana a -1 indica una relación fuerte y negativa, lo que significa que a medida que una variable aumenta, la otra tiende a disminuir.

Cero o Sin Correlación

La falta de correlación o correlación nula se produce cuando no hay una relación lineal detectable entre dos variables aleatorias. Se expresa como un valor cercano a 0. Una correlación nula indica que no hay una tendencia lineal evidente, lo que no descarta la existencia de una relación no lineal.

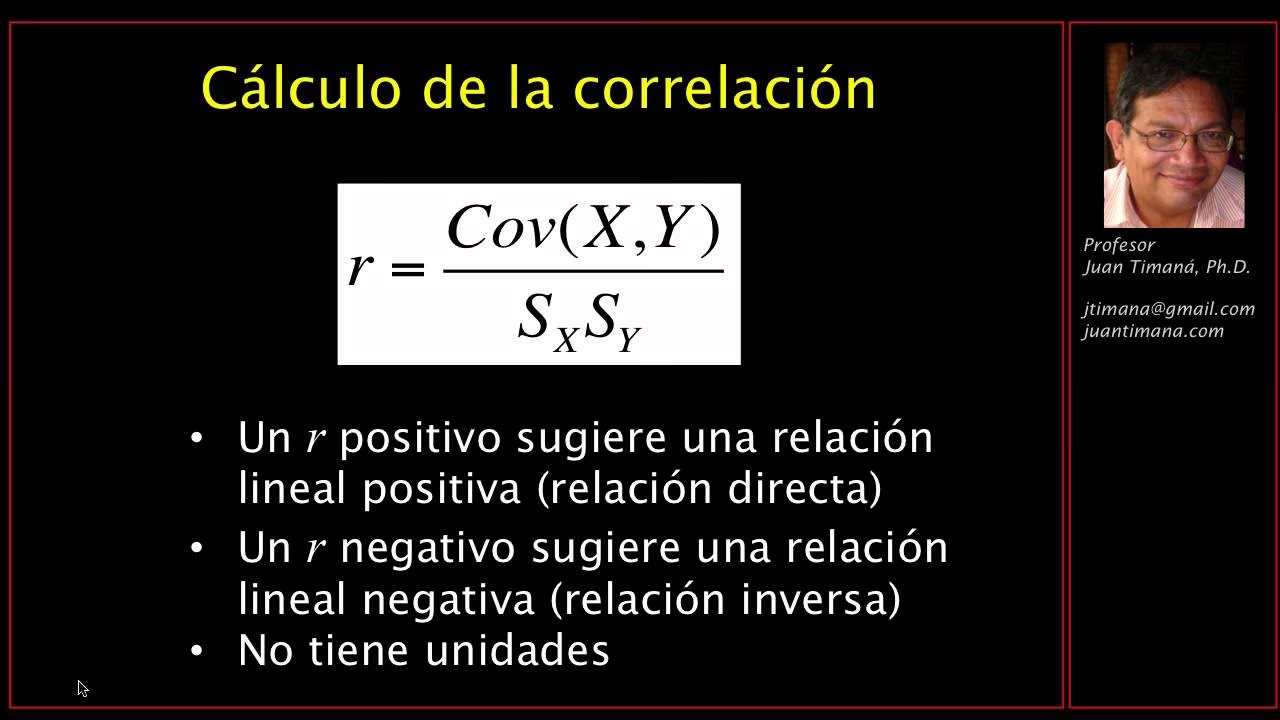

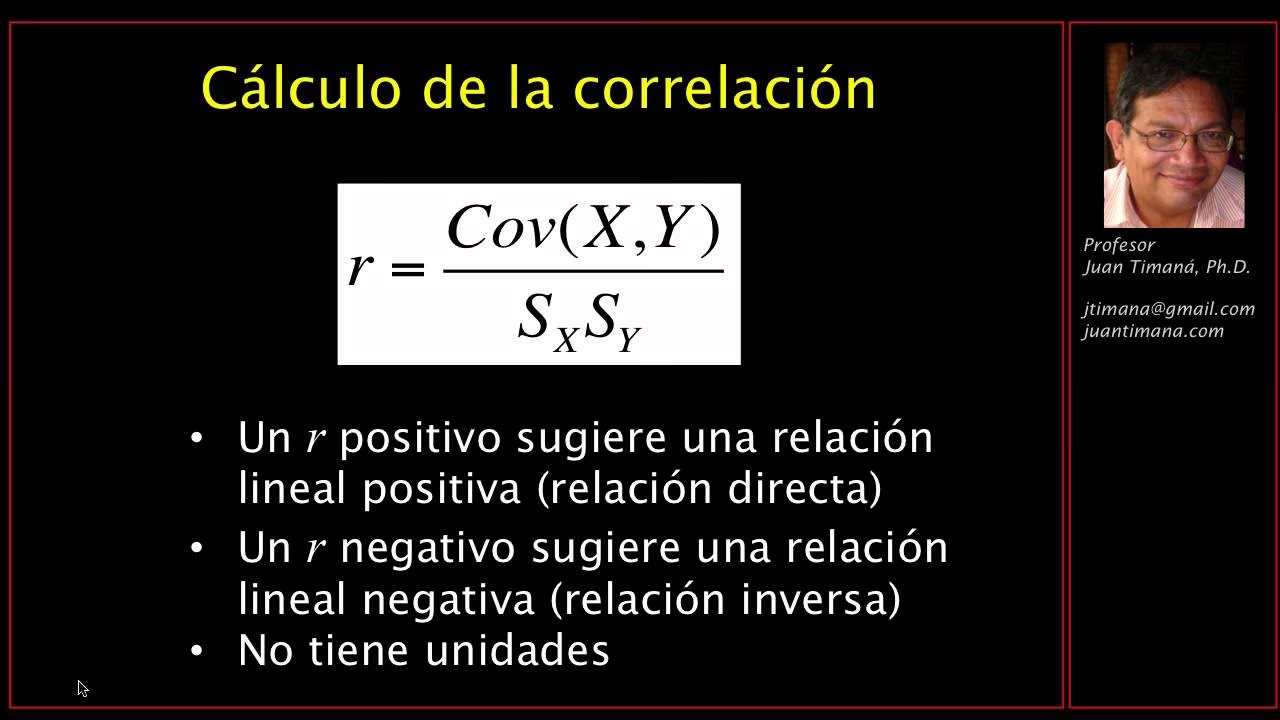

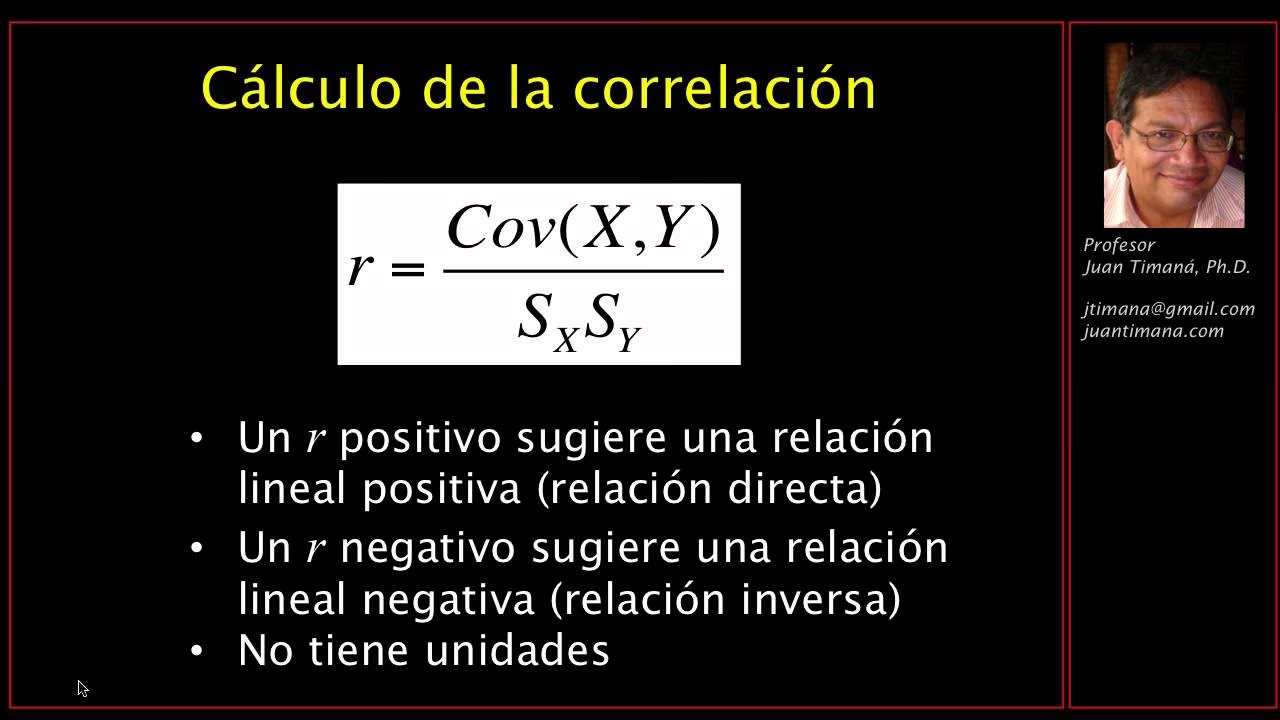

¿Qué es el Coeficiente de Correlación?

La correlación se calcula utilizando un método conocido como «Correlación producto-momento de Pearson» o simplemente «Coeficiente de Correlación de Pearson». Generalmente se denota con la letra cursiva r o con la letra griega ρ (rho) para la población.

Fórmula del Coeficiente de Correlación de Pearson

La fórmula utilizada para calcular el coeficiente de correlación r para dos variables X e Y es la siguiente:

r = Cov(X,Y) / (σX * σY)

Donde:

Cov(X,Y)es la covarianza entre X e Y.σXes la desviación estándar de la variable X.σYes la desviación estándar de la variable Y.

Esta fórmula también se puede expresar de la siguiente manera, que es la forma más común para cálculos manuales:

r = [nΣ(xy) - ΣxΣy] / √([nΣx² - (Σx)²] * [nΣy² - (Σy)²])

Aquí:

n= Número de valores o elementos.Σx= Suma de todos los valores de X.Σy= Suma de todos los valores de Y.Σxy= Suma del producto de cada par de valores (x,y).Σx²= Suma de los cuadrados de los valores de X.Σy²= Suma de los cuadrados de los valores de Y.

El coeficiente de correlación r varía entre -1 y 1. Un valor de r cercano a 1 indica una correlación positiva fuerte, mientras que un valor de r cercano a -1 indica una correlación negativa fuerte. Un valor de r cercano a 0 indica una correlación lineal débil o nula entre las variables.

Propiedades del Coeficiente de Correlación

- El valor de

rsiempre está entre -1 y +1. - El signo de

r(positivo o negativo) es el mismo que el signo de la covarianza. - Si

rse acerca a +1, la relación lineal positiva es muy fuerte. - Si

rse acerca a -1, la relación lineal negativa es muy fuerte. - Si

rse acerca a 0, la relación lineal es débil o inexistente. - El coeficiente de correlación es una medida pura, sin unidades, lo que lo hace independiente de las escalas de las variables.

- No se ve afectado si se intercambian las variables (

Corr(X,Y) = Corr(Y,X)). - No implica causalidad; solo mide la asociación lineal.

¿Qué es una Matriz de Correlación?

Al igual que la matriz de covarianza, una matriz de correlación es una tabla que muestra los coeficientes de correlación para varias variables. Las filas y columnas de la tabla contienen el nombre de las variables, y cada celda muestra el coeficiente de correlación entre las variables correspondientes. La matriz de correlación es esencialmente una forma de visualizar la relación lineal entre múltiples variables y puede ayudar a identificar patrones y tendencias en los datos de manera rápida.

Matriz de Correlación = [[Corr(X1,X1) Corr(X1,X2) ... Corr(X1,Xn)], [Corr(X2,X1) Corr(X2,X2) ... Corr(X2,Xn)], [...], [Corr(Xn,X1) Corr(Xn,X2) ... Corr(Xn,Xn)]]

Los elementos de la diagonal principal son siempre 1, ya que la correlación de una variable consigo misma es perfecta. Al igual que la matriz de covarianza, la matriz de correlación es simétrica.

¿Para qué sirve la Matriz de Correlación?

La matriz de correlación es una herramienta comúnmente utilizada en diferentes problemas basados en datos:

- Resumen de conjuntos de datos: Para conjuntos de datos grandes, la matriz de correlación es una forma efectiva de resumir la correlación entre múltiples variables, facilitando la interpretación visual de las relaciones.

- Pruebas de regresión: En regresión lineal múltiple, la multicolinealidad (cuando dos o más variables independientes están altamente correlacionadas) puede dificultar la interpretación. La matriz de correlación ayuda a una detección rápida de variables altamente correlacionadas, lo que puede guiar decisiones sobre qué variables incluir en el modelo.

- Entrada para análisis complejos: Métodos de análisis, como los modelos de ecuaciones estructurales o el análisis de componentes principales (PCA), pueden utilizar la matriz de correlación como entrada directa para sus cálculos, ya que trabajan con relaciones estandarizadas.

Covarianza vs. Correlación: ¿Cuál es la Diferencia?

La covarianza y la correlación son medidas estadísticas que se utilizan para evaluar la relación lineal entre dos variables aleatorias. Aunque ambas medidas están interrelacionadas y ambas indican la dirección de la relación, hay diferencias clave y fundamentales entre ellas:

| Característica | Covarianza | Correlación |

|---|---|---|

| Definición | Mide la variabilidad conjunta de dos variables y la dirección de su relación lineal. | Mide la fuerza y dirección de la relación lineal estandarizada entre dos variables. |

| Rango de Valores | Puede tomar cualquier valor real, de -∞ a +∞. Su magnitud depende de las unidades de las variables. | Siempre se encuentra entre -1 y +1. Es una medida estandarizada y sin unidades. |

| Unidades | Tiene unidades (producto de las unidades de las dos variables). | No tiene unidades (es un número puro). |

| Interpretación | Indica solo la dirección (positiva, negativa, cero). La magnitud no es directamente interpretable para la fuerza. | Indica tanto la dirección como la fuerza de la relación. Fácil de comparar entre diferentes conjuntos de datos. |

| Estandarización | No estandarizada. | Estandarizada (dividida por las desviaciones estándar). |

| Sensibilidad a la Escala | Muy sensible a los cambios de escala de las variables. | Insensible a los cambios de escala o unidades de las variables. |

En esencia, la covarianza nos dice si las variables se mueven en la misma dirección o en direcciones opuestas. La correlación, al ser una versión estandarizada de la covarianza, va un paso más allá y nos dice cuán fuerte es esa relación, independientemente de la escala de las variables.

¿Cómo Sacar la Covarianza con la Correlación?

Una de las preguntas más comunes es cómo se relacionan estas dos medidas, y si es posible derivar una de la otra. La respuesta es sí. De hecho, la fórmula del coeficiente de correlación de Pearson ya nos da la clave para calcular la covarianza si conocemos la correlación y las desviaciones estándar de las variables. Como mencionamos anteriormente, la fórmula de correlación es:

r = Cov(X,Y) / (σX * σY)

Para despejar la covarianza (Cov(X,Y)) de esta ecuación, simplemente multiplicamos el coeficiente de correlación por el producto de las desviaciones estándar de las dos variables:

Cov(X,Y) = r * σX * σY

Donde:

Cov(X,Y)es la covarianza entre las variables X e Y.res el coeficiente de correlación de Pearson entre X e Y.σXes la desviación estándar de la variable X.σYes la desviación estándar de la variable Y.

Esta relación es fundamental y demuestra que la correlación es, de hecho, una versión normalizada de la covarianza. Si tienes el coeficiente de correlación y las desviaciones estándar, puedes calcular la covarianza de manera sencilla.

¿Cómo son Relevantes la Covarianza y la Correlación para el Análisis de Datos?

La covarianza y la correlación son herramientas indispensables en el análisis de datos y tienen una amplia variedad de casos de uso prácticos:

- Comparar Muestras: Ayudan a analizar tendencias y patrones comunes en diferentes muestras o poblaciones, lo que es útil para identificar relaciones y similitudes en los datos.

- Industrias Basadas en Datos: En sectores donde los datos son el motor, como las finanzas, la salud o el marketing, la covarianza y la correlación son importantes para identificar datos multivariados y realizar operaciones analíticas efectivas que informen decisiones de negocio.

- Investigación de Relaciones: La correlación es un método clave para investigar la fuerza y dirección de las relaciones entre dos variables antes de implementar un modelado estadístico más complejo, como la regresión.

- Análisis de Componentes Principales (PCA): Como se mencionó, tanto la covarianza como la correlación son la base para implementar PCA, una técnica vital para reducir la dimensionalidad de grandes conjuntos de datos y mejorar la interpretabilidad.

- Procesos Analíticos Avanzados: Procesos como el análisis multivariante, la selección de características en el aprendizaje automático o la construcción de carteras de inversión, se logran empleando métodos basados en covarianza y correlación.

En resumen, estas medidas permiten a los científicos de datos y a los investigadores comprender la estructura subyacente de sus datos, identificar variables clave y construir modelos predictivos más robustos.

Puntos Clave sobre Covarianza y Correlación

Hemos explorado dos conceptos clave en el análisis de datos: la covarianza y la correlación. A continuación, se resumen los puntos más importantes:

- La covarianza y la correlación son dos herramientas estadísticas estrechamente relacionadas, pero de naturaleza diferente, que interpretan la relación lineal entre variables aleatorias.

- La covarianza es una medida de la dirección de la relación, mientras que la correlación es una versión estandarizada de la covarianza que también indica la fuerza de la relación.

- Los valores de correlación oscilan entre +1 y -1, lo que permite una interpretación universal de la fuerza de la relación. Los valores de covarianza, por otro lado, pueden variar de -∞ a +∞ y su magnitud no es directamente interpretable para la fuerza.

- Una covarianza positiva siempre conduce a una correlación positiva, y una covarianza negativa siempre genera una correlación negativa. Esto se debe a que el coeficiente de correlación es una función de la covarianza y las desviaciones estándar, que siempre son positivas.

- Ambas medidas son fundamentales para el análisis exploratorio de datos, la reducción de la dimensionalidad y la comprensión de la interdependencia entre variables en diversos campos.

Preguntas Frecuentes (FAQ)

¿Cuál es la diferencia principal entre la covarianza y el coeficiente de correlación?

La diferencia principal radica en la estandarización y la interpretación de la magnitud. La covarianza mide la dirección de la relación lineal entre dos variables, pero su valor no está estandarizado y depende de las unidades de las variables, lo que dificulta comparar la fuerza de las relaciones entre diferentes pares de variables. El coeficiente de correlación, por otro lado, es una versión estandarizada de la covarianza (dividida por el producto de las desviaciones estándar), lo que significa que su valor siempre está entre -1 y +1. Esto permite interpretar no solo la dirección, sino también la fuerza de la relación de manera universal.

¿Cuál es la fórmula para la correlación y covarianza de Pearson?

Para la covarianza entre dos variables X e Y, la fórmula es:Cov(X, Y) = Σ [(xi - x̄) * (yi - ȳ)] / (n - 1)

Para el coeficiente de correlación de Pearson (r) entre dos variables X e Y, la fórmula es:r = Cov(X,Y) / (σX * σY)

También se puede expresar como:r = [nΣ(xy) - ΣxΣy] / √([nΣx² - (Σx)²] * [nΣy² - (Σy)²])

Donde σX y σY son las desviaciones estándar de X e Y, respectivamente.

¿La correlación implica causalidad?

No, la correlación no implica causalidad. Una correlación fuerte entre dos variables simplemente significa que se mueven juntas de manera predecible. Puede haber una tercera variable no observada que esté influyendo en ambas, o la relación podría ser puramente coincidente. Para establecer causalidad, se requieren métodos de investigación más rigurosos, como experimentos controlados o análisis causales avanzados.

¿Qué significa una covarianza o correlación de cero?

Una covarianza o correlación de cero indica que no existe una relación lineal entre las dos variables. Esto significa que los cambios en una variable no pueden predecir los cambios en la otra de manera lineal. Sin embargo, es importante recordar que la ausencia de una relación lineal no significa necesariamente que no haya ninguna relación en absoluto; podría haber una relación no lineal (por ejemplo, cuadrática o exponencial) que estas medidas no capturan.

Si quieres conocer otros artículos parecidos a Covarianza y Correlación: Guía Esencial para Datos puedes visitar la categoría Estadística.