01/12/2024

En el vasto universo de la estadística, donde los números hablan y los datos revelan patrones ocultos, pocas herramientas son tan poderosas y versátiles como el estadístico F. Nombrado en honor al insigne estadístico y biólogo Ronald Fisher, este valor es una pieza central en el análisis de la varianza (ANOVA) y en muchos otros modelos estadísticos. Pero, ¿qué es exactamente el estadístico F? ¿Cómo se calcula? Y, lo más importante, ¿qué nos dice sobre los datos que analizamos? En este artículo, desglosaremos el concepto del estadístico F, su método de cálculo y su crucial papel en la toma de decisiones estadísticas.

- ¿Qué es el Estadístico F en Estadística?

- El Estadístico F en el Análisis de Varianza (ANOVA)

- Cálculo del Estadístico F: Un Ejemplo Práctico

- Distribuciones F y Pruebas de Hipótesis: Interpretando el Valor F

- ¿Por qué analizar la varianza para evaluar las medias?

- Tabla Comparativa: Valores F Altos vs. Bajos

- Preguntas Frecuentes (FAQ)

¿Qué es el Estadístico F en Estadística?

El estadístico F es, en su esencia más pura, una proporción de dos varianzas. Para entenderlo, primero debemos recordar qué es la varianza. La varianza es una medida de dispersión que nos indica qué tan dispersos o alejados están los datos con respecto a su media. Un valor de varianza alto significa que los datos están muy extendidos, mientras que un valor bajo indica que los datos están agrupados cerca de la media. Es el cuadrado de la desviación estándar, lo que la hace menos intuitiva que la desviación estándar (que está en las mismas unidades que los datos), pero fundamental para muchos cálculos estadísticos.

Cuando hablamos del estadístico F, no estamos comparando cualquier par de varianzas, sino estimaciones específicas de la varianza de la población, conocidas como 'cuadrados medios'. Aunque el término 'cuadrados medios' pueda sonar complejo, simplemente se refiere a una estimación de la varianza de la población que ha sido ajustada por los grados de libertad (GL) utilizados en su cálculo. Los grados de libertad son el número de valores en un cálculo final de un estadístico que son libres de variar.

La prueba F, que utiliza el estadístico F, es sorprendentemente flexible. Si bien su aplicación más conocida es en el Análisis de Varianza (ANOVA) para determinar si las medias de tres o más grupos son significativamente diferentes, también se utiliza para evaluar la significancia global de un modelo de regresión, para comparar el ajuste de diferentes modelos, o para probar términos específicos dentro de un modelo.

El Estadístico F en el Análisis de Varianza (ANOVA)

El ANOVA es una técnica estadística que, a pesar de su nombre (Análisis de Varianza), se utiliza principalmente para comparar las medias de tres o más grupos. La razón por la que se utiliza la varianza para comparar medias es ingeniosa: si la variabilidad entre las medias de los grupos es significativamente mayor que la variabilidad dentro de cada grupo, podemos inferir que las medias de los grupos no son iguales. Aquí es donde entra en juego el estadístico F.

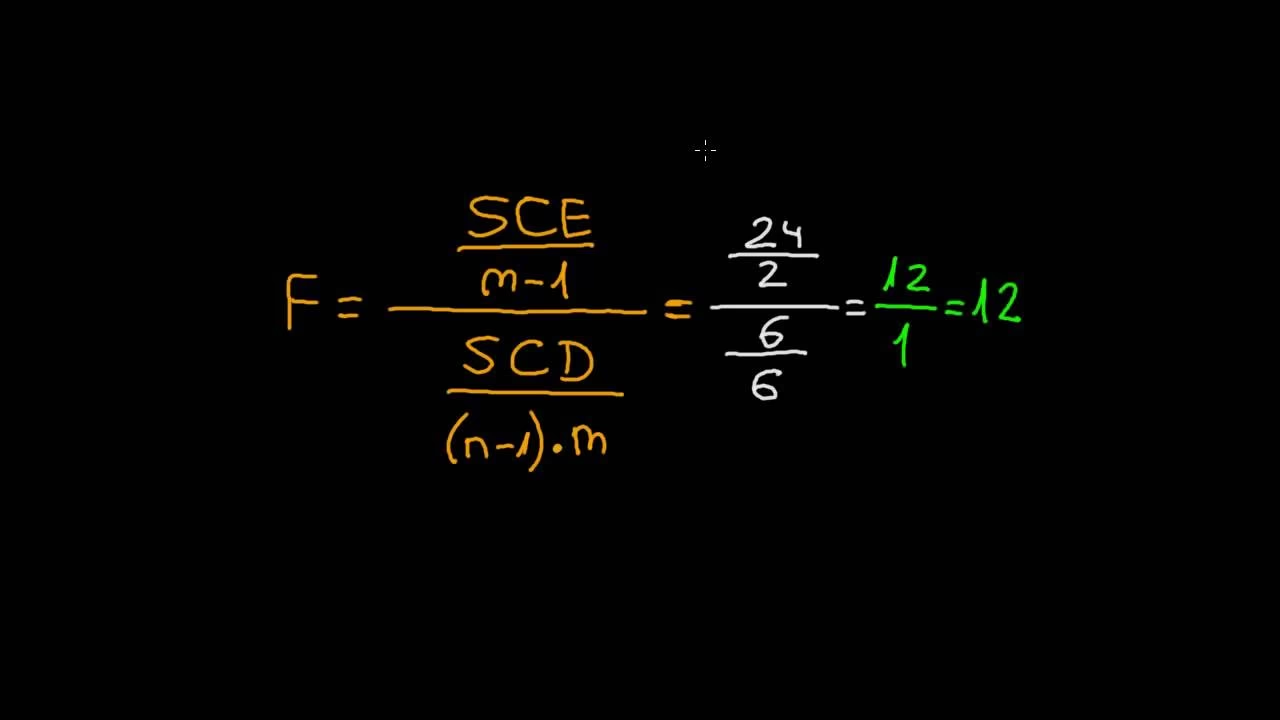

En un ANOVA de un solo factor, la fórmula del estadístico F se define como:

F = Variación entre las medias de las muestras / Variación dentro de las muestras

Vamos a desglosar cada componente de esta proporción para entender su significado y cómo se calculan.

Numerador: Variación entre las Medias de las Muestras (Cuadrado Medio del Factor)

El numerador del estadístico F mide la variabilidad entre las medias de los diferentes grupos. Se le conoce como el 'Cuadrado Medio del Factor' (CM Factor) o 'Cuadrado Medio entre Grupos'. Para calcularlo, se estima cuánto se dispersan las medias de cada grupo con respecto a la media general de todos los datos. Si las medias de los grupos están muy separadas entre sí, esto sugiere que hay una diferencia real entre ellos, y el valor del numerador será alto.

Pensemos en un ejemplo práctico. Supongamos que estamos midiendo la resistencia de cuatro tipos diferentes de plástico. El ANOVA calcula una media de resistencia para cada tipo de plástico. Si estas cuatro medias (por ejemplo: 11.203, 8.938, 10.683 y 8.838) están muy dispersas entre sí en relación con la media global de todas las mediciones (9.915), esto indicaría una alta variabilidad entre los grupos.

En los resultados de un software estadístico, este valor se encuentra típicamente bajo la etiqueta 'CM ajust. del Factor' o 'Mean Square (MS) for Factor'. Cuanto mayor sea este número, más dispersas estarán las medias de los grupos, lo que nos acerca a la conclusión de que hay diferencias significativas entre ellos.

Denominador: Variación Dentro de las Muestras (Cuadrado Medio del Error)

El denominador del estadístico F mide la variabilidad dentro de cada uno de los grupos. Se le llama 'Cuadrado Medio del Error' (CM Error) o 'Cuadrado Medio dentro de Grupos'. Representa la variabilidad de las observaciones individuales con respecto a la media de su propio grupo. Es, en esencia, el 'ruido de fondo' o la variabilidad aleatoria que no puede ser explicada por las diferencias entre los grupos.

Si las observaciones dentro de cada grupo están muy cerca de la media de su propio grupo, la varianza dentro de las muestras será baja. Por el contrario, si las observaciones están muy dispersas dentro de cada grupo, el valor del denominador será alto. Para poder detectar diferencias entre las medias de los grupos, deseamos que esta variabilidad dentro de los grupos sea lo más baja posible.

Continuando con el ejemplo de la resistencia del plástico, el CM Error se calcularía a partir de qué tan lejos está cada medición individual de la resistencia de la media de su tipo de plástico correspondiente. En la salida de un software, este valor se encuentra generalmente como 'CM ajust. del Error' o 'Mean Square (MS) for Error'.

Cálculo del Estadístico F: Un Ejemplo Práctico

Ahora que entendemos los componentes, veamos cómo se calcula el estadístico F usando los valores de nuestro ejemplo de resistencia del plástico. Supongamos que el software estadístico nos arroja los siguientes cuadrados medios ajustados:

- CM ajust. del Factor (Variación entre las medias de las muestras): 14.540

- CM ajust. del Error (Variación dentro de las muestras): 4.402

Aplicando la fórmula, el estadístico F se calcula como:

F = 14.540 / 4.402 = 3.30

Este valor de 3.30 es nuestro estadístico F observado. Pero, ¿es este valor 'alto' o 'bajo'? ¿Es lo suficientemente grande como para concluir que las resistencias medias de los diferentes tipos de plástico son realmente distintas? Aquí es donde entran en juego las distribuciones F y las pruebas de hipótesis.

Distribuciones F y Pruebas de Hipótesis: Interpretando el Valor F

Un valor F por sí solo no nos dice mucho. Necesitamos compararlo con una distribución teórica, la distribución F, para determinar su significancia estadística. La distribución F es una familia de distribuciones de probabilidad que varían según sus grados de libertad. Específicamente, una distribución F se define por dos tipos de grados de libertad: los del numerador (asociados al factor o entre grupos) y los del denominador (asociados al error o dentro de grupos).

En nuestro ejemplo de ANOVA de un solo factor, los grados de libertad para el numerador serían 3 (número de grupos - 1) y los grados de libertad para el denominador serían 36 (número total de observaciones - número de grupos). Estos grados de libertad son cruciales porque definen la forma específica de la distribución F con la que compararemos nuestro estadístico F.

La lógica detrás de la prueba F en ANOVA es la siguiente:

- Hipótesis Nula (H₀): Todas las medias de los grupos son iguales. (μ₁ = μ₂ = μ₃ = μ₄...)

- Hipótesis Alternativa (H₁): Al menos una de las medias de los grupos es diferente.

Si la hipótesis nula es verdadera (es decir, no hay diferencias reales entre las medias de los grupos), entonces se esperaría que la variación entre las medias de las muestras sea aproximadamente igual a la variación dentro de las muestras. En este escenario, el estadístico F debería ser cercano a 1. Un valor F significativamente mayor que 1 sugiere que la variación entre los grupos es mayor de lo que se esperaría por puro azar si la hipótesis nula fuera cierta.

El Valor P: La Clave para la Decisión

Para determinar si nuestro estadístico F observado es 'lo suficientemente alto', calculamos un valor P. El valor P es la probabilidad de observar un estadístico F tan extremo (o más extremo) como el que obtuvimos en nuestro estudio, asumiendo que la hipótesis nula es verdadera. En otras palabras, nos dice cuán probable es que nuestras observaciones ocurran por puro azar si no hubiera una diferencia real entre las medias de los grupos.

Para nuestro ejemplo de resistencia del plástico, con un valor F de 3.30 y los grados de libertad correspondientes (3 para el numerador y 36 para el denominador), el software estadístico calcula un valor P. Si este valor P es, por ejemplo, 0.031 (3.1%), significa que hay un 3.1% de probabilidad de obtener un estadístico F de 3.30 o mayor si, en realidad, no hubiera diferencias entre los tipos de plástico.

La decisión se toma comparando el valor P con un nivel de significancia preestablecido (alfa, α), comúnmente 0.05 (5%).

- Si P ≤ α: Se rechaza la hipótesis nula. Esto sugiere que las diferencias observadas entre las medias de los grupos son estadísticamente significativas y no se deben al azar. En nuestro ejemplo (0.031 ≤ 0.05), rechazaríamos la hipótesis nula y concluiríamos que al menos una de las medias de resistencia de los plásticos es diferente.

- Si P > α: No se rechaza la hipótesis nula. Esto significa que no hay suficiente evidencia para concluir que las medias de los grupos son diferentes; las diferencias observadas podrían deberse al azar.

Valor Crítico F

Además del valor P, otra forma de tomar una decisión es comparar el estadístico F observado con un 'valor crítico F'. El valor crítico F es un umbral que se obtiene de la tabla de la distribución F para un nivel de significancia (α) y grados de libertad específicos. Si el estadístico F calculado es mayor que el valor crítico F, se rechaza la hipótesis nula. Es un método alternativo al valor P para llegar a la misma conclusión.

¿Por qué analizar la varianza para evaluar las medias?

Esta es una pregunta fundamental que a menudo desconcierta a los principiantes. Si nuestro objetivo es comparar medias, ¿por qué utilizamos un 'Análisis de Varianza'? La respuesta reside en la lógica de la prueba F. Las diferencias en las medias de los grupos se manifiestan como una mayor variabilidad 'entre' los grupos. Si los grupos tienen medias muy diferentes, entonces sus datos combinados mostrarán una mayor dispersión si se comparan con la variabilidad inherente dentro de cada grupo.

El ANOVA evalúa si la variabilidad entre las medias de los grupos es lo suficientemente grande en comparación con la variabilidad natural dentro de cada grupo (el 'ruido' aleatorio). Si el cociente (el estadístico F) es grande, significa que las medias de los grupos están lo suficientemente dispersas como para ser consideradas diferentes, más allá de lo que el azar podría explicar. Por lo tanto, el análisis de la varianza es el medio por el cual inferimos sobre la igualdad de las medias.

Tabla Comparativa: Valores F Altos vs. Bajos

Para solidificar la comprensión, consideremos la implicación de diferentes valores F:

| Característica | Estadístico F Bajo (Cercano a 1) | Estadístico F Alto (> 1) |

|---|---|---|

| Variación entre grupos (Numerador) | Pequeña, similar a la variación dentro de grupos. | Grande, significativamente mayor que la variación dentro de grupos. |

| Variación dentro de grupos (Denominador) | Relativamente alta en comparación con la variación entre grupos. | Relativamente baja en comparación con la variación entre grupos. |

| Implicación sobre las medias de los grupos | Las medias de los grupos son probablemente iguales; las diferencias observadas son por azar. | Las medias de los grupos son probablemente diferentes; las diferencias son significativas. |

| Valor P | Alto (generalmente > 0.05). | Bajo (generalmente ≤ 0.05). |

| Decisión (para α=0.05) | No se rechaza la hipótesis nula. | Se rechaza la hipótesis nula. |

Preguntas Frecuentes (FAQ)

¿Cómo se relaciona el estadístico F con la significancia estadística?

El estadístico F es el valor de prueba que se utiliza en una prueba F. Su magnitud, en combinación con los grados de libertad, determina el valor P. El valor P, a su vez, es lo que nos permite determinar la significancia estadística. Si el valor P es menor que nuestro nivel de significancia (alfa), concluimos que el resultado es estadísticamente significativo, lo que implica que la relación o diferencia observada probablemente no se deba al azar.

¿Qué es el valor crítico F?

El valor crítico F es un umbral obtenido de las tablas de la distribución F (o calculado por software) para un nivel de significancia y grados de libertad específicos. Si el estadístico F que calculamos a partir de nuestros datos es mayor que este valor crítico, entonces se considera que los resultados son estadísticamente significativos, lo que nos lleva a rechazar la hipótesis nula.

¿Qué significa un valor F alto o bajo?

- Un valor F alto indica que la variabilidad entre las medias de los grupos es sustancialmente mayor que la variabilidad dentro de los grupos. Esto sugiere que las diferencias observadas entre las medias de los grupos son probablemente reales y no simplemente el resultado de la variabilidad aleatoria.

- Un valor F bajo (cercano a 1) indica que la variabilidad entre las medias de los grupos es similar a la variabilidad dentro de los grupos. Esto sugiere que cualquier diferencia observada entre las medias de los grupos podría explicarse por la variabilidad aleatoria, y no hay suficiente evidencia para concluir que las medias son realmente diferentes.

¿Se utiliza el F-test solo para ANOVA?

No, aunque el ANOVA es su aplicación más común y conocida, la prueba F es una herramienta versátil. También se utiliza en el análisis de regresión para evaluar la significancia global del modelo, para comparar la varianza de dos poblaciones, y en pruebas más avanzadas como la comparación de modelos anidados.

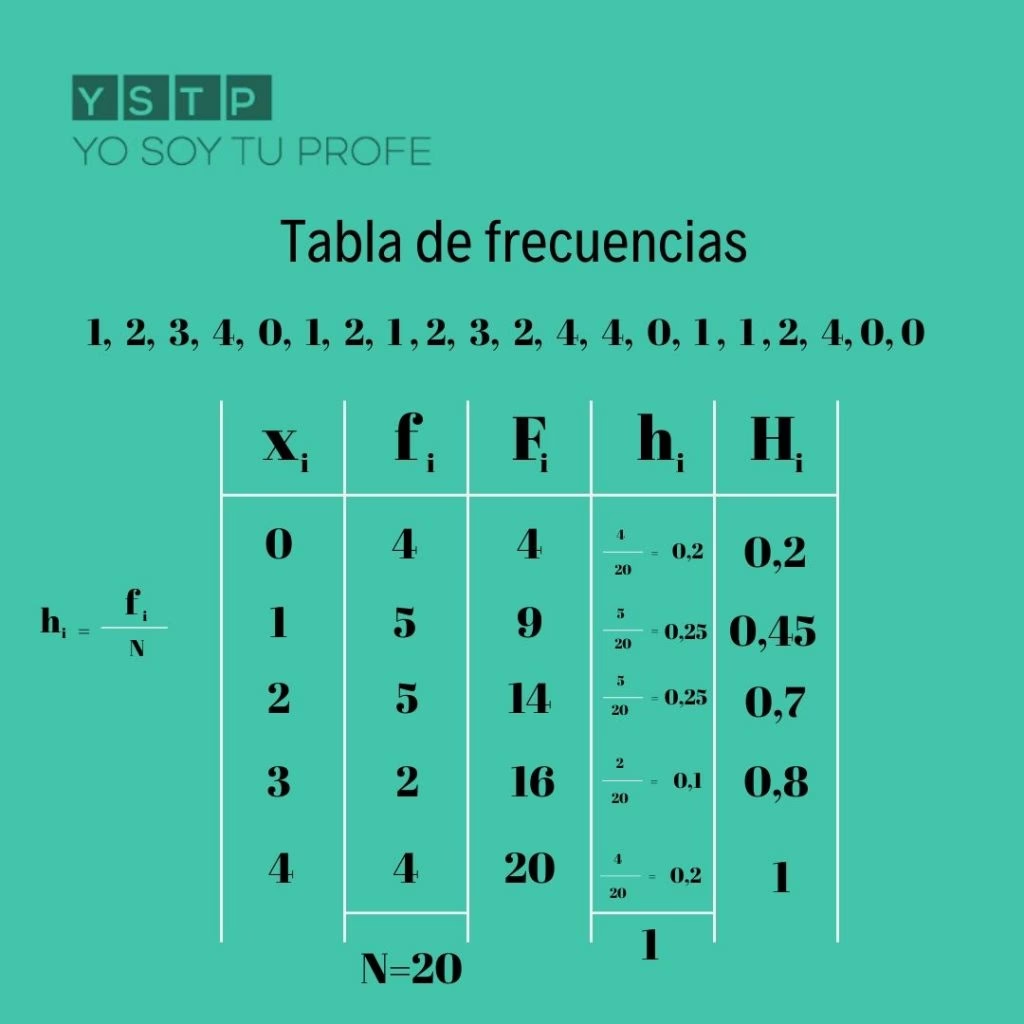

¿Cuál es la diferencia entre 'f' y 'fi' en estadística?

Es importante aclarar esta posible confusión. La 'f' en 'estadístico F' se refiere al estadístico de Fisher, una medida de la proporción de varianzas. Por otro lado, 'fi' (frecuencia relativa) es un concepto completamente diferente en estadística descriptiva. La frecuencia relativa (fi) se calcula como el cociente entre la frecuencia absoluta (ni) de un dato y el número total de datos (N) en un conjunto (fi = ni/N). Representa la proporción de veces que un valor o categoría aparece en un conjunto de datos y se utiliza para describir distribuciones de frecuencias, no para pruebas de hipótesis sobre medias o varianzas como el estadístico F.

En conclusión, el estadístico F es una piedra angular de la inferencia estadística, permitiéndonos discernir si las diferencias observadas entre los grupos son meras coincidencias o reflejan una realidad subyacente. Al comprender cómo se calcula y se interpreta, desbloqueamos la capacidad de tomar decisiones más informadas y sólidas a partir de nuestros datos.

Si quieres conocer otros artículos parecidos a El Estadístico F y su Cálculo en Estadística puedes visitar la categoría Estadística.