10/06/2023

En el vasto universo de las mediciones, ya sea que estemos en un laboratorio científico, diseñando un componente de ingeniería, cocinando una receta o simplemente midiendo una habitación, la precisión es un pilar fundamental. Sin embargo, la perfección es un ideal inalcanzable. Cada medición que realizamos, por muy sofisticado que sea el instrumento o meticuloso el proceso, conlleva inherente una cierta cantidad de incertidumbre o error. Comprender y cuantificar estos errores no es solo una necesidad académica, sino una habilidad crucial que nos permite evaluar la fiabilidad de nuestros resultados y tomar decisiones informadas.

Este artículo te sumergirá en el fascinante mundo del error en las mediciones, desde sus conceptos más básicos, como el error absoluto y relativo, hasta cómo estos errores se propagan a través de operaciones matemáticas complejas como la multiplicación y la división. Exploraremos las metodologías para cuantificarlos, los errores comunes que se suelen cometer y la importancia de la metrología y la calibración en la minimización de estas desviaciones. Prepárate para desvelar cómo la exactitud y la precisión se convierten en tus mejores aliados en cualquier campo.

- Entendiendo el Error Absoluto y Relativo

- Propagación de Errores en Operaciones Matemáticas

- Metrología, Calibración y Errores Instrumentales

- Errores Comunes y Malentendidos

- Preguntas Frecuentes (FAQs)

- ¿Por qué es importante calcular los errores en las mediciones?

- ¿Cuál es la diferencia principal entre exactitud y precisión?

- ¿Cuándo debo usar el método de errores relativos para la propagación de errores en multiplicación/división?

- ¿Qué significa el 'error de multiplicación' en el contexto de un instrumento de medida?

- ¿Cómo influye la calibración en la reducción de errores?

- ¿Es posible eliminar completamente el error en una medición?

- Conclusión

Entendiendo el Error Absoluto y Relativo

Antes de sumergirnos en la propagación de errores en cálculos más complejos, es esencial comprender los dos tipos fundamentales de error asociados a una única medición: el error absoluto y el error relativo.

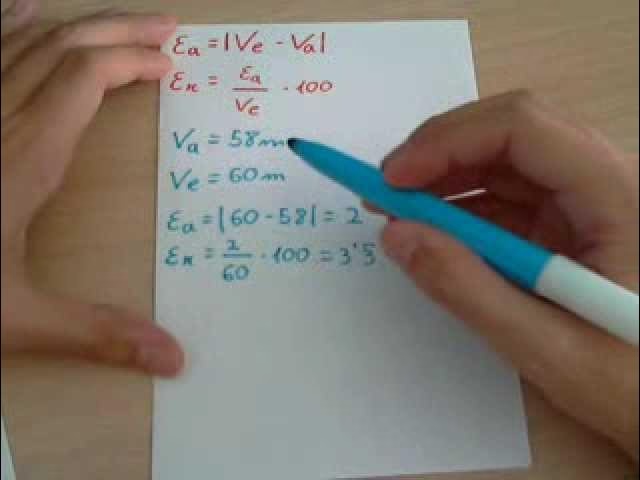

¿Qué es el Error Absoluto?

El error absoluto es la diferencia simple entre el valor medido de una cantidad y su valor verdadero o real. Nos indica “cuánto” nos hemos desviado del valor esperado. Es una medida directa de la desviación, expresada en las mismas unidades que la cantidad que se está midiendo. Cuanto menor sea el error absoluto, más cerca estará nuestra medición del valor real.

La fórmula para calcular el error absoluto es la siguiente:

Δx = |xactual - xmedido|

Donde:

Δxes el error absoluto.xactuales el valor verdadero o real de la cantidad.xmedidoes el valor obtenido a través de la medición.

El uso de las barras de valor absoluto (| |) asegura que el error absoluto siempre sea un valor positivo, ya que solo nos interesa la magnitud de la diferencia, no la dirección.

¿Qué es el Error Relativo?

A diferencia del error absoluto, que nos da una idea de la magnitud del error en términos de la unidad de medida, el error relativo nos proporciona una perspectiva de la importancia de ese error en relación con el valor real de la cantidad. Es la relación entre el error absoluto y el valor verdadero. Esta medida es particularmente útil porque nos permite comparar la precisión de diferentes mediciones, incluso si se refieren a cantidades de escalas muy distintas.

La fórmula para el error relativo es:

Error Relativo = Δx / xactual

O, expresado como porcentaje, lo cual es muy común:

Error Relativo (%) = (|xactual - xmedido| / xactual) × 100%

El error relativo no tiene unidades, ya que es una relación entre dos cantidades con las mismas unidades (el error absoluto y el valor actual). Esto lo hace ideal para comparaciones trans-escalares.

Ejemplos Prácticos de Error Absoluto y Relativo

Para ilustrar estos conceptos, consideremos un ejemplo sencillo:

Imagina que la longitud real de un palo es de 100 cm. Al medirlo con una regla, obtienes una longitud de 98.8 cm.

- Calcular el Error Absoluto:

Δx = |100 cm - 98.8 cm| = 1.2 cm

El error absoluto es de 1.2 cm. - Calcular el Error Relativo:

Error Relativo = 1.2 cm / 100 cm = 0.012

Expresado en porcentaje:0.012 × 100% = 1.2%

El error relativo es del 1.2%.

Veamos otro caso, esta vez con masas:

Masa real = 50 g; Masa medida = 47.7 g

- Error Absoluto:

|50 g - 47.7 g| = 2.3 g - Error Relativo:

2.3 g / 50 g = 0.046o4.6%

Importancia del Error Absoluto y Relativo

La importancia de estos errores radica en la certeza de que toda medición posee cierto grado de incertidumbre. Conocer el error nos permite juzgar si un resultado es fiable y cómo se compara con el valor real o aceptado. Este concepto es fundamental en campos como la ciencia, la ingeniería, la estadística y la economía, donde la precisión y la exactitud son críticas.

Por ejemplo, en la vida cotidiana, si estás horneando un pastel y añades 5 gramos de harina de más o de menos (error absoluto), el error relativo te indicará cuán significativo es ese error en comparación con la cantidad total de harina requerida. Si necesitas 500g de harina, 5g de error es un 1%; si necesitas 50g, 5g de error es un 10%, lo que podría afectar mucho más el resultado final del pastel.

Tabla Comparativa: Error Absoluto vs. Error Relativo

| Característica | Error Absoluto | Error Relativo |

|---|---|---|

| Definición | Diferencia entre el valor real y el medido. | Error absoluto dividido por el valor real. |

| Fórmula | |Actual – Medido| | |Actual – Medido| ÷ Actual |

| Unidad | La misma que la medición (ej., cm, g). | Ninguna unidad (a menudo se expresa como %). |

| Cuándo usar | Cuando el tamaño de la desviación es lo que importa (ej., pequeñas piezas). | Para comparar errores en diferentes escalas o magnitudes. |

| Ejemplo | 1.2 cm de error en un palo de 100 cm. | 1.2% de error en un palo de 100 cm. |

Propagación de Errores en Operaciones Matemáticas

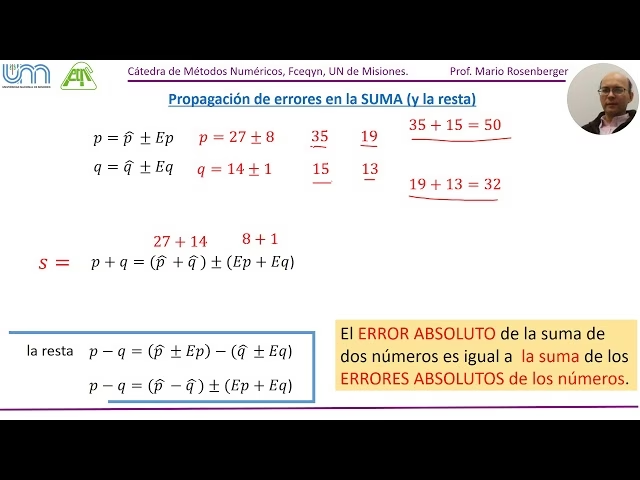

En el mundo real, rara vez una medición se utiliza de forma aislada. A menudo, combinamos varias mediciones a través de sumas, restas, multiplicaciones o divisiones para obtener un resultado final. Pero, ¿qué sucede con los errores de esas mediciones individuales? ¿Cómo afectan al error del resultado final? Esto es lo que se conoce como propagación de errores.

Error en Sumas y Restas

Cuando sumas o restas números que tienen errores, la regla es sorprendentemente sencilla: simplemente sumas los errores absolutos. Esto se aplica tanto si las cantidades se están sumando como si se están restando.

Imagina que estás midiendo una habitación de unos 5 metros de largo, pero solo tienes una cinta métrica de 4 metros y una regla de 1 metro. Primero mides 4 metros con la cinta y luego el metro restante con la regla. Las mediciones obtenidas, con sus respectivos errores, son:

- Cinta métrica:

4.00 ± 0.01 m - Regla:

1.00 ± 0.005 m

Para obtener la longitud total de la habitación, sumamos las mediciones: 4.00 m + 1.00 m = 5.00 m.

Para el error, simplemente sumamos los errores absolutos:

Error total = 0.01 m + 0.005 m = 0.015 m

Así, la longitud total de la habitación es 5.00 ± 0.015 m.

Esta lógica se mantiene incluso en los casos extremos. Si ambas mediciones estuvieran en su límite máximo de error (4.01 m y 1.005 m), el total sería 5.015 m. Si ambas estuvieran en su límite mínimo (3.99 m y 0.995 m), el total sería 4.985 m. Ambos extremos están dentro del rango de 5.00 ± 0.015 m.

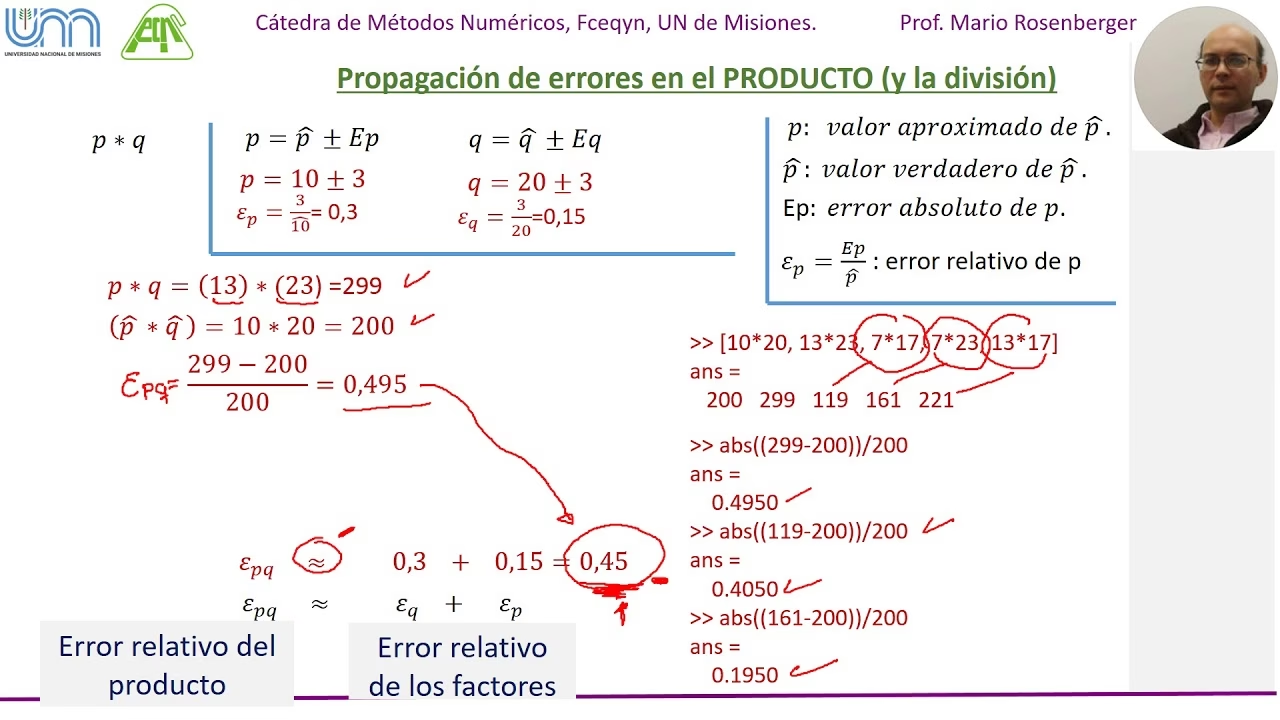

Error en Multiplicaciones

Calcular el error en una multiplicación es más complejo que en sumas y restas, y existen diferentes métodos dependiendo de la magnitud relativa de los errores.

Método para Errores Pequeños (Usando Errores Relativos)

Cuando los errores son pequeños en comparación con los valores de las cantidades medidas (generalmente menos del 1% del valor), el método de los errores relativos es muy efectivo y preciso. La regla es que el error relativo del resultado de una multiplicación es la suma de los errores relativos de los números que se están multiplicando.

Consideremos dos números que se multiplican: a ± x y b ± y, donde x e y son los errores absolutos.

- Primero, calculamos el producto de los números sin considerar los errores:

Resultado = a × b. - Luego, calculamos los errores relativos de cada número:

Error Relativo de a = x / aError Relativo de b = y / b - Sumamos los errores relativos:

Error Relativo Total = (x / a) + (y / b) - Finalmente, para obtener el error absoluto del resultado, multiplicamos el error relativo total por el resultado:

Error Absoluto Total = Error Relativo Total × (a × b)

Ejemplo: Multiplicar 4.00 ± 0.05 por 7.00 ± 0.10.

- Resultado sin error:

4 × 7 = 28 - Errores relativos individuales:

Error Relativo de 4 = 0.05 / 4 = 0.0125Error Relativo de 7 = 0.10 / 7 ≈ 0.01428 - Suma de errores relativos:

Error Relativo Total = 0.0125 + 0.01428 = 0.02678 - Error absoluto del resultado:

Error Absoluto Total = 0.02678 × 28 ≈ 0.75

El resultado final es 28 ± 0.75.

Método para Errores Grandes (Análisis de Casos Extremos)

Cuando los errores no son pequeños en relación con las cantidades medidas (por ejemplo, si el porcentaje de error es superior al 1%), el método de los errores relativos puede no ser tan preciso. En estos casos, se recomienda un enfoque más riguroso que implica calcular los resultados en los escenarios de error más extremos y luego determinar la desviación máxima respecto al valor central.

- Calcula el resultado multiplicando solo los números sin considerar los errores:

Resultado = a × b. - Determina el valor máximo posible del resultado asumiendo los errores positivos más grandes para cada número:

(a + x) × (b + y). - Determina el valor mínimo posible del resultado asumiendo los errores negativos más grandes para cada número:

(a - x) × (b - y). - Calcula la diferencia entre el resultado central y cada uno de los valores extremos. El error final será el mayor de estos dos valores.

Ejemplo: Multiplicar 4.00 ± 0.05 por 7.00 ± 0.10 usando el método de casos extremos.

- Resultado sin error:

4 × 7 = 28 - Valor máximo posible:

(4 + 0.05) × (7 + 0.10) = 4.05 × 7.10 = 28.755 - Valor mínimo posible:

(4 - 0.05) × (7 - 0.10) = 3.95 × 6.90 = 27.255 - Cálculo de la desviación desde el resultado central (28):

|28.755 - 28| = 0.755|27.255 - 28| = 0.745

El error más grande es 0.755.

El resultado final es 28 ± 0.755. Como los errores iniciales suelen darse con una cifra significativa, redondearíamos a 28 ± 0.76 o 28 ± 0.8 dependiendo de la precisión deseada.

Error en Divisiones

Al igual que con la multiplicación, la propagación de errores en la división se maneja de manera similar, especialmente con el método de errores relativos.

Método para Errores Pequeños (Usando Errores Relativos)

La regla es la misma que para la multiplicación: el error relativo del resultado de una división es la suma de los errores relativos de los números involucrados (numerador y denominador).

Consideremos una división: (a ± x) / (b ± y).

- Primero, calculamos el cociente de los números sin errores:

Resultado = a / b. - Calculamos los errores relativos individuales:

Error Relativo de a = x / ayError Relativo de b = y / b. - Sumamos los errores relativos:

Error Relativo Total = (x / a) + (y / b). - Finalmente, obtenemos el error absoluto del resultado:

Error Absoluto Total = Error Relativo Total × (a / b).

Ejemplo: Dividir 4.00 ± 0.05 por 2.00 ± 0.01.

- Resultado sin error:

4 / 2 = 2 - Errores relativos individuales:

Error Relativo de 4 = 0.05 / 4 = 0.0125Error Relativo de 2 = 0.01 / 2 = 0.005 - Suma de errores relativos:

Error Relativo Total = 0.0125 + 0.005 = 0.0175 - Error absoluto del resultado:

Error Absoluto Total = 0.0175 × 2 = 0.035

El resultado final es 2.00 ± 0.035.

Método para Errores Grandes (Análisis de Casos Extremos)

Cuando los errores son grandes, también debemos recurrir al análisis de casos extremos para la división. Sin embargo, los escenarios para obtener el valor máximo y mínimo son diferentes a los de la multiplicación.

- Calcula el resultado dividiendo solo los números sin errores:

Resultado = a / b. - Para encontrar el valor máximo posible del resultado, usa el error positivo para el numerador y el error negativo para el denominador:

(a + x) / (b - y). Esto maximiza el numerador y minimiza el denominador, dando el valor más alto. - Para encontrar el valor mínimo posible del resultado, usa el error negativo para el numerador y el error positivo para el denominador:

(a - x) / (b + y). Esto minimiza el numerador y maximiza el denominador, dando el valor más bajo. - Calcula la diferencia entre el resultado central y cada uno de los valores extremos. El error final será el mayor de estos dos valores.

Ejemplo: Dividir 4.00 ± 0.05 por 2.00 ± 0.01 usando el método de casos extremos.

- Resultado sin error:

4 / 2 = 2 - Valor máximo posible:

(4 + 0.05) / (2 - 0.01) = 4.05 / 1.99 ≈ 2.03517 - Valor mínimo posible:

(4 - 0.05) / (2 + 0.01) = 3.95 / 2.01 ≈ 1.96517 - Cálculo de la desviación desde el resultado central (2):

|2.03517 - 2| = 0.03517|1.96517 - 2| = 0.03483

El error más grande es 0.03517.

El resultado final es 2.00 ± 0.035 (redondeando).

Metrología, Calibración y Errores Instrumentales

La metrología es la ciencia de las mediciones y sus aplicaciones. Es una disciplina crucial que busca asegurar la exactitud y fiabilidad de todas las mediciones. Dentro de este campo, la calibración juega un papel fundamental para garantizar que los instrumentos de medida proporcionen resultados precisos y trazables a estándares nacionales o internacionales.

La calibración es el procedimiento de comparar lo que indica un instrumento de medición con lo que debería indicar según un patrón de referencia conocido. Durante este proceso, se identifican los errores de indicación del equipo. Si el error es mayor que un límite aceptable, el instrumento debe ser ajustado. Este ajuste es una operación destinada a llevar el instrumento a un estado de funcionamiento conveniente.

Durante una calibración, se pueden identificar varios tipos de errores inherentes al instrumento o al proceso de medición:

- Error de Cero: Ocurre cuando las lecturas del instrumento están sistemáticamente desplazadas por un mismo valor constante respecto a la lectura correcta, incluso cuando el valor real es cero.

- Error de Multiplicación (o Ganancia): Este es un tipo de error instrumental donde el valor de las lecturas aumenta o disminuye progresivamente (de forma proporcional) respecto a la característica ideal del instrumento a medida que la variable medida aumenta. Es como si la escala del instrumento estuviera 'estirada' o 'comprimida'. Este error es diferente a la propagación de error cuando multiplicamos dos cantidades medidas; aquí se refiere a un comportamiento erróneo en la propia escala del equipo de medición.

- Error de Angularidad (o Linealidad): Se presenta cuando las lecturas son correctas en los extremos del rango (0% y 100%), pero se desvían en los puntos intermedios. Esto indica una falta de linealidad en la respuesta del instrumento.

El objetivo de la calibración es documentar estos errores y, si es posible, ajustarlos para que el instrumento opere dentro de las tolerancias requeridas. Esta práctica es vital para asegurar la confiabilidad de los datos en cualquier aplicación, desde la investigación científica hasta la producción industrial.

Tipos de Incertidumbre en la Medición

La incertidumbre de una medida es un parámetro no negativo que caracteriza la dispersión de los valores que podrían atribuirse razonablemente a la magnitud que se mide. Generalmente, se clasifica en dos tipos principales:

- Incertidumbre Tipo A: Se estima a partir de cálculos estadísticos basados en una serie de observaciones repetidas del mensurando bajo las mismas condiciones. La mejor estimación del valor es la media aritmética de las observaciones, y la incertidumbre se deriva de la desviación estándar experimental de la media.

- Incertidumbre Tipo B: Se evalúa por métodos no estadísticos, basándose en la experiencia, información previa (como certificados de calibración), especificaciones del fabricante, o datos de otras fuentes. Este tipo de incertidumbre se caracteriza por una distribución de probabilidad asumida (por ejemplo, rectangular o triangular) para la cual se estima una desviación típica.

La combinación de estas incertidumbres da lugar a la incertidumbre típica combinada (u), y al multiplicarla por un factor de cobertura (k), se obtiene la incertidumbre expandida (U). Esta última define un intervalo alrededor del resultado de la medición en el que se espera encontrar el valor verdadero con un nivel de confianza específico (ej., 95% para k=2).

Errores Comunes y Malentendidos

Al trabajar con errores y mediciones, es fácil caer en ciertas trampas. Estar consciente de estos errores comunes puede ayudarte a evitarlos:

- Confundir Error Absoluto con Error Relativo: Son conceptos distintos con diferentes aplicaciones. El absoluto indica la magnitud, el relativo la importancia.

- Olvidar las Unidades para el Error Absoluto: El error absoluto siempre debe tener las mismas unidades que la cantidad medida. El error relativo, en cambio, no tiene unidades.

- Usar el Valor Medido en Lugar del Valor Actual (Verdadero) para el Error Relativo: La fórmula del error relativo siempre utiliza el valor real o actual en el denominador.

- No Tomar el Valor Absoluto: Al calcular el error absoluto, siempre se debe usar el valor absoluto de la diferencia, ignorando el signo negativo.

- Sumar Errores Relativos en Sumas/Restas: Para sumas y restas, se suman los errores absolutos, no los relativos. La suma de errores relativos es para multiplicaciones y divisiones (en el caso de errores pequeños).

Preguntas Frecuentes (FAQs)

¿Por qué es importante calcular los errores en las mediciones?

Es crucial porque ninguna medición es perfectamente precisa. Calcular los errores nos permite entender el nivel de fiabilidad de nuestros datos, comparar la calidad de diferentes mediciones y garantizar que los resultados sean aptos para el propósito previsto, especialmente en campos donde la exactitud es vital como la ciencia, la ingeniería o la medicina.

¿Cuál es la diferencia principal entre exactitud y precisión?

La exactitud se refiere a cuán cerca está una medición del valor verdadero o real de la cantidad. La precisión, por otro lado, se refiere a cuán cerca están entre sí varias mediciones repetidas de la misma cantidad, independientemente de su cercanía al valor verdadero.

¿Cuándo debo usar el método de errores relativos para la propagación de errores en multiplicación/división?

El método de sumar errores relativos es adecuado y suficientemente preciso cuando los errores individuales de las cantidades medidas son pequeños en comparación con sus valores (generalmente, si el error porcentual es menor al 1-5%). Para errores más grandes, el método de casos extremos ofrece una estimación más robusta.

¿Qué significa el 'error de multiplicación' en el contexto de un instrumento de medida?

En el contexto de un instrumento de medida y su calibración, el 'error de multiplicación' es un tipo de error sistemático donde las lecturas del instrumento se desvían progresivamente (aumentando o disminuyendo) de la lectura correcta a medida que el valor medido aumenta. No debe confundirse con la propagación del error cuando se multiplican dos cantidades medidas.

¿Cómo influye la calibración en la reducción de errores?

La calibración es fundamental para identificar y corregir los errores inherentes a un instrumento de medida. Al comparar el instrumento con un patrón de referencia, se pueden ajustar sus valores para que sean lo más exactos posible, minimizando así los errores sistemáticos y asegurando la trazabilidad y fiabilidad de las mediciones futuras.

¿Es posible eliminar completamente el error en una medición?

No, es imposible eliminar completamente el error en una medición. Siempre existirá alguna incertidumbre residual debido a limitaciones del instrumento, factores ambientales, habilidades del operador, o la propia naturaleza del fenómeno medido. El objetivo es cuantificar y minimizar los errores a un nivel aceptable para el uso previsto.

Conclusión

La comprensión y el manejo de los errores en las mediciones son habilidades indispensables en cualquier disciplina que requiera cuantificación. Hemos explorado desde los conceptos fundamentales del error absoluto y relativo, que nos permiten evaluar la desviación y la significancia de una sola medición, hasta las metodologías para la propagación de errores en operaciones como la suma, resta, multiplicación y división. Es vital recordar que la elección del método para la propagación de errores depende de la magnitud relativa de los errores involucrados.

Además, hemos subrayado el papel crucial de la metrología y la calibración en la minimización de errores instrumentales, como el “error de multiplicación” que afecta a la linealidad de un equipo. Al dominar estos conceptos y aplicar las fórmulas correctas, no solo mejoraremos la precisión de nuestros resultados, sino que también desarrollaremos una mentalidad crítica para evaluar la fiabilidad de cualquier dato numérico. La exactitud y la confianza en las mediciones son el cimiento de decisiones informadas y del avance en cualquier campo del conocimiento.

Si quieres conocer otros artículos parecidos a Dominando el Error: Precisión en tus Cálculos puedes visitar la categoría Cálculos.