17/02/2022

En el fascinante mundo de la electrónica y la electricidad, realizar mediciones precisas es fundamental para garantizar el correcto funcionamiento de los circuitos y sistemas. Sin embargo, ninguna medición es perfecta; siempre existirá un grado de incertidumbre o error. Entender cómo se calcula y se interpreta este error, especialmente cuando utilizamos una herramienta tan esencial como el multímetro, es crucial para cualquier aficionado, estudiante o profesional. Este artículo te guiará a través de los conceptos clave de exactitud, precisión, resolución y rango, y te enseñará a desentrañar las especificaciones de tu multímetro para determinar la fiabilidad de tus lecturas.

- Comprendiendo el Error en la Medición: Fundamentos Básicos

- Exactitud vs. Precisión: Distinciones Cruciales en tu Multímetro

- Resolución y Rango: Detallando tus Mediciones

- Cuentas y Dígitos: La Resolución del Display

- Cálculo del Error en el Multímetro: Un Ejemplo Práctico

- Tabla Comparativa de Exactitud de Multímetros

- Preguntas Frecuentes sobre el Error en Multímetros

Comprendiendo el Error en la Medición: Fundamentos Básicos

Antes de sumergirnos en los detalles específicos del multímetro, es vital entender qué es el error de medición en un sentido más amplio. Cuando medimos una magnitud, como una tensión o una corriente, el valor que obtenemos es una aproximación del valor real. La diferencia entre el valor medido y el valor real es lo que conocemos como error. En física y metrología, si la magnitud medida es 'x', su error se denota como Δx.

El resultado de una medición se expresa comúnmente de la siguiente forma: x = (x₀ ± Δx) [unidades]. Aquí, x₀ es el valor medido y Δx es la incertidumbre o error absoluto, ambos expresados en las mismas unidades. Las mediciones directas son aquellas que se obtienen directamente de un instrumento de medida, como es el caso de un multímetro.

Exactitud vs. Precisión: Distinciones Cruciales en tu Multímetro

Aunque a menudo se usan indistintamente, la exactitud y la precisión son conceptos distintos y fundamentales al evaluar la calidad de las mediciones de un multímetro. Comprender su diferencia es el primer paso para interpretar correctamente los datos que obtienes.

¿Qué es la Exactitud en un Multímetro Digital?

La exactitud se refiere a cuán cerca está una medida del valor real (o verdadero) de la señal que se está midiendo. Se expresa como el máximo índice de error permisible bajo condiciones de funcionamiento específicas. Generalmente se da como un porcentaje. Por ejemplo, si un multímetro tiene una exactitud del ±3% y mides 100 V, la lectura podría estar en cualquier punto entre 97 V y 103 V.

La necesidad de una mayor exactitud varía según la aplicación. Para simplemente verificar si una toma de corriente de 115 V AC tiene tensión, un multímetro con ±3% de exactitud podría ser suficiente, ya que las tensiones de línea pueden fluctuar un ±5% o más. Sin embargo, para aplicaciones críticas como la calibración en automoción, medicina, aviación o equipos industriales especializados, se requiere una exactitud mucho mayor. Un multímetro con ±2% de exactitud en una lectura de 100,0 V podría oscilar entre 98,0 V y 102,0 V. Este margen es inaceptable para componentes electrónicos delicados.

Las especificaciones de exactitud de un multímetro digital a menudo incluyen una cantidad de dígitos (o cuentas) que se suman al nivel básico de exactitud. Por ejemplo, una exactitud de ±(2% + 2 dígitos) para una lectura de 100,0 V significa que el error se calcula sumando el 2% de la lectura más el valor de 2 unidades del dígito menos significativo. Si la resolución es de 0,1 V (es decir, el último dígito representa décimas de voltio), entonces 2 dígitos equivaldrían a 0,2 V. Por lo tanto, el error total sería (2% de 100,0 V) + 0,2 V = 2,0 V + 0,2 V = 2,2 V. Esto implicaría que la lectura de 100,0 V podría variar de 97,8 V a 102,2 V.

Los multímetros digitales de alta calidad, como los de Fluke, ofrecen exactitudes básicas de CC que pueden oscilar entre el 0,5% y el 0,025%, permitiendo su uso en una amplia gama de aplicaciones.

¿Qué Precisión Tiene un Multímetro Digital?

La precisión, por otro lado, se refiere a la capacidad de un multímetro digital para obtener la misma medida de forma repetida bajo las mismas condiciones. Piensa en un tirador que dispara a un objetivo: si todos los disparos están muy juntos, pero lejos del centro de la diana, el tirador (o el rifle) es preciso, pero no exacto. Si los disparos están agrupados muy cerca del centro, entonces es tanto exacto como preciso. Si los disparos están dispersos aleatoriamente, no es ni exacto ni preciso.

En ciertas situaciones, la precisión o repetitividad puede ser incluso más importante que la exactitud. Si las mediciones son consistentemente precisas (repetibles), incluso si hay un ligero sesgo o error constante, este patrón de error puede ser identificado y corregido, lo que lleva a resultados finales más fiables.

Resolución y Rango: Detallando tus Mediciones

Además de la exactitud y la precisión, otros dos términos clave que definen la capacidad de medición de un multímetro son la resolución y el rango.

¿Qué se Entiende por Resolución de la Medida?

La resolución es el menor incremento que un instrumento es capaz de detectar y mostrar. Es, en esencia, la 'finura' de la medición. Imagina dos reglas: una con marcas cada milímetro y otra con marcas cada centímetro. La primera ofrece una resolución mucho mayor porque puede detectar y mostrar cambios más pequeños.

Aplicado a un multímetro, si este tiene una resolución de 1 mV (0,001 V) en el rango de 3 V, significa que puedes observar cambios de tan solo una milésima de voltio. Si mides una batería de 1,5 V, el multímetro podría mostrar 1,500 V y tú podrías notar si la tensión cambia a 1,499 V o 1,501 V.

La resolución también se puede especificar como 'resolución máxima', que es el valor mínimo que se puede distinguir en el ajuste de rango más bajo del multímetro. Por ejemplo, una resolución máxima de 100 mV (0,1 V) indica que en el rango más alto, la lectura se mostrará con una precisión de décimas de voltio. Para mejorar la resolución, generalmente se debe reducir el ajuste de rango del multímetro, siempre y cuando la medida se encuentre dentro de ese rango establecido.

¿Cuál es el Rango de un Multímetro?

El rango de un multímetro se refiere a los límites de medición que el instrumento puede manejar para una magnitud específica (tensión, corriente, resistencia, etc.). Muchos multímetros modernos incorporan una función de 'rango automático' que selecciona automáticamente el rango más adecuado para la magnitud de la medida. Esto no solo facilita el uso, sino que también ayuda a obtener la mejor resolución posible para la lectura.

Si la magnitud medida es mayor que el rango seleccionado, el multímetro generalmente mostrará 'OL' (sobrecarga). Para obtener la medida más exacta posible, se recomienda utilizar el ajuste de rango más bajo que no provoque una sobrecarga. La relación entre rango y resolución es crucial, como se muestra en la siguiente tabla:

| Rango | Resolución |

|---|---|

| 300,0 mV | 0,1 mV (0,0001 V) |

| 3,000 V | 1 mV (0,001 V) |

| 30,00 V | 10 mV (0,01 V) |

| 300,0 V | 100 mV (0,1 V) |

| 1000 V | 1000 mV (1 V) |

Cuentas y Dígitos: La Resolución del Display

Para describir la resolución de un multímetro digital, se utilizan comúnmente los términos 'número de cuentas' y 'dígitos'. Aunque históricamente se usaban más los dígitos, hoy en día es más común clasificar los multímetros por el número total de cuentas que pueden mostrar.

Número de Cuentas

El número de cuentas de un multímetro digital indica la resolución máxima de su pantalla. Cuanto mayor es el número de cuentas, mayor es la resolución para ciertas medidas. Por ejemplo, un multímetro de 6000 cuentas puede mostrar un valor de hasta 5999 en su pantalla. Esto significa que, en un rango de 6 V, puede mostrar 5,999 V, mientras que un multímetro de 2000 cuentas en el mismo rango de 2 V solo podría mostrar hasta 1,999 V. Los multímetros de Fluke, por ejemplo, ofrecen modelos de 3½ dígitos con hasta 6000 cuentas, y modelos de 4½ dígitos con 20.000 o incluso 50.000 cuentas, lo que permite una mayor granularidad en las mediciones.

Dígitos

El término dígitos se refiere a la capacidad de visualización del multímetro. Un multímetro de 3½ dígitos puede mostrar tres dígitos completos (del 0 al 9) y un 'medio dígito'. Este medio dígito, que es el más significativo, solo puede ser un 1 o permanecer en blanco. Esto significa que la pantalla puede ir, por ejemplo, de 0,000 a 1,999, o de 00,00 a 19,99, y así sucesivamente, dependiendo del rango. Un multímetro de 4½ dígitos, por su parte, puede mostrar cuatro dígitos completos y un medio dígito, lo que inherentemente le confiere una resolución mayor que uno de 3½ dígitos.

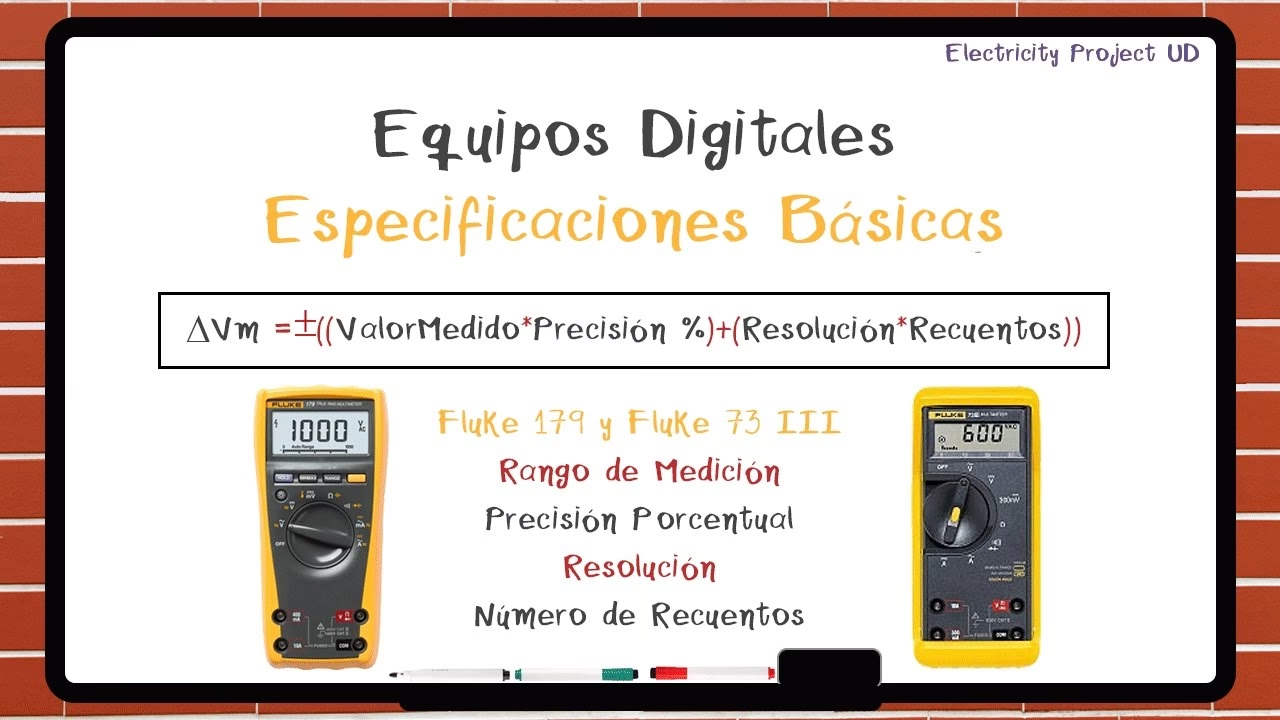

Cálculo del Error en el Multímetro: Un Ejemplo Práctico

Ahora que hemos cubierto los conceptos fundamentales, veamos cómo se aplica la fórmula de cálculo del error en un escenario real, tal como se especifica en las hojas de datos de los multímetros.

La fórmula general para el error en un multímetro es: Error = ±(X% de la lectura + Y dígitos).

Tomemos el ejemplo proporcionado: si el valor real es 2,000 V y se mide en el rango de 5,000 V, con una exactitud especificada como ±(0,08 % de la lectura + 2 dígitos).

- Calcular el porcentaje de la lectura:

- 0,08 % de 2,000 V = (0,08 / 100) * 2,000 V = 0,0008 * 2,000 V = 0,0016 V.

- Calcular el error por dígitos:

- El término '2 dígitos' se refiere a 2 veces el valor del dígito menos significativo que el multímetro puede mostrar en ese rango. En un rango de 5,000 V, la pantalla de un multímetro de alta resolución típicamente mostraría hasta tres decimales (ej: 2,000 V). Por lo tanto, el dígito menos significativo es el milivoltio (0,001 V).

- Entonces, 2 dígitos = 2 * 0,001 V = 0,002 V.

- Sumar ambos componentes para obtener el error total:

- Error total = 0,0016 V (porcentaje) + 0,002 V (dígitos) = 0,0036 V.

Esto significa que el valor medido estará dentro de un rango de ±0,0036 V del valor real. Por lo tanto, si el valor real es 2,000 V, el multímetro mostrará una lectura que podría estar entre:

- Límite inferior: 2,000 V - 0,0036 V = 1,9964 V

- Límite superior: 2,000 V + 0,0036 V = 2,0036 V

El ejemplo original redondea este rango a 1,996 V a 2,004 V, lo que implica un redondeo del error total a 0,004 V para fines prácticos de especificación o visualización. Es importante tener en cuenta que las especificaciones pueden redondearse para simplificar la interpretación, pero el cálculo subyacente sigue los principios que hemos descrito.

Tabla Comparativa de Exactitud de Multímetros

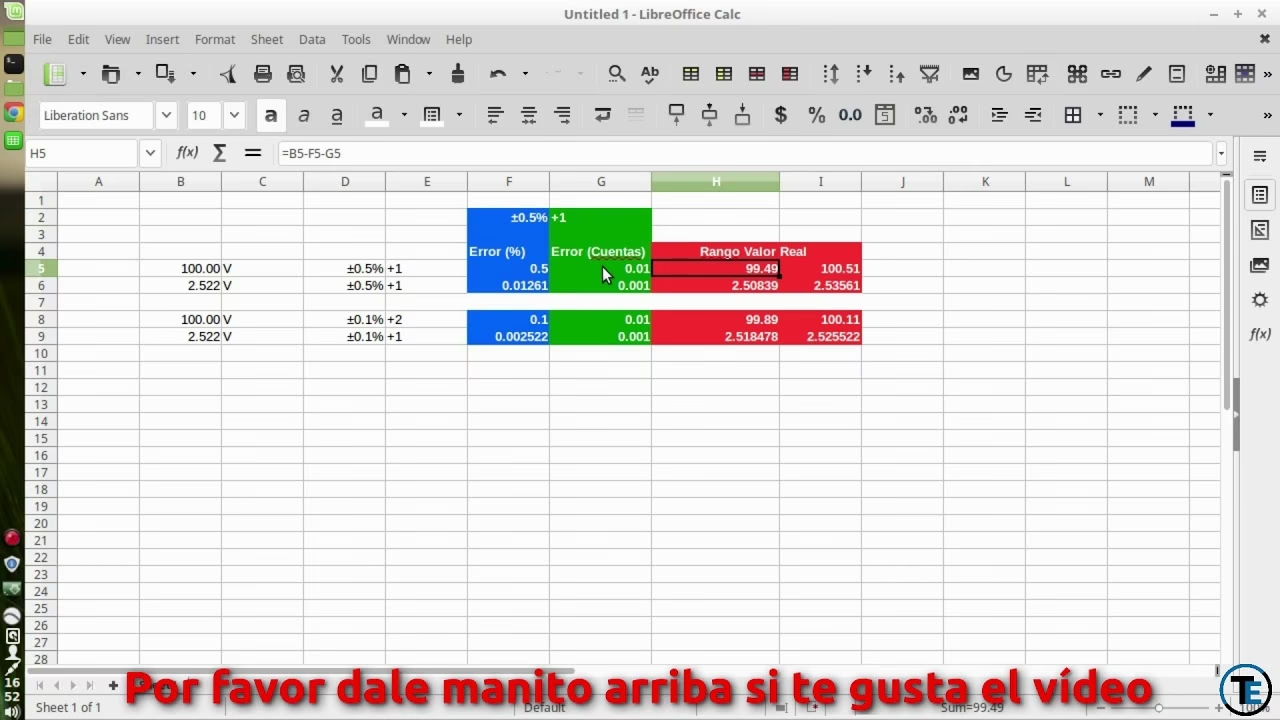

Para ilustrar mejor cómo las diferentes especificaciones de exactitud impactan el rango de una medición, consideremos una lectura hipotética de 100,0 V con distintos tipos de multímetros:

| Tipo de Multímetro | Especificación de Exactitud | Lectura Esperada | Error por Porcentaje | Error por Dígitos (asumiendo 0,1V/dígito) | Error Total (Absoluto) | Rango de Valor Medido |

|---|---|---|---|---|---|---|

| Básico | ±(2% + 2 dígitos) | 100,0 V | 2% de 100 V = 2,0 V | 2 * 0,1 V = 0,2 V | 2,0 V + 0,2 V = 2,2 V | 97,8 V a 102,2 V |

| Estándar | ±(0,5% + 1 dígito) | 100,0 V | 0,5% de 100 V = 0,5 V | 1 * 0,1 V = 0,1 V | 0,5 V + 0,1 V = 0,6 V | 99,4 V a 100,6 V |

| Alta Precisión | ±(0,08% + 2 dígitos) | 100,0 V | 0,08% de 100 V = 0,08 V | 2 * 0,1 V = 0,2 V | 0,08 V + 0,2 V = 0,28 V | 99,72 V a 100,28 V |

Esta tabla demuestra cómo un multímetro con mayor exactitud (menor porcentaje y/o menor número de dígitos de error) reduce significativamente el rango de incertidumbre de la medición, acercándote más al valor real.

Preguntas Frecuentes sobre el Error en Multímetros

¿Por qué es importante la exactitud en un multímetro?

La exactitud es crucial porque determina cuán cerca está tu lectura del valor real de la magnitud que estás midiendo. En aplicaciones donde las tolerancias son estrictas, como en la electrónica de precisión, la medicina o la automoción, una alta exactitud es indispensable para evitar fallos, diagnósticos erróneos o daños a los componentes. Utilizar un multímetro con la exactitud adecuada para la tarea garantiza la fiabilidad y utilidad de tus mediciones.

¿Cuál es la diferencia principal entre exactitud y precisión?

La exactitud se refiere a la cercanía de una medición al valor verdadero, mientras que la precisión se refiere a la repetibilidad o consistencia de las mediciones. Un multímetro puede ser muy preciso (siempre da la misma lectura) pero inexacto (esa lectura consistente está lejos del valor real). Idealmente, un buen multímetro debe ser tanto exacto como preciso.

¿Cómo afecta la resolución a mis mediciones?

La resolución determina el nivel de detalle que tu multímetro puede mostrar. Una mayor resolución te permite detectar cambios más pequeños en la magnitud medida, lo cual es vital para ajustar circuitos finamente o detectar pequeñas variaciones que podrían indicar un problema. Sin una resolución adecuada, podrías pasar por alto anomalías críticas.

¿Qué significa "X% + Y dígitos" en la especificación de un multímetro?

Esta es la forma estándar de especificar la exactitud. "X% de la lectura" indica una parte del error que es proporcional al valor que estás midiendo. "Y dígitos" (o "Y cuentas") indica una parte del error que es fija, basada en la resolución de la pantalla del multímetro. Esta última parte es un valor absoluto que se suma al error porcentual, representando la incertidumbre asociada con el último dígito del display.

¿Cuándo debo usar un multímetro de mayor exactitud?

Debes considerar un multímetro de mayor exactitud cuando la aplicación lo requiera. Esto incluye el diseño o prueba de circuitos sensibles, la calibración de equipos, la resolución de problemas en sistemas críticos (médicos, aeronáuticos), o cualquier situación donde un pequeño error en la medición pueda tener consecuencias significativas. Para tareas generales como verificar la continuidad o la presencia de tensión en circuitos no críticos, un multímetro de exactitud estándar suele ser suficiente.

Dominar el arte de la medición implica mucho más que simplemente conectar las puntas de prueba a un circuito. Requiere una profunda comprensión de las capacidades y limitaciones de tus herramientas. Al entender cómo se calcula e interpreta el error en tu multímetro, y al diferenciar entre exactitud, precisión, resolución y rango, te equipas con el conocimiento necesario para tomar decisiones informadas, garantizar la fiabilidad de tus resultados y, en última instancia, trabajar con mayor confianza y eficacia en cualquier proyecto de electrónica.

Si quieres conocer otros artículos parecidos a ¿Cómo Calcular el Error en tu Multímetro? puedes visitar la categoría Cálculos.