24/06/2023

En el vasto y complejo universo de la estadística y el aprendizaje automático, la precisión de nuestras estimaciones es un pilar fundamental. Sin embargo, nuestras predicciones y modelos rara vez son perfectos. Aquí es donde entran en juego los conceptos de error de estimación, que nos ayudan a cuantificar y comprender las desviaciones entre lo que observamos o modelamos y la realidad subyacente. Aunque la frase 'error de estimación' puede parecer genérica, en campos avanzados como el aprendizaje automático se descompone en componentes específicos, mientras que en estadística clásica se refiere a una medida de variabilidad clave. Este artículo explorará dos facetas cruciales de este concepto: el error de aproximación, fundamental en la teoría del aprendizaje, y el error estándar de estimación, vital para la inferencia estadística.

Comprender estos dos tipos de errores no solo es crucial para la construcción de modelos robustos, sino también para la interpretación correcta de los resultados. Nos permiten discernir si un problema radica en la elección de nuestro modelo (sesgo) o en la variabilidad inherente a los datos muestreados (varianza). Dominar esta distinción es el primer paso para construir sistemas predictivos más fiables y tomar decisiones informadas en cualquier campo que dependa del análisis de datos.

- El Error de Aproximación: La Brecha del Modelo

- El Error Estándar de Estimación: La Variabilidad del Muestreo

- Diferencias Clave y Relación entre los Errores

- Preguntas Frecuentes (FAQs)

- ¿Cuál es la diferencia principal entre el error de aproximación y el error estándar?

- ¿Por qué es importante el error estándar?

- ¿Cómo afecta el tamaño de la muestra al error estándar?

- ¿Qué es la dimensión VC y por qué es relevante para el error de aproximación?

- ¿Qué es la regularización en este contexto y cómo ayuda a reducir el error?

- ¿Qué es el clasificador de Bayes óptimo (f_Bayes)?

- Conclusión

El Error de Aproximación: La Brecha del Modelo

En el contexto del aprendizaje automático y la teoría de la clasificación, el error de aproximación es una pieza fundamental para lograr la consistencia de Bayes. Para entenderlo, primero debemos recordar que el error de estimación (en este contexto, la diferencia entre el riesgo de un clasificador entrenado con datos y el riesgo del mejor clasificador posible dentro de una clase de funciones dada) busca asegurar la consistencia con respecto a una clase de funciones específica, F. Sin embargo, para alcanzar la consistencia de Bayes (es decir, que nuestro clasificador converja al clasificador óptimo de Bayes, el mejor posible para una distribución de datos dada), necesitamos considerar otra pieza del rompecabezas: el error de aproximación.

Formalmente, el error de estimación se define como R(f_n) − R(f_F), donde R(f_n) es el riesgo del clasificador obtenido con 'n' puntos de datos y R(f_F) es el riesgo del mejor clasificador posible dentro de la clase de funciones F. El error de aproximación, por su parte, se define como R(f_F) − R(f_Bayes), donde R(f_Bayes) es el riesgo del clasificador de Bayes óptimo. Para lograr la consistencia de Bayes, ambos términos deben tender a cero a medida que el número de datos (n) tiende a infinito.

El problema surge cuando intentamos reducir el error de estimación. Para que este converja a cero, la clase de funciones F debe tener una capacidad razonablemente pequeña (es decir, no ser demasiado compleja). Pero esto crea un dilema para el error de aproximación: si F es demasiado simple o tiene una capacidad pequeña, es muy probable que el clasificador de Bayes óptimo (f_Bayes) no esté contenido en F. En tal caso, el error de aproximación podría no ser cero, sin importar cuántos datos tengamos.

Cómo Abordar el Error de Aproximación

Existen principalmente dos caminos para resolver este problema y asegurar que el error de aproximación se anule:

1. Hacer Suposiciones sobre el Clasificador de Bayes

La primera forma es asumir que el clasificador de Bayes óptimo (f_Bayes) ya pertenece a una clase de funciones F conocida y con baja capacidad. Si f_Bayes ∈ F, entonces el error de aproximación es cero por definición. En este escenario, la consistencia de Bayes se reduce a la consistencia con respecto a F, que puede lograrse con métodos estándar para controlar el error de estimación. Sin embargo, esta aproximación es limitada, ya que a menudo no podemos hacer suposiciones tan fuertes sobre la forma funcional del clasificador de Bayes óptimo en situaciones reales.

2. Trabajar con Espacios de Funciones Anidados

Si no queremos hacer suposiciones restrictivas sobre el clasificador de Bayes, la alternativa es utilizar una construcción diferente. En lugar de una única clase de funciones F, consideramos una secuencia de espacios de funciones anidados: F_1, F_2, F_3, … . La clave aquí es que el espacio F_n se vuelve progresivamente más complejo a medida que el tamaño de la muestra (n) aumenta. La construcción estándar es elegir espacios F_n que formen una secuencia creciente de espacios de funciones anidados, es decir, F_1 ⊂ F_2 ⊂ F_3 ⊂ … . La intuición es que comenzamos con un espacio de funciones simple y gradualmente añadimos funciones más y más complejas al espacio.

Para que un clasificador construido a partir de F_n sea consistente con Bayes, deben cumplirse dos condiciones:

El error de estimación debe converger a 0 a medida que n → ∞. Aunque el límite del error de estimación disminuye con el tamaño de la muestra, aumenta con la complejidad del espacio de funciones. Es crucial asegurar que la complejidad de F_n no crezca demasiado rápido para que el error de estimación general siga disminuyendo.

El error de aproximación debe converger a 0 a medida que n → ∞. Esto significa que, eventualmente, para un n suficientemente grande, cada función del espacio de todas las funciones posibles (F_all) debe estar contenida en F_n, o al menos poder ser aproximada arbitrariamente bien por una función de F_n.

Un teorema fundamental en la teoría del aprendizaje establece que si la dimensión VC (una medida de complejidad de la clase de funciones) de F_n satisface VC(F_n) ⋅ log(n) / n → 0 cuando n → ∞, y R(f_F_n) → R(f_Bayes) cuando n → ∞, entonces la secuencia de clasificadores es consistente con Bayes. La primera condición asegura que la complejidad de F_n no crezca demasiado rápido, y la segunda que el error de aproximación tienda a cero. Por ejemplo, si la dimensión VC de F_n crece como n^α con α ∈ ]0,1[, la primera condición se satisface, permitiendo un equilibrio entre la complejidad del modelo y la cantidad de datos.

Regularización: Una Forma Implícita de Espacios Anidados

Una manera implícita de trabajar con espacios de funciones anidados es a través del principio de regularización. En lugar de simplemente minimizar el riesgo empírico (R_emp(f)), se minimiza el riesgo regularizado: R_reg(f) = R_emp(f) + λΩ(f). Aquí, Ω(f) es el 'regularizador', una función que penaliza las funciones excesivamente complejas. Por ejemplo, Ω(f) puede penalizar funciones con grandes fluctuaciones, favoreciendo aquellas que varían lentamente. El parámetro λ (lambda) es una constante de compensación que equilibra la importancia del riesgo empírico y la penalización de complejidad. Un λ grande significa que priorizamos la simplicidad del modelo, incluso si eso implica un riesgo empírico ligeramente mayor; un λ pequeño reduce la influencia de la penalización, haciendo que el modelo se ajuste más a los datos observados.

Muchos clasificadores populares, como las Máquinas de Vectores de Soporte (SVM), pueden formularse dentro del marco de la regularización. Para probar la consistencia de Bayes de los clasificadores regularizados, se considera una secuencia de espacios de funciones anidados F_ω1, F_ω2, … donde cada F_ωi contiene todas las funciones f con Ω(f) ≤ ωi. A medida que ωi aumenta, estos espacios se vuelven más inclusivos, aproximándose al espacio de todas las funciones (F_all). Para la consistencia, la constante λ debe tender a cero a medida que n → ∞, pero no demasiado rápido, para evitar el sobreajuste en muestras pequeñas.

Lograr un Error de Aproximación Cero

El teorema mencionado postula que el error de aproximación debe converger a cero. ¿Cómo se logra esto en la práctica? La clave es asegurar que cada función en F_all pueda ser contenida o aproximada arbitrariamente bien por una función de F_n para un n lo suficientemente grande. La rama de las matemáticas que se ocupa de este tipo de problemas es la teoría de la aproximación. Por ejemplo, se sabe que en un subconjunto acotado de los números reales, cualquier función medible puede aproximarse arbitrariamente bien por un polinomio. Esto significa que podríamos elegir F_n como espacios de polinomios con un grado máximo d_n, donde d_n crece lentamente con n, garantizando la convergencia del error de aproximación.

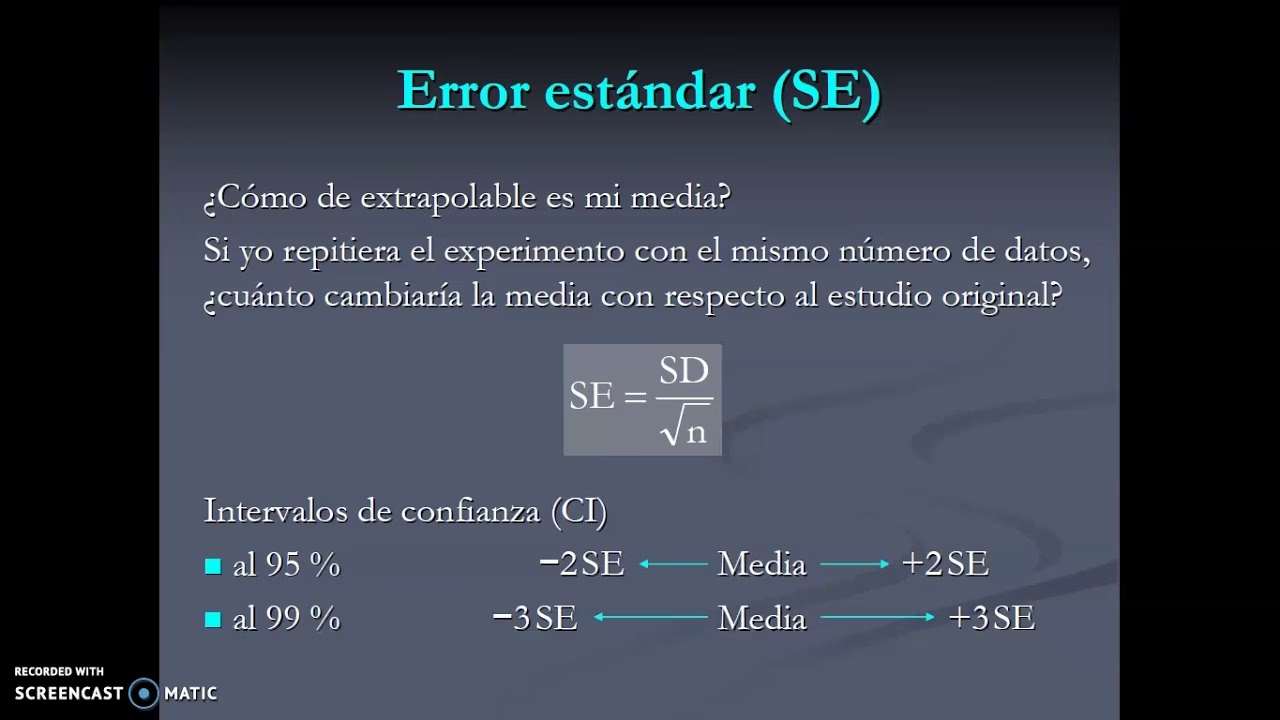

El Error Estándar de Estimación: La Variabilidad del Muestreo

Mientras que el error de aproximación se centra en el sesgo inherente a la elección de la clase de modelos, el error estándar de estimación se relaciona con la variabilidad de nuestras estimaciones debido al muestreo. En estadística, cuando tomamos múltiples muestras de una misma población y calculamos una estadística (como la media) para cada muestra, estas estadísticas varían. La distribución de estas estadísticas muestrales tiene su propia desviación estándar, y a esta desviación estándar de la distribución de las medias muestrales se le conoce como el error estándar.

El error estándar nos indica cuán precisamente la media de una muestra dada representa la verdadera media de la población. Es una medida crucial de la precisión de un estimador muestral.

Error Estándar Grande vs. Pequeño

- Un error estándar grande indica que las medias muestrales están más dispersas alrededor de la media poblacional. Esto sugiere que es más probable que la media de su muestra sea una representación inexacta de la verdadera media de la población.

- Por otro lado, un error estándar pequeño indica que las medias muestrales están más agrupadas. Esto implica que es más probable que la media de su muestra sea una representación precisa de la verdadera media de la población.

El error estándar aumenta cuando la desviación estándar de la población (o de la muestra) aumenta, ya que una mayor variabilidad en los datos individuales se traduce en una mayor variabilidad en las medias muestrales. Sin embargo, el error estándar disminuye cuando el tamaño de la muestra (n) aumenta. Cuantos más datos tenga, menos variación habrá en sus resultados muestrales, lo que conduce a una estimación más precisa de la media poblacional.

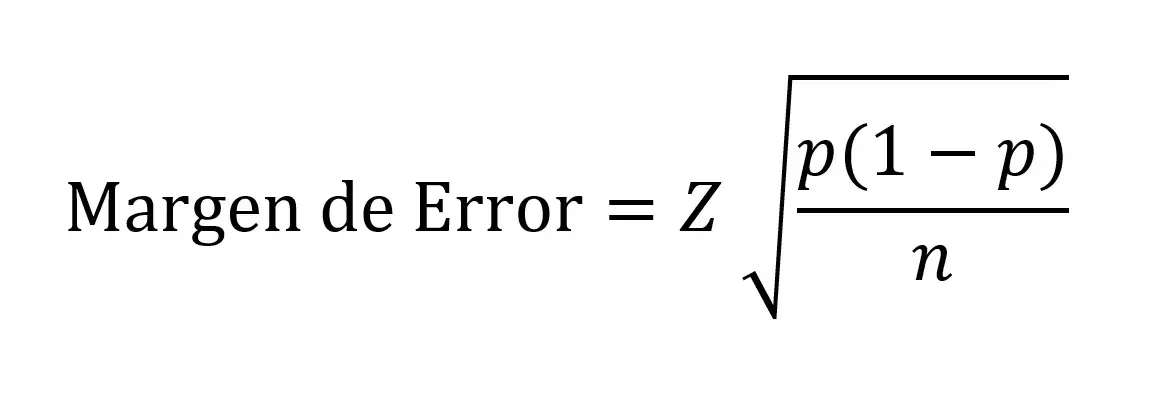

Fórmula del Error Estándar

La fórmula para calcular el error estándar (SE) de la media muestral es la siguiente:

SE = σ / √n

- SE = Error Estándar de la Muestra

- σ (sigma) = Desviación Estándar de la Muestra (o de la población, si se conoce)

- n = Número de Muestras (tamaño de la muestra)

Cómo Calcular el Error Estándar (Paso a Paso)

Para calcular el error estándar, siga estos pasos:

- Calcule la media (promedio) de los valores de su muestra.

- Calcule la desviación de cada medición respecto a la media. (Valor de la muestra - Media).

- Eleve al cuadrado cada una de estas desviaciones.

- Sume todas las desviaciones al cuadrado.

- Divida la suma de las desviaciones al cuadrado por el tamaño de la muestra menos uno (n-1). Este es el cálculo de la varianza muestral.

- Calcule la raíz cuadrada del valor obtenido en el Paso 5. Este resultado es la desviación estándar de su muestra.

- Divida la desviación estándar (obtenida en el Paso 6) por la raíz cuadrada del tamaño de la muestra (n). El valor resultante es el error estándar.

Ejemplo de Cálculo del Error Estándar

Supongamos que los valores en su muestra son: 52, 60, 55 y 65.

- Calcule la media: (52 + 60 + 55 + 65) / 4 = 58.

- Calcule las desviaciones y elévelas al cuadrado:

- (58 – 52)^2 = 6^2 = 36

- (58 – 60)^2 = (-2)^2 = 4

- (58 – 55)^2 = 3^2 = 9

- (58 – 65)^2 = (-7)^2 = 49

- Sume las desviaciones al cuadrado: 36 + 4 + 9 + 49 = 98.

- Calcule la varianza muestral: 98 / (4 – 1) = 98 / 3 ≈ 32.67.

- Calcule la desviación estándar: √32.67 ≈ 5.72.

- Calcule el error estándar: 5.72 / √4 = 5.72 / 2 = 2.86.

El error estándar de los valores en este ejemplo es aproximadamente 2.86.

Diferencias Clave y Relación entre los Errores

Es fundamental no confundir el error de aproximación con el error estándar de estimación, aunque ambos son componentes del error total en un sistema de predicción o inferencia. Aquí una tabla comparativa para clarificar sus roles:

| Característica | Error de Aproximación | Error Estándar de Estimación |

|---|---|---|

| Concepto Principal | Sesgo del modelo (Bias) | Varianza del estimador (Variance) |

| Causa Principal | Limitaciones de la clase de funciones/modelo elegido; el modelo es demasiado simple para capturar la complejidad real. | Variabilidad inherente al muestreo; diferentes muestras dan resultados ligeramente diferentes. |

| Qué Mide | La brecha entre el mejor modelo posible dentro de nuestra clase elegida y el verdadero modelo óptimo (ideal). | La precisión de una estimación muestral (ej., la media) como representante del verdadero parámetro poblacional. |

| Cómo se Reduce | Aumentando la complejidad o flexibilidad de la clase de funciones (ej., espacios anidados, regularización). | Aumentando el tamaño de la muestra (n). |

| Contexto Típico | Aprendizaje automático, teoría de la generalización, sesgo-varianza. | Inferencias estadísticas, intervalos de confianza, pruebas de hipótesis. |

Ambos errores son cruciales en la comprensión del error total de un modelo predictivo. Un modelo con un alto error de aproximación puede ser muy simple y no capturar patrones complejos (subajuste o underfitting), mientras que un modelo con un error estándar alto puede ser demasiado sensible a las fluctuaciones de la muestra, llevando a un sobreajuste (overfitting) o a estimaciones muy variables. El objetivo es encontrar un equilibrio.

Preguntas Frecuentes (FAQs)

¿Cuál es la diferencia principal entre el error de aproximación y el error estándar?

La diferencia principal radica en su origen y lo que miden. El error de aproximación se relaciona con el sesgo (bias) de un modelo y surge de la incapacidad de la clase de funciones elegida para representar perfectamente la relación subyacente verdadera. El error estándar, por otro lado, se relaciona con la varianza (variance) de un estimador y surge de la variabilidad inherente al tomar muestras de una población.

¿Por qué es importante el error estándar?

El error estándar es vital porque cuantifica la precisión con la que una estadística calculada a partir de una muestra (como la media muestral) representa el verdadero parámetro de la población. Un error estándar bajo indica que su estimación es probablemente cercana al valor real de la población, lo cual es crucial para la inferencia estadística y la toma de decisiones informadas.

¿Cómo afecta el tamaño de la muestra al error estándar?

El tamaño de la muestra (n) tiene un efecto inverso en el error estándar: a medida que el tamaño de la muestra aumenta, el error estándar disminuye. Esto se debe a que muestras más grandes tienden a ser más representativas de la población, lo que reduce la variabilidad entre las medias de diferentes muestras y, por lo tanto, hace que la estimación sea más precisa.

¿Qué es la dimensión VC y por qué es relevante para el error de aproximación?

La dimensión VC (Vapnik-Chervonenkis) es una medida de la capacidad o complejidad de una clase de funciones. En el contexto del error de aproximación, es relevante porque una dimensión VC más baja generalmente implica una clase de funciones menos compleja, lo que puede ayudar a reducir el error de estimación (la varianza del modelo). Sin embargo, una dimensión VC demasiado baja puede aumentar el error de aproximación (el sesgo del modelo) si la clase de funciones es demasiado restrictiva para capturar la complejidad real del clasificador de Bayes óptimo.

¿Qué es la regularización en este contexto y cómo ayuda a reducir el error?

La regularización es una técnica utilizada en aprendizaje automático para prevenir el sobreajuste (overfitting) y, al mismo tiempo, ayudar a reducir el error de aproximación de manera implícita. Consiste en añadir un término de penalización a la función de riesgo empírico (que el modelo intenta minimizar). Este término penaliza la complejidad del modelo, fomentando soluciones más simples y generalizables. Al controlar la complejidad, la regularización actúa como una forma de navegar implícitamente a través de espacios de funciones de complejidad creciente a medida que se tienen más datos, ayudando a que el error de aproximación converja a cero.

¿Qué es el clasificador de Bayes óptimo (f_Bayes)?

El clasificador de Bayes óptimo (f_Bayes) representa el mejor clasificador posible para una distribución de datos dada. Es el clasificador teórico que minimiza el riesgo de clasificación (la probabilidad de error) y, por lo tanto, establece el límite inferior de error que cualquier clasificador podría alcanzar. Es el objetivo ideal al que intentamos que nuestros modelos de aprendizaje automático se aproximen.

Conclusión

El dominio de los conceptos de error de aproximación y error estándar de estimación es esencial para cualquier persona que trabaje con datos y modelos predictivos. El error de aproximación, vinculado al sesgo del modelo, nos enseña sobre las limitaciones inherentes a nuestra elección de un modelo y cómo podemos superarlas mediante estrategias como el uso de espacios de funciones anidados y la regularización. Por otro lado, el error estándar de estimación, relacionado con la varianza del estimador, nos proporciona una medida crucial de la fiabilidad de nuestras inferencias a partir de una muestra, destacando la importancia del tamaño de la muestra para obtener estimaciones precisas.

Al comprender y mitigar ambos tipos de errores, podemos construir modelos más precisos, realizar inferencias más robustas y, en última instancia, tomar decisiones más informadas y confiables basadas en el análisis de datos. La interacción entre estos dos tipos de errores es un pilar central en la búsqueda de modelos que no solo se ajusten bien a los datos observados, sino que también generalicen de manera efectiva a datos nuevos y no vistos.

Si quieres conocer otros artículos parecidos a Errores de Estimación: Aproximación y Estándar puedes visitar la categoría Estadística.