04/07/2025

En el vasto universo de las matemáticas y la ciencia, rara vez trabajamos con valores absolutamente exactos. Ya sea debido a las limitaciones de los instrumentos de medición, la necesidad de redondear cifras o la naturaleza intrínsecamente aproximada de ciertos cálculos numéricos, las aproximaciones son una constante en nuestra vida diaria y profesional. Pero, ¿cómo podemos saber cuán buena es una aproximación? La respuesta reside en comprender y calcular el error de aproximación. Este concepto es fundamental para cualquier persona que trabaje con datos, desde ingenieros y científicos hasta estudiantes y analistas financieros, ya que permite cuantificar la discrepancia entre un valor real y su estimación.

Comprender el error de aproximación no es solo una cuestión académica; es una habilidad práctica que nos permite evaluar la fiabilidad de nuestros resultados, tomar decisiones informadas y, en última instancia, mejorar la precisión de nuestros trabajos. En este artículo, desglosaremos los diferentes tipos de errores de aproximación, exploraremos sus fórmulas, discutiremos sus usos y responderemos a las preguntas más frecuentes para que domines este concepto esencial.

¿Qué es el Error de Aproximación?

El error de aproximación es, en esencia, la diferencia o discrepancia entre un valor exacto y una aproximación a este. Esta diferencia puede surgir por diversas razones, siendo las más comunes la imprecisión en la medición de datos debido a las limitaciones de los instrumentos (por ejemplo, redondear 4.5 cm a 5 cm porque la regla no tiene decimales) o el uso de aproximaciones inherentes a ciertos métodos numéricos. En el campo del análisis numérico, la estabilidad de un algoritmo se mide por cómo este propaga el error.

Es crucial entender que, aunque a menudo buscamos la máxima precisión, una aproximación no es necesariamente un error en el sentido de una equivocación. Más bien, es una estimación que conlleva un cierto grado de incertidumbre, y el error de aproximación es la herramienta que nos permite cuantificar esa incertidumbre.

Tipos Principales de Error de Aproximación

Existen principalmente tres maneras de cuantificar el error de una aproximación, cada una ofreciendo una perspectiva diferente sobre la precisión:

Error Absoluto

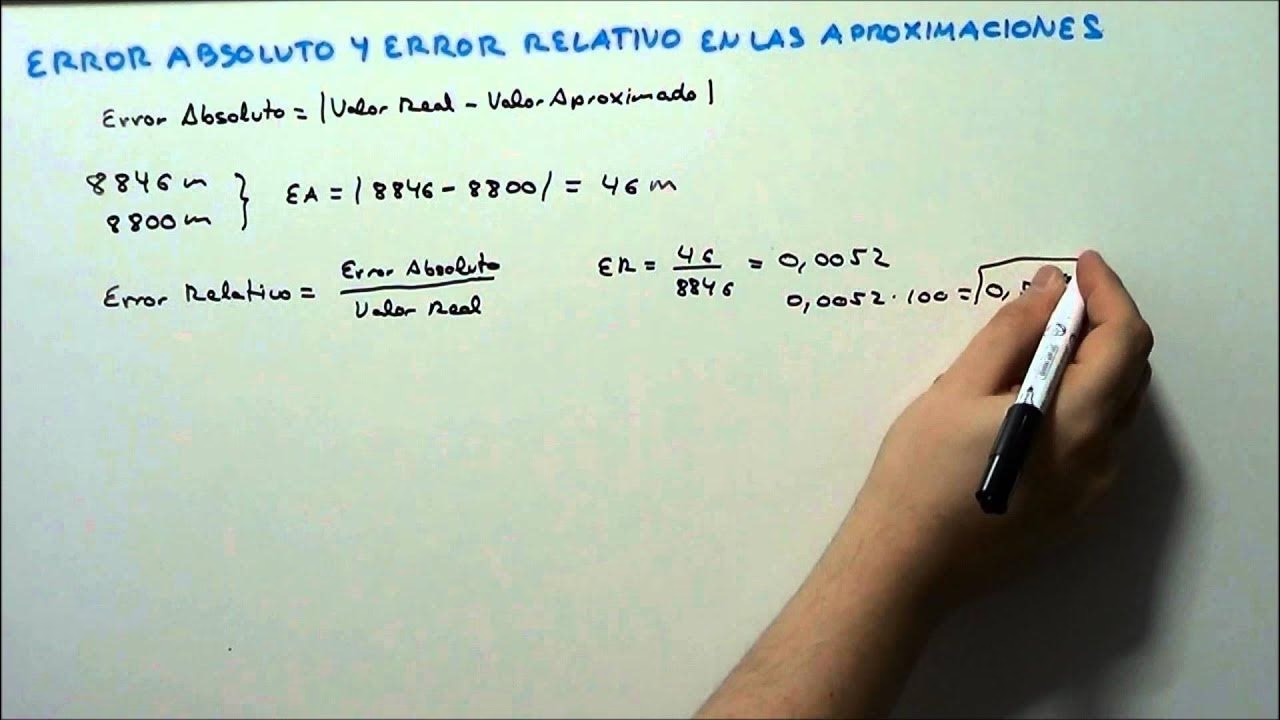

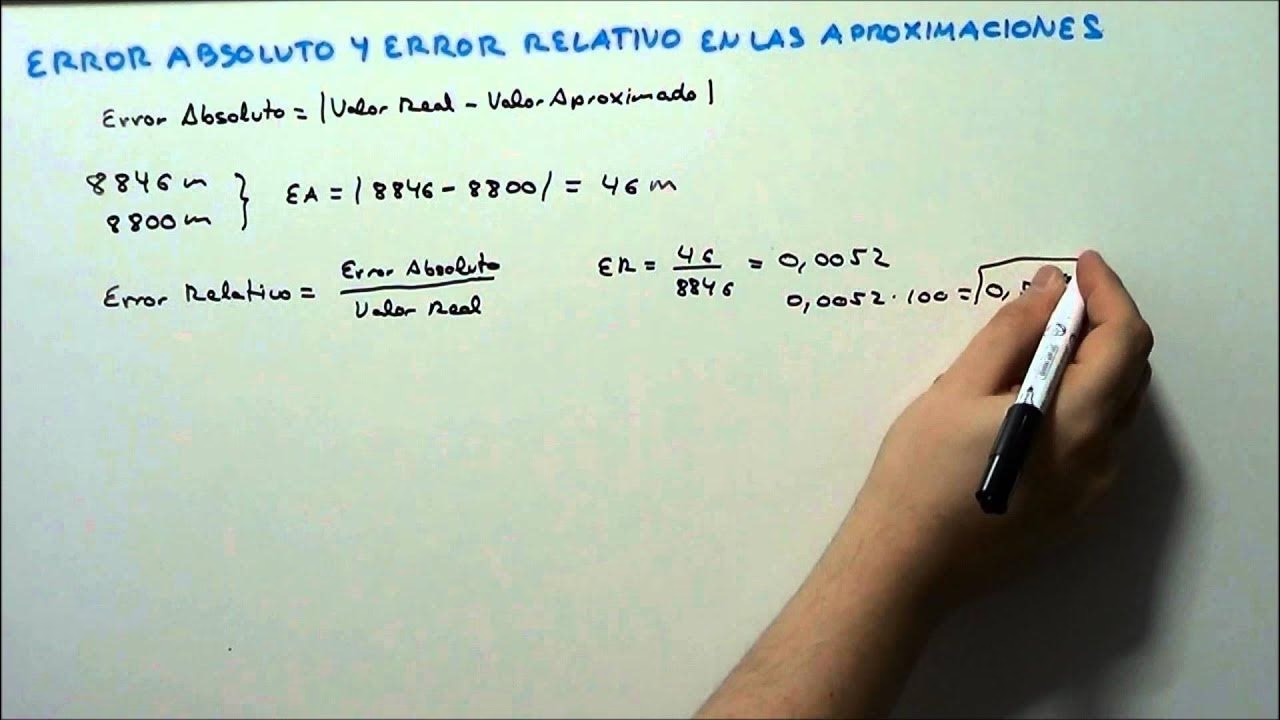

El error absoluto es la medida más directa de la discrepancia. Se define como la magnitud de la diferencia entre el valor exacto y el valor aproximado. Matemáticamente, si 'v' es el valor exacto y 'approx' es su aproximación, el error absoluto se calcula como:

Error Absoluto = |v - approx|

Las barras verticales indican el valor absoluto, lo que significa que el error absoluto siempre será un número no negativo, representando la distancia entre los dos valores sin importar cuál sea mayor. Por ejemplo, si el valor exacto es 4.5 y la aproximación es 5, el error absoluto es |4.5 - 5| = |-0.5| = 0.5. Si el valor exacto es 5 y la aproximación es 4.5, el error absoluto también es |5 - 4.5| = |0.5| = 0.5.

Error Relativo

Mientras que el error absoluto nos da la magnitud de la diferencia, el error relativo nos proporciona una idea de la importancia de esa diferencia en relación con el tamaño del valor exacto. Es decir, nos dice cuán grande es el error en proporción al valor que estamos midiendo.

Se calcula dividiendo el error absoluto por la magnitud del valor exacto (siempre que el valor exacto no sea cero):

Error Relativo = Error Absoluto / |v| = |v - approx| / |v| (donde v ≠ 0)

El error relativo es una medida sin unidades, lo que lo hace útil para comparar la precisión de aproximaciones de valores de diferentes magnitudes. Por ejemplo, un error absoluto de 0.5 puede ser insignificante si el valor exacto es 1000, pero muy significativo si el valor exacto es 1. El error relativo nos ayuda a contextualizar esto.

Un Desafío con el Error Relativo Tradicional

Un problema común con la definición tradicional del error relativo surge cuando el valor exacto 'v' es cero. En este caso, la división por cero hace que la fórmula no tenga sentido (el error relativo se vuelve infinito), sin importar cuán cerca esté la aproximación de cero. Para abordar esto, algunos proponen una definición alternativa del error relativo, dividiendo el error absoluto no por el valor exacto 'v', sino por el valor aproximado 'approx' (siempre que approx ≠ 0):

Error Relativo (Alternativo) = |v - approx| / |approx| (donde approx ≠ 0)

Esta nueva definición tiene la ventaja de que, si conocemos el valor aproximado y un límite superior para el error relativo (δ), podemos fácilmente determinar el intervalo en el que se encuentra el valor exacto: entre approx - δ ⋅ approx y approx + δ ⋅ approx. Por ejemplo, si la aproximación es 2 y el error relativo (según esta nueva definición) no es más del 5% (0.05), el valor exacto estaría entre 2 - 0.05 ⋅ 2 = 1.9 y 2 + 0.05 ⋅ 2 = 2.1.

Error Porcentual

El error porcentual es simplemente el error relativo expresado como un porcentaje. Es la forma más común y fácil de interpretar para comunicar la precisión de una aproximación.

Se calcula multiplicando el error relativo por 100:

Error Porcentual = Error Relativo × 100% = (|v - approx| / |v|) × 100% (donde v ≠ 0)

Al igual que el error relativo, el error porcentual es una medida de la precisión de la aproximación en relación con el valor exacto, pero expresada en un formato más intuitivo para la mayoría de las personas.

¿Cómo se Calcula el Error de Aproximación?

El cálculo del error de aproximación depende de si conocemos el valor exacto de la cantidad o si solo tenemos aproximaciones sucesivas. En general, el proceso implica identificar el valor exacto (o la mejor aproximación disponible) y el valor aproximado, y luego aplicar las fórmulas descritas.

Cuando el valor exacto es conocido (o se puede asumir como tal, como en un experimento controlado con un valor de referencia), el cálculo es directo:

- Identifica el valor exacto (v).

- Identifica el valor aproximado (approx).

- Calcula el Error Absoluto:

|v - approx| - Si

v ≠ 0, calcula el Error Relativo:|v - approx| / |v| - Si

v ≠ 0, calcula el Error Porcentual:(|v - approx| / |v|) × 100%

En muchos escenarios de computación numérica, el valor exacto es desconocido. En estos casos, especialmente cuando se utilizan métodos iterativos, el error de aproximación se cuantifica a menudo como la diferencia entre la aproximación actual y la aproximación anterior. Esto se conoce como Error Aproximado Iterativo:

Error Aproximado (Ea) = Aproximación Actual - Aproximación Previa

Este tipo de error es útil para determinar cuándo un método iterativo ha convergido lo suficiente como para detener las iteraciones, ya que un error aproximado muy pequeño indica que las aproximaciones sucesivas ya no cambian significativamente.

Error Verdadero vs. Error de Aproximación

Es importante distinguir entre el "error verdadero" y el "error de aproximación" en ciertos contextos, particularmente en el aprendizaje automático y la estadística:

Error Verdadero (True Error): En el contexto de la hipótesis o el riesgo verdadero, es la probabilidad (o proporción) de que una hipótesis aprendida clasifique erróneamente una instancia seleccionada aleatoriamente de la población. Se define como:

Error Verdadero = Valor Verdadero - Valor Aproximado. Este concepto asume que existe un "valor verdadero" o una "verdad absoluta" que la hipótesis intenta predecir o clasificar, y el error mide la desviación de esa verdad. Se utiliza a menudo cuando el valor exacto es conocido o se puede inferir, como en la evaluación de un modelo predictivo.Error de Aproximación (Approximation Error): Como hemos discutido, este se refiere a la discrepancia entre un valor exacto y su aproximación. Es el término más general y se aplica a situaciones donde el valor exacto puede ser desconocido. Cuando se usa en métodos iterativos, el error de aproximación se define a menudo como la diferencia entre la aproximación actual y la anterior, sirviendo como una medida de convergencia.

La clave es que el "error verdadero" se centra en la desviación de una realidad conocida (o teórica), mientras que el "error de aproximación" se centra en la diferencia entre una estimación y el valor que intenta representar, siendo este último a menudo desconocido en la práctica.

Tabla Comparativa de Errores de Aproximación

| Tipo de Error | Fórmula | Descripción | Cuándo Usarlo |

|---|---|---|---|

| Error Absoluto | |v - approx| | Magnitud de la diferencia entre el valor exacto (v) y el aproximado (approx). Siempre positivo. | Cuando la magnitud del error es lo más importante, independientemente del tamaño del valor. |

| Error Relativo | |v - approx| / |v| (v ≠ 0) | Error absoluto dividido por la magnitud del valor exacto. Mide la precisión en relación al tamaño del valor. | Para comparar la precisión de aproximaciones de valores de diferentes magnitudes. |

| Error Porcentual | (|v - approx| / |v|) × 100% (v ≠ 0) | Error relativo expresado como porcentaje. Fácil de interpretar y comunicar. | Para comunicar la precisión de manera clara y comprensible a una audiencia más amplia. |

| Error Aproximado (Iterativo) | Aprox Actual - Aprox Previa | Diferencia entre aproximaciones sucesivas en un método iterativo. | Para evaluar la convergencia de métodos numéricos iterativos cuando el valor exacto es desconocido. |

Usos e Importancia del Cálculo del Error Porcentual

El cálculo del error porcentual es una herramienta invaluable en múltiples campos por varias razones:

Evaluación de la Precisión: Permite cuantificar cuán cerca está una estimación o medición del valor real. Esto es crucial en experimentos científicos, donde se busca la máxima exactitud.

Control de Calidad: En la industria, el error porcentual se utiliza para asegurar que los productos cumplen con las especificaciones. Un alto error porcentual podría indicar un problema en el proceso de fabricación.

Análisis de Datos: Los estadísticos y analistas de datos lo utilizan para determinar si la recopilación de datos está progresando en la dirección correcta o si hay desviaciones significativas que requieren atención.

Toma de Decisiones: En finanzas y economía, el error porcentual puede ayudar a evaluar la precisión de las proyecciones y modelos, lo que influye en las decisiones de inversión y planificación.

Aprendizaje y Mejora: Permite a los estudiantes y profesionales identificar áreas donde sus métodos o instrumentos necesitan ser mejorados para lograr mayor precisión.

En resumen, el error porcentual es una métrica de rendimiento que nos ayuda a entender la calidad de nuestras aproximaciones y a tomar medidas correctivas cuando sea necesario. Es una métrica de confiabilidad.

Preguntas Frecuentes (FAQ)

¿Cuál es el error de aproximación absoluto?

El error de aproximación absoluto es la magnitud de la diferencia entre un valor exacto y su aproximación. Se calcula como el valor absoluto de la resta entre el valor exacto y el valor aproximado: |Valor Exacto - Valor Aproximado|.

¿Cómo se diferencia el error absoluto del error porcentual?

El error absoluto es la diferencia directa entre los valores, expresada en las mismas unidades que los valores. Por otro lado, el error porcentual es el error absoluto dividido por el valor exacto, y luego multiplicado por 100 para expresarlo como un porcentaje. El error porcentual proporciona una medida relativa de la precisión, lo que permite comparar la exactitud de diferentes mediciones o cálculos, mientras que el error absoluto solo indica la magnitud de la discrepancia.

¿Cómo se diferencia el error relativo del error porcentual?

El error relativo es el error absoluto dividido por el valor exacto. Es una proporción sin unidades que indica la precisión en relación con el tamaño del valor exacto. El error porcentual es simplemente el error relativo multiplicado por 100. Son esencialmente la misma medida, pero el error porcentual se expresa en un formato más fácil de entender y comunicar (un porcentaje).

¿Por qué es importante el error porcentual?

El error porcentual es importante porque proporciona una medida estandarizada y fácilmente comprensible de la precisión de una aproximación. Permite evaluar la calidad de los datos, comparar la fiabilidad de diferentes mediciones o experimentos, y tomar decisiones informadas en diversos campos como la ciencia, la ingeniería, las finanzas y el control de calidad. Nos ayuda a entender cuán significativa es una desviación con respecto al valor real.

Conclusión

El cálculo del error de una aproximación es una habilidad fundamental en cualquier disciplina que maneje datos y mediciones. Ya sea que estemos lidiando con el error absoluto, que nos da la magnitud pura de la discrepancia, el error relativo, que contextualiza esa discrepancia en función del tamaño del valor, o el error porcentual, que traduce esa relación a un formato fácilmente interpretable, cada tipo de error nos ofrece una perspectiva única sobre la precisión y la fiabilidad de nuestros resultados.

Comprender y aplicar estos conceptos nos permite no solo cuantificar la incertidumbre inherente a las aproximaciones, sino también mejorar nuestros métodos, validar nuestros experimentos y, en última instancia, tomar decisiones más sólidas y fundamentadas. En un mundo donde la información y los datos son clave, la capacidad de evaluar la exactitud de una aproximación es, sin duda, una herramienta poderosa.

Si quieres conocer otros artículos parecidos a ¿Cómo Calcular el Error de una Aproximación? puedes visitar la categoría Matemáticas.