05/11/2022

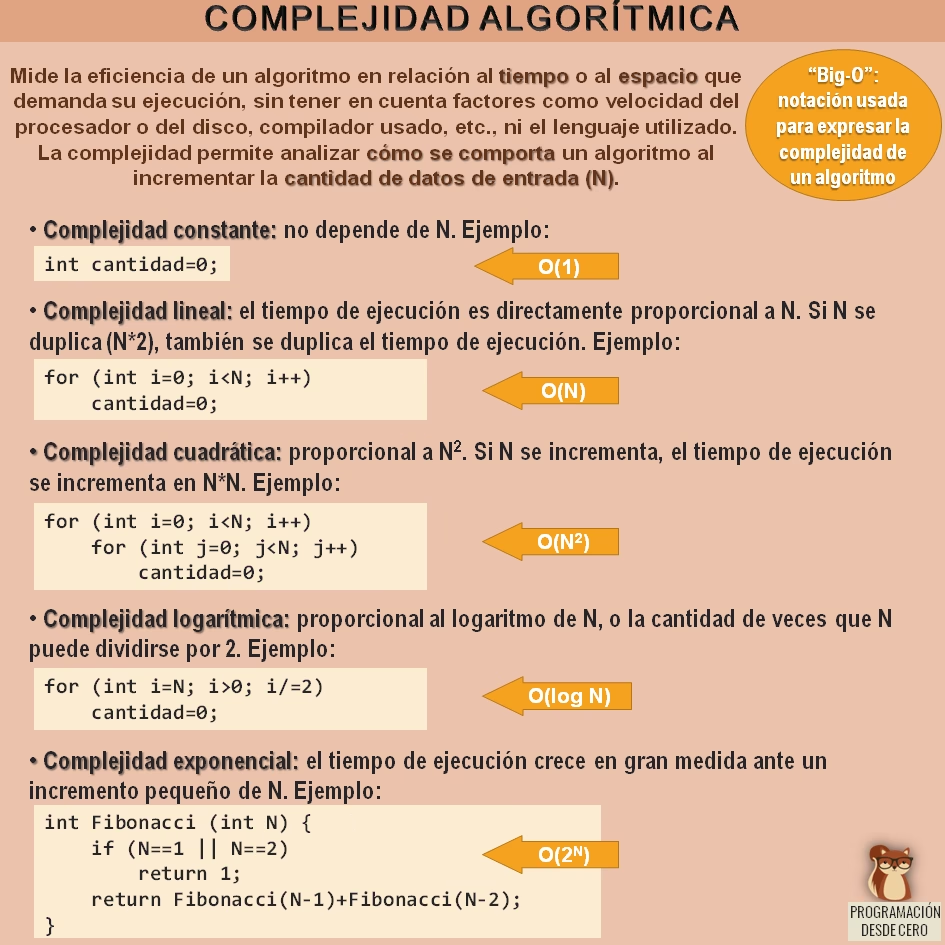

En el dinámico mundo de la programación y la informática, diseñar un programa que simplemente funcione ya no es suficiente. La verdadera maestría reside en crear soluciones que no solo sean correctas, sino también notablemente eficientes. Aquí es donde entra en juego un concepto fundamental: la complejidad de los algoritmos. Entender y aplicar este conocimiento es vital para optimizar procesos como búsquedas, recomendaciones o predicciones, lo que se traduce en significativas reducciones de tiempo y costes computacionales.

Para abordar este tema crucial, primero debemos establecer una base sólida. ¿Qué es exactamente un algoritmo? En esencia, un algoritmo es un conjunto bien definido de pasos o procedimientos lógicos, una serie de instrucciones precisas diseñadas para resolver un problema específico. Un algoritmo toma una entrada, realiza una secuencia de operaciones sobre ella y produce una salida. Son la espina dorsal de la informática, impulsando desde los cálculos más sencillos hasta los sistemas de inteligencia artificial más complejos.

- ¿Por Qué es Crucial Entender la Complejidad?

- Fundamentos de la Complejidad: Tiempo y Espacio

- Comprendiendo la Notación Big O: El Peor Escenario

- El Impacto del Tamaño de la Entrada (n)

- Tipos Comunes de Complejidad Temporal (con ejemplos)

- Jerarquía de las Complejidades Big O

- Análisis de Complejidad en Algoritmos de Ordenación

- Calculando la Complejidad en Algoritmos Recursivos

- Preguntas Frecuentes (FAQ)

- Conclusión

¿Por Qué es Crucial Entender la Complejidad?

La complejidad de un algoritmo es una medida directa de su eficiencia. Nos indica cuánto tiempo y espacio (memoria) requerirá el algoritmo para producir una solución. En un mundo donde los datos crecen exponencialmente y la demanda de inmediatez es constante, un algoritmo ineficiente puede significar la diferencia entre un sistema que funciona y uno que colapsa bajo su propia carga. Ya no basta con que un programa realice una tarea; el valor añadido reside en nuestra capacidad para optimizar ese algoritmo, mejorando sus tiempos de ejecución y reduciendo sus costes computacionales.

Consideremos, por ejemplo, el impacto en la industria. Un algoritmo de búsqueda ligeramente más eficiente puede ahorrar millones de dólares a una empresa de comercio electrónico al reducir los tiempos de espera de los usuarios y, por ende, aumentar las conversiones. En el ámbito de la inteligencia artificial, la optimización algorítmica permite entrenar modelos más grandes y complejos en menos tiempo, acelerando el avance tecnológico. En matemáticas, la complejidad nos ayuda a comprender las limitaciones de los algoritmos y las compensaciones inherentes a la resolución de problemas complejos.

Fundamentos de la Complejidad: Tiempo y Espacio

La complejidad se mide principalmente en dos dimensiones:

- Complejidad Temporal: Se refiere a la cantidad de tiempo que un algoritmo tarda en ejecutarse en función del tamaño de su entrada. No se trata de segundos o milisegundos absolutos, sino de cómo el tiempo de ejecución escala con el aumento del volumen de datos.

- Complejidad Espacial: Se refiere a la cantidad de memoria (espacio de almacenamiento) que un algoritmo requiere para ejecutarse en función del tamaño de su entrada. Esto incluye la memoria utilizada para almacenar variables, estructuras de datos y el espacio de la pila para llamadas recursivas.

Es importante destacar que, al analizar el rendimiento de un algoritmo, no consideramos factores externos como el hardware, el sistema operativo o la velocidad de la CPU. Nos centramos en cómo el algoritmo escala intrínsecamente con el tamaño de la entrada, lo que nos permite comparar la eficiencia de diferentes algoritmos de manera justa y universal.

Comprendiendo la Notación Big O: El Peor Escenario

Para expresar la complejidad de un algoritmo, utilizamos notaciones asintóticas. La más común y fundamental es la notación Big O. Esta notación describe el comportamiento del tiempo de ejecución o el espacio requerido por un algoritmo a medida que el tamaño de la entrada (n) tiende al infinito. En otras palabras, nos da una cota superior del rendimiento, es decir, el peor caso posible de un algoritmo.

La notación Big O nos permite estimar cuánto tiempo se ejecutará nuestro código con diferentes conjuntos de entradas y, crucialmente, medir con qué eficacia escala nuestro código a medida que aumenta el tamaño de la entrada. No nos dice la velocidad exacta en milisegundos, sino cómo el tiempo de ejecución crece en relación con la entrada.

Además de Big O (O), existen otras dos notaciones menos utilizadas pero igualmente importantes:

- Notación Omega (Ω): Representa la complejidad del mejor caso de un algoritmo. Nos da una cota inferior del tiempo de ejecución, es decir, el tiempo mínimo que tardará un algoritmo en ejecutarse por completo.

- Notación Theta (Θ): Representa la complejidad del caso promedio de un algoritmo. Se utiliza cuando los límites superior e inferior del tiempo de ejecución son los mismos, lo que significa que el rendimiento del algoritmo es consistentemente similar sin importar la entrada.

En esta guía, nos centraremos principalmente en la notación Big O debido a su importancia para garantizar que nuestras aplicaciones se ejecuten correctamente y para escribir código limpio y robusto frente a cualquier escenario.

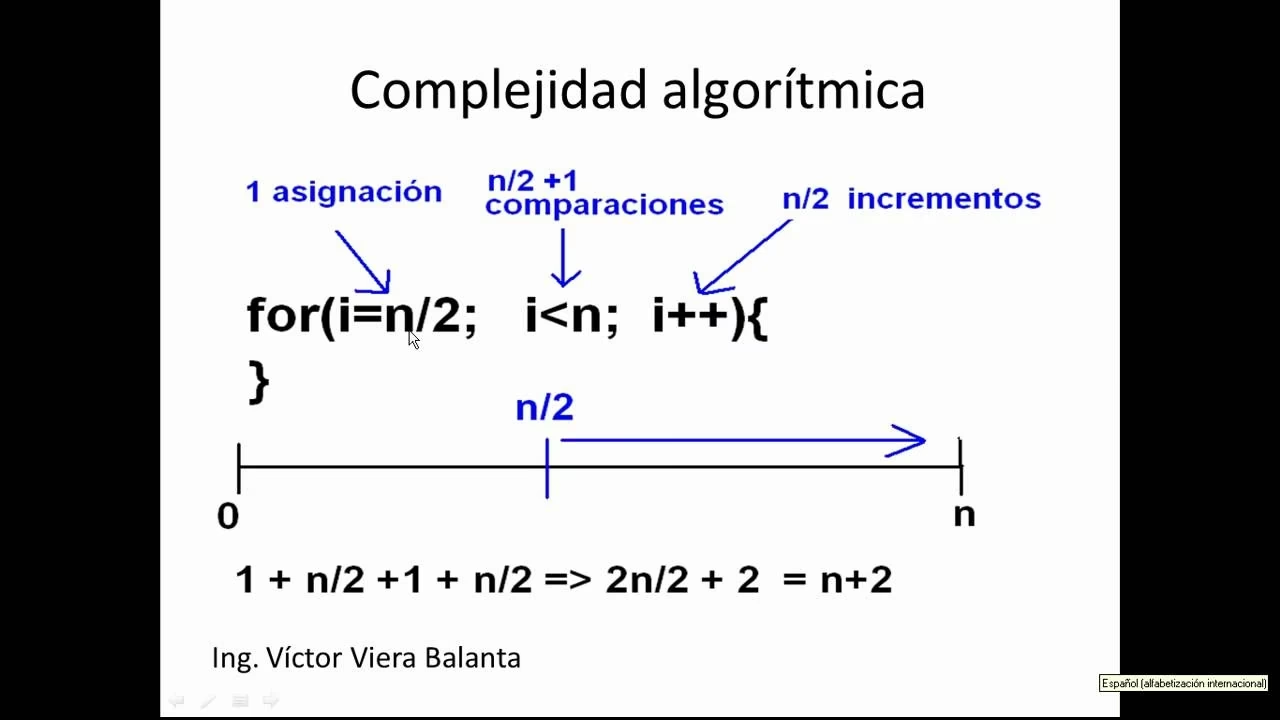

El Impacto del Tamaño de la Entrada (n)

Para comprender perfectamente el concepto de la complejidad en función del tamaño de la entrada, imaginemos un algoritmo simple que calcula la suma de todos los números desde 1 hasta un valor de entrada `n`:

const calcularSuma = (entrada) => {

let suma = 0; // Primera declaración

for (let i = 0; i <= entrada; i++) {

suma += i; // Segunda declaración

}

return suma; // Tercera declaración

};A primera vista, el código tiene solo tres declaraciones. Sin embargo, debido a la presencia de un bucle, la segunda declaración (`suma += i;`) se ejecutará `entrada + 1` veces. Si la `entrada` es 4, esta declaración se ejecutará 5 veces (para i=0, 1, 2, 3, 4). Por lo tanto, el algoritmo completo se ejecutará `(entrada + 1) + 2` veces (las otras dos declaraciones se ejecutan una vez cada una). Esto demuestra que el número total de operaciones está directamente en función del tamaño de la entrada `n`.

Tipos Comunes de Complejidad Temporal (con ejemplos)

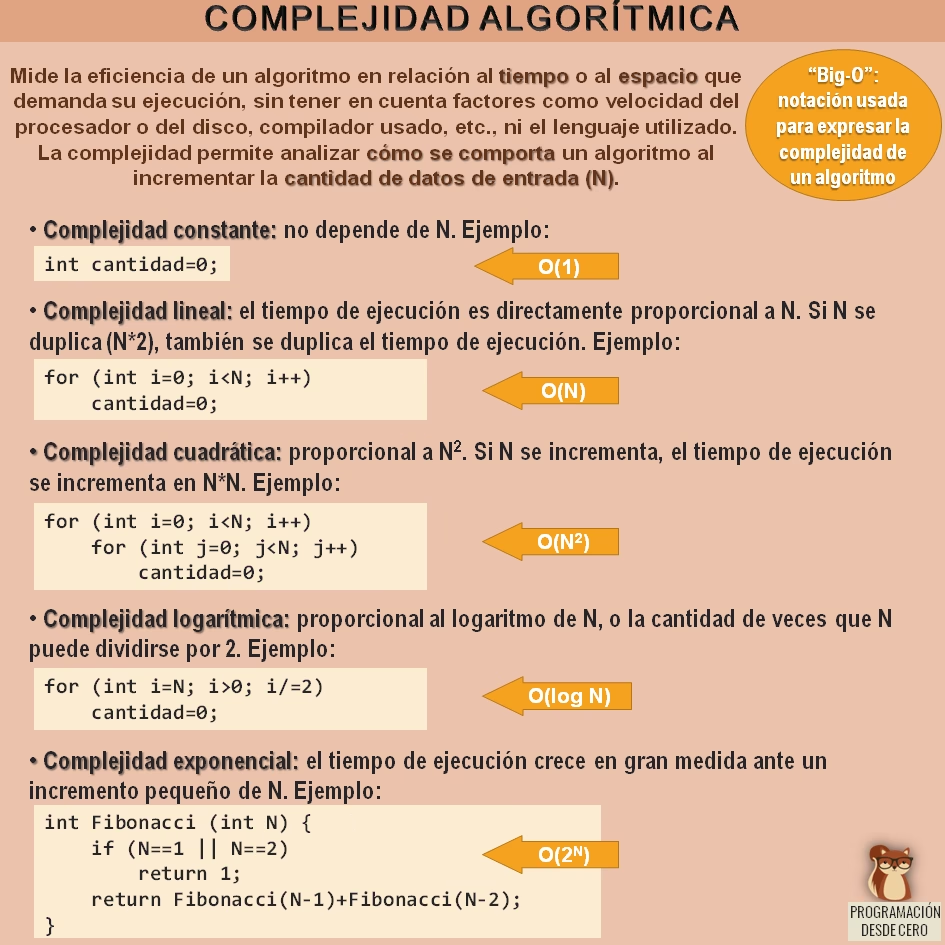

La notación Big O clasifica los algoritmos según la forma en que su tiempo de ejecución escala con el tamaño de la entrada. Aquí presentamos los tipos más comunes, ordenados de mejor a peor rendimiento:

O(1) - Tiempo Constante

Un algoritmo tiene complejidad temporal constante cuando su tiempo de ejecución no depende del tamaño de la entrada `n`. Esto significa que el número de operaciones es siempre el mismo, independientemente de si la entrada es pequeña o enorme.

Ejemplo: Acceder al primer elemento de un arreglo.

const primerElemento = (arreglo) => {

return arreglo[0];

};

let marcadores = [12, 55, 67, 94, 22];

console.log(primerElemento(marcadores)); // 12Esta función siempre realizará una única operación: acceder al elemento en la posición 0. El tiempo será el mismo para un arreglo de 5 elementos o de 5 millones. Por eso, O(1) es la eficiencia óptima, el mejor escenario posible.

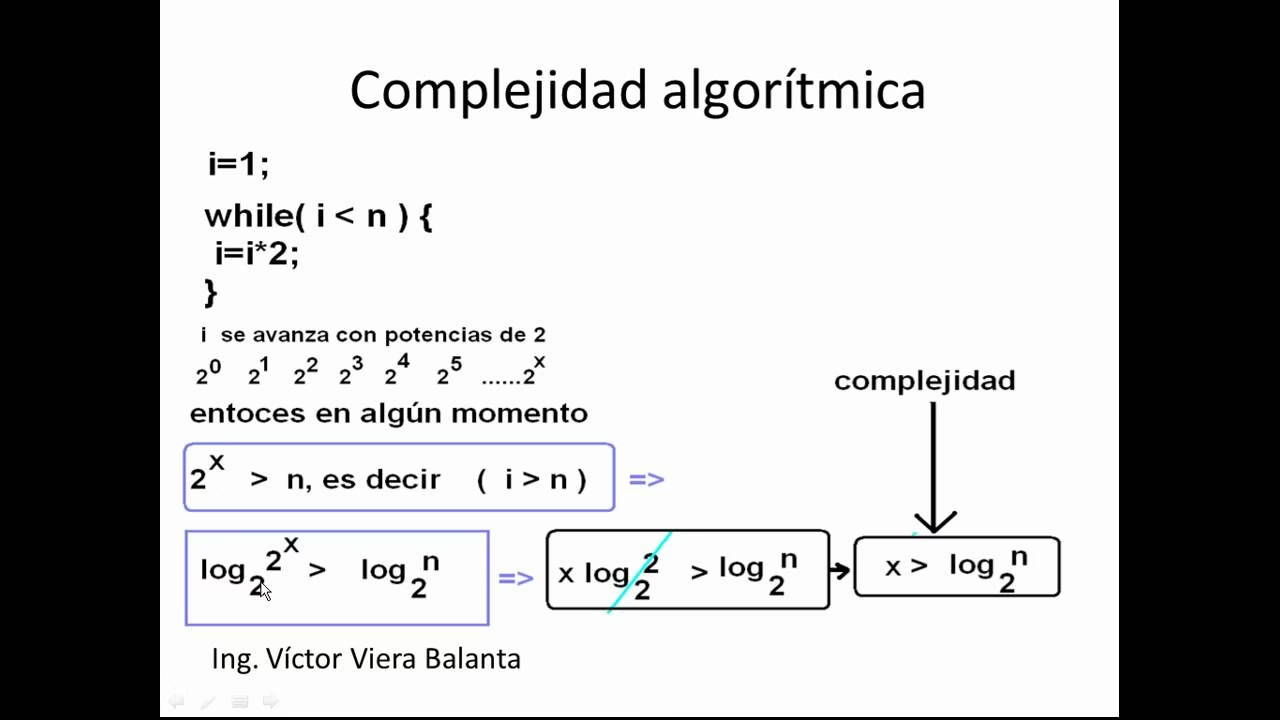

O(log n) - Tiempo Logarítmico

Un algoritmo tiene complejidad logarítmica cuando el tiempo de ejecución disminuye a medida que el tamaño de la entrada se divide repetidamente. Esto ocurre a menudo en algoritmos que eliminan una gran parte del espacio de búsqueda en cada paso.

Ejemplo: Búsqueda binaria en una lista ordenada.

const busquedaBinaria = (arreglo, objetivo) => {

let primerIndice = 0;

let ultimoIndice = arreglo.length - 1;

while (primerIndice <= ultimoIndice) {

let medioIndice = Math.floor((primerIndice + ultimoIndice) / 2);

if (arreglo[medioIndice] === objetivo) {

return medioIndice;

}

if (arreglo[medioIndice] > objetivo) {

ultimoIndice = medioIndice - 1;

} else {

primerIndice = medioIndice + 1;

}

}

return -1;

};

let marcadores = [12, 22, 45, 67, 96];

console.log(busquedaBinaria(marcadores, 96)); // 4En cada iteración, la búsqueda binaria reduce el espacio de búsqueda a la mitad. Esto significa que, incluso con un arreglo muy grande, el número de pasos necesarios para encontrar un elemento es sorprendentemente pequeño. Por ejemplo, para un arreglo de un millón de elementos, solo se necesitan unas 20 comparaciones (log₂ 1,000,000 ≈ 19.9).

O(n) - Tiempo Lineal

Un algoritmo tiene complejidad lineal cuando su tiempo de ejecución aumenta directamente proporcional al tamaño de la entrada `n`. Si la entrada se duplica, el tiempo de ejecución también se duplica.

Ejemplo: Calcular el factorial de un número o recorrer todos los elementos de un arreglo una vez.

const calcularFactorial = (n) => {

let factorial = 1;

for (let i = 2; i <= n; i++) {

factorial = factorial * i;

}

return factorial;

};

console.log(calcularFactorial(5)); // 120El bucle se ejecuta `n-1` veces, lo que significa que el número de operaciones crece linealmente con el valor de `n`. Este es un nivel de eficiencia aceptable para muchos problemas.

O(n log n) - Tiempo Log-Lineal

Esta complejidad es el resultado de combinar operaciones lineales con logarítmicas, común en algoritmos eficientes de ordenación. Es significativamente mejor que una complejidad cuadrática.

Ejemplo: Algoritmos de ordenación como Merge Sort o Heap Sort.

Estos algoritmos a menudo dividen el problema en subproblemas (log n) y luego realizan una operación lineal (n) para combinarlos o procesarlos.

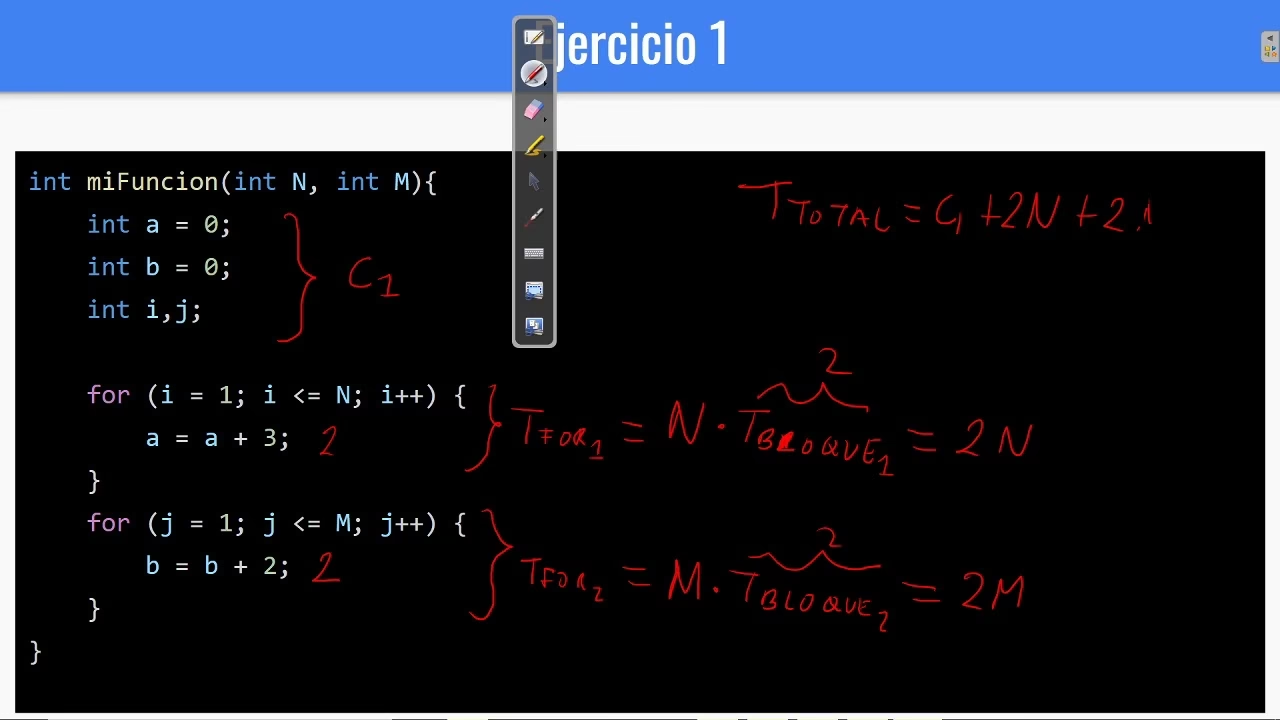

O(n^2) - Tiempo Cuadrático

Un algoritmo tiene complejidad cuadrática cuando su tiempo de ejecución es proporcional al cuadrado del tamaño de la entrada `n`. Esto suele ocurrir cuando hay bucles anidados, donde cada elemento de la entrada se compara o procesa con cada otro elemento.

Ejemplo: Encontrar elementos similares en un arreglo mediante dos bucles anidados.

const elementosSimilares = (arreglo) => {

for (let i = 0; i < arreglo.length; i++) {

for (let j = 0; j < arreglo.length; j++) {

if (i !== j && arreglo[i] === arreglo[j]) {

return `Encontrado en ${i} y ${j}`;

}

}

}

return "No hay coincidencias 😞";

};

const frutas = ["🍓", "🍐", "🍊", "🍌", "🍍", "🍑", "🍎", "🍈", "🍊", "🍇"];

console.log(elementosSimilares(frutas)); // "Encontrado en 2 y 8"Si el arreglo tiene 10 elementos, el bucle interior se ejecutará 10 veces por cada una de las 10 iteraciones del bucle exterior, resultando en 100 operaciones (10^2). Para un arreglo de 1000 elementos, esto significaría un millón de operaciones, lo que lo hace muy ineficiente para grandes conjuntos de datos.

O(2^n) - Tiempo Exponencial

La complejidad exponencial ocurre cuando la tasa de crecimiento del tiempo de ejecución se duplica con cada adición a la entrada `n`. Estos algoritmos son extremadamente ineficientes y solo son prácticos para entradas muy pequeñas.

Ejemplo: Cálculo recursivo ingenuo de la secuencia de Fibonacci.

const Fibonaccirecursivo = (n) => {

if (n < 2) {

return n;

}

return Fibonaccirecursivo(n - 1) + Fibonaccirecursivo(n - 2);

};

console.log(Fibonaccirecursivo(6)); // 8Cada llamada a la función `Fibonaccirecursivo` genera dos nuevas llamadas, lo que lleva a un crecimiento exponencial del número de operaciones a medida que `n` aumenta.

O(n!) - Tiempo Factorial

La complejidad factorial es la peor de todas, donde el tiempo de ejecución crece a una velocidad asombrosa. Esto ocurre en algoritmos que intentan explorar todas las posibles permutaciones de una entrada.

Ejemplo: Resolver el problema del viajante de comercio por fuerza bruta.

Este tipo de algoritmos son inviables para entradas incluso moderadamente pequeñas.

Jerarquía de las Complejidades Big O

El siguiente gráfico ilustra visualmente la eficiencia de las diferentes complejidades:

| Complejidad | Descripción | Eficiencia | |

|---|---|---|---|

| O(1) | Constante | Excelente/Mejor | |

| O(log n) | Logarítmica | Muy Bueno | |

| O(n) | Lineal | Aceptable | |

| O(n log n) | Log-Lineal | Bueno | |

| O(n^2) | Cuadrática | Malo | |

| O(2^n) | Exponencial | Horrible/Peor | |

| O(n!) | Factorial | Insostenible |

El objetivo siempre debe ser diseñar algoritmos con la menor complejidad posible, priorizando O(1), O(log n) y O(n). Las complejidades O(n^2) o peores deben evitarse siempre que sea posible para entradas grandes.

Análisis de Complejidad en Algoritmos de Ordenación

Los algoritmos de ordenación son un campo de estudio clásico para entender la complejidad. A continuación, analizamos la complejidad temporal (mejor, promedio, peor caso) y espacial de algunos de los algoritmos de ordenación más comunes:

Tabla Comparativa de Complejidad de Algoritmos de Ordenación

| Algoritmo | Complejidad Temporal (Mejor Caso) | Complejidad Temporal (Promedio) | Complejidad Temporal (Peor Caso) | Complejidad Espacial | Estabilidad |

|---|---|---|---|---|---|

| Bubble Sort | O(n) | O(n^2) | O(n^2) | O(1) | Sí |

| Selection Sort | O(n^2) | O(n^2) | O(n^2) | O(1) | No |

| Insertion Sort | O(n) | O(n^2) | O(n^2) | O(1) | Sí |

| Merge Sort | O(n log n) | O(n log n) | O(n log n) | O(n) | Sí |

| Quick Sort | O(n log n) | O(n log n) | O(n^2) | O(log n) a O(n) | No |

| Heap Sort | O(n log n) | O(n log n) | O(n log n) | O(1) | No |

Explicación Breve de Cada Algoritmo:

- Bubble Sort: Compara y, si es necesario, intercambia elementos adyacentes repetidamente. Es simple pero ineficiente para grandes conjuntos de datos.

- Selection Sort: Busca el elemento más pequeño y lo coloca en la posición correcta. Realiza el mismo número de comparaciones independientemente de la entrada.

- Insertion Sort: Construye la lista ordenada de un elemento a la vez, insertando cada nuevo elemento en su posición correcta dentro de la parte ya ordenada. Eficiente para listas casi ordenadas.

- Merge Sort: Un algoritmo de 'divide y vencerás'. Divide la lista en mitades recursivamente hasta que cada sublista tiene un solo elemento, y luego fusiona las sublistas de forma ordenada. Es muy eficiente y estable.

- Quick Sort: También de 'divide y vencerás'. Elige un 'pivote' y particiona el arreglo alrededor de él. Es muy rápido en promedio, pero su peor caso es cuadrático si la elección del pivote es mala.

- Heap Sort: Convierte el arreglo en un montículo (heap) y extrae repetidamente el elemento máximo (o mínimo) para construir la lista ordenada. Es eficiente y tiene una complejidad espacial constante.

La estabilidad de un algoritmo de ordenación se refiere a si preserva el orden relativo de los elementos con valores iguales. Por ejemplo, si tienes dos 'A's y el primero aparece antes que el segundo en la lista original, un algoritmo estable garantizará que siga siendo así después de la ordenación.

Calculando la Complejidad en Algoritmos Recursivos

Calcular la complejidad de un algoritmo recursivo puede ser un poco más complejo, pero sigue principios similares. La clave es identificar la operación dominante y cómo el número de veces que se realiza esa operación crece con el tamaño de la entrada.

Para encontrar la complejidad, debes elegir una operación tal que el orden del número de veces que se realiza sea igual al orden del total de operaciones del algoritmo. Es decir, esta operación debe realizarse en cada una de las llamadas recursivas o en un número de veces que sea del mismo orden que el total de llamadas.

Por ejemplo, en el caso de la función Fibonacci recursiva (O(2^n)), la operación dominante es la suma y las llamadas recursivas. Cada llamada genera dos nuevas llamadas (salvo los casos base), duplicando el trabajo con cada paso hacia atrás en la recursión.

En contraste, un algoritmo recursivo que divide el problema por la mitad en cada paso, como la búsqueda binaria implementada recursivamente, tendrá una complejidad logarítmica O(log n), ya que el número de llamadas recursivas se reduce drásticamente con cada iteración.

Preguntas Frecuentes (FAQ)

¿Por qué Big O solo considera el peor caso?

La notación Big O se enfoca en el peor caso para proporcionar una garantía sobre el rendimiento de un algoritmo. Si un algoritmo se desempeña bien en su peor caso, podemos confiar en que funcionará de manera eficiente en cualquier otro escenario. Es una forma de asegurar la robustez del software.

¿Es más importante la complejidad temporal o espacial?

Depende del contexto. En muchos escenarios modernos, donde la memoria es abundante, la complejidad temporal suele ser más crítica. Sin embargo, en sistemas embebidos, dispositivos móviles o aplicaciones de Big Data con restricciones de memoria, la complejidad espacial puede ser igual o incluso más importante. Idealmente, buscamos un equilibrio entre ambas.

¿La complejidad Big O me dice qué tan rápido es mi algoritmo en segundos?

No directamente. La notación Big O describe cómo el tiempo de ejecución (o espacio) de un algoritmo escala con el tamaño de la entrada, no su velocidad absoluta. Un algoritmo O(n) puede ser más lento en segundos que un O(n^2) para una entrada muy pequeña debido a constantes ocultas o factores del hardware, pero a medida que la entrada crece, el O(n) siempre superará al O(n^2).

¿Cómo puedo mejorar la complejidad de mi algoritmo?

Mejorar la complejidad implica a menudo cambiar la estrategia fundamental del algoritmo. Esto puede incluir el uso de estructuras de datos más eficientes (como árboles binarios de búsqueda o tablas hash), algoritmos más avanzados (como los de divide y vencerás), o técnicas de optimización como la programación dinámica o la memorización para evitar cálculos repetidos.

Conclusión

El estudio de la complejidad de los algoritmos es una parte indispensable tanto de las matemáticas como de la informática. Nos capacita para comprender las limitaciones de nuestras soluciones y las compensaciones involucradas en la resolución de problemas complejos. En la era de la inteligencia artificial, donde la eficiencia y la optimización son más valiosas que nunca, dominar el análisis de la complejidad es una habilidad que distingue a un buen programador de uno excepcional.

Al comprender cómo el tiempo de ejecución y el uso de memoria de un algoritmo escalan con el tamaño de la entrada, podemos diseñar sistemas que no solo funcionen, sino que lo hagan de manera óptima, garantizando que nuestras aplicaciones sean rápidas, fiables y capaces de manejar los desafíos del futuro.

Si quieres conocer otros artículos parecidos a Dominando la Complejidad de Algoritmos puedes visitar la categoría Cálculos.