25/05/2025

En el vasto y a menudo complejo mundo de la estadística aplicada, comparar dos resultados de variables binarias entre dos grupos independientes es una tarea sorprendentemente común. Sin embargo, a pesar de su frecuencia, existe una notable falta de consenso sobre cuál es la mejor prueba estadística para esta situación. Para tamaños de muestra grandes, la prueba de chi-cuadrado es la elección habitual. Pero, ¿qué sucede cuando las muestras son pequeñas? Aquí es donde la prueba exacta de Fisher, también conocida como prueba de Fisher-Irwin, entra en juego, aunque el debate sobre qué constituye una muestra “pequeña” o “grande” y qué versión de estas pruebas utilizar sigue siendo un tema de investigación activa y discusión. Este artículo profundiza en la prueba exacta de Fisher, su cálculo, cuándo es apropiada y cómo se compara con otras alternativas.

- La Intriga del Té y el Nacimiento de una Prueba

- Conceptos Fundamentales: Pruebas Exactas vs. Aproximadas

- La Prueba de Chi-Cuadrado de Independencia: El Estándar General

- La Prueba Exacta de Fisher: Precisión en Muestras Pequeñas

- Alternativas y Correcciones

- Resumen y Recomendaciones

- Preguntas Frecuentes (FAQ)

- ¿Cuándo debo usar la prueba exacta de Fisher?

- ¿Es la prueba exacta de Fisher siempre la mejor opción para muestras pequeñas?

- ¿Cómo se interpreta el valor p de la prueba exacta de Fisher?

- ¿Puedo usar la prueba exacta de Fisher para tablas de contingencia más grandes que 2x2?

- ¿Por qué se considera que la prueba exacta de Fisher es más conservadora?

La Intriga del Té y el Nacimiento de una Prueba

Para comprender verdaderamente la prueba exacta de Fisher, es esencial conocer su fascinante origen. Imaginemos la estación de investigación agraria de Rothamsted a principios de la década de 1920. Ronald Fisher, un genio de la genética y la estadística, se encontraba tomando el té con algunos colegas, entre ellos Blanche Muriel Bristol, una botánica. Muriel afirmó que podía distinguir si la leche se había añadido al té antes o después de la infusión. Fisher, escéptico, propuso un experimento: se prepararían ocho tazas de té, cuatro con la leche primero y cuatro con el té primero, mezcladas al azar. Para sorpresa de Fisher, Muriel acertó el orden de las ocho tazas. Este incidente, uno de los primeros experimentos aleatorizados documentados, llevó a Fisher a desarrollar un método matemático para determinar la probabilidad de que Muriel hubiera acertado por pura casualidad. Así nació la prueba exacta de Fisher, un testimonio de cómo la curiosidad por un detalle cotidiano puede dar lugar a innovaciones estadísticas fundamentales.

Conceptos Fundamentales: Pruebas Exactas vs. Aproximadas

Antes de sumergirnos en los detalles de la prueba de Fisher, es crucial entender la distinción entre pruebas exactas y aproximadas:

- Pruebas Aproximadas: Calculan un estadístico cuya distribución de probabilidad es conocida. Se basan en una aproximación que se vuelve más precisa a medida que el tamaño de la muestra tiende a infinito. La prueba de chi-cuadrado es un ejemplo clásico. Son más sencillas de calcular manualmente, pero pueden ser menos precisas con muestras pequeñas.

- Pruebas Exactas: Calculan la probabilidad de obtener los resultados observados de forma directa, enumerando todos los posibles escenarios que se alinean con la hipótesis estudiada y calculando sus probabilidades. Son más precisas, especialmente con tamaños de muestra pequeños o cuando alguna categoría tiene pocas observaciones. Sin embargo, son computacionalmente más intensivas.

La elección entre una y otra ha sido objeto de debate. Aunque los métodos aproximados son más sencillos, la potencia computacional actual de los ordenadores ha reducido esta ventaja. La recomendación general es usar una prueba exacta cuando el número total de observaciones es menor de 1000 o cuando alguna de las celdas esperadas en la tabla de contingencia tiene un valor menor de 5.

La Prueba de Chi-Cuadrado de Independencia: El Estándar General

Uno de los métodos más antiguos y comúnmente enseñados en los cursos introductorios de estadística es la prueba de chi-cuadrado, propuesta por Karl Pearson en 1900. Se basa en comparar los recuentos observados en cada grupo con lo que se esperaría por azar. Es una prueba no paramétrica, libre de suposiciones sobre la población subyacente. Se utiliza con una tabla de 2x2 (dos por dos) con la siguiente nomenclatura:

| Éxito | Fracaso | Total Filas | |

|---|---|---|---|

| Diseño A | a | b | m |

| Diseño B | c | d | n |

| Total Columnas | r | s | N |

La fórmula para calcular el estadístico chi-cuadrado es:

χ2 = (ad - bc)2 N / (m n r s)

Los grados de libertad para una tabla de 2x2 siempre son 1, calculados como (número de filas - 1) * (número de columnas - 1). El resultado se compara con una distribución chi-cuadrado para obtener el valor p.

Ejemplo de Cálculo Chi-Cuadrado

Consideremos un ejemplo: Si 40 de 60 usuarios (67%) completan una tarea en el Diseño A, y 15 de 35 (43%) la completan en el Diseño B, ¿podemos concluir que hay una diferencia estadísticamente significativa?

| Éxito | Fracaso | Total Filas | |

|---|---|---|---|

| Diseño A | 40 | 20 | 60 |

| Diseño B | 15 | 20 | 35 |

| Total Columnas | 55 | 40 | 95 |

Aplicando la fórmula:

χ2 = (40 * 20 - 20 * 15)2 * 95 / (60 * 35 * 55 * 40)

χ2 = (800 - 300)2 * 95 / 4620000 = 5002 * 95 / 4620000 = 250000 * 95 / 4620000 = 23750000 / 4620000 ≈ 5.1406

Un valor p de 0.0234 (usando =CHIDIST(5.1406, 1) en Excel) nos lleva a concluir que las tasas de finalización son estadísticamente diferentes, siendo el Diseño A significativamente superior.

Limitaciones del Chi-Cuadrado para Muestras Pequeñas

La prueba de chi-cuadrado es precisa para muestras grandes, pero no se recomienda cuando los tamaños de muestra son pequeños. La directriz más común es usar chi-cuadrado solo cuando los recuentos esperados de cada celda son mayores que 5. Los recuentos esperados se calculan multiplicando los totales de fila y columna para cada celda y dividiendo por el tamaño total de la muestra.

Para el ejemplo anterior, los recuentos esperados son:

- (55 * 60) / 95 = 34.74

- (40 * 60) / 95 = 25.26

- (55 * 35) / 95 = 20.26

- (40 * 35) / 95 = 14.74

Como el mínimo esperado es 14.74 (mayor que 5), el chi-cuadrado es apropiado.

Ahora, consideremos un ejemplo con una muestra más pequeña, donde algunos recuentos esperados son menores que 5. once de 12 usuarios (92%) completaron la tarea en el Diseño A; 5 de 10 (50%) la completaron en el Diseño B. El tamaño total de la muestra es 22.

| Éxito | Fracaso | Total Filas | |

|---|---|---|---|

| Diseño A | 11 (a) | 1 (b) | 12 (m) |

| Diseño B | 5 (c) | 5 (d) | 10 (n) |

| Total Columnas | 16 (r) | 6 (s) | 22 (N) |

Calculando el chi-cuadrado:

χ2 = (11 * 5 - 1 * 5)2 * 22 / (12 * 10 * 16 * 6)

χ2 = (55 - 5)2 * 22 / 11520 = 502 * 22 / 11520 = 2500 * 22 / 11520 = 55000 / 11520 ≈ 4.7743

El valor p es 0.0288. Sin embargo, al examinar las frecuencias esperadas:

- (16 * 12) / 22 = 8.73

- (6 * 12) / 22 = 3.27

- (16 * 10) / 22 = 7.27

- (6 * 10) / 22 = 2.73

Dos de los recuentos esperados (3.27 y 2.73) son menores que 5. En este caso, la mayoría de los textos de estadística desaconsejan el uso del chi-cuadrado y recomiendan la prueba exacta de Fisher o la corrección de Yates.

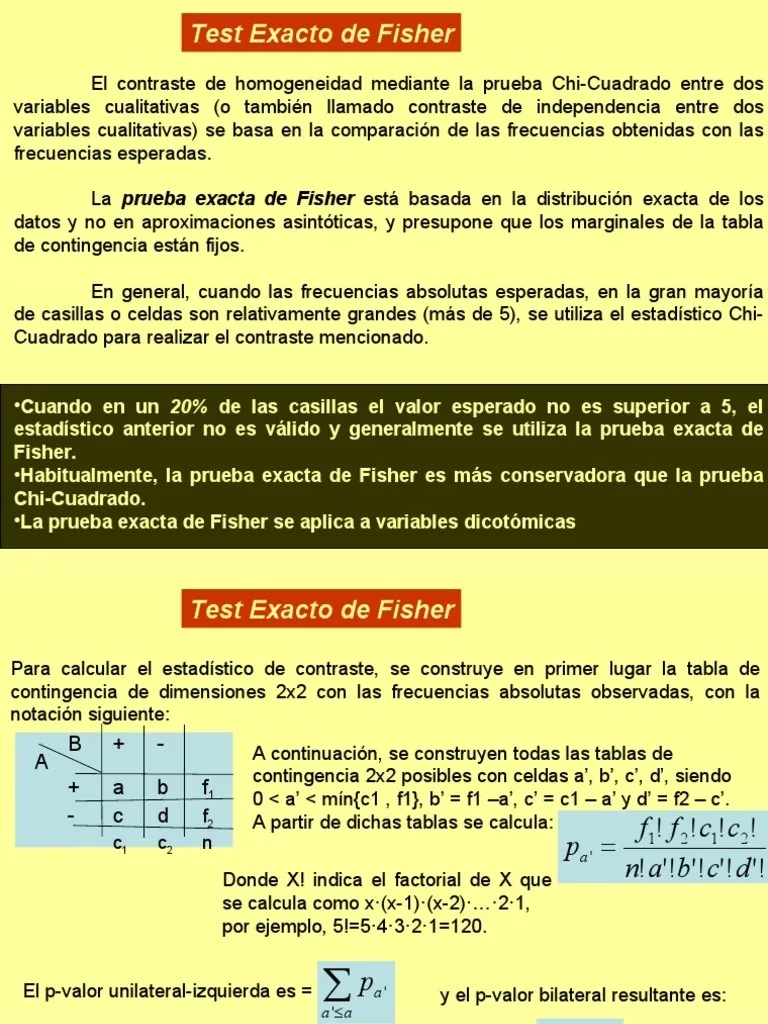

La Prueba Exacta de Fisher: Precisión en Muestras Pequeñas

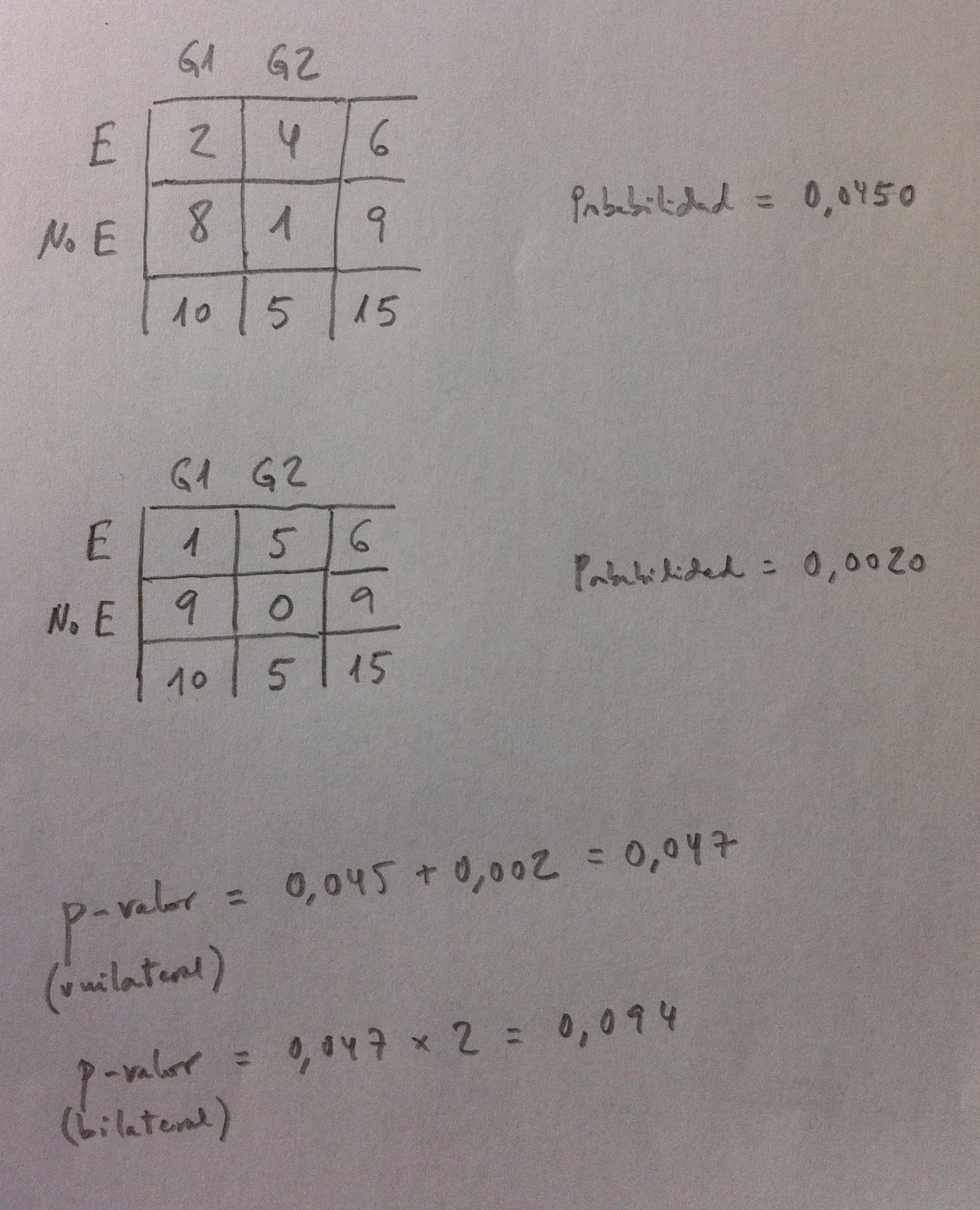

La prueba exacta de Fisher utiliza probabilidades exactas en lugar de aproximaciones. Tiende a ser más conservadora, generando valores p más altos y requiriendo diferencias mayores entre grupos para alcanzar significación estadística. La prueba de Fisher calcula el valor p determinando las probabilidades de todas las combinaciones posibles de tablas de 2x2 que tienen los mismos totales marginales (los valores de m, n, r y s) que son iguales o más extremos que los observados.

La probabilidad de cada tabla de 2x2 se calcula utilizando la siguiente fórmula basada en la distribución hipergeométrica:

p = (m! * n! * r! * s!) / (a! * b! * c! * d! * N!)

Donde '!' denota el factorial del número. Los cálculos son tediosos de hacer a mano y pueden generar números extremadamente grandes debido a los factoriales. Por lo tanto, el software estadístico es indispensable para calcular los valores p, ya que normalmente hay docenas de tablas con los mismos totales marginales o más extremos, incluso para tamaños de muestra modestos.

Cálculo del Valor p en la Prueba Exacta de Fisher: Ejemplo Práctico

Retomemos el ejemplo de las tasas de conversión (11/12 en Diseño A, 5/10 en Diseño B). Para aplicar la prueba exacta de Fisher, necesitamos considerar todas las tablas posibles que tengan los mismos totales marginales (12, 10, 16, 6) que la tabla observada, y que sean igual o más extremas. La idea es "desplazar" los valores internos de la tabla (a, b, c, d) manteniendo fijos los totales de fila y columna, y calcular la probabilidad de cada una de estas tablas. El valor p es la suma de las probabilidades de todas las tablas con una probabilidad igual o menor que la observada.

Para nuestro ejemplo de Diseño A/B con recuentos (11, 1, 5, 5) y marginales (12, 10, 16, 6, N=22), las tablas posibles con los mismos marginales fijos se construyen reduciendo la frecuencia mínima de una columna hasta que llega a cero, ajustando las otras celdas para mantener los marginales. Esto genera una serie de tablas, y se calcula la probabilidad de cada una usando la fórmula de Fisher. La suma de estas probabilidades (de la tabla observada y las más extremas en la dirección de la hipótesis) da el valor p. Para este ejemplo, un calculador en línea de Fisher arroja un valor p de 0.0557.

Si nuestro umbral de significación es 0.05, estrictamente hablando, con la prueba exacta de Fisher, concluiríamos que NO hay una diferencia estadísticamente significativa entre los diseños, ya que 0.0557 > 0.05. Esto ilustra la naturaleza más conservadora de la prueba exacta de Fisher.

Alternativas y Correcciones

Corrección de Yates

La corrección de Yates intenta aproximar los valores p de la prueba exacta de Fisher mediante un simple ajuste a la fórmula original de chi-cuadrado:

χ2Yates = (|ad - bc| - N/2)2 * N / (m n r s)

Aplicando esta corrección al ejemplo de la muestra pequeña:

χ2Yates = (|11 * 5 - 1 * 5| - 22/2)2 * 22 / (12 * 10 * 16 * 6)

χ2Yates = (|55 - 5| - 11)2 * 22 / 11520 = (50 - 11)2 * 22 / 11520 = 392 * 22 / 11520 = 1521 * 22 / 11520 = 33462 / 11520 ≈ 2.905

El valor p resultante es 0.0883. La corrección de Yates tiende a generar valores p más altos que la prueba exacta de Fisher, siendo aún más conservadora y sobreestimando la verdadera probabilidad a largo plazo de una diferencia. Por esta razón, y dado que la mayoría del software puede calcular fácilmente la prueba exacta de Fisher, generalmente no se recomienda el uso de la corrección de Yates.

La Prueba Chi-Cuadrado N-1 y la Prueba de Dos Proporciones N-1

Karl Pearson también propuso una forma alternativa de la prueba de chi-cuadrado en su trabajo original. En lugar de multiplicar el numerador por N (el tamaño total de la muestra), se multiplica por N-1:

χ2N-1 = (ad - bc)2 * (N - 1) / (m n r s)

Estudios recientes han demostrado que este simple ajuste tiene un mejor rendimiento que el chi-cuadrado estándar, la variante de Yates y la prueba exacta de Fisher para casi todos los tamaños de muestra, excepto cuando el recuento esperado mínimo de la celda es inferior a 1 (en cuyo caso Fisher es un sustituto apropiado).

Aplicando la prueba chi-cuadrado N-1 al ejemplo de la muestra pequeña:

χ2N-1 = (11 * 5 - 1 * 5)2 * (22 - 1) / (12 * 10 * 16 * 6)

χ2N-1 = (50)2 * 21 / 11520 = 2500 * 21 / 11520 = 52500 / 11520 ≈ 4.557

El valor p resultante es 0.0328. Con un umbral de 0.05, concluiríamos que hay una diferencia estadísticamente significativa entre los diseños.

La prueba de dos proporciones N-1 es matemáticamente equivalente a la prueba de chi-cuadrado N-1, pero utiliza la distribución normal (Z) para generar los valores p. Esta aproximación puede ser más intuitiva para muchos, ya que permite pensar en términos de tasas de finalización o conversión, utiliza la distribución normal más familiar y simplifica la comprensión de los intervalos de confianza. La fórmula ajustada es:

z = (&pcirc1 - &pcirc2) / √[ (N-1)/N * P * Q * (1/n1 + 1/n2) ]

Donde &pcirc1 y &pcirc2 son las proporciones muestrales, P es la proporción combinada de éxitos (x1+x2)/(n1+n2), Q = 1-P, y n1 y n2 son los tamaños de las muestras.

Para el ejemplo (11/12 en Diseño A, 5/10 en Diseño B):

P = (11 + 5) / (12 + 10) = 16 / 22 ≈ 0.727

Q = 1 - 0.727 = 0.273

z = (0.917 - 0.50) / √[ (22-1)/22 * 0.727 * 0.273 * (1/12 + 1/10) ]

z = 0.417 / √[ 0.9545 * 0.1986 * 0.1833 ] ≈ 0.417 / √[ 0.0347 ] ≈ 0.417 / 0.1863 ≈ 2.238

Un valor p de 0.0328 (usando =(1-NORMSDIST(2.238))*2 en Excel), el mismo que el chi-cuadrado N-1, demostrando su equivalencia matemática.

Resumen y Recomendaciones

La siguiente tabla resume los valores p generados a partir de los datos de nuestro ejemplo de muestra pequeña para los diferentes enfoques y nuestra estrategia recomendada:

| Método | Valor P | Notas |

|---|---|---|

| Chi-cuadrado N-1 / Prueba de dos proporciones N-1 | 0.0328 | Recomendado: Cuando todos los recuentos esperados de las celdas son >1. |

| Chi-cuadrado / Prueba de dos proporciones estándar | 0.0288 | No recomendado: Subestima la verdadera probabilidad para muestras pequeñas. |

| Chi-cuadrado con corrección de Yates | 0.0883 | No recomendado: Sobrestima la verdadera probabilidad para todos los tamaños de muestra. |

| Prueba Exacta de Fisher | 0.0557 | Recomendado: Cuando cualquier recuento esperado de las celdas es <1. |

En resumen, si bien la prueba de chi-cuadrado es una herramienta valiosa para muestras grandes, la prueba exacta de Fisher es indispensable cuando nos enfrentamos a muestras pequeñas y recuentos de celdas esperados bajos, asegurando una mayor precisión al calcular probabilidades exactas. Para la mayoría de los casos de tamaños de muestra, la prueba chi-cuadrado N-1 o la prueba de dos proporciones N-1 ofrecen un rendimiento superior. Es fundamental elegir la prueba adecuada para cada escenario para garantizar la validez de las conclusiones estadísticas.

Preguntas Frecuentes (FAQ)

¿Cuándo debo usar la prueba exacta de Fisher?

La prueba exacta de Fisher debe usarse cuando se desea estudiar la asociación entre dos variables cualitativas dicotómicas (tablas 2x2), especialmente si el tamaño de la muestra es pequeño (generalmente menos de 1000 observaciones) o si alguno de los recuentos esperados en las celdas de la tabla de contingencia es menor que 5 (o incluso menor que 1, donde es la opción preferida).

¿Es la prueba exacta de Fisher siempre la mejor opción para muestras pequeñas?

La prueba exacta de Fisher es una excelente opción y la más precisa para muestras muy pequeñas, especialmente cuando los recuentos esperados en las celdas son extremadamente bajos (por ejemplo, menos de 1). Sin embargo, para la mayoría de las muestras pequeñas a moderadas donde los recuentos esperados de las celdas son mayores que 1, la investigación actual sugiere que la prueba chi-cuadrado N-1 (o su equivalente, la prueba de dos proporciones N-1) puede ofrecer un rendimiento ligeramente mejor.

¿Cómo se interpreta el valor p de la prueba exacta de Fisher?

El valor p de la prueba exacta de Fisher se interpreta de la misma manera que el valor p de cualquier otra prueba estadística. Si el valor p es menor que su nivel de significación predefinido (comúnmente 0.05), se rechaza la hipótesis nula (que las variables son independientes) y se concluye que existe una asociación estadísticamente significativa entre las dos variables. Si el valor p es mayor, no hay evidencia suficiente para rechazar la hipótesis nula.

¿Puedo usar la prueba exacta de Fisher para tablas de contingencia más grandes que 2x2?

Sí, existen extensiones del método de Fisher para tablas de contingencia más grandes (MxN). Muchos paquetes de software estadístico pueden realizar estas versiones generalizadas de la prueba exacta de Fisher, aunque los cálculos se vuelven exponencialmente más complejos.

¿Por qué se considera que la prueba exacta de Fisher es más conservadora?

Se considera más conservadora porque tiende a producir valores p más altos que las pruebas aproximadas, lo que significa que requiere una evidencia más fuerte (una diferencia más grande entre los grupos) para alcanzar la significación estadística. Esto se debe a que calcula probabilidades exactas para todas las configuraciones de datos posibles, lo que puede limitar el número de resultados "extremos" que contribuyen al valor p total, comparado con las aproximaciones continuas.

Si quieres conocer otros artículos parecidos a Prueba Exacta de Fisher: Cuándo y Cómo Usarla puedes visitar la categoría Estadística.