04/11/2023

En el vasto universo de las matemáticas, los sistemas de ecuaciones lineales son una herramienta fundamental para modelar y resolver problemas en diversas disciplinas, desde la ingeniería y la física hasta la economía y la informática. Sin embargo, a medida que la cantidad de ecuaciones y variables aumenta, su resolución manual se vuelve tediosa y propensa a errores. Es aquí donde las matrices emergen como una solución elegante y poderosa, ofreciendo un marco sistemático y eficiente para abordar estos desafíos. La capacidad de representar un conjunto de ecuaciones como una única estructura matricial no solo simplifica la notación, sino que también abre la puerta a algoritmos computacionales que pueden encontrar soluciones con una velocidad y precisión inigualables.

Este artículo explora cómo las matrices revolucionan la forma en que entendemos y resolvemos sistemas de ecuaciones lineales. Desde la conversión de un sistema tradicional a su forma matricial Ax=b, hasta la aplicación de criterios clave para determinar la existencia y unicidad de soluciones, y finalmente, la exposición de los métodos matriciales más utilizados para encontrar dichas soluciones. Prepárate para desentrañar el potencial de las matrices y transformar tu perspectiva sobre la resolución de problemas algebraicos complejos.

- ¿Qué es un Sistema de Ecuaciones Lineales?

- La Representación Matricial: Ax = b

- ¿Cuándo un Sistema Tiene Solución? El Criterio del Rango

- Métodos de Resolución de Sistemas con Matrices

- Ejemplos Prácticos (Conceptual)

- Comparativa de Métodos de Resolución con Matrices

- Preguntas Frecuentes (FAQs)

- ¿Por qué usar matrices para resolver ecuaciones en lugar de métodos tradicionales?

- ¿Cuándo un sistema de ecuaciones no tiene solución?

- ¿Es siempre posible usar el método de la matriz inversa?

- ¿Cuál es el método matricial más eficiente para resolver sistemas grandes?

- ¿Qué significa el rango de una matriz en el contexto de las soluciones?

¿Qué es un Sistema de Ecuaciones Lineales?

Un sistema de ecuaciones lineales es un conjunto de dos o más ecuaciones lineales que comparten las mismas variables. El objetivo principal al trabajar con estos sistemas es encontrar los valores de las variables que satisfacen simultáneamente todas las ecuaciones. Por ejemplo, un sistema simple podría ser:

2x + 3y = 7

x - y = 1

Aquí, buscamos valores de 'x' e 'y' que hagan que ambas igualdades sean verdaderas. La resolución de estos sistemas es crucial en muchas aplicaciones del mundo real, ya que permiten modelar situaciones donde múltiples condiciones interdependientes deben ser satisfechas.

La Representación Matricial: Ax = b

Una de las mayores ventajas de utilizar matrices es la capacidad de condensar un sistema de ecuaciones lineales en una forma mucho más compacta y manejable, conocida como la ecuación matricial Ax = b. Esta notación no solo es elegante, sino que también es la base para aplicar algoritmos matriciales para la resolución.

¿Cómo se forma la ecuación Ax = b?

Para transformar un sistema de ecuaciones lineales en su forma matricial Ax = b, necesitamos identificar tres componentes clave:

- La matriz de coeficientes (A): Esta matriz se construye con los coeficientes numéricos de las variables en cada ecuación, manteniendo el orden de las variables. Si una variable no aparece en una ecuación, su coeficiente es cero.

- El vector de incógnitas (x): Este es un vector columna que contiene todas las variables del sistema, en el mismo orden en que aparecen sus coeficientes en la matriz A.

- El vector de términos independientes (b): Este es un vector columna que contiene los términos constantes (los números al lado derecho de las ecuaciones) de cada ecuación.

Consideremos el sistema de ecuaciones:

2x1 + 3x2 - 2x3 = 7

x1 - x2 - 3x3 = 5

Aquí, la matriz de coeficientes A sería:

A = [[2, 3, -2], [1, -1, -3]]

El vector de incógnitas x sería:

x = [[x1], [x2], [x3]]

Y el vector de términos independientes b sería:

b = [[7], [5]]

Así, el sistema original se puede reescribir como la ecuación matricial:

[[2, 3, -2], [1, -1, -3]] * [[x1], [x2], [x3]] = [[7], [5]]

Esta es la forma Ax = b. Es fundamental entender que el producto de la matriz A por el vector x resulta en un nuevo vector que representa las combinaciones lineales de las columnas de A, donde los coeficientes son las entradas de x. Este resultado debe ser igual al vector b.

Cuatro Maneras Equivalentes de Escribir un Sistema Lineal

La belleza de la notación matricial radica en su equivalencia con otras representaciones, lo que nos permite cambiar de una a otra según la conveniencia o la perspectiva que necesitemos para la resolución o el análisis. Estas son las cuatro formas principales de conceptualizar un sistema de ecuaciones lineales:

- Como un Sistema de Ecuaciones: Es la forma tradicional y más intuitiva que hemos visto hasta ahora, con cada ecuación listada explícitamente.

- Como una Matriz Aumentada: Combina la matriz de coeficientes A y el vector de términos independientes b en una sola matriz, separadas por una línea vertical. Por ejemplo, para el sistema anterior, la matriz aumentada sería:

[[2, 3, -2 | 7], [1, -1, -3 | 5]]. Esta forma es particularmente útil para aplicar métodos de reducción por filas. - Como una Ecuación Vectorial: Expresa el sistema como una combinación lineal de los vectores columna de la matriz de coeficientes, donde las incógnitas son los escalares de la combinación. Para nuestro ejemplo:

x1 * [[2], [1]] + x2 * [[3], [-1]] + x3 * [[-2], [-3]] = [[7], [5]]. Esto resalta la interpretación geométrica de las soluciones. - Como una Ecuación Matricial (Ax = b): La forma compacta que hemos estado discutiendo, donde A es la matriz de coeficientes, x es el vector de incógnitas y b es el vector de términos independientes.

Todas estas representaciones tienen el mismo conjunto de soluciones, y la habilidad para transitar entre ellas es una habilidad clave en el álgebra lineal.

¿Cuándo un Sistema Tiene Solución? El Criterio del Rango

Una de las preguntas más importantes al abordar un sistema de ecuaciones lineales es si este tiene solución, y si la tiene, cuántas. La respuesta a esta pregunta se encuentra en el concepto del rango de una matriz, una medida de la 'dimensión' de la matriz, que se define como el número máximo de filas (o columnas) linealmente independientes que contiene. El criterio fundamental para la consistencia de un sistema se basa en la comparación del rango de la matriz de coeficientes y el rango de la matriz ampliada.

El Teorema de Rouché-Frobenius

El teorema clave que nos permite determinar la existencia de soluciones es el Teorema de Rouché-Frobenius, que establece:

- Un sistema de ecuaciones lineales Ax = b es consistente (es decir, tiene al menos una solución) si y solo si el rango de la matriz de coeficientes A es igual al rango de la matriz ampliada A*. Es decir, rang(A) = rang(A*).

- Si rang(A) ≠ rang(A*), el sistema es inconsistente y no tiene solución.

La matriz ampliada (A*) se forma añadiendo el vector de términos independientes 'b' como una columna adicional a la matriz de coeficientes 'A'. Por ejemplo, para el sistema Ax=b, A* = [A | b].

Tipos de Soluciones según el Rango

Una vez que sabemos que un sistema es consistente, el rango nos dice si la solución es única o si hay infinitas soluciones:

- Sistema compatible determinado (Solución única): Esto ocurre cuando rang(A) = rang(A*) = n, donde 'n' es el número de variables (incógnitas) del sistema. En este caso, el sistema tiene una única solución. Esto significa que cada variable tiene un valor específico que satisface todas las ecuaciones.

- Sistema compatible indeterminado (Infinitas soluciones): Esto sucede cuando rang(A) = rang(A*) < n. Aquí, el sistema tiene un número infinito de soluciones. Esto implica que una o más variables pueden expresarse en términos de otras (variables libres), lo que genera un conjunto infinito de combinaciones que satisfacen el sistema.

- Sistema incompatible (Sin solución): Como se mencionó, si rang(A) ≠ rang(A*), el sistema no tiene solución. Esto suele manifestarse cuando, al intentar resolver el sistema, se llega a una contradicción, como

0 = 5.

Para calcular el rango de una matriz, generalmente se utiliza el método de eliminación Gaussiana o Gauss-Jordan para transformar la matriz en su forma escalonada. El número de filas no nulas en la matriz escalonada es el rango de la matriz.

Métodos de Resolución de Sistemas con Matrices

Una vez que hemos determinado que un sistema de ecuaciones lineales tiene solución, el siguiente paso es encontrarla. Las matrices nos ofrecen varios métodos sistemáticos para lograrlo, cada uno con sus propias ventajas y aplicabilidad.

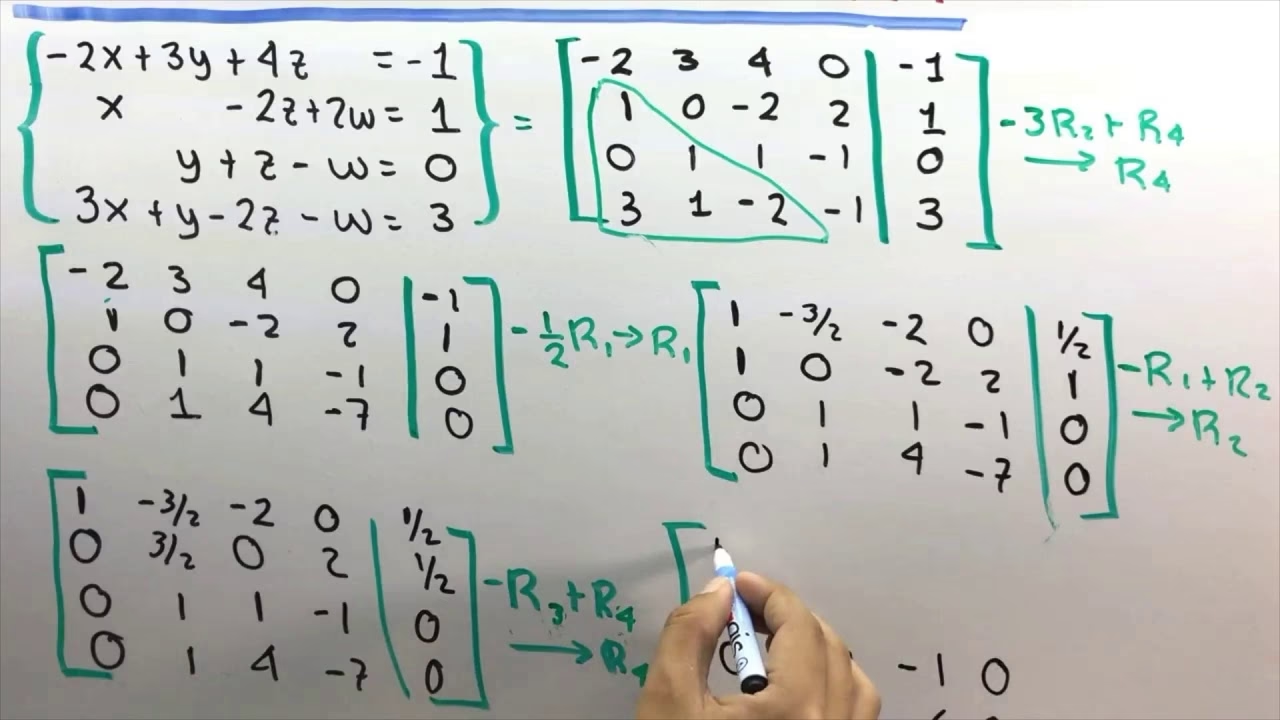

1. Eliminación Gaussiana

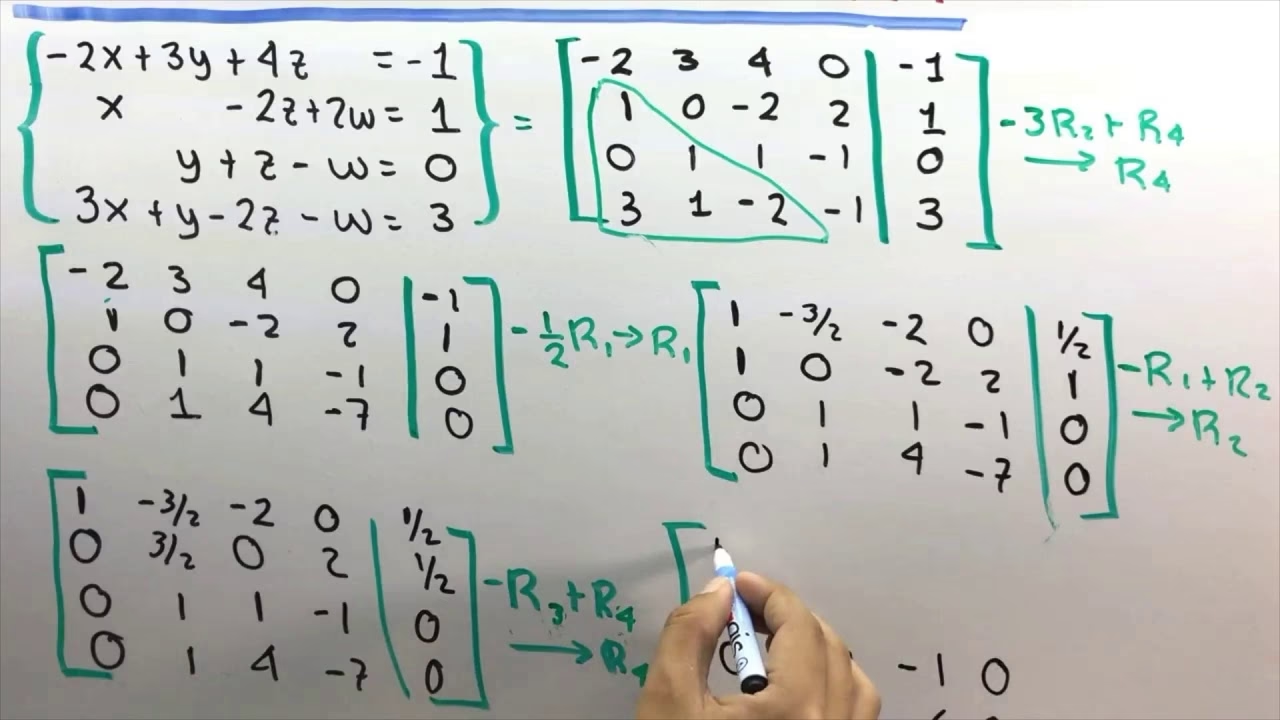

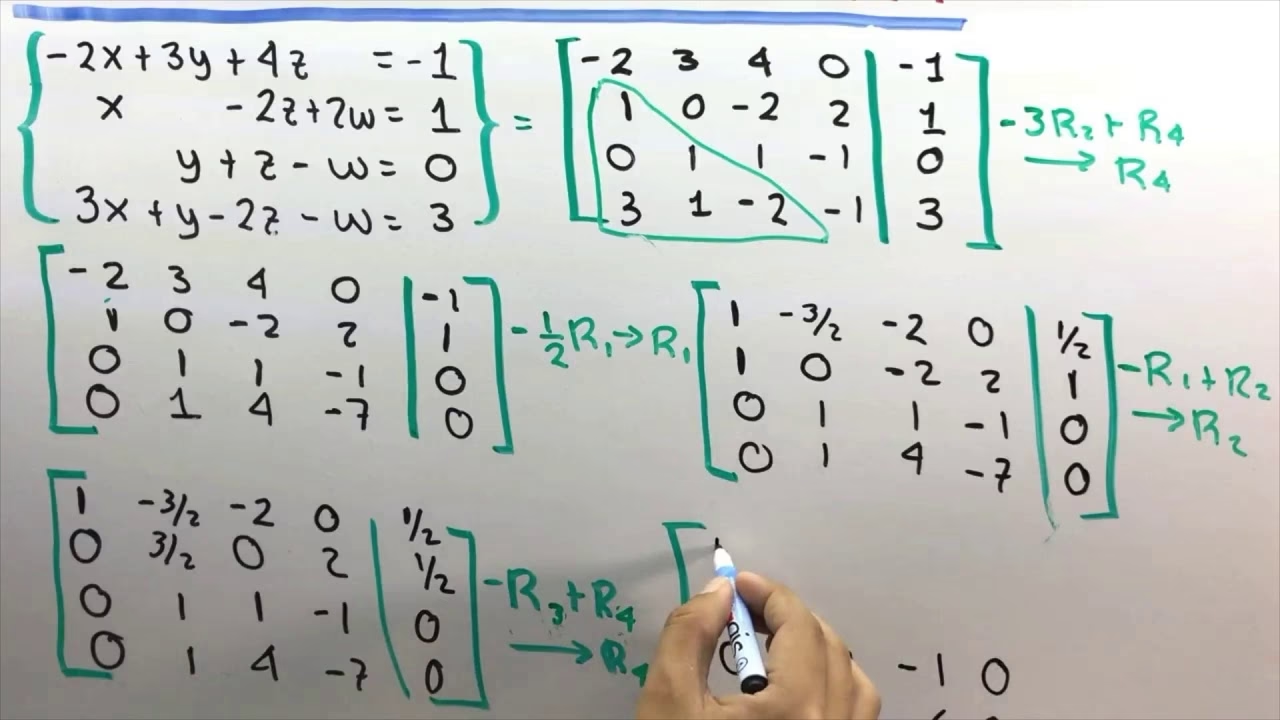

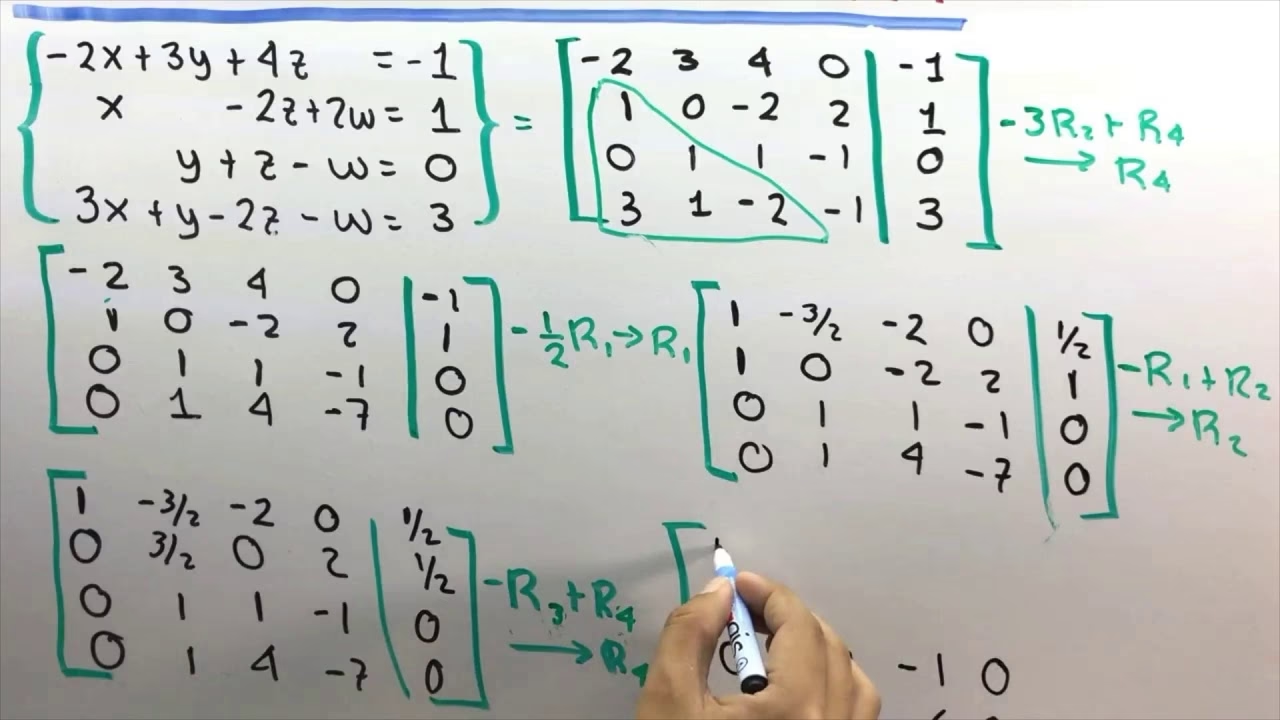

La eliminación Gaussiana es uno de los métodos más fundamentales y ampliamente utilizados para resolver sistemas de ecuaciones lineales. Consiste en transformar la matriz aumentada del sistema en una matriz escalonada superior mediante una serie de operaciones elementales por filas. Estas operaciones son:

- Intercambiar dos filas.

- Multiplicar una fila por un escalar no nulo.

- Sumar un múltiplo de una fila a otra fila.

El objetivo es obtener una matriz donde los elementos por debajo de la diagonal principal sean ceros, formando una estructura escalonada. Una vez que la matriz aumentada está en forma escalonada, el sistema de ecuaciones equivalente se resuelve fácilmente mediante sustitución hacia atrás. Se resuelve la última ecuación (que tendrá una sola variable), luego se sustituye este valor en la penúltima ecuación para encontrar la siguiente variable, y así sucesivamente hasta la primera ecuación.

2. Eliminación de Gauss-Jordan

La eliminación de Gauss-Jordan es una extensión de la eliminación Gaussiana. No solo transforma la matriz aumentada en una matriz escalonada, sino que la lleva un paso más allá para convertirla en una matriz escalonada reducida. Esto significa que:

- Todos los elementos por debajo y por encima de los pivotes (el primer elemento no nulo de cada fila) son cero.

- Los pivotes son todos iguales a 1.

Cuando la matriz aumentada se encuentra en su forma escalonada reducida, el sistema de ecuaciones correspondiente tiene una solución directa. Las columnas correspondientes a las variables pivote contendrán un '1' en la diagonal y ceros en el resto, lo que permite leer directamente los valores de las incógnitas del vector de términos independientes resultante.

3. Método de la Matriz Inversa

Este método es aplicable únicamente a sistemas de ecuaciones lineales donde la matriz de coeficientes A es cuadrada (es decir, el número de ecuaciones es igual al número de variables) y es invertible (su determinante es distinto de cero). Si A es invertible, entonces existe su matriz inversa, denotada como A-1. En este caso, la solución del sistema Ax = b se puede encontrar multiplicando ambos lados por A-1:

A-1 * (Ax) = A-1 * b

(A-1A) * x = A-1 * b

I * x = A-1 * b

x = A-1 * b

Donde 'I' es la matriz identidad. Este método es elegante y conceptualmente simple, pero su aplicación práctica puede ser computacionalmente intensiva para matrices grandes, ya que calcular la inversa de una matriz puede ser un proceso complejo.

4. Regla de Cramer

La Regla de Cramer es otro método para resolver sistemas de ecuaciones lineales que tienen el mismo número de ecuaciones que de variables (sistemas cuadrados) y cuya determinante de la matriz de coeficientes es diferente de cero. Este método expresa la solución para cada variable como una razón de determinantes. Para cada variable xi, su valor se calcula como el determinante de una matriz específica (formada reemplazando la columna i de A con el vector b) dividido por el determinante de la matriz de coeficientes A. Aunque conceptualmente interesante, la Regla de Cramer es computacionalmente muy ineficiente para sistemas con más de tres o cuatro variables debido a la gran cantidad de determinantes que deben calcularse.

Ejemplos Prácticos (Conceptual)

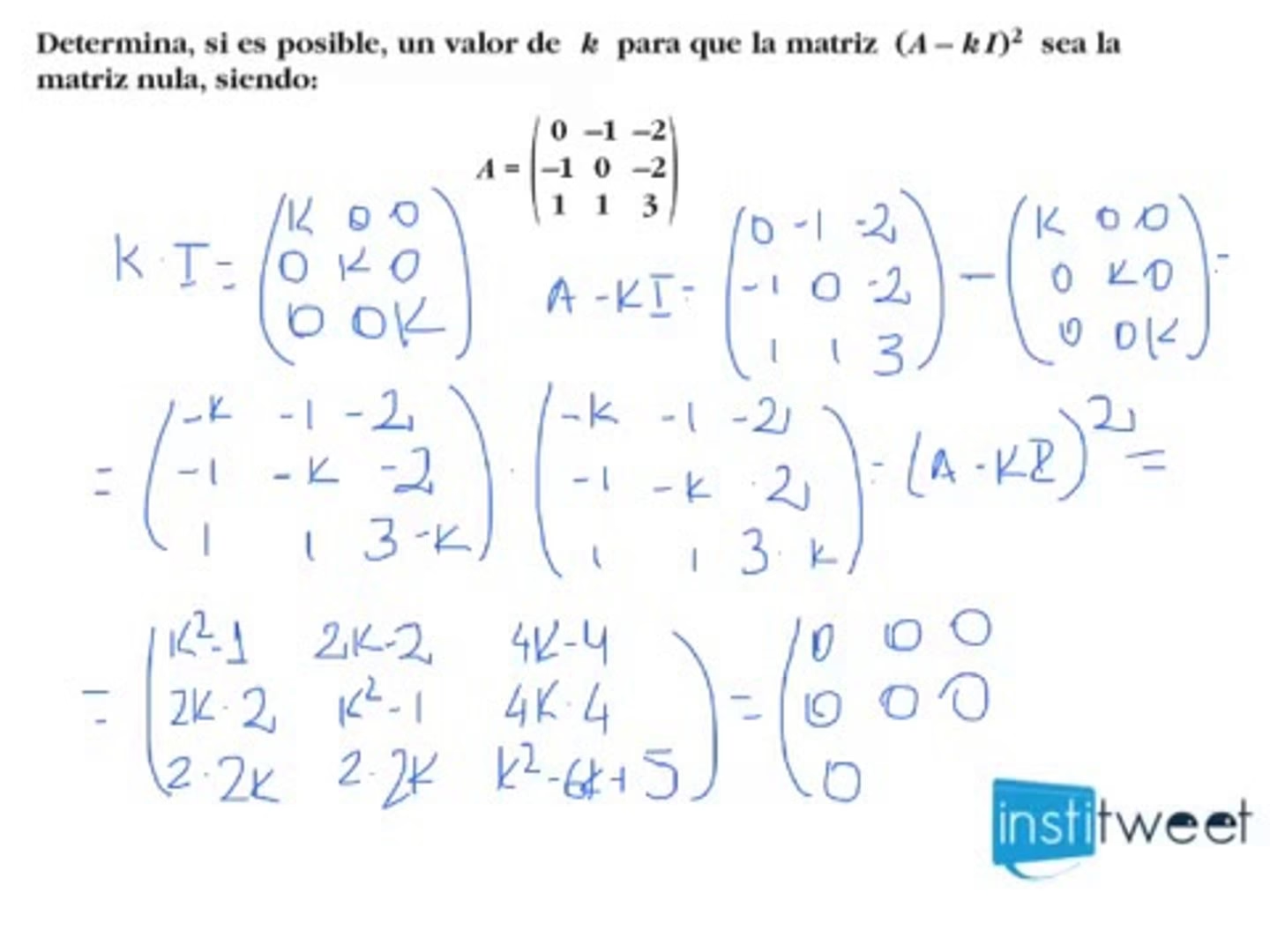

Para ilustrar el proceso de resolución con matrices, consideremos un sistema de 3 ecuaciones con 3 incógnitas. El primer paso sería escribir el sistema en su forma matricial aumentada [A | b]. Luego, se aplicaría uno de los métodos de reducción por filas. Por ejemplo, si usamos la eliminación de Gauss-Jordan, nuestro objetivo sería transformar [A | b] en [I | x], donde 'I' es la matriz identidad y 'x' es el vector de soluciones. Esto se logra realizando operaciones elementales en las filas hasta que la parte izquierda de la matriz aumentada se convierta en la matriz identidad. Una vez alcanzado este estado, los valores de las incógnitas se leerán directamente en la columna final de la matriz aumentada. Si durante el proceso de reducción se llega a una fila de ceros en la parte de A y un número no cero en la parte de b (por ejemplo, [0 0 0 | 5]), entonces el sistema es incompatible y no tiene solución. Si se llega a una fila de ceros tanto en A como en b (por ejemplo, [0 0 0 | 0]), el sistema tiene infinitas soluciones y se deberán expresar las variables libres en términos de parámetros.

Comparativa de Métodos de Resolución con Matrices

Cada método de resolución matricial tiene sus fortalezas y debilidades, lo que hace que la elección del método adecuado dependa del tipo y tamaño del sistema, así como de los recursos computacionales disponibles.

| Método | Aplicabilidad | Ventajas | Desventajas |

|---|---|---|---|

| Eliminación Gaussiana | Cualquier sistema lineal | Eficiente, base para otros algoritmos, robusta. | Requiere sustitución hacia atrás. |

| Eliminación de Gauss-Jordan | Cualquier sistema lineal | Solución directa, fácil de interpretar. | Ligeramente menos eficiente que Gaussiana para grandes sistemas. |

| Matriz Inversa | Sistemas cuadrados con matriz de coeficientes invertible. | Fórmula directa para la solución, útil en análisis teórico. | Costoso computacionalmente, no aplicable si A no es invertible. |

| Regla de Cramer | Sistemas cuadrados con determinante de A no nulo. | Fórmula explícita para cada variable. | Muy ineficiente para sistemas grandes debido al cálculo de determinantes. |

Preguntas Frecuentes (FAQs)

A continuación, respondemos algunas de las preguntas más comunes sobre la resolución de sistemas de ecuaciones con matrices:

¿Por qué usar matrices para resolver ecuaciones en lugar de métodos tradicionales?

Las matrices ofrecen una notación compacta y sistemática que simplifica la representación de sistemas complejos. Son ideales para la implementación computacional, permitiendo resolver sistemas con cientos o miles de variables de manera eficiente y precisa, algo inalcanzable con métodos manuales tradicionales. Además, proporcionan herramientas poderosas para el análisis de la existencia y unicidad de soluciones.

¿Cuándo un sistema de ecuaciones no tiene solución?

Un sistema no tiene solución (es inconsistente) cuando el rango de la matriz de coeficientes (A) es diferente al rango de la matriz ampliada (A*). Geométricamente, esto significa que las ecuaciones representan planos o líneas que no se intersectan en ningún punto común, o que llevan a una contradicción matemática, como 0 = 1.

¿Es siempre posible usar el método de la matriz inversa?

No. El método de la matriz inversa solo se puede usar si el sistema es cuadrado (mismo número de ecuaciones que de variables) y si la matriz de coeficientes es invertible, lo que significa que su determinante debe ser diferente de cero. Si el determinante es cero, la matriz no tiene inversa y este método no es aplicable.

¿Cuál es el método matricial más eficiente para resolver sistemas grandes?

Para sistemas grandes, los métodos basados en la eliminación por filas, como la eliminación Gaussiana o Gauss-Jordan, son generalmente los más eficientes. Aunque Gauss-Jordan da la solución directa, la eliminación Gaussiana seguida de sustitución hacia atrás puede ser ligeramente más rápida en términos de operaciones computacionales para sistemas muy grandes. Los métodos de la matriz inversa y la Regla de Cramer se vuelven prohibitivamente costosos a medida que el tamaño del sistema aumenta.

¿Qué significa el rango de una matriz en el contexto de las soluciones?

El rango de una matriz es el número de filas o columnas linealmente independientes que tiene. En el contexto de un sistema de ecuaciones, el rango de la matriz de coeficientes (A) indica el número de ecuaciones realmente independientes. Compararlo con el rango de la matriz ampliada (A*) nos dice si el sistema es consistente y, si lo es, si tiene una solución única (rangos iguales al número de variables) o infinitas soluciones (rangos iguales pero menores que el número de variables). Es un indicador crucial de la naturaleza del conjunto de soluciones.

En resumen, las matrices no son solo una forma diferente de escribir sistemas de ecuaciones; son una herramienta conceptual y computacional que transforma la complejidad en claridad. Comprender su funcionamiento y los métodos asociados es esencial para cualquier persona que trabaje con problemas que puedan modelarse linealmente. Desde determinar si existe una solución hasta encontrarla de manera eficiente, el álgebra matricial proporciona un marco riguroso y adaptable. Al dominar estas técnicas, no solo resolverás ecuaciones, sino que también obtendrás una comprensión más profunda de la estructura subyacente de los problemas matemáticos y sus aplicaciones en el mundo real.

Si quieres conocer otros artículos parecidos a El Poder de las Matrices en la Solución de Ecuaciones puedes visitar la categoría Matemáticas.