01/04/2022

En el vasto universo de la probabilidad y la estadística, existen símbolos que, a primera vista, pueden parecer crípticos, pero que encierran un poder inmenso para predecir y comprender el comportamiento de los fenómenos. Uno de esos símbolos es µ (mu), que representa el valor esperado o la media de una variable aleatoria. Comprender cómo calcular y utilizar µ es fundamental para cualquiera que desee ir más allá de los cálculos básicos y adentrarse en la predicción de resultados a largo plazo. Acompáñanos en este viaje para desentrañar el significado de µ, su relación con otros conceptos clave como la varianza y la desviación estándar, y cómo estas herramientas nos permiten analizar con mayor profundidad cualquier distribución de probabilidad.

- ¿Qué es µ (Mu) en Probabilidad?

- La Fórmula Mágica: Cómo Calcular µ

- µ como Parámetro Poblacional y la Ley de los Grandes Números

- Más Allá de la Media: La Varianza (σ²) y la Desviación Estándar (σ)

- µ y σ en la Distribución Normal

- Ejemplos Prácticos Adicionales: Juegos de Azar y Toma de Decisiones

- Preguntas Frecuentes sobre µ y σ

- Conclusión

¿Qué es µ (Mu) en Probabilidad?

Cuando hablamos de µ en el contexto de una variable aleatoria discreta X, nos referimos a su valor esperado, también conocido como la media a largo plazo. Imagina que repites un experimento una y otra vez, un número muy grande de veces. El valor esperado de X es el promedio que anticiparías obtener en el transcurso de esas repeticiones. No es lo que sucederá en un único intento, sino la tendencia promedio si el experimento se realiza infinitamente.

Por ejemplo, si lanzas tres monedas justas y X es el número de caras que obtienes, el valor esperado de X sería el número promedio de caras que esperarías obtener por cada tres lanzamientos, si repitieras este experimento miles de veces. Este concepto es crucial porque nos permite resumir una distribución de probabilidad con un solo número, dándonos una idea central del comportamiento de la variable.

La Fórmula Mágica: Cómo Calcular µ

Calcular el valor esperado, E(X) o µ, para una variable aleatoria discreta X es sorprendentemente sencillo una vez que conoces su distribución de probabilidad. La fórmula es la siguiente:

E(X) = µ = Σ xP(x)

x: Representa cada uno de los posibles valores que puede tomar la variable aleatoria X.P(x): Es la probabilidad correspondiente a cada valor de x. Es decir, la probabilidad de que la variable aleatoria X tome ese valor específico x.Σ: Simboliza la suma de todos los productos (x multiplicado por P(x)).

Para aplicar esta fórmula, simplemente multiplicas cada valor de la variable aleatoria por su probabilidad asociada y luego sumas todos esos productos. Veamos un ejemplo práctico para ilustrarlo:

Ejemplo 1: Días de Juego de un Equipo de Fútbol

Un equipo de fútbol masculino juega cero, uno o dos días a la semana. La probabilidad de que jueguen cero días es de 0.2, la probabilidad de que jueguen un día es de 0.5, y la probabilidad de que jueguen dos días es de 0.3. Queremos encontrar el promedio a largo plazo o el valor esperado (µ) del número de días por semana que el equipo de fútbol juega.

Primero, definimos la variable aleatoria X como el número de días que el equipo juega a la semana. X puede tomar los valores 0, 1, 2. Construimos una tabla de distribución de probabilidad y añadimos una columna para el producto xP(x):

| x (Días Jugados) | P(x) (Probabilidad) | xP(x) |

|---|---|---|

| 0 | 0.2 | (0)(0.2) = 0 |

| 1 | 0.5 | (1)(0.5) = 0.5 |

| 2 | 0.3 | (2)(0.3) = 0.6 |

Ahora, sumamos los valores de la columna xP(x) para obtener el valor esperado:

E(X) = µ = 0 + 0.5 + 0.6 = 1.1

El valor esperado o media es 1.1. Esto significa que, en promedio, el equipo de fútbol esperaría jugar 1.1 días por semana a largo plazo. Es importante destacar que 1.1 no es un valor que X pueda tomar (no se puede jugar 1.1 días), pero es el promedio que se esperaría si se observa el equipo durante muchas semanas.

µ como Parámetro Poblacional y la Ley de los Grandes Números

El símbolo µ se utiliza para la media porque es un parámetro. Representa la media de una población, no de una muestra. Esto nos lleva a un concepto fundamental en probabilidad: la Ley de los Grandes Números.

Esta ley establece que, a medida que el número de ensayos en un experimento de probabilidad aumenta, la diferencia entre la probabilidad teórica de un evento y su frecuencia relativa (o probabilidad experimental) se acerca a cero. En otras palabras, la probabilidad teórica y la frecuencia relativa se vuelven cada vez más parecidas. La frecuencia relativa, o probabilidad experimental, es lo que realmente sucede en la práctica.

Consideremos el lanzamiento de una moneda justa. La probabilidad teórica de obtener cara es 0.5. Si lanzas la moneda dos veces, no significa que obtendrás una cara y una cruz. Incluso si la lanzas 10 o 100 veces, no te garantiza la mitad de caras y la mitad de cruces. Sin embargo, si la lanzas 24,000 veces, como hizo Karl Pearson obteniendo 12,012 caras (una frecuencia relativa de 0.5005), verás cómo la frecuencia relativa se acerca mucho a la probabilidad teórica. Este ejemplo ilustra perfectamente la Ley de los Grandes Números y cómo el valor esperado (µ) se convierte en una predicción fiable a largo plazo.

Más Allá de la Media: La Varianza (σ²) y la Desviación Estándar (σ)

Si bien µ nos da una idea del centro de la distribución, no nos dice nada sobre su dispersión. Para eso, necesitamos la varianza (σ²) y la desviación estándar (σ). Al igual que la media, la varianza y la desviación estándar de una distribución de probabilidad son parámetros, ya que resumen información sobre una población.

La desviación estándar (σ) es una medida de cuán dispersos están los datos en relación con la media. Una desviación estándar baja (o pequeña) indica que los datos están agrupados firmemente alrededor de la media. Por el contrario, una desviación estándar alta (o grande) indica que los datos están más dispersos.

Para calcular la varianza σ² de una distribución de probabilidad discreta, seguimos estos pasos:

- Encuentra la desviación de cada valor respecto a la media (x - µ).

- Eleva al cuadrado cada desviación (x - µ)².

- Multiplica cada desviación al cuadrado por su probabilidad correspondiente P(x).

- Suma todos esos productos.

La fórmula es:

σ² = Σ (x - µ)² P(x)

Una vez que tienes la varianza, la desviación estándar (σ) se obtiene simplemente tomando la raíz cuadrada de la varianza:

σ = √σ² = √Σ (x - µ)² P(x)

Ejemplo 2: Despertar de Madres por Bebés

Un investigador estudió cuántas veces a la semana una madre primeriza era despertada por el llanto de su bebé después de la medianoche. Se seleccionaron 50 madres al azar. Los resultados fueron:

- 2 madres fueron despertadas 0 veces.

- 11 madres fueron despertadas 1 vez.

- 23 madres fueron despertadas 2 veces.

- 9 madres fueron despertadas 3 veces.

- 4 madres fueron despertadas 4 veces.

- 1 madre fue despertada 5 veces.

Primero, calculamos las probabilidades (frecuencias relativas) para cada valor de X (número de veces que la madre es despertada) y el valor esperado (µ), como hicimos en el ejemplo anterior. Ya sabemos por la información provista que µ = 2.1.

Ahora, construimos una tabla para calcular la varianza y la desviación estándar:

| x | P(x) | xP(x) | (x - µ)² | (x - µ)² • P(x) |

|---|---|---|---|---|

| 0 | 2/50 = 0.04 | 0 | (0 - 2.1)² = 4.41 | 4.41 • 0.04 = 0.1764 |

| 1 | 11/50 = 0.22 | 0.22 | (1 - 2.1)² = 1.21 | 1.21 • 0.22 = 0.2662 |

| 2 | 23/50 = 0.46 | 0.92 | (2 - 2.1)² = 0.01 | 0.01 • 0.46 = 0.0046 |

| 3 | 9/50 = 0.18 | 0.54 | (3 - 2.1)² = 0.81 | 0.81 • 0.18 = 0.1458 |

| 4 | 4/50 = 0.08 | 0.32 | (4 - 2.1)² = 3.61 | 3.61 • 0.08 = 0.2888 |

| 5 | 1/50 = 0.02 | 0.10 | (5 - 2.1)² = 8.41 | 8.41 • 0.02 = 0.1682 |

Sumamos la última columna para obtener la varianza:

σ² = 0.1764 + 0.2662 + 0.0046 + 0.1458 + 0.2888 + 0.1682 = 1.05

Finalmente, calculamos la desviación estándar:

σ = √1.05 ≈ 1.0247

Así, la desviación estándar de las veces que un bebé despierta a su madre por semana es aproximadamente 1.0247. Esto nos da una medida de la variabilidad en torno a la media de 2.1 despertares.

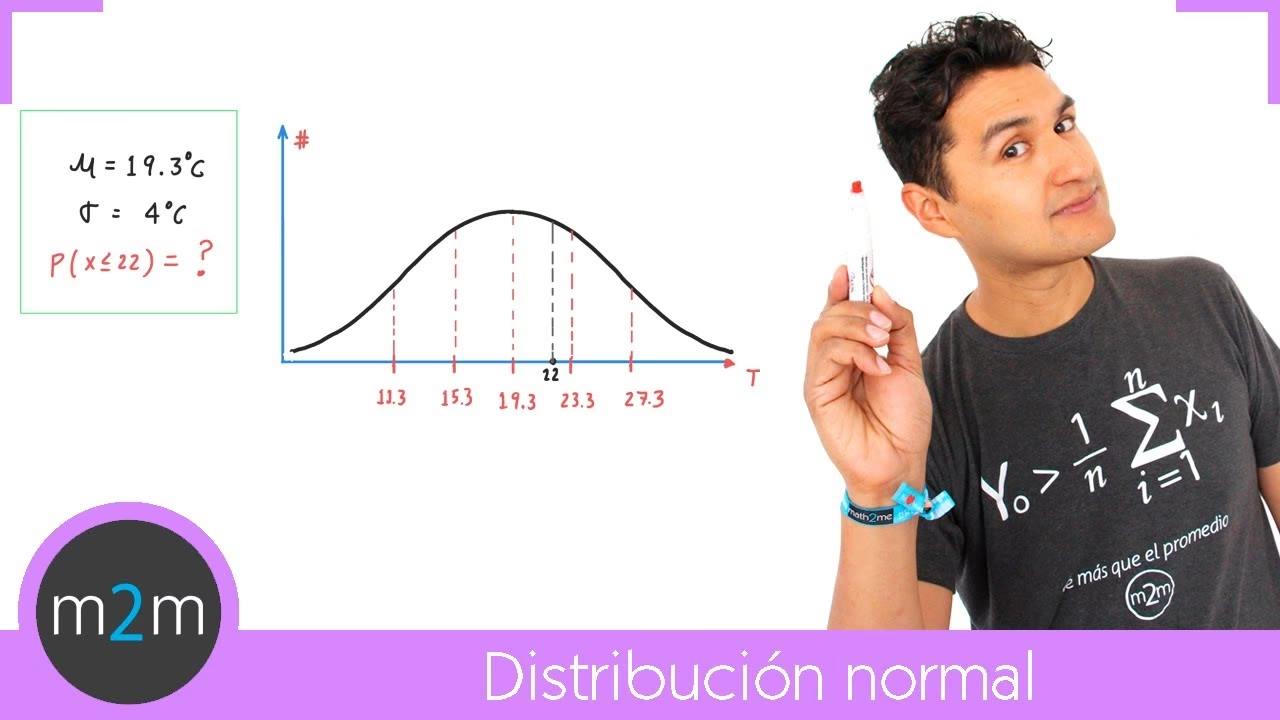

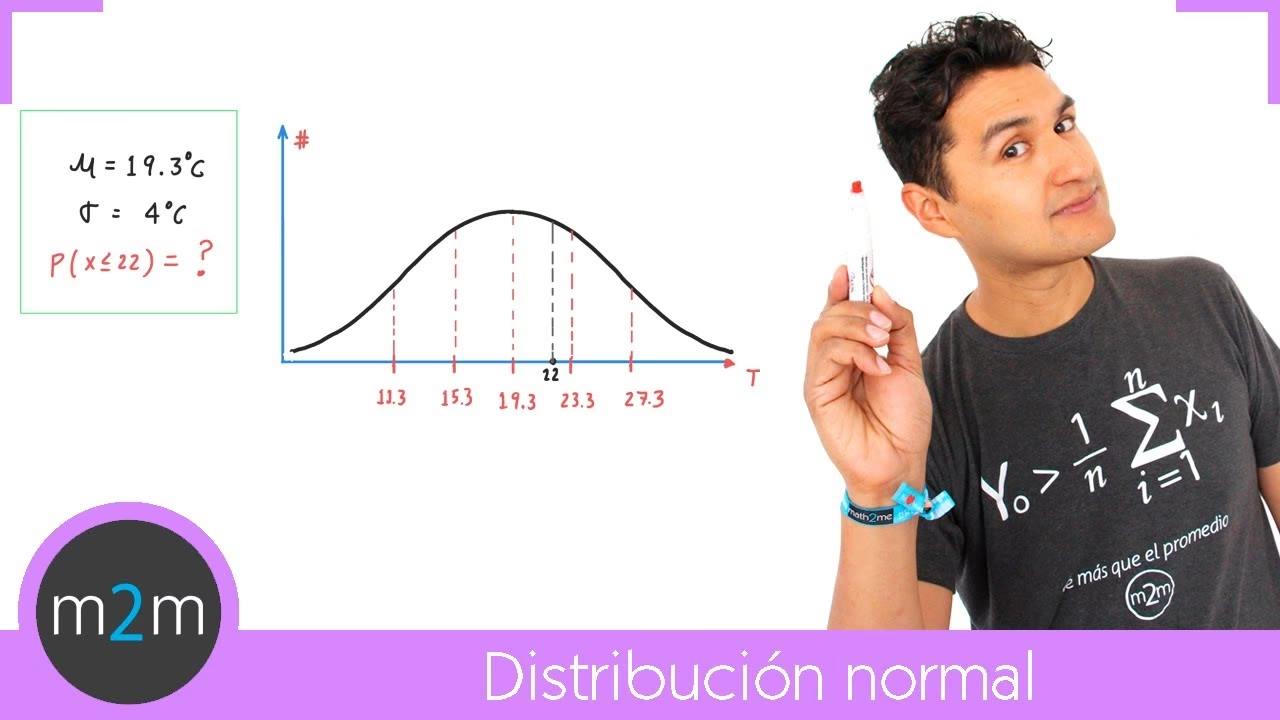

µ y σ en la Distribución Normal

La distribución normal, también conocida como la campana de Gauss, es quizás la distribución de probabilidad continua más importante y ampliamente utilizada en estadística y biomedicina. Su popularidad se debe a que un gran número de variables aleatorias en la naturaleza y en diversas disciplinas siguen esta distribución.

Lo fascinante de la distribución normal es que puede ser completamente caracterizada por solo dos parámetros: su media (µ) y su desviación estándar (σ). La media (µ) determina la posición del centro de la campana, mientras que la desviación estándar (σ) define su "ancho" o dispersión. Una σ pequeña indica una campana alta y estrecha (datos muy agrupados alrededor de la media), mientras que una σ grande indica una campana baja y ancha (datos más dispersos).

Una propiedad fundamental de la distribución normal es la "regla empírica" o "regla 68-95-99.7":

- Aproximadamente el 68% de los datos se encuentran dentro de una desviación estándar de la media (µ ± 1σ).

- Aproximadamente el 95% de los datos se encuentran dentro de dos desviaciones estándar de la media (µ ± 2σ).

- Aproximadamente el 99.7% de los datos se encuentran dentro de tres desviaciones estándar de la media (µ ± 3σ).

Esta regla es increíblemente útil para hacer inferencias rápidas sobre la distribución de los datos. Por ejemplo, si la presión arterial sistólica de adolescentes sigue una distribución normal con µ = 120 mmHg y σ = 12 mmHg, sabemos que el 95% de los adolescentes tendrá una presión entre 120 - 2*12 = 96 mmHg y 120 + 2*12 = 144 mmHg.

Además, µ y σ son esenciales para la estandarización. Cualquier valor de una distribución normal puede transformarse en una "puntuación z" utilizando la fórmula Z = (x - µ) / σ. Esta puntuación z indica cuántas desviaciones estándar se encuentra un valor dado de la media. La distribución de estas puntuaciones z es una distribución normal estándar, con una media de 0 y una desviación estándar de 1. Esto simplifica enormemente el cálculo de probabilidades, ya que solo se necesita una tabla de la distribución normal estándar para cualquier problema.

Ejemplos Prácticos Adicionales: Juegos de Azar y Toma de Decisiones

El valor esperado (µ) es especialmente revelador en el análisis de juegos de azar o inversiones, ya que nos permite predecir la ganancia o pérdida promedio a largo plazo. Aquí, µ se convierte en una herramienta para la toma de decisiones informadas.

Ejemplo 3: Un Juego de Lotería Simple

Supongamos que juegas un juego de azar donde se eligen cinco números del 0 al 9. Una computadora selecciona aleatoriamente cinco números con reemplazo. Pagas $2 para jugar. Si aciertas los cinco números en orden, ganas $100,000 (recuperas tus $2 más $100,000). Si no aciertas, pierdes tus $2. ¿Cuál es tu ganancia esperada a largo plazo?

Primero, definimos X como la cantidad de dinero que ganas (tu "profit").

- Si ganas: X = $100,000 (ganas $100,000 y recuperas tu apuesta inicial de $2, por lo que tu beneficio neto es $100,000).

- Si pierdes: X = -$2 (pierdes tu apuesta de $2).

Ahora, calculamos las probabilidades:

- La probabilidad de elegir el primer número correcto es 1/10.

- Dado que la selección es con reemplazo, la probabilidad de elegir los cinco números correctos en orden es (1/10) * (1/10) * (1/10) * (1/10) * (1/10) = 0.00001. Esta es P(X=$100,000).

- La probabilidad de perder es 1 - 0.00001 = 0.99999. Esta es P(X=-$2).

Construimos nuestra tabla de valor esperado:

| X (Profit) | P(x) | xP(x) |

|---|---|---|

| -$2 | 0.99999 | (-$2)(0.99999) = -$1.99998 |

| $100,000 | 0.00001 | ($100,000)(0.00001) = $1 |

Sumamos la última columna para obtener el valor esperado:

E(X) = µ = -$1.99998 + $1 = -$0.99998

Esto significa que, en promedio, esperarías perder aproximadamente $1 por cada juego que juegues a largo plazo. Aunque cada vez que juegues, o pierdes $2 o ganas $100,000, el promedio a lo largo de muchas partidas te indica una pérdida esperada. Esto es fundamental para entender la rentabilidad de los juegos de azar desde la perspectiva del jugador.

Preguntas Frecuentes sobre µ y σ

A continuación, respondemos algunas de las preguntas más comunes sobre µ y σ en estadística y probabilidad:

¿Es µ siempre un número entero?

No, como hemos visto en el ejemplo del equipo de fútbol (µ = 1.1) o el de las madres (µ = 2.1), el valor esperado µ no tiene por qué ser uno de los valores que la variable aleatoria pueda tomar. Es un promedio teórico a largo plazo, y como tal, puede ser un número decimal o fraccionario, incluso si los valores de la variable aleatoria son enteros.

¿Cuál es la diferencia entre µ y la media aritmética simple?

La media aritmética simple (o media muestral, usualmente denotada como x̄) se calcula sumando todos los valores de una muestra y dividiendo por el número de valores. Es una estadística que describe una muestra específica. µ (la media poblacional o valor esperado), por otro lado, es un parámetro que describe la distribución completa de una población, o la media teórica a largo plazo de una variable aleatoria. La media muestral (x̄) es una estimación de µ.

¿Para qué se usa el valor esperado (µ) en la vida real?

El valor esperado tiene innumerables aplicaciones. Se utiliza en finanzas para calcular el rendimiento esperado de inversiones, en seguros para determinar primas (riesgo esperado), en ingeniería para predecir el rendimiento de sistemas, en medicina para evaluar la efectividad de tratamientos, y en juegos para analizar la rentabilidad a largo plazo. Es una herramienta poderosa para la toma de decisiones bajo incertidumbre.

¿Cómo se relaciona µ con la Ley de los Grandes Números?

La Ley de los Grandes Números es el fundamento teórico detrás del valor esperado. Nos asegura que, a medida que aumentamos el número de observaciones o repeticiones de un experimento, la media de esas observaciones (la media muestral) convergerá hacia el valor esperado (µ) de la distribución. En esencia, µ es el punto al que la "media experimental" tiende a largo plazo.

¿Qué significa una desviación estándar de cero?

Una desviación estándar de cero (σ = 0) significa que no hay dispersión en los datos; todos los puntos de datos son idénticos a la media. En una distribución de probabilidad, esto implicaría que la variable aleatoria siempre toma el mismo valor con una probabilidad del 100%, lo cual es una situación muy específica y rara.

Conclusión

El valor esperado (µ) y la desviación estándar (σ) son pilares fundamentales en el estudio de la probabilidad y la estadística. Mientras que µ nos proporciona una medida de la tendencia central o el promedio a largo plazo de una variable aleatoria, σ nos informa sobre la dispersión o variabilidad de los datos alrededor de esa media. Juntos, estos dos parámetros ofrecen una imagen completa del comportamiento de una distribución de probabilidad, permitiéndonos no solo predecir resultados con mayor precisión, sino también comprender la incertidumbre inherente a los fenómenos aleatorios. Dominar el cálculo y la interpretación de µ y σ es un paso esencial para cualquier persona que busque tomar decisiones informadas y analizar datos de manera efectiva en cualquier campo.

Si quieres conocer otros artículos parecidos a Calculando µ en Probabilidad: La Media Escondida puedes visitar la categoría Estadística.