06/10/2025

En el vasto universo de la estadística, el aprendizaje automático y las pruebas diagnósticas, dos conceptos emergen con una importancia crítica: los falsos positivos y los falsos negativos. Estos términos, aunque suenen técnicos, son fundamentales para evaluar la fiabilidad de cualquier sistema que busque clasificar o predecir resultados. Comprender qué son, cómo se calculan y, lo que es más importante, cómo influyen en nuestras decisiones, es esencial para cualquiera que trabaje con datos o dependa de ellos.

Desde un test médico que indica una enfermedad inexistente, hasta un algoritmo de inteligencia artificial que marca una transacción legítima como fraudulenta, los errores de clasificación pueden tener consecuencias significativas. Este artículo desglosará cada uno de estos conceptos, ofreciendo una guía clara para su entendimiento y aplicación, con el objetivo de empoderarte para interpretar mejor la información y tomar decisiones más informadas.

- Entendiendo los Cuatro Posibles Resultados

- ¿Cómo Calcular un Falso Positivo?

- ¿Cómo Calcular un Falso Negativo?

- Falsos Positivos y Falsos Negativos en el Aprendizaje Automático

- Errores Tipo I y Tipo II en Estadística y Pruebas A/B

- El Equilibrio entre Falsos Positivos y Falsos Negativos

- Preguntas Frecuentes (FAQ)

- Conclusión

Entendiendo los Cuatro Posibles Resultados

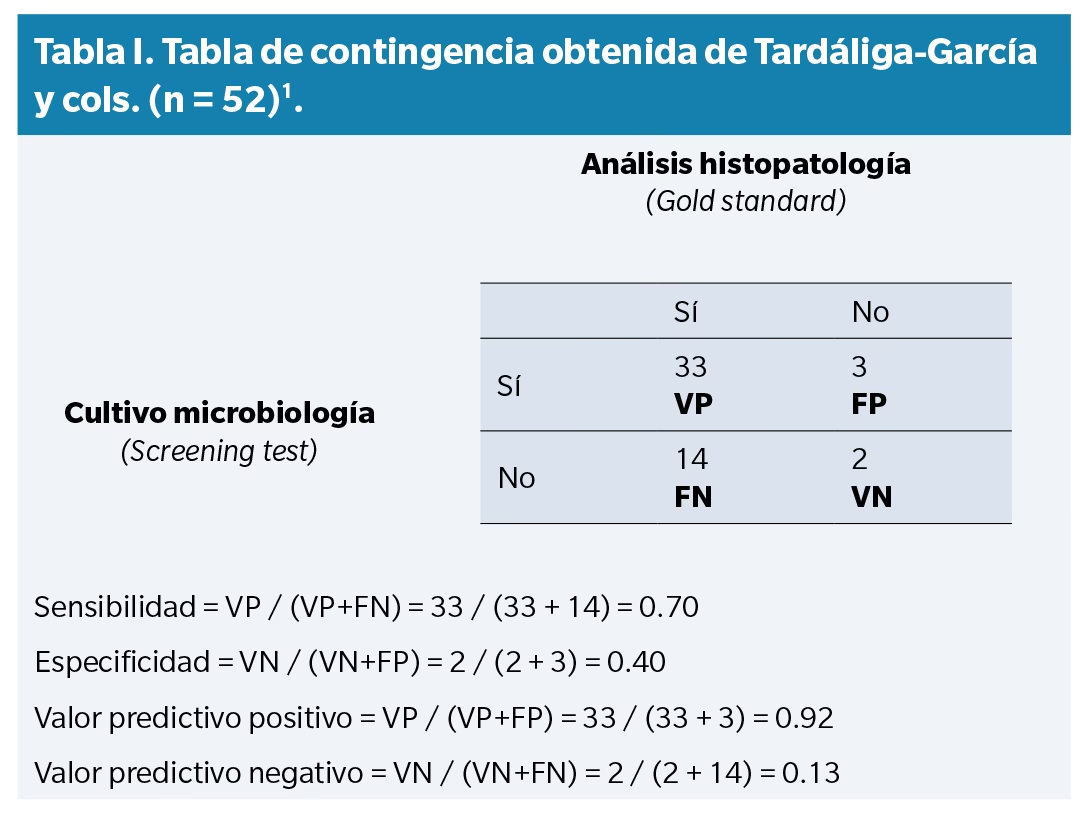

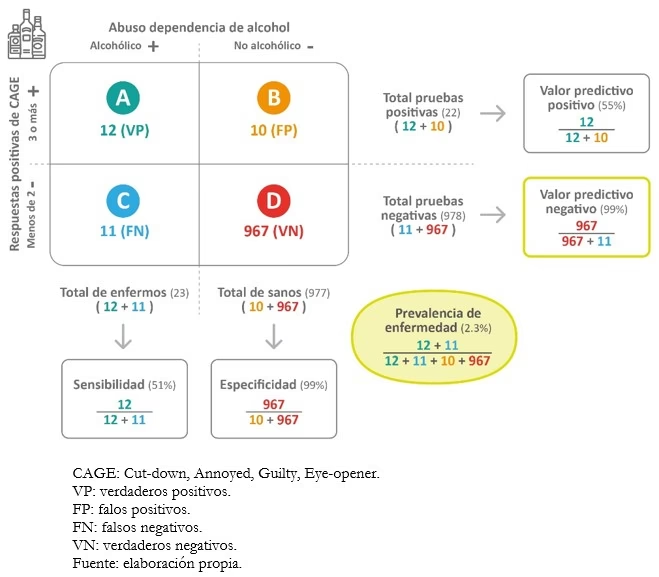

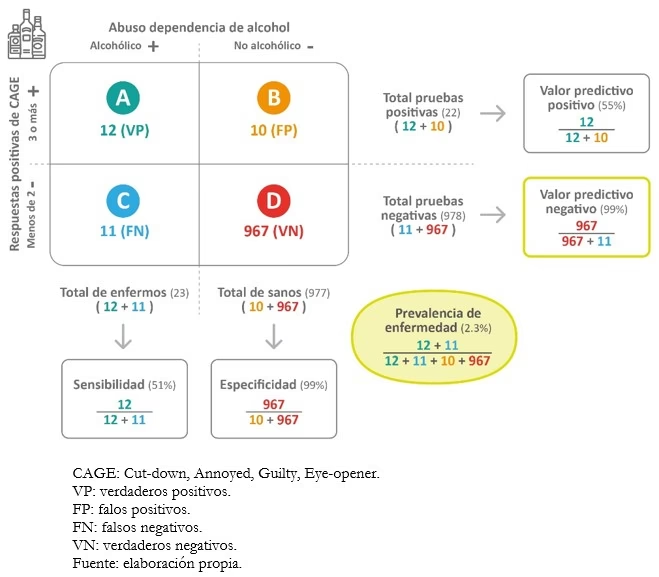

Antes de sumergirnos en los falsos positivos y negativos, es vital comprender los cuatro posibles resultados que pueden surgir de cualquier prueba o modelo de clasificación binaria (donde solo hay dos posibles resultados, como 'sí' o 'no', 'positivo' o 'negativo'):

- Verdadero Positivo (VP): La prueba o modelo predice correctamente un resultado positivo cuando la realidad es positiva. Por ejemplo, un test médico detecta una enfermedad que realmente está presente.

- Verdadero Negativo (VN): La prueba o modelo predice correctamente un resultado negativo cuando la realidad es negativa. Por ejemplo, un test médico indica que no hay una enfermedad, y de hecho no la hay. También se conoce como especificidad en ciertos contextos.

- Falso Positivo (FP): La prueba o modelo predice un resultado positivo cuando la realidad es negativa. Es un error de tipo I. Por ejemplo, un test médico indica una enfermedad que no existe.

- Falso Negativo (FN): La prueba o modelo predice un resultado negativo cuando la realidad es positiva. Es un error de tipo II. Por ejemplo, un test médico indica que no hay una enfermedad, pero en realidad sí está presente.

Estos cuatro resultados forman la base de la matriz de confusión, una herramienta fundamental para evaluar el rendimiento de un modelo o prueba. La suma de estos cuatro valores (VP + VN + FP + FN) representa el tamaño total de la población evaluada (N).

¿Cómo Calcular un Falso Positivo?

Un falso positivo ocurre cuando un sistema o prueba clasifica incorrectamente algo como positivo, cuando en realidad es negativo. Es como una falsa alarma. En el ámbito del aprendizaje automático, la tasa de falsos positivos (FPR, por sus siglas en inglés) es una métrica clave para evaluar la precisión de un modelo.

La Tasa de Falsos Positivos (FPR)

La Tasa de Falsos Positivos se calcula como la proporción de todos los casos negativos que fueron incorrectamente clasificados como positivos. En otras palabras, es la probabilidad de que se genere una alerta falsa.

La fórmula para la Tasa de Falsos Positivos es:

FPR = FP / (FP + VN)

Donde:

- FP es el número de Falsos Positivos (casos negativos clasificados incorrectamente como positivos).

- VN es el número de Verdaderos Negativos (casos negativos clasificados correctamente como negativos).

Es decir, la FPR es el número de falsos positivos dividido por el total de casos negativos reales (falsos positivos + verdaderos negativos). Una FPR baja indica que el modelo es bueno para no generar alertas innecesarias sobre lo que es normal.

Ejemplo de Falso Positivo: Detección de Fraude

Imaginemos un sistema de detección de fraude en un banco. Si el sistema identifica una transacción legítima de un cliente como fraudulenta, esto es un falso positivo. Si de 1000 transacciones legítimas (negativas reales), el sistema marca 5 como fraudulentas (falsos positivos), y las otras 995 las identifica correctamente como legítimas (verdaderos negativos), la FPR sería:

FPR = 5 / (5 + 995) = 5 / 1000 = 0.005 o 0.5%

Esto significa que el 0.5% de las transacciones legítimas son incorrectamente señaladas como fraude. Aunque parece pequeño, en un volumen masivo de transacciones, esto puede generar inconvenientes significativos para los clientes y costos operativos para el banco.

¿Cómo Calcular un Falso Negativo?

Un falso negativo ocurre cuando una prueba o sistema clasifica incorrectamente algo como negativo, cuando en realidad es positivo. Este error puede ser particularmente peligroso en ciertos contextos, como el diagnóstico médico, donde una enfermedad grave podría pasar desapercibida.

A diferencia de los falsos positivos, el texto proporcionado no ofrece una fórmula directa para calcular el número de falsos negativos (FN) per se, sino que lo define como el "Número de casos que la prueba declara negativos y que en realidad son positivos". Sin embargo, el concepto de FN es fundamental para calcular la Tasa de Verdaderos Positivos (TPR) o Sensibilidad.

La Tasa de Verdaderos Positivos (TPR) o Sensibilidad

La Sensibilidad, también conocida como Recall o Tasa de Verdaderos Positivos (TPR), es una medida de cuántos casos positivos en un conjunto de datos son correctamente clasificados como tales. Aunque no es una fórmula para FN directamente, FN es un componente crucial de ella.

La fórmula para la Tasa de Verdaderos Positivos es:

TPR = VP / (VP + FN)

Donde:

- VP es el número de Verdaderos Positivos (casos positivos clasificados correctamente como positivos).

- FN es el número de Falsos Negativos (casos positivos clasificados incorrectamente como negativos).

La Sensibilidad nos dice qué tan bien el modelo detecta los casos positivos. Un valor alto es deseable, especialmente cuando no queremos perder ningún caso positivo real. La cantidad de falsos negativos se obtiene simplemente contando cuántos casos positivos fueron erróneamente clasificados como negativos por la prueba.

Ejemplo de Falso Negativo: Diagnóstico Médico

Consideremos un test para detectar una enfermedad rara. Si una persona tiene la enfermedad (es un caso positivo real), pero el test arroja un resultado negativo, estamos ante un falso negativo. Si de 100 personas enfermas (positivos reales), el test detecta correctamente a 90 (verdaderos positivos) pero falla en detectar a 10 (falsos negativos), la Sensibilidad del test sería:

TPR = 90 / (90 + 10) = 90 / 100 = 0.9 o 90%

Esto significa que el test detecta el 90% de los casos de la enfermedad, dejando un 10% (los 10 falsos negativos) sin diagnosticar. En medicina, un falso negativo puede retrasar el tratamiento y tener consecuencias graves para la salud del paciente.

Falsos Positivos y Falsos Negativos en el Aprendizaje Automático

El campo del aprendizaje automático (Machine Learning, ML) se basa en la capacidad de los algoritmos para aprender de datos históricos y hacer predicciones sobre nuevos datos. La evaluación de la precisión de estos modelos es donde los conceptos de falsos positivos y negativos cobran una relevancia suprema.

Evaluación de la Precisión del Modelo

En ML, la "realidad del terreno" (ground truth) es el estado verdadero de las cosas, a menudo representado por etiquetas que clasifican los datos subyacentes. Comparando las salidas del modelo con esta realidad, se puede evaluar su precisión. Esto es común en métodos de aprendizaje supervisado, como la clasificación binaria.

Los modelos de clasificación, tras ser entrenados con datos históricos, predicen la clase más probable para nuevos datos. La comparación de la predicción con la etiqueta real (ground truth) nos permite determinar la exactitud del modelo y, por ende, identificar los VP, VN, FP y FN.

Reducción de Falsos Positivos en ML: El Caso del Fraude Bancario

Un área donde el ML demuestra su poder es en la detección de fraudes. Los sistemas tradicionales basados en reglas fijas a menudo generan una alta tasa de falsos positivos. Por ejemplo, una regla podría ser: "cualquier transacción superior a 1000 euros realizada en el extranjero es fraudulenta". Esto podría marcar viajes de negocios o vacaciones como fraude, llevando a la denegación de tarjetas legítimas y a una mala experiencia para el cliente.

El ML, al aprender patrones de gasto de los consumidores y considerar la naturaleza fluctuante del gasto (viajes, compras navideñas, etc.), puede distinguir entre comportamientos anómalos pero no fraudulentos y el fraude real. Esto reduce significativamente los falsos positivos, mejorando la experiencia del cliente y la eficiencia operativa de los bancos. Los algoritmos de ML construyen un modelo matemático que les permite hacer predicciones sin ser programados explícitamente para cada escenario, volviéndose más precisos a medida que procesan más datos.

Errores Tipo I y Tipo II en Estadística y Pruebas A/B

En estadística, particularmente en las pruebas de hipótesis y las pruebas A/B, los falsos positivos y negativos se conocen como Errores Tipo I y Tipo II, respectivamente. Estos errores son inherentes a la naturaleza probabilística de cualquier experimento y prueba de hipótesis.

Significancia Estadística

Cuando realizamos una prueba A/B, buscamos resultados estadísticamente significativos. Esto significa que la diferencia observada entre las variaciones (por ejemplo, una nueva versión de un sitio web frente a la original) es poco probable que haya ocurrido por pura casualidad y, en cambio, se atribuye a la causa que estamos probando. Un nivel de significancia común es p < 0.05, lo que implica que hay menos de un 5% de probabilidad de que los resultados observados sean aleatorios si la hipótesis nula fuera cierta.

Pruebas de Hipótesis: Nula vs. Alternativa

En una prueba de hipótesis, se compara una hipótesis nula (H0), que postula que no hay relación o diferencia entre las variables, con una hipótesis alternativa (H1), que postula lo contrario. El objetivo es determinar si hay suficiente evidencia para rechazar la hipótesis nula.

A pesar de la búsqueda de significancia, siempre existe un grado de incertidumbre, lo que da lugar a dos tipos de errores:

| Realidad | Decisión de la Prueba | Resultado |

|---|---|---|

| H0 es Verdadera | No se rechaza H0 | Decisión Correcta (Verdadero Negativo) |

| H0 es Verdadera | Se rechaza H0 | Error Tipo I (Falso Positivo) |

| H0 es Falsa | No se rechaza H0 | Error Tipo II (Falso Negativo) |

| H0 es Falsa | Se rechaza H0 | Decisión Correcta (Verdadero Positivo) |

Error Tipo I (Falso Positivo)

El Error Tipo I, o falso positivo en el contexto estadístico, ocurre cuando se rechaza incorrectamente una hipótesis nula que en realidad es verdadera. En una prueba A/B, esto significaría declarar que una variación (por ejemplo, un nuevo diseño de botón) es ganadora y produce una diferencia estadísticamente significativa, cuando en realidad la mejora observada fue solo por casualidad.

- Probabilidad: La probabilidad de cometer un Error Tipo I se denota con 'α' (alfa), que es el nivel de significancia que establecemos (por ejemplo, 0.05 para un 95% de confianza).

- Consecuencias: Implementar cambios basados en un falso positivo puede llevar a la pérdida de tiempo y recursos, o incluso a una disminución real en métricas importantes (como la tasa de conversión) al desplegar una característica que no funciona como se esperaba.

- Cómo Evitarlo: Aumentar la duración de la prueba y el tamaño de la muestra puede ayudar a asegurar que los resultados no sean producto del azar.

Error Tipo II (Falso Negativo)

El Error Tipo II, o falso negativo en el contexto estadístico, ocurre cuando no se rechaza una hipótesis nula que en realidad es falsa. Esto significa que no se detecta un efecto o diferencia real que sí existe. En una prueba A/B, implicaría no declarar un ganador cuando una variación sí tuvo un impacto positivo real.

- Probabilidad: La probabilidad de cometer un Error Tipo II se denota con 'β' (beta).

- Relación con el Poder Estadístico: El Error Tipo II está inversamente relacionado con el poder estadístico de una prueba. El poder estadístico es la probabilidad de que una prueba detecte un efecto que realmente existe (1 - β). Un mayor poder estadístico reduce la probabilidad de un Error Tipo II.

- Consecuencias: Los falsos negativos en A/B testing significan oportunidades perdidas para mejorar el producto o servicio. No implementar una variación que realmente funciona puede dejar de lado un potencial aumento en ventas o conversiones.

- Cómo Evitarlo: Aumentar el poder estadístico de la prueba, principalmente a través de un tamaño de muestra suficiente y una duración adecuada del experimento, asegura la recopilación de datos más precisos.

El Equilibrio entre Falsos Positivos y Falsos Negativos

Es crucial entender que existe una compensación entre los errores Tipo I y Tipo II. Reducir la probabilidad de un tipo de error a menudo aumenta la probabilidad del otro, asumiendo un tamaño de muestra fijo. La decisión de cuál error es más tolerable depende en gran medida del contexto y las consecuencias asociadas.

Por ejemplo, en medicina, un falso negativo para una enfermedad grave podría ser catastrófico (la enfermedad no se trata), mientras que un falso positivo (un diagnóstico erróneo) podría llevar a tratamientos innecesarios y estrés, pero rara vez la muerte. En cambio, en la detección de spam, un falso positivo (un correo legítimo marcado como spam) es molesto, pero un falso negativo (un spam que llega a la bandeja de entrada) es generalmente menos crítico.

En el ámbito empresarial, muchos argumentan que un Error Tipo I (gastar recursos en algo que no funciona) puede ser más dañino que un Error Tipo II (perder una oportunidad). Sin embargo, esto varía según la industria y los objetivos específicos. La clave es evaluar los costos y beneficios de cada tipo de error y ajustar los umbrales de decisión (como el nivel de significancia) en consecuencia.

Preguntas Frecuentes (FAQ)

¿Por qué son tan importantes los falsos positivos y negativos?

Son importantes porque impactan directamente en la confianza y utilidad de las pruebas y modelos. Un alto número de falsos positivos puede llevar a la fatiga de alertas o a la desconfianza en el sistema, mientras que un alto número de falsos negativos puede hacer que se pierdan oportunidades críticas o se ignoren riesgos importantes. Su correcta gestión es vital para tomar decisiones acertadas en diversos campos, desde la medicina hasta las finanzas.

¿Siempre se pueden evitar los falsos positivos y negativos?

No, es imposible eliminarlos por completo. Dado que cualquier prueba o modelo se basa en probabilidades y datos con cierta variabilidad, siempre existirá un margen de error. El objetivo no es eliminarlos, sino minimizarlos y gestionarlos de manera que las consecuencias negativas sean aceptables para el contexto específico. Esto se logra mediante el diseño cuidadoso de las pruebas, la recopilación de datos de alta calidad, la elección de modelos adecuados y la calibración de umbrales de decisión.

¿Cómo afectan las decisiones empresariales los falsos positivos y negativos?

Afectan profundamente. Un falso positivo puede llevar a la asignación de recursos a iniciativas ineficaces, el lanzamiento de productos fallidos o la interrupción de procesos legítimos, resultando en pérdidas financieras y de reputación. Un falso negativo, por otro lado, puede significar la pérdida de oportunidades de mercado, la incapacidad de detectar fraudes o amenazas, o la falta de identificación de mejoras cruciales en los productos, lo que impide el crecimiento y la eficiencia. La capacidad de entender y mitigar estos errores es una ventaja competitiva.

¿Cuál es la diferencia entre Sensibilidad y Especificidad en relación con estos errores?

La Sensibilidad (o Tasa de Verdaderos Positivos) mide la capacidad de una prueba para identificar correctamente los casos positivos reales (1 - Tasa de Falsos Negativos). Una alta sensibilidad significa menos falsos negativos. La Especificidad (o Tasa de Verdaderos Negativos) mide la capacidad de una prueba para identificar correctamente los casos negativos reales (1 - Tasa de Falsos Positivos). Una alta especificidad significa menos falsos positivos. Ambas métricas son esenciales para una evaluación completa del rendimiento de una prueba o modelo.

Conclusión

Los falsos positivos y falsos negativos son pilares fundamentales en la evaluación de la precisión y fiabilidad de cualquier sistema de clasificación o diagnóstico. Ya sea en la medicina, el aprendizaje automático o la estadística, su comprensión nos permite ir más allá de una simple métrica de "precisión general" y profundizar en los tipos de errores que realmente importan.

Reconocer que estos errores son inevitables, pero que pueden ser gestionados y minimizados, es el primer paso hacia una toma de decisiones más robusta. Al calibrar cuidadosamente nuestros modelos y pruebas, considerando el impacto de cada tipo de error en un contexto dado, podemos construir sistemas más confiables y eficientes, optimizando resultados y mitigando riesgos. En última instancia, una comprensión profunda de los falsos positivos y negativos nos empodera para navegar el mundo de los datos con mayor sabiduría y efectividad.

Si quieres conocer otros artículos parecidos a Falsos Positivos y Negativos: Un Análisis Profundo puedes visitar la categoría Estadística.