06/03/2025

En el vasto universo de la programación y la informática, no basta con escribir código que funcione; es crucial que este código funcione de manera eficiente. Aquí es donde entra en juego el concepto de complejidad temporal de un algoritmo, una métrica fundamental que nos permite predecir y comparar el rendimiento de diferentes soluciones a un mismo problema. Comprender cómo se calcula esta complejidad es una habilidad esencial para cualquier desarrollador que aspire a crear software robusto y escalable.

La complejidad temporal mide cuánto tiempo le toma a un algoritmo ejecutarse en función del tamaño de su entrada. No se trata de medir segundos o milisegundos, ya que esto dependería de factores externos como la velocidad del procesador o el lenguaje de programación. En cambio, busca cuantificar el número de operaciones elementales que un algoritmo realiza, lo que nos da una idea abstracta y generalizable de su comportamiento a medida que el tamaño de los datos de entrada crece.

- La Importancia de la Complejidad Temporal

- ¿Qué es la Notación Big O?

- Métodos para Calcular la Complejidad Temporal

- Tabla Comparativa de Complejidades Temporales Comunes

- La Complejidad Temporal en Máquinas de Turing

- Preguntas Frecuentes (FAQ)

- ¿La complejidad temporal mide el tiempo real en segundos?

- ¿Por qué ignoramos las constantes y los términos de menor orden en la Notación Big O?

- ¿Cuál es la complejidad temporal ideal para un algoritmo?

- ¿La complejidad temporal siempre se calcula en el peor caso?

- ¿La complejidad temporal es lo mismo que la complejidad espacial?

- Conclusión

La Importancia de la Complejidad Temporal

La eficiencia de un algoritmo es un pilar central en la ingeniería de software. Un algoritmo ineficiente puede convertir una tarea trivial en un cuello de botella insostenible a medida que el volumen de datos aumenta. Imagina una aplicación de comercio electrónico que tarda horas en procesar una lista de productos a medida que su inventario crece, o un motor de búsqueda que se ralentiza drásticamente con cada nueva página indexada. En ambos casos, la experiencia del usuario se ve comprometida y la viabilidad del sistema se pone en duda.

Analizar la complejidad temporal nos permite:

- Predecir el rendimiento: Anticipar cómo se comportará un algoritmo con entradas muy grandes sin necesidad de ejecutarlo.

- Comparar algoritmos: Elegir la solución más eficiente entre varias opciones para un mismo problema.

- Optimizar el código: Identificar las partes más lentas de un programa para enfocarse en su mejora.

- Garantizar la escalabilidad: Asegurar que un sistema pueda manejar un aumento en la carga de trabajo de manera sostenible.

En esencia, la complejidad temporal nos da una herramienta para razonar sobre la escalabilidad y la eficiencia de nuestro software, permitiéndonos construir sistemas que no solo funcionen, sino que lo hagan bien, incluso bajo presión.

¿Qué es la Notación Big O?

Para expresar la complejidad temporal de manera estandarizada y universal, utilizamos la Notación Big O (también conocida como Notación O Grande). Esta notación describe el comportamiento del tiempo de ejecución de un algoritmo en el peor caso, a medida que el tamaño de la entrada tiende al infinito. Se enfoca en la tasa de crecimiento de la función de tiempo, ignorando constantes y términos de menor orden, ya que estos se vuelven insignificantes para entradas muy grandes.

Algunos puntos clave sobre la Notación Big O:

- Es un marco para analizar y comparar algoritmos.

- Se centra en la cantidad de trabajo que la CPU debe realizar a medida que el tamaño de la entrada crece.

- Se eliminan las constantes y los términos de orden inferior. Por ejemplo, O(3n² + 10n + 10) se convierte en O(n²).

- Siempre considera el peor caso. Por ejemplo, al ordenar elementos en un array, el peor caso para algunos algoritmos de ordenación es cuando los elementos están en orden inverso.

Visualmente, cuanto menor sea la función de complejidad temporal en un gráfico, mejor será el rendimiento del algoritmo. Por ejemplo, un algoritmo O(log n) es significativamente más eficiente que uno O(n²) para entradas grandes.

Métodos para Calcular la Complejidad Temporal

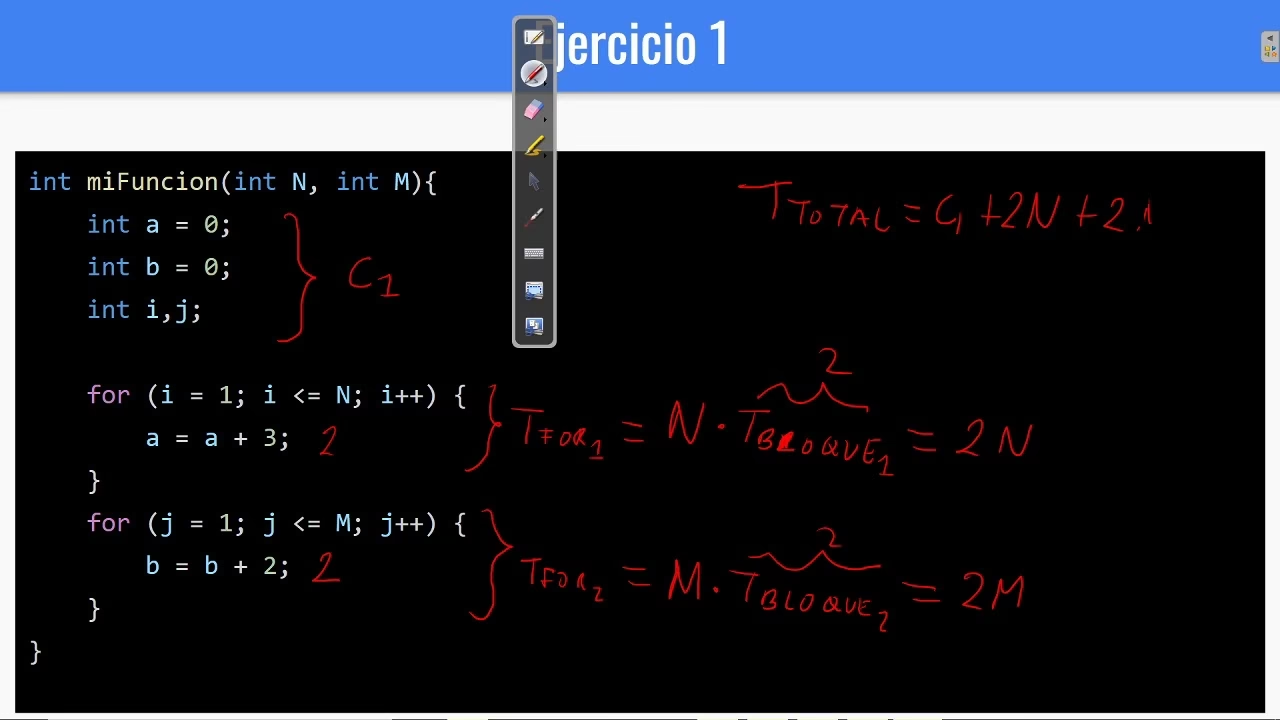

Determinar la complejidad temporal de un algoritmo implica analizar sus sentencias línea por línea, prestando especial atención a cómo se agrupan y se repiten. Aquí desglosamos cómo abordar los escenarios más comunes:

Sentencias Secuenciales

Las operaciones básicas como asignaciones, comparaciones, operaciones aritméticas o lectura de variables se consideran de tiempo constante, denotado como O(1). Esto significa que el tiempo que tardan en ejecutarse no depende del tamaño de la entrada.

sentencia1; // O(1) sentencia2; // O(1) ... sentenciaN; // O(1)Si tenemos un conjunto de sentencias secuenciales, el tiempo total será la suma de los tiempos individuales. Dado que cada una es O(1), la suma de cualquier número fijo de operaciones constantes sigue siendo O(1).

Ejemplo:

function calcularSumaCuadrados(a, b, c) { const sa = a * a; // O(1) const sb = b * b; // O(1) const sc = c * c; // O(1) const suma = sa + sb + sc; // O(1) return suma; // O(1) }En este caso, la función siempre realizará el mismo número de operaciones, independientemente de los valores de a, b y c. Por lo tanto, su complejidad temporal es O(1).

Sentencias Condicionales

Cuando el código incluye sentencias condicionales (if-else), debemos considerar el peor caso. Esto significa que tomaremos la rama del condicional que tenga la mayor complejidad temporal.

if (condicion) { // Bloque 1 } else { // Bloque 2 }La complejidad total será el máximo entre la complejidad del Bloque 1 y la complejidad del Bloque 2.

Ejemplo:

if (esValido) { array.sort(); // O(n log n) return true; // O(1) } else { return false; // O(1) }Si la condición esValido es verdadera, se ejecuta una operación de ordenación que comúnmente tiene una complejidad de O(n log n) (para algoritmos eficientes). Si es falsa, la operación es O(1). El peor caso es la rama que ejecuta la ordenación, por lo tanto, la complejidad es O(n log n).

Sentencias de Bucle (Iterativas)

Los bucles (for, while) son una fuente común de complejidad. Para calcularla, se determina la complejidad del bloque de código dentro del bucle y se multiplica por el número de veces que se ejecuta el bucle.

Bucles de Tiempo Constante

Si un bucle se ejecuta un número fijo de veces, independientemente del tamaño de la entrada, su complejidad es O(1).

for (let i = 0; i < 100; i++) { // Operaciones O(1) }Aunque se repita 100 veces, este número es una constante. Por lo tanto, la complejidad es O(1).

Bucles de Tiempo Lineal

Si el número de iteraciones de un bucle es directamente proporcional al tamaño de la entrada (n), su complejidad es O(n).

for (let i = 0; i < array.length; i++) { // n = array.length // Operaciones O(1) }Este bucle se ejecuta n veces, por lo que la complejidad es O(n). Incluso si se recorre solo la mitad del array, sigue siendo O(n) porque las constantes se eliminan (1/2 * n es O(n)).

Bucles de Tiempo Logarítmico

Un bucle tiene complejidad O(log n) si en cada iteración el tamaño del problema se reduce por un factor constante (típicamente a la mitad).

Ejemplo: Búsqueda Binaria

function busquedaBinaria(array, target) { let low = 0; let high = array.length - 1; while (low <= high) { let mid = Math.floor((low + high) / 2); if (target < array[mid]) { high = mid - 1; } else if (target > array[mid]) { low = mid + 1; } else { return mid; } } return -1; }En cada iteración, el rango de búsqueda se reduce a la mitad. Si el tamaño del array es n, el número de iteraciones es log₂ n. Por ejemplo, para un array de 8 elementos, se necesitan log₂ 8 = 3 iteraciones en el peor caso. Esto resulta en una complejidad de O(log n), considerada altamente eficiente.

Bucles Anidados

Cuando hay bucles dentro de otros bucles, la complejidad se calcula multiplicando el número de iteraciones de cada bucle.

for (let i = 0; i < n; i++) { for (let j = 0; j < m; j++) { // Operaciones O(1) } }Si el bucle externo se ejecuta n veces y el interno m veces, la complejidad es O(n * m). Si ambos bucles dependen del mismo tamaño de entrada n, la complejidad sería O(n²).

Llamadas a Funciones

Al calcular la complejidad de un programa que invoca a otras funciones, es esencial conocer la complejidad temporal de esas funciones. Si la función es propia, se inspecciona su implementación. Si es de una librería, se consulta su documentación.

for (let i = 0; i < n; i++) { funcionA(); // Costo t(funcionA) for (let j = 0; j < n; j++) { funcionB(); // Costo t(funcionB) } }La complejidad total sería n * (t(funcionA) + n * t(funcionB)). Si funcionA y funcionB son O(1), la complejidad del fragmento es O(n²). Si funcionB fuera O(n), entonces la complejidad total sería O(n³).

Funciones Recursivas

Analizar la complejidad de funciones recursivas puede ser más complejo y a menudo implica el uso de árboles de recursión o el teorema maestro. Un enfoque intuitivo es visualizar el árbol de llamadas.

Ejemplo: Número de Fibonacci

function fibonacci(n) { if (n < 0) return 0; if (n < 2) return n; return fibonacci(n - 1) + fibonacci(n - 2); }Para fibonacci(4), se generan las siguientes llamadas:

fibonacci(4)llama afibonacci(3)yfibonacci(2)fibonacci(3)llama afibonacci(2)yfibonacci(1)fibonacci(2)llama afibonacci(1)yfibonacci(0)

Esto forma un árbol binario. Aunque no es un árbol completo, el número de llamadas crece exponencialmente con n. La altura del árbol es n, y en el peor caso, el número de nodos puede acercarse a 2ⁿ. Por lo tanto, la complejidad temporal de esta implementación es O(2ⁿ), lo que la hace muy ineficiente para valores grandes de n.

Tabla Comparativa de Complejidades Temporales Comunes

A continuación, presentamos una tabla que resume las complejidades temporales más comunes, ordenadas de la más eficiente a la menos eficiente, junto con una breve descripción y ejemplos.

| Notación Big O | Nombre | Descripción | Ejemplos Comunes |

|---|---|---|---|

| O(1) | Tiempo Constante | El tiempo de ejecución es independiente del tamaño de la entrada. | Acceder a un elemento en un array por índice, operaciones aritméticas básicas. |

| O(log n) | Tiempo Logarítmico | El tiempo de ejecución disminuye a medida que la entrada se divide repetidamente. | Búsqueda binaria, operaciones en árboles binarios balanceados. |

| O((log n)k) | Tiempo Poli-logarítmico | El tiempo de ejecución es proporcional a una potencia del logaritmo del tamaño de la entrada. | Ciertas operaciones en algoritmos paralelos. |

| O(n) | Tiempo Lineal | El tiempo de ejecución crece directamente proporcional al tamaño de la entrada. | Recorrer un array, encontrar el máximo/mínimo en un array no ordenado. |

| O(n log n) | Tiempo Cuasilineal | El tiempo de ejecución crece un poco más rápido que lineal, pero mucho más lento que cuadrático. | Algoritmos de ordenación eficientes (Merge Sort, Quick Sort, Heap Sort). |

| O(nk) | Tiempo Polinomial | El tiempo de ejecución crece como una potencia del tamaño de la entrada (k es una constante). | Bucles anidados (O(n²), O(n³)), Bubble Sort, Insertion Sort, multiplicación de matrices (O(n³)). |

| O(cn) | Tiempo Exponencial | El tiempo de ejecución se duplica con cada adición a la entrada (c > 1). | Problemas NP-completos (Ej. Problema del viajante, subconjunto suma) con soluciones de fuerza bruta, recursión ineficiente (Ej. Fibonacci sin memoización). |

| O(n!) | Tiempo Factorial | El tiempo de ejecución crece extremadamente rápido, proporcional al factorial del tamaño de la entrada. | Algoritmos de fuerza bruta para problemas de permutaciones (Ej. Bogosort). |

| O(2cn) | Doble Tiempo Exponencial | El tiempo de ejecución crece como una potencia de una potencia. | Algunos problemas de decisión complejos en lógica o teoría de conjuntos. |

Es importante destacar que las complejidades como O(n²), O(n³), etc., se engloban dentro de la categoría de tiempo polinomial. Los algoritmos de tiempo polinomial se consideran generalmente tratables o "eficientes" en contraste con los algoritmos de tiempo superpolinomial, exponencial o factorial, que son intratables para entradas grandes.

Otras Complejidades Relevantes:

- Tiempo Sub-lineal (o(n)): Un algoritmo se ejecuta en tiempo sub-lineal si T(n) = o(n). Esto significa que el tiempo de ejecución crece más lento que linealmente. Ejemplos incluyen búsqueda binaria (O(log n)) o algoritmos que no necesitan leer toda la entrada, a menudo usando paralelismo o aleatorización.

- Tiempo Superpolinomial (ω(nc)): Un algoritmo toma tiempo superpolinomial si T(n) no está limitado por ningún polinomio. Crece más rápido que cualquier función polinomial. Incluye tiempos exponenciales y factoriales.

- Tiempo Cuasi-polinomial: Un crecimiento que es más rápido que polinomial pero más lento que exponencial. T(n) = 2(log n)O(1).

- Tiempo Sub-exponencial (2o(n)): Se refiere a algoritmos cuyo tiempo de ejecución crece más rápido que cualquier polinomio pero significativamente más lento que un exponencial completo (2n). Existen dos definiciones comunes, pero en general, se aplica a problemas que son más manejables que aquellos con solo algoritmos exponenciales, como algunos algoritmos de factorización de enteros.

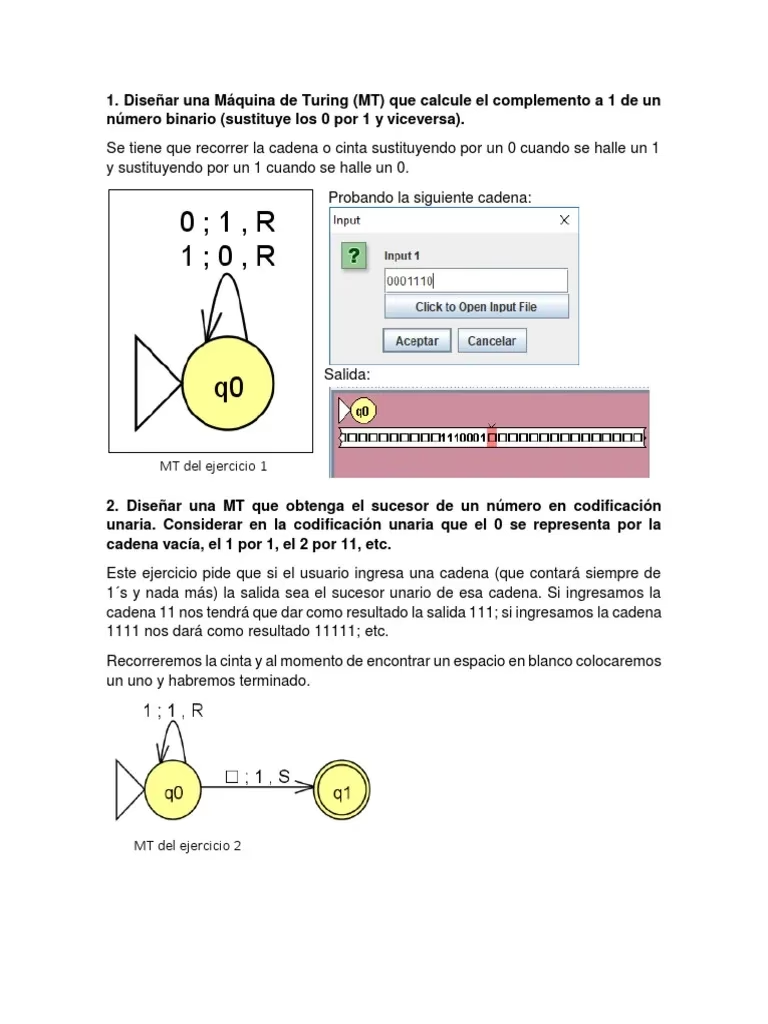

La Complejidad Temporal en Máquinas de Turing

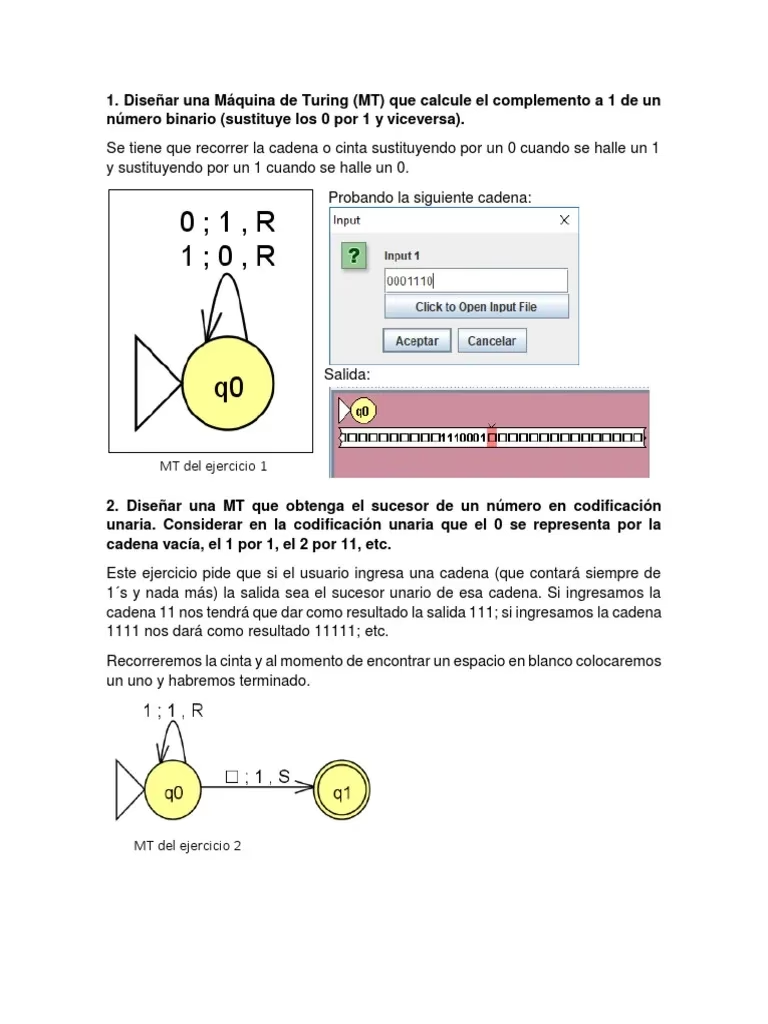

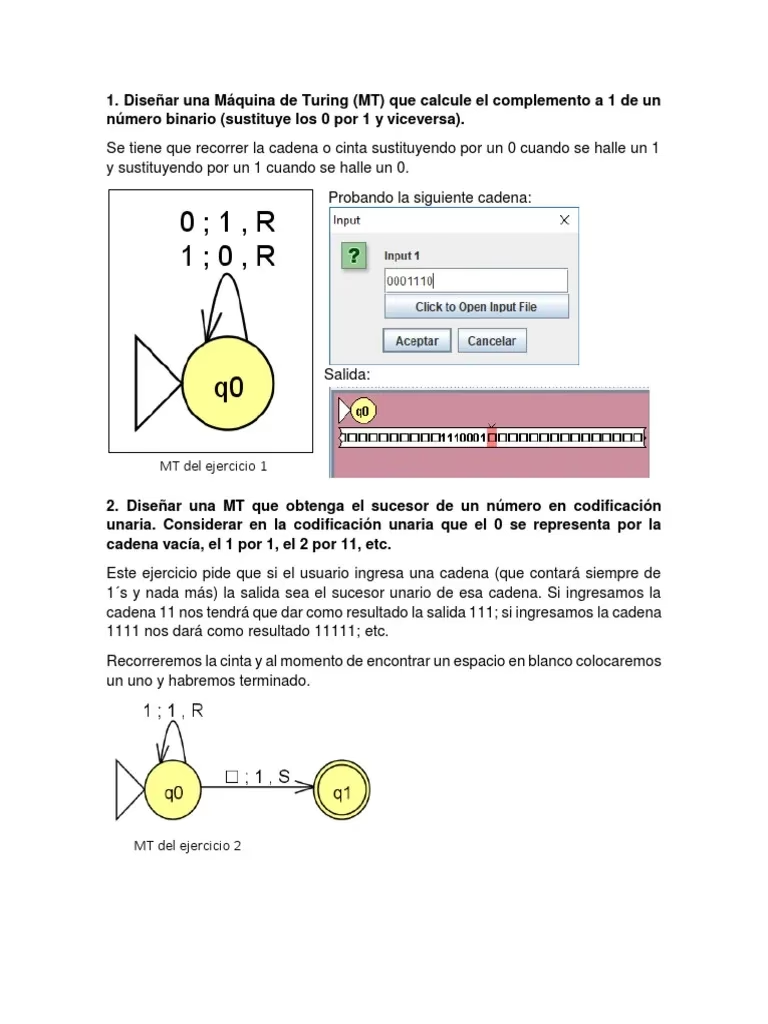

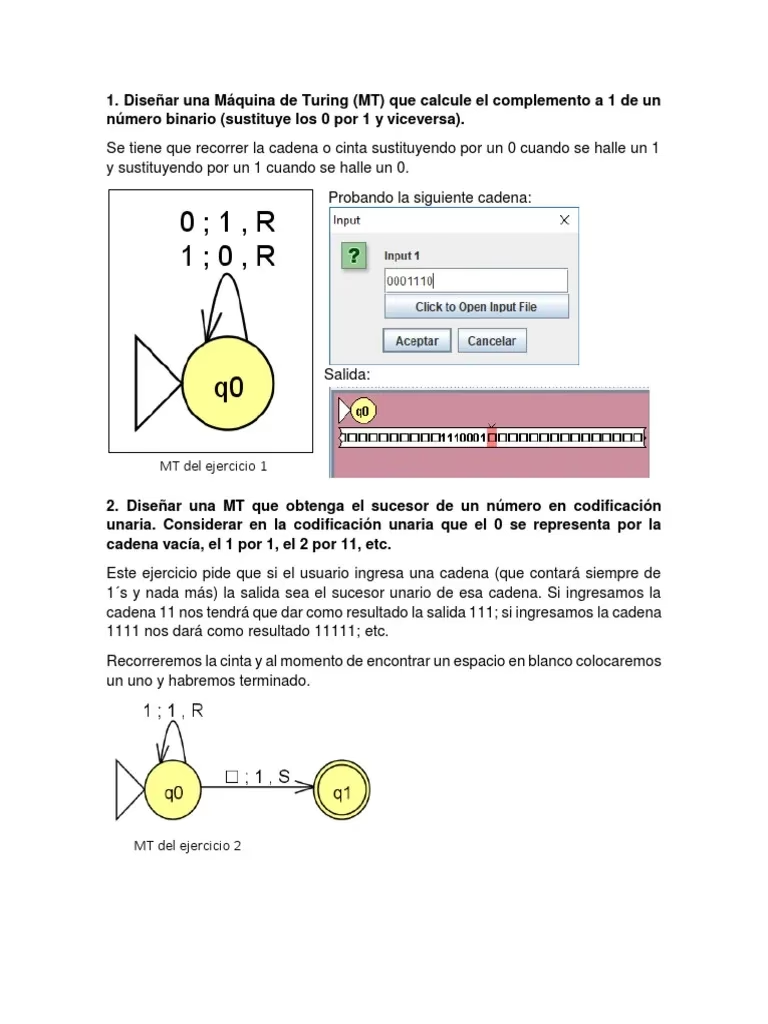

El concepto de complejidad temporal no se limita a los lenguajes de programación modernos, sino que tiene sus raíces en la teoría de la computación, particularmente con las Máquinas de Turing. Las Máquinas de Turing son un modelo teórico de computación que permite analizar la capacidad y eficiencia de los algoritmos de forma abstracta.

¿Cómo se Calcula la Complejidad Temporal de una Máquina de Turing?

Para una Máquina de Turing determinista M, la complejidad temporal, denotada como tM(n), es el número máximo de pasos que M realiza en cualquier palabra de entrada de longitud n. Si M se detiene en todas las entradas de longitud n después de un número de pasos menor o igual a tM(n), decimos que M se ejecuta en tiempo tM(n).

El cálculo implica contar el número de transiciones de estado, movimientos de cabeza y operaciones de escritura en la cinta que la máquina realiza desde el estado inicial hasta un estado de aceptación o rechazo. Al igual que con los algoritmos en lenguajes de alto nivel, nos interesa la función tM(n) que describe el comportamiento en el peor caso a medida que n (la longitud de la entrada) crece.

La Máquina Universal de Turing y su Complejidad

Una Máquina Universal de Turing (MUT) es una máquina de Turing que puede simular cualquier otra Máquina de Turing arbitraria. Para ello, la MUT toma como entrada la descripción de la máquina a simular (M) y la entrada para esa máquina (w). La eficiencia con la que una MUT puede simular a otras máquinas es un tema crucial en la teoría de la complejidad.

Un resultado fundamental es que una MUT puede simular una Máquina de Turing de k-cintas que se ejecuta en tiempo T(n) con una sobrecarga de tiempo de O(T(n) log T(n)) en una única cinta. Esta sobrecarga logarítmica es un factor clave y a menudo es fuente de confusión.

La pregunta de por qué el tiempo de simulación es O(T(n) log T(n)) y no O(n T(n) log T(n)), y por qué se asume que un paso de la máquina simulada se ejecuta en tiempo constante por la MUT, es pertinente. Aquí la aclaración:

- La sobrecarga O(log T(n)) por paso simulado: Este factor logarítmico no proviene de la longitud de la descripción de la máquina simulada (M) en sí, sino de la necesidad de la MUT de gestionar eficientemente la cinta simulada y el estado de la máquina M. Si la máquina M utiliza varias cintas, la MUT debe simular estas múltiples cintas en su única cinta (o en un número fijo de cintas). Esto a menudo implica codificar las múltiples cintas como pistas en una única cinta y mover las cabezas simuladas. Estas operaciones de gestión y acceso a la configuración de la máquina simulada (que puede crecer hasta un tamaño proporcional a T(n) en el peor caso) pueden tomar tiempo logarítmico en relación con el espacio o tiempo utilizado por la máquina simulada. Por ejemplo, si la MUT necesita mover su cabeza a una posición específica en la cinta simulada que representa el estado de M, y el número de celdas activas en la cinta simulada es proporcional a T(n), entonces encontrar y actualizar esa posición podría tomar un tiempo logarítmico.

- El "tiempo constante" para un paso de la máquina simulada: La asunción de que la MUT ejecuta un paso de la máquina simulada en un tiempo constante se refiere al tiempo que le toma a la MUT *interpretar la tabla de transiciones* de la máquina M. La descripción de una máquina M (su conjunto de estados, símbolos y reglas de transición) es de tamaño fijo para esa M en particular. Por lo tanto, el tiempo que la MUT invierte en buscar la regla de transición correcta en la descripción de M (que está en su propia cinta) es un valor constante que depende de la complejidad de M, no del tamaño de la entrada 'n' de M. Es decir, para una máquina M dada, el tiempo de búsqueda de la regla es independiente de 'n'.

En el contexto del Teorema de Jerarquía Temporal, donde la entrada a la MUT *es* la descripción de una máquina (es decir, n es la longitud de la descripción de M), la complejidad sigue siendo dominada por la sobrecarga O(T(n) log T(n)). El factor 'n' que el usuario menciona, si se refiriera a la longitud de la descripción de la máquina simulada por cada paso, no se aplica de esa manera, ya que la búsqueda de la regla de transición es eficiente y el factor logarítmico surge de la gestión de la cinta y el estado, no de la lectura repetida de la descripción completa de M por cada paso simulado.

Preguntas Frecuentes (FAQ)

Aquí respondemos algunas de las preguntas más comunes sobre la complejidad temporal de los algoritmos:

¿La complejidad temporal mide el tiempo real en segundos?

No, la complejidad temporal no mide el tiempo real en segundos. Mide el número de operaciones elementales que un algoritmo realiza en función del tamaño de la entrada. El tiempo real dependerá de factores como la velocidad del procesador, el lenguaje de programación, el compilador y otras tareas en el sistema.

¿Por qué ignoramos las constantes y los términos de menor orden en la Notación Big O?

Ignoramos las constantes y los términos de menor orden porque la Notación Big O se enfoca en el comportamiento asintótico del algoritmo, es decir, cómo se escala el tiempo de ejecución a medida que el tamaño de la entrada tiende al infinito. Para entradas muy grandes, el término de mayor orden dominará completamente el tiempo de ejecución, haciendo que las constantes y los términos de menor orden sean insignificantes.

¿Cuál es la complejidad temporal ideal para un algoritmo?

La complejidad temporal ideal es O(1) (tiempo constante), lo que significa que el algoritmo siempre tarda el mismo tiempo, independientemente del tamaño de la entrada. Sin embargo, esto no siempre es posible. En general, se busca la menor complejidad posible para el problema en cuestión. Los algoritmos de tiempo polinomial (O(nk)) se consideran eficientes para la mayoría de los propósitos prácticos, mientras que los algoritmos exponenciales o factoriales son generalmente intratables para entradas grandes.

¿La complejidad temporal siempre se calcula en el peor caso?

La Notación Big O, por definición, describe el peor caso de la complejidad temporal. También existen otras notaciones, como Big Omega (Ω) para el mejor caso y Big Theta (Θ) para el caso promedio, cuando el peor y el mejor caso son asintóticamente iguales. Sin embargo, Big O es la más comúnmente utilizada porque nos proporciona una garantía sobre el límite superior del tiempo de ejecución.

¿La complejidad temporal es lo mismo que la complejidad espacial?

No, son conceptos relacionados pero distintos. La complejidad temporal mide el tiempo que tarda un algoritmo en ejecutarse, mientras que la complejidad espacial mide la cantidad de memoria que el algoritmo utiliza en función del tamaño de la entrada. Ambos son importantes para evaluar la eficiencia de un algoritmo.

Conclusión

El análisis de la complejidad temporal es una herramienta indispensable en el arsenal de cualquier profesional de la computación. Al entender cómo los algoritmos escalan con el tamaño de los datos, podemos tomar decisiones informadas sobre el diseño y la implementación de sistemas. La Notación Big O nos proporciona un lenguaje universal para comunicar y comparar la eficiencia, permitiéndonos construir soluciones más robustas, rápidas y, en última instancia, más útiles en un mundo cada vez más impulsado por los datos. Dominar este concepto no solo mejora la calidad de nuestro código, sino que también eleva nuestra capacidad para resolver problemas complejos de manera elegante y efectiva.

Si quieres conocer otros artículos parecidos a Entendiendo la Complejidad Temporal de Algoritmos puedes visitar la categoría Cálculos.