10/08/2024

En la era digital en la que vivimos, las palabras que escribimos, los mensajes que enviamos y los textos que leemos en nuestras pantallas parecen estar compuestos por letras, tal como las conocemos. Sin embargo, detrás de esa aparente simplicidad, existe un proceso complejo y fascinante que transforma cada carácter en una secuencia de ceros y unos. Este es el mundo del código binario, el lenguaje fundamental que las computadoras realmente entienden. Comprender cómo las letras se convierten en números binarios no solo desvela uno de los secretos más importantes de la computación, sino que también nos permite apreciar la ingeniosidad detrás de toda la tecnología que nos rodea. ¿Alguna vez te has preguntado qué significan esas largas cadenas de 0s y 1s o cómo tu nombre se traduce al lenguaje de las máquinas? Este artículo te guiará paso a paso por este proceso, desentrañando el misterio de la codificación de caracteres.

Desde el momento en que pulsas una tecla en tu teclado, se desencadena una serie de eventos que culminan en la representación digital de esa letra. Las computadoras, al ser dispositivos electrónicos, solo pueden interpretar dos estados: encendido o apagado, que se representan como 1 y 0 respectivamente. Esta dualidad es la base del sistema binario. Para que una computadora pueda procesar y almacenar texto, cada letra, número o símbolo debe tener una representación numérica única en este sistema binario. Es aquí donde entran en juego los estándares de codificación, actuando como puentes entre nuestro lenguaje humano y el lenguaje de las máquinas.

- ¿Qué es el Código Binario y Por Qué es Crucial?

- El Puente entre Letras y Números: ASCII y Unicode

- Paso a Paso: Cómo Convertir una Letra a Binario

- Descifrando Mensajes: Cómo Convertir Binario a Letras

- Tabla Comparativa: ASCII vs. Unicode (UTF-8)

- Aplicaciones Prácticas de la Codificación Binaria

- Herramientas y Recursos para la Conversión

- Preguntas Frecuentes (FAQs)

- Conclusión

¿Qué es el Código Binario y Por Qué es Crucial?

El código binario es un sistema de numeración que utiliza solo dos dígitos: 0 y 1. Cada uno de estos dígitos se conoce como un bit (abreviatura de binary digit). En el mundo de las computadoras, un bit representa el estado más básico de información, como un interruptor encendido (1) o apagado (0). Aunque parece increíblemente simple, la combinación de millones de estos bits permite a las computadoras realizar operaciones complejas, almacenar datos y ejecutar programas.

La razón por la que las computadoras utilizan el sistema binario es puramente física y electrónica. Los componentes electrónicos, como los transistores, funcionan como interruptores. Pueden estar en un estado de alto voltaje (representando un 1) o bajo voltaje (representando un 0). Sería extremadamente difícil y propenso a errores construir circuitos que distinguieran entre diez niveles de voltaje diferentes para representar los dígitos del 0 al 9 del sistema decimal. Por lo tanto, el sistema binario es la opción más robusta y eficiente para la lógica interna de un procesador.

Un conjunto de ocho bits se denomina un byte. Un byte es la unidad básica de almacenamiento de información en la mayoría de los sistemas informáticos y es capaz de representar 2^8 (256) valores diferentes, lo que es suficiente para codificar un carácter alfanumérico o un símbolo común. Cuando hablamos de megabytes, gigabytes o terabytes, nos referimos a múltiplos de esta unidad fundamental.

El Puente entre Letras y Números: ASCII y Unicode

Para que las computadoras puedan intercambiar información de texto de manera coherente, fue necesario establecer estándares sobre cómo se mapean las letras y otros caracteres a sus representaciones numéricas. Aquí es donde los sistemas de codificación de caracteres juegan un papel fundamental.

ASCII: El Pionero de la Codificación

El estándar más antiguo y fundamental es ASCII (American Standard Code for Information Interchange). Desarrollado en la década de 1960, ASCII asigna un número único a cada letra mayúscula y minúscula del alfabeto inglés, a los números del 0 al 9, a los signos de puntuación y a algunos caracteres de control. ASCII utiliza 7 bits para representar cada carácter, lo que le permite codificar 2^7 = 128 caracteres diferentes. Por ejemplo, la letra 'A' se representa con el número decimal 65, que en binario es 01000001. La letra 'a' es 97 en decimal, o 01100001 en binario.

Aunque ASCII fue revolucionario y sentó las bases de la comunicación digital de texto, rápidamente se hizo evidente su limitación: solo podía representar caracteres del inglés. ¿Qué pasaba con los caracteres acentuados, las ñ, los alfabetos cirílicos, griegos, asiáticos, o los emojis? Claramente, se necesitaba una solución más amplia.

Unicode: La Solución Universal

Para abordar las limitaciones de ASCII y permitir la representación de caracteres de todos los idiomas del mundo, se desarrolló Unicode. Unicode es un estándar de codificación de caracteres que busca abarcar todos los sistemas de escritura existentes. A diferencia de ASCII, que es un conjunto de caracteres fijo y pequeño, Unicode es un conjunto de caracteres mucho más grande que puede contener más de un millón de caracteres diferentes, cada uno con un 'punto de código' único (un número). Es un esfuerzo continuo para estandarizar la codificación de texto a nivel mundial.

Unicode por sí solo es solo un mapa de números a caracteres. Para almacenar o transmitir esos números, se necesitan 'esquemas de codificación'. El más popular y ampliamente utilizado hoy en día es UTF-8 (Unicode Transformation Format - 8-bit). UTF-8 es una codificación de longitud variable: los caracteres más comunes (como los del alfabeto latino básico, que coinciden con los de ASCII) se codifican en un solo byte, mientras que otros caracteres (como los cirílicos, chinos, o emojis) pueden requerir dos, tres o incluso cuatro bytes. Esta flexibilidad hace que UTF-8 sea extremadamente eficiente para el texto web y compatible con versiones anteriores de ASCII.

Paso a Paso: Cómo Convertir una Letra a Binario

El proceso de convertir una letra en su equivalente binario es bastante directo una vez que se entiende la lógica subyacente de los sistemas de codificación como ASCII o Unicode. Aquí te explicamos los pasos:

Identifica el Código Decimal (ASCII o Unicode):

El primer paso es encontrar el valor decimal asociado a la letra o carácter que deseas convertir. Para caracteres comunes del alfabeto inglés, generalmente se utiliza la tabla ASCII. Para caracteres especiales o de otros idiomas, se consulta la tabla Unicode (específicamente, el punto de código Unicode).

- Por ejemplo, si queremos convertir la letra 'h', buscamos su valor en la tabla ASCII. La 'h' minúscula tiene un valor decimal de 104.

- Si queremos convertir la letra 'L', su valor ASCII decimal es 76.

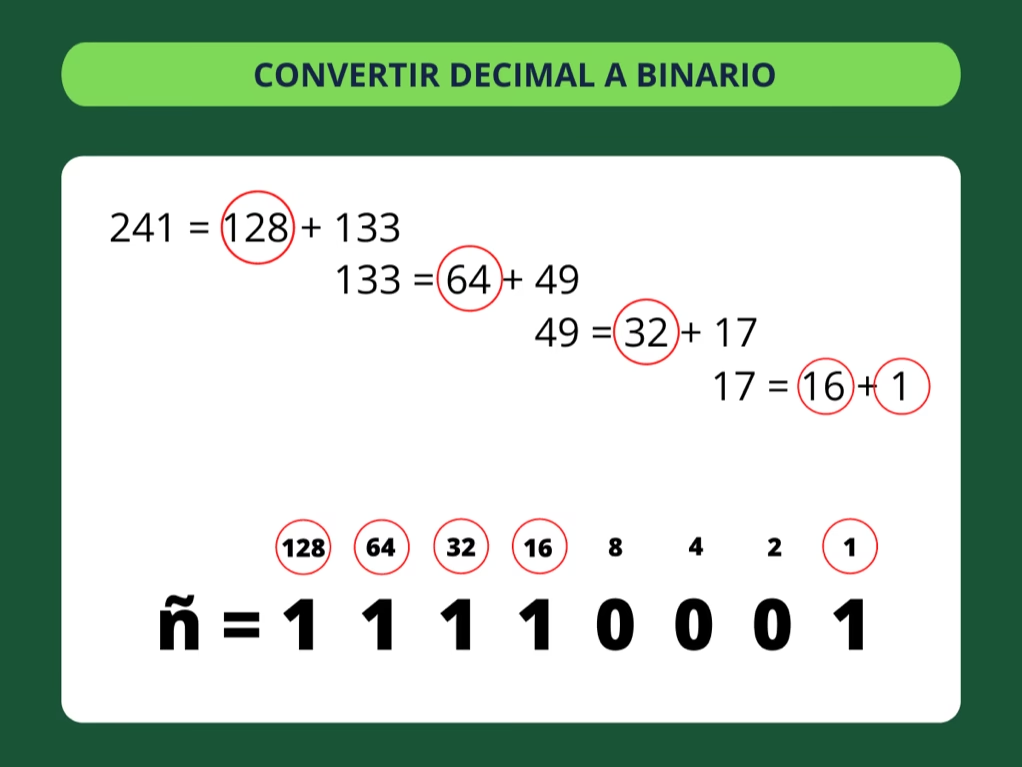

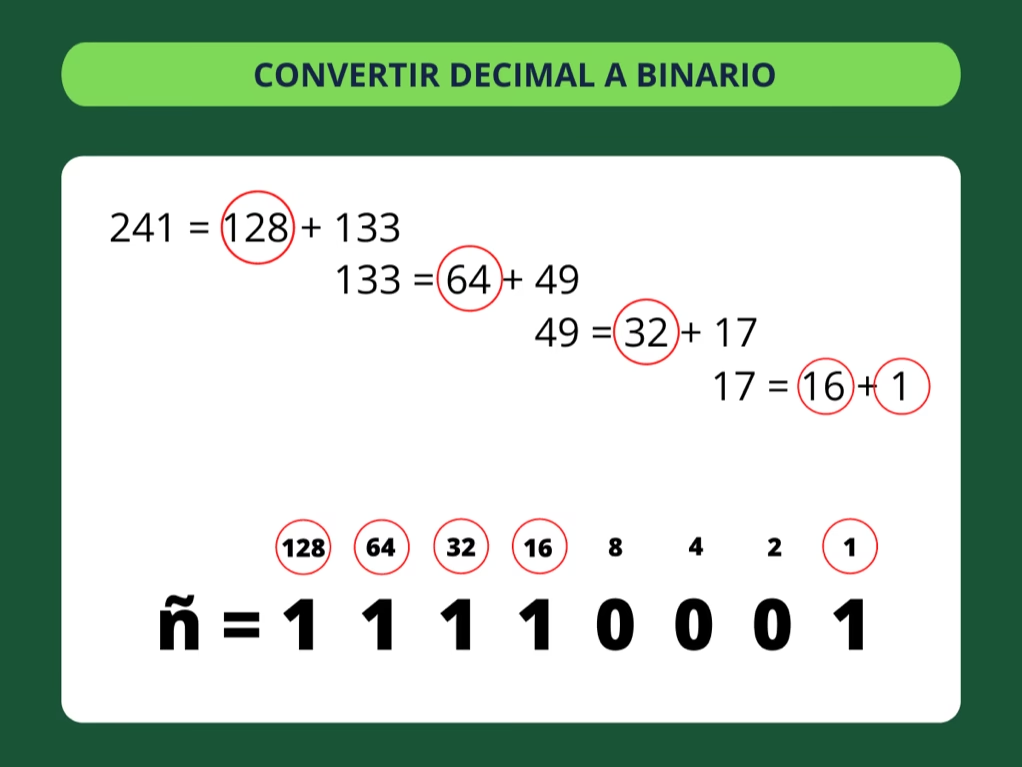

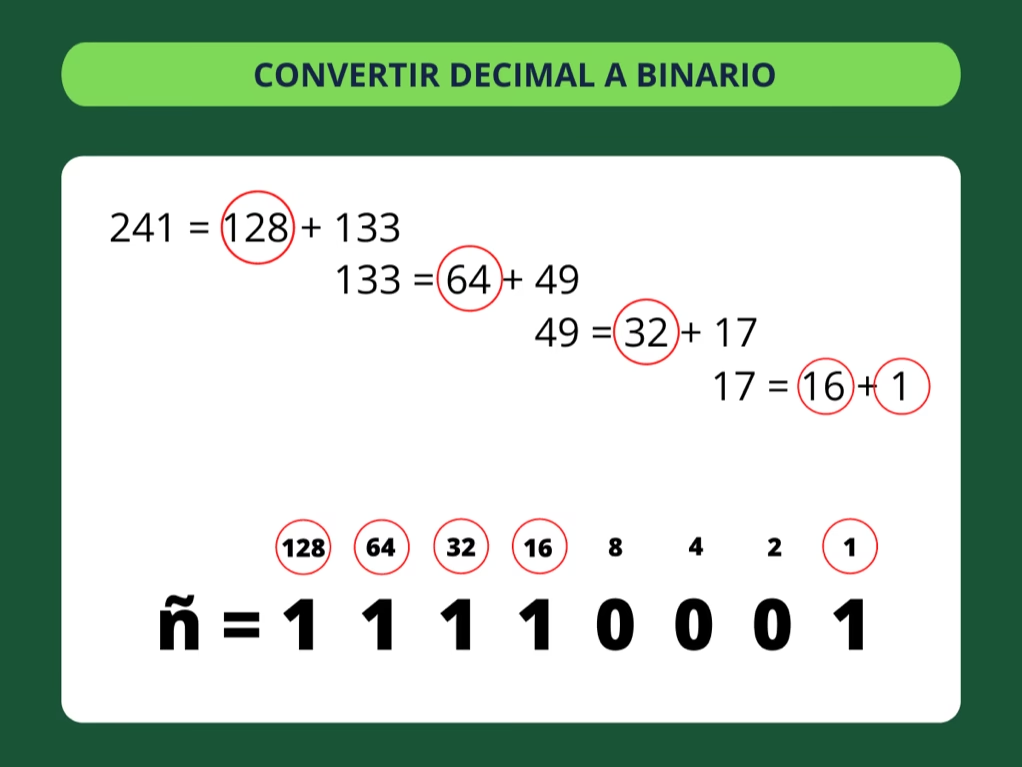

Convierte el Valor Decimal a Binario:

Una vez que tienes el valor decimal, el siguiente paso es convertir ese número decimal a su representación binaria. El método más común para hacer esto es la división sucesiva por 2.

- Toma el número decimal.

- Divídelo por 2.

- Anota el resto (que será 0 o 1).

- Toma el cociente y repite el proceso hasta que el cociente sea 0.

- La secuencia binaria se forma leyendo los restos de abajo hacia arriba.

Veamos el ejemplo de la letra 'h', cuyo valor decimal es 104:

104 ÷ 2 = 52 Resto: 0 52 ÷ 2 = 26 Resto: 0 26 ÷ 2 = 13 Resto: 0 13 ÷ 2 = 6 Resto: 1 6 ÷ 2 = 3 Resto: 0 3 ÷ 2 = 1 Resto: 1 1 ÷ 2 = 0 Resto: 1

Leyendo los restos de abajo hacia arriba, obtenemos 1101000. Dado que los caracteres se suelen representar en bytes (8 bits), añadimos un 0 al principio para completar los 8 bits: 01101000. Este es el valor binario de la letra 'h'.

Descifrando Mensajes: Cómo Convertir Binario a Letras

El proceso inverso, es decir, convertir una secuencia de números binarios de vuelta a letras, es igualmente importante para entender cómo las computadoras procesan la información. Para decodificar, seguimos estos pasos:

Agrupa los Bits en Bytes:

Si tienes una larga cadena de bits, el primer paso es agruparlos en conjuntos de 8 bits (bytes). Esto se debe a que, como mencionamos, la mayoría de los caracteres se codifican en un byte o múltiples bytes en codificaciones como UTF-8.

Convierte Cada Byte a su Valor Decimal:

Para cada grupo de 8 bits, conviértelo de binario a decimal. Para hacer esto, multiplica cada bit por la potencia de 2 correspondiente a su posición, comenzando desde la derecha con 2^0.

Por ejemplo, para el binario 01101000:

(0 * 2^7) + (1 * 2^6) + (1 * 2^5) + (0 * 2^4) + (1 * 2^3) + (0 * 2^2) + (0 * 2^1) + (0 * 2^0) = (0 * 128) + (1 * 64) + (1 * 32) + (0 * 16) + (1 * 8) + (0 * 4) + (0 * 2) + (0 * 1) = 0 + 64 + 32 + 0 + 8 + 0 + 0 + 0 = 104

Busca el Carácter Correspondiente:

Una vez que tienes el valor decimal para cada byte, consulta la tabla ASCII o Unicode para encontrar el carácter que corresponde a ese número.

¿01101000011011110110110001100001 qué significa?

Ahora, apliquemos este proceso a la secuencia binaria que nos has proporcionado:

01101000 01101111 01101100 01100001

Dividimos la secuencia en bytes de 8 bits:

- Primer byte: 01101000

Convertimos a decimal:

0*128 + 1*64 + 1*32 + 0*16 + 1*8 + 0*4 + 0*2 + 0*1 = 64 + 32 + 8 = 104

En la tabla ASCII, el número 104 corresponde a la letra 'h'.

- Segundo byte: 01101111

Convertimos a decimal:

0*128 + 1*64 + 1*32 + 0*16 + 1*8 + 1*4 + 1*2 + 1*1 = 64 + 32 + 8 + 4 + 2 + 1 = 111

En la tabla ASCII, el número 111 corresponde a la letra 'o'.

- Tercer byte: 01101100

Convertimos a decimal:

0*128 + 1*64 + 1*32 + 0*16 + 1*8 + 1*4 + 0*2 + 0*1 = 64 + 32 + 8 + 4 = 108

En la tabla ASCII, el número 108 corresponde a la letra 'l'.

¿Qué es hola en binario? Por lo tanto, HOLA en binario se escribe como 01001000 01000101 01001100 01001100 01001111. - Cuarto byte: 01100001

Convertimos a decimal:

0*128 + 1*64 + 1*32 + 0*16 + 0*8 + 0*4 + 0*2 + 1*1 = 64 + 32 + 1 = 97

En la tabla ASCII, el número 97 corresponde a la letra 'a'.

Uniendo todas las letras decodificadas, la secuencia binaria 01101000011011110110110001100001 significa: hola.

¿Cómo se escribe hola en binario?

Para escribir la palabra 'hola' en binario, simplemente tomamos cada letra y la convertimos individualmente a su representación binaria ASCII (o UTF-8 para caracteres que no sean ASCII puro, aunque en este caso 'hola' es compatible con ASCII):

- h: Ya sabemos que su valor decimal ASCII es 104, que se convierte a 01101000 en binario.

- o: Su valor decimal ASCII es 111, que se convierte a 01101111 en binario.

- l: Su valor decimal ASCII es 108, que se convierte a 01101100 en binario.

- a: Su valor decimal ASCII es 97, que se convierte a 01100001 en binario.

Por lo tanto, la palabra 'hola' escrita en binario es la concatenación de estos valores:

01101000011011110110110001100001

Tabla Comparativa: ASCII vs. Unicode (UTF-8)

Para entender mejor la evolución y las diferencias entre estos dos sistemas de codificación, observemos la siguiente tabla comparativa:

| Característica | ASCII | Unicode (UTF-8) |

|---|---|---|

| Año de origen | 1963 | 1991 |

| Número de caracteres | 128 | Más de 1 millón (en constante expansión) |

| Bits por carácter | 7 bits (fijo) | 1 a 4 bytes (variable) |

| Soporte de idiomas | Principalmente inglés, sin caracteres acentuados o especiales | Todos los idiomas del mundo, símbolos, emojis |

| Compatibilidad con ASCII | N/A | Los primeros 128 caracteres de UTF-8 son idénticos a ASCII |

| Uso común | Sistemas antiguos, protocolos básicos | Web, sistemas operativos modernos, aplicaciones internacionales |

Aplicaciones Prácticas de la Codificación Binaria

La capacidad de codificar letras y otros caracteres en binario es la piedra angular de casi toda la tecnología digital que utilizamos. Algunas de sus aplicaciones prácticas incluyen:

- Almacenamiento de Datos: Cada archivo de texto, documento Word, o página web se guarda en el disco duro o en la memoria de la computadora como una secuencia de bits.

- Comunicación en Redes: Cuando envías un correo electrónico, un mensaje de texto o navegas por internet, tus palabras se convierten en binario para ser transmitidas a través de cables o de forma inalámbrica y luego se decodifican en el destino.

- Programación y Desarrollo de Software: Los programadores escriben código en lenguajes de alto nivel (como Python o Java), pero estos lenguajes se compilan o interpretan en lenguaje máquina (binario) para que la computadora pueda ejecutarlos.

- Seguridad Informática: Los principios de codificación y decodificación son fundamentales en la criptografía, donde los datos se convierten en formatos ilegibles (cifrados) utilizando algoritmos matemáticos, a menudo basados en operaciones binarias, para proteger la información sensible.

- Procesamiento de Texto: Editores de texto, procesadores de palabras y sistemas de gestión de contenido dependen de la correcta codificación y decodificación para mostrar y manipular el texto.

Herramientas y Recursos para la Conversión

Aunque entender el proceso manual es educativo, en la práctica, rara vez necesitarás convertir letras a binario a mano. Existen numerosas herramientas y recursos disponibles:

- Calculadoras Binarias Online: Muchos sitios web ofrecen calculadoras que permiten introducir texto y obtener instantáneamente su equivalente binario, y viceversa. Son útiles para verificaciones rápidas.

- Funciones de Programación: La mayoría de los lenguajes de programación modernos tienen funciones integradas para manejar la codificación y decodificación de caracteres. Por ejemplo, en Python, puedes usar la función

.encode()para convertir una cadena a bytes (binario) y.decode()para lo contrario.

Preguntas Frecuentes (FAQs)

¿Por qué las computadoras no usan el sistema decimal?

Las computadoras usan el sistema binario (base 2) porque sus componentes electrónicos, como los transistores, funcionan mejor con dos estados distintos: encendido (1) o apagado (0). Esto es mucho más confiable y simple de implementar que intentar representar diez estados diferentes (0-9) con voltajes variables.

¿Todos los caracteres se representan con 8 bits?

No, no todos. Mientras que muchos caracteres comunes (especialmente los del alfabeto latino básico) se representan con 8 bits (un byte) utilizando codificaciones como ASCII o los primeros caracteres de UTF-8, otros caracteres (acentos, símbolos especiales, alfabetos de otros idiomas) en UTF-8 pueden requerir 2, 3 o incluso 4 bytes (16, 24 o 32 bits) para su representación binaria.

¿Qué es un byte?

Un byte es una unidad de información digital que consta de ocho bits. Es la unidad básica de almacenamiento de datos en la mayoría de los sistemas informáticos y es suficiente para representar un solo carácter alfanumérico en codificaciones como ASCII.

¿Es lo mismo ASCII que UTF-8?

No son lo mismo, pero están relacionados. ASCII es un conjunto de caracteres y una codificación de 7 bits para 128 caracteres. UTF-8 es una codificación de longitud variable de Unicode, que es un conjunto de caracteres mucho más grande. La relación es que los primeros 128 caracteres de UTF-8 son idénticos a los de ASCII, lo que asegura la compatibilidad hacia atrás.

¿Dónde puedo encontrar una tabla completa de ASCII/Unicode?

Puedes encontrar tablas completas de ASCII y Unicode fácilmente en línea buscando 'tabla ASCII' o 'tabla de caracteres Unicode'. Sitios como Wikipedia o recursos para desarrolladores suelen tener listados detallados.

Conclusión

La conversión de letras a números binarios es un concepto fundamental que subyace a la forma en que interactuamos con la tecnología a diario. Cada vez que escribes, envías un mensaje o lees un texto en tu dispositivo, estás presenciando la magia de la codificación y decodificación de caracteres. Comprender el papel del código binario, así como los estándares como ASCII y Unicode, nos permite apreciar la complejidad y la brillantez de la ingeniería detrás de nuestros sistemas informáticos. Es un recordatorio de cómo un lenguaje de apenas dos dígitos puede dar vida a la vasta y rica diversidad de la información digital que define nuestro mundo moderno.

Si quieres conocer otros artículos parecidos a El Lenguaje Secreto: Convertir Letras a Binario puedes visitar la categoría Cálculos.