18/06/2025

En el vasto universo de los datos, entender cómo una variable se relaciona con otra es fundamental para predecir comportamientos, tomar decisiones informadas y desentrañar patrones complejos. Aquí es donde entran en juego dos pilares de la estadística: los coeficientes de regresión y el coeficiente de correlación. Aunque a menudo se confunden, cada uno ofrece una perspectiva única y complementaria sobre la interdependencia entre variables. Este artículo te guiará a través de sus definiciones, métodos de cálculo, propiedades y, lo más importante, cómo se interrelacionan para ofrecer una comprensión más profunda de tus datos.

¿Qué son los Coeficientes de Regresión?

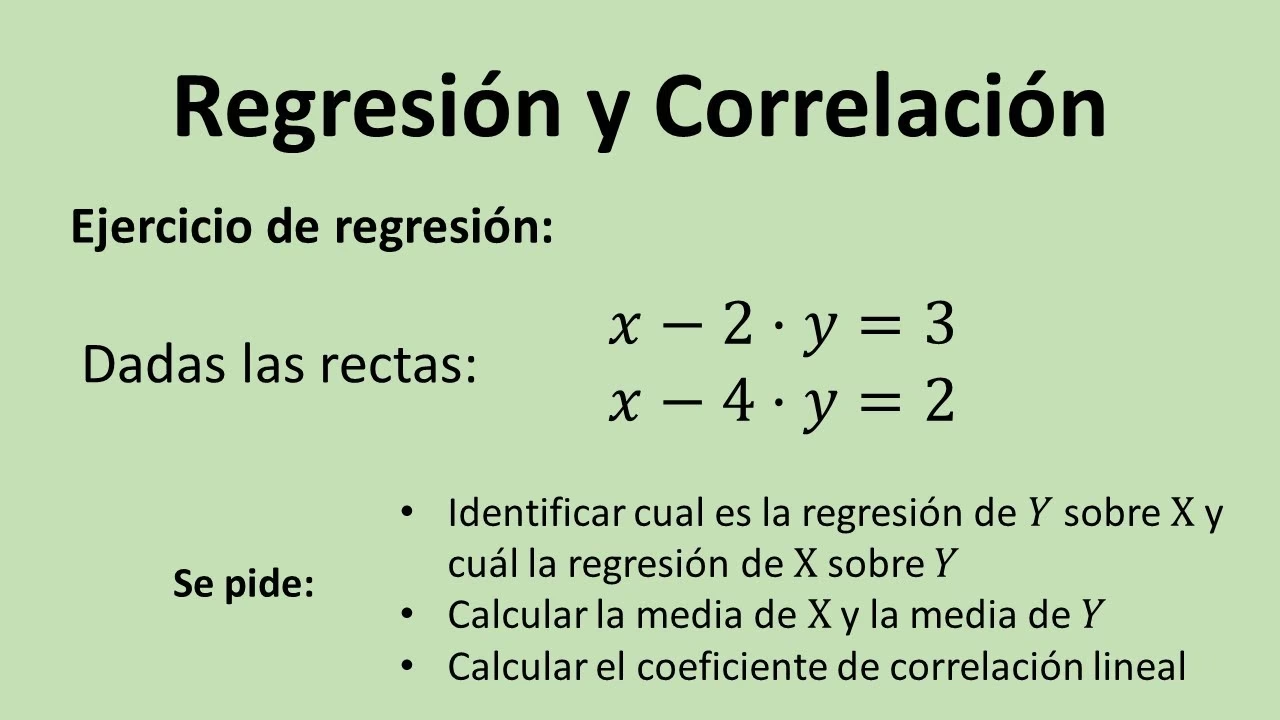

La regresión es una técnica estadística que nos permite modelar la relación entre una variable dependiente (la que queremos predecir) y una o más variables independientes (las que usamos para predecir). En su forma más simple, la regresión lineal, esta relación se expresa como una línea recta. Los coeficientes de regresión son los valores numéricos que definen esta línea, indicando la fuerza y la dirección de la relación de cada variable independiente con la dependiente.

En una ecuación de regresión lineal simple, como Y = b0 + b1X, tenemos dos coeficientes:

- b0 (o 'a'): Es el intercepto o la constante. Representa el valor esperado de Y cuando X es cero.

- b1 (o 'b'): Es el coeficiente de regresión para la variable X. Indica cuánto cambia Y por cada unidad de cambio en X. Si el coeficiente es positivo, un aumento en X se asocia con un aumento en Y; si es negativo, un aumento en X se asocia con una disminución en Y.

Cuando tenemos más de una variable independiente, hablamos de regresión lineal múltiple. La ecuación se expande para incluir un coeficiente para cada predictor: x̂i = c0 + ct * week + ∑j=1, j≠i10 cj * xj. Aquí, c0 es el intercepto, ct el coeficiente para la variable tiempo (semana) y cj los coeficientes para las otras regiones xj. Cada cj nos dice el impacto de la región j en la región i, manteniendo las demás variables constantes.

Cálculo de los Coeficientes de Regresión

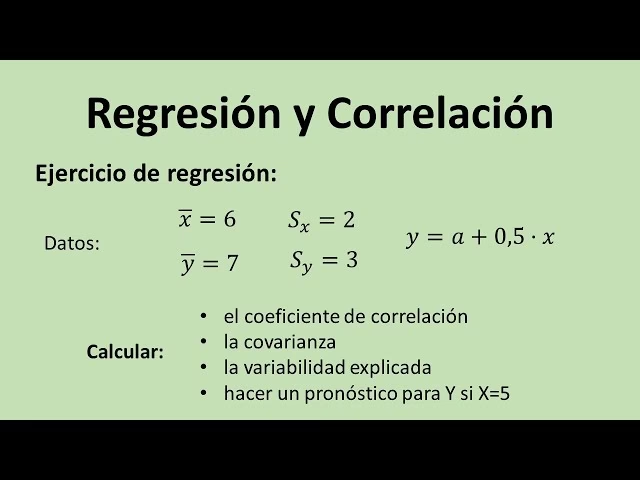

Los coeficientes de regresión se calculan minimizando la suma de los cuadrados de los errores (la diferencia entre los valores observados y los predichos). Para una regresión lineal simple (Y = a + bX), las fórmulas para 'a' y 'b' son:

b = [n(∑xy) – (∑x)(∑y)] / [n(∑x²) – (∑x)²]

a = [(∑y)(∑x²) – (∑x)(∑xy)] / [n(∑x²) – (∑x)²]

Alternativamente, el coeficiente b1 (que es 'b' en la notación anterior) también puede expresarse como:

b1 = ∑[(xi – x̄)(yi – ȳ)] / ∑[(xi – x̄)²]

Donde:

nes el número de observaciones.xieyison los valores individuales de las variables X e Y.x̄eȳson las medias de las variables X e Y, respectivamente.∑denota la suma de todos los valores.

Estas fórmulas nos permiten encontrar la línea que mejor se ajusta a nuestros datos, es decir, la línea que minimiza la distancia total entre los puntos de datos y la línea.

Propiedades Clave de los Coeficientes de Regresión

Los coeficientes de regresión poseen características importantes que debemos comprender:

- Se denotan comúnmente como 'b'. Por ejemplo,

byxpara la regresión de Y sobre X, ybxypara X sobre Y. - Si uno de los coeficientes de regresión (

byxobxy) es mayor que 1, el otro será menor que 1. - No son independientes del cambio de escala. Si las variables X e Y se multiplican por una constante, los coeficientes de regresión cambiarán.

- La media aritmética de ambos coeficientes de regresión (

(byx + bxy)/2) es mayor o igual que el coeficiente de correlación (r). - La media geométrica de los dos coeficientes de regresión (

√(byx * bxy)) es igual al coeficiente de correlación (r). - Si

bxyes positivo, entoncesbyxtambién será positivo, y viceversa. Esto significa que la dirección de la relación es consistente.

¿Qué es el Coeficiente de Correlación Lineal (CCL)?

El coeficiente de correlación lineal, popularmente conocido como el coeficiente de correlación de Pearson (en honor a Karl Pearson, su desarrollador), es una medida estadística que cuantifica la fuerza y la dirección de una relación lineal entre dos variables cuantitativas. Su valor oscila entre -1 y +1.

- Un valor cercano a +1 indica una fuerte correlación lineal positiva: a medida que una variable aumenta, la otra también tiende a aumentar de manera consistente.

- Un valor cercano a -1 indica una fuerte correlación lineal negativa: a medida que una variable aumenta, la otra tiende a disminuir de manera consistente.

- Un valor cercano a 0 indica una ausencia de relación lineal. Es importante notar que esto no significa que no haya relación alguna, solo que no hay una relación lineal. Podría existir una relación no lineal (curva, parabólica, etc.).

La magnitud del coeficiente (cuán lejos esté de cero) indica la fuerza de la asociación, mientras que el signo (+ o -) indica la dirección.

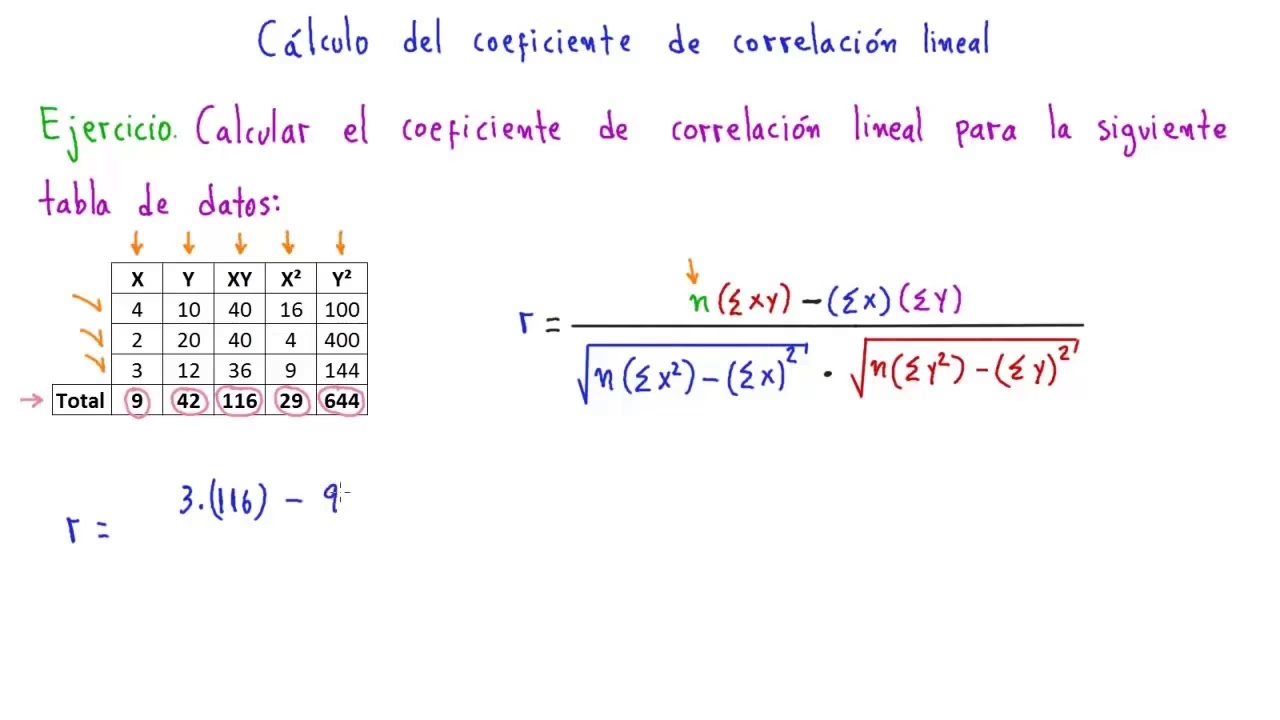

Cálculo del Coeficiente de Correlación

La fórmula para el coeficiente de correlación de Pearson (ρ para la población, r para la muestra) es:

Para la población (ρXY):

ρXY = Cov(X, Y) / (σX * σY)

Donde:

Cov(X, Y)es la covarianza entre X e Y.σXes la desviación estándar de X.σYes la desviación estándar de Y.

Para la muestra (r):

r = [n(∑xy) – (∑x)(∑y)] / √([n(∑x²) – (∑x)²][n(∑y²) – (∑y)²])

Esta fórmula de muestra es la más utilizada en la práctica y nos permite calcular la correlación directamente a partir de los datos.

Diferencias Clave entre Correlación y Regresión

Aunque están estrechamente relacionados, la correlación y la regresión abordan preguntas diferentes y tienen propósitos distintos:

| Base | Correlación | Regresión |

|---|---|---|

| Significado | Medida estadística que define la co-relación o asociación de dos variables. | Describe cómo una variable independiente se asocia con la variable dependiente. |

| Variables | No distingue entre dependiente e independiente; ambas son simétricas. | Establece claramente una variable dependiente (Y) y una o más independientes (X). |

| Uso principal | Para describir la fuerza y dirección de una relación lineal entre dos variables. | Para ajustar la mejor línea y estimar o predecir una variable basándose en otra(s). |

| Objetivo | Encontrar un valor que exprese el grado de relación entre variables. | Estimar valores de una variable aleatoria basándose en los valores de una variable fija. |

| Línea de ajuste | No ajusta una línea a los datos. | Busca la línea que mejor predice Y a partir de X. |

En resumen, la correlación cuantifica la asociación, mientras que la regresión modela la predicción.

La Conexión entre Regresión y Correlación

La relación entre el coeficiente de correlación y los coeficientes de regresión es fundamental. De hecho, los coeficientes de regresión pueden calcularse utilizando el coeficiente de correlación y las desviaciones estándar de las variables:

- Coeficiente de regresión de Y sobre X (byx):

byx = r * (σy / σx) - Coeficiente de regresión de X sobre Y (bxy):

bxy = r * (σx / σy)

Donde r es el coeficiente de correlación de Pearson, σy es la desviación estándar de Y, y σx es la desviación estándar de X. Esta relación destaca que la fuerza de la correlación influye directamente en la pendiente de la línea de regresión, ajustada por la dispersión de cada variable.

Aplicación en el Análisis de Datos Espaciales

Consideremos un ejemplo práctico como el análisis de la distribución espacial de una enfermedad como la ILI (Influenza-Like Illness). Los coeficientes de regresión pueden ayudarnos a modelar cómo la incidencia de ILI en una región (xi) se relaciona con la incidencia en otras regiones (xj) y con el tiempo (week). La ecuación propuesta es:

x̂i = c0 + ct * week + ∑j=1, j≠i10 cj * xj

Aquí, c0, ct y cj son los coeficientes de regresión. Un cj positivo indica que la región j está positivamente relacionada con la región i (si xj aumenta, x̂i también tiende a aumentar), mientras que un cj negativo sugiere una relación inversa. La magnitud del coeficiente refleja la intensidad de esta relación.

La tabla de coeficientes de regresión para diferentes regiones, como la que se presenta en el estudio de ILI, es una mina de oro de información. Por ejemplo, si tomamos la Región 6, podríamos observar que el coeficiente c4 (para la Región 4) es 0.66 y c8 (para la Región 8) es 0.45. Esto indica que la Región 4 y la Región 8 son las que tienen una influencia más fuerte y positiva en la Región 6 en este modelo. El valor de correlación de Pearson (Cor) entre xi y x̂i (la predicción) se utiliza para medir el rendimiento del modelo de regresión. Un Cor de 0.952 para la Región 6, por ejemplo, significa que los valores originales de ILI en la Región 6 pueden ser muy bien aproximados por la ecuación de regresión.

Además de la predicción, los coeficientes permiten entender la dinámica de difusión. Un coeficiente no significativo (cercano a cero) para una variable o región sugiere que tiene una influencia relativamente pequeña en la variable dependiente. Esto es crucial para identificar los factores más influyentes en un fenómeno.

Análisis de Sensibilidad y Coeficientes

El análisis de sensibilidad complementa la interpretación de los coeficientes de regresión al evaluar cómo los cambios en los parámetros de entrada afectan las salidas del modelo. Matemáticamente, el coeficiente de sensibilidad (SI) se define como la derivada de la salida del modelo con respecto a un parámetro de entrada. Para nuestro modelo de regresión, un índice de sensibilidad SIk(c) con respecto a la variable xk (ILI ponderada de la k-ésima región) es simplemente la media del coeficiente de regresión ck. Esto valida que los coeficientes de regresión son, en esencia, estimaciones a posteriori de la sensibilidad del modelo a cada variable.

Preguntas Frecuentes (FAQs)

P: ¿Un coeficiente de correlación de cero significa que no hay relación entre las variables?

R: No, significa que no hay una relación lineal. Podría existir una relación no lineal (curva, parabólica, etc.) que el coeficiente de correlación de Pearson no detectaría.

P: ¿Es lo mismo correlación que causalidad?

R: ¡Definitivamente no! La correlación indica una asociación o una tendencia a variar juntas, pero no implica que una variable cause a la otra. La causalidad es un concepto mucho más complejo que requiere experimentación controlada o un diseño de estudio riguroso para establecerse.

P: ¿Cuándo debo usar correlación y cuándo regresión?

R: Usa la correlación cuando quieras cuantificar la fuerza y dirección de la relación lineal entre dos variables sin implicar una relación de causa y efecto o predicción. Usa la regresión cuando quieras modelar la relación para predecir el valor de una variable (dependiente) basándose en una o más variables (independientes).

P: ¿Qué es un buen valor para el coeficiente de correlación?

R: El "buen" valor depende del contexto. En ciencias sociales, un r de 0.5 puede ser fuerte, mientras que en física, se espera un r mucho más cercano a 1. Un valor más cercano a +1 o -1 siempre indica una relación lineal más fuerte.

P: ¿Los coeficientes de regresión pueden ser negativos?

R: Sí, un coeficiente de regresión negativo indica una relación inversa: a medida que el valor de la variable independiente aumenta, el valor de la variable dependiente tiende a disminuir.

Conclusión

Los coeficientes de regresión y el coeficiente de correlación son herramientas estadísticas poderosas e indispensables para cualquier analista de datos o investigador. Mientras que el coeficiente de correlación nos da una visión concisa de la fuerza y dirección de la asociación lineal, los coeficientes de regresión nos permiten construir modelos predictivos y entender el impacto individual de cada variable. Dominar el cálculo y la interpretación de ambos es fundamental para transformar datos brutos en insights valiosos, permitiéndonos no solo comprender el pasado, sino también prever el futuro y tomar decisiones estratégicas en diversos campos, desde la economía hasta la salud pública.

Si quieres conocer otros artículos parecidos a Coeficientes de Regresión y Correlación: Desvelando Relaciones puedes visitar la categoría Estadística.